在人工智能领域,文本到图像生成(Text-to-Image Generation)技术正迅速发展,其应用范围从娱乐到专业设计不断扩展。然而,风格一致性生成一直是该领域的一个技术难题。最近,InstantX团队提出了一种名为InstantStyle的新框架,旨在解决这一挑战。

InstantStyle框架的核心在于两个创新策略,以实现从参考图像到目标内容图像的风格迁移,同时保持内容的文本可控性。

特征空间内的风格和内容解耦

-

风格和内容的特征表示:在InstantStyle中,风格和内容是通过特征空间来表示的。利用CLIP模型(一种将图像和文本映射到共享特征空间的模型),可以分别提取参考图像的风格特征和内容文本的特征。

-

减法操作:通过对参考图像的CLIP特征和内容文本的CLIP特征进行简单的减法操作,InstantStyle能够去除图像特征中与内容相关的部分,从而得到更加纯粹的风格特征。这种方法基于的假设是,在CLIP的特征空间内,特征可以进行数学运算,如加法和减法。

-

减少内容泄露:通过这种减法操作,InstantStyle显著减少了内容泄露的问题。内容泄露是指在生成的图像中,不期望出现的参考图像的内容元素(如特定的纹理或物体)被错误地包含进来。减法操作有效地去除了这些不需要的内容元素,使得生成的图像更加符合风格迁移的目标。

特定风格块的特征注入

-

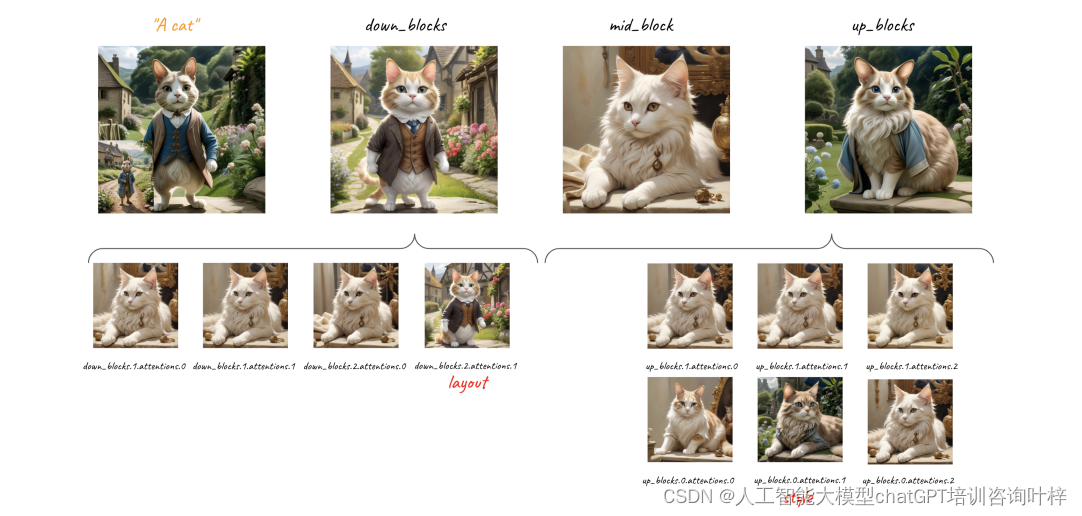

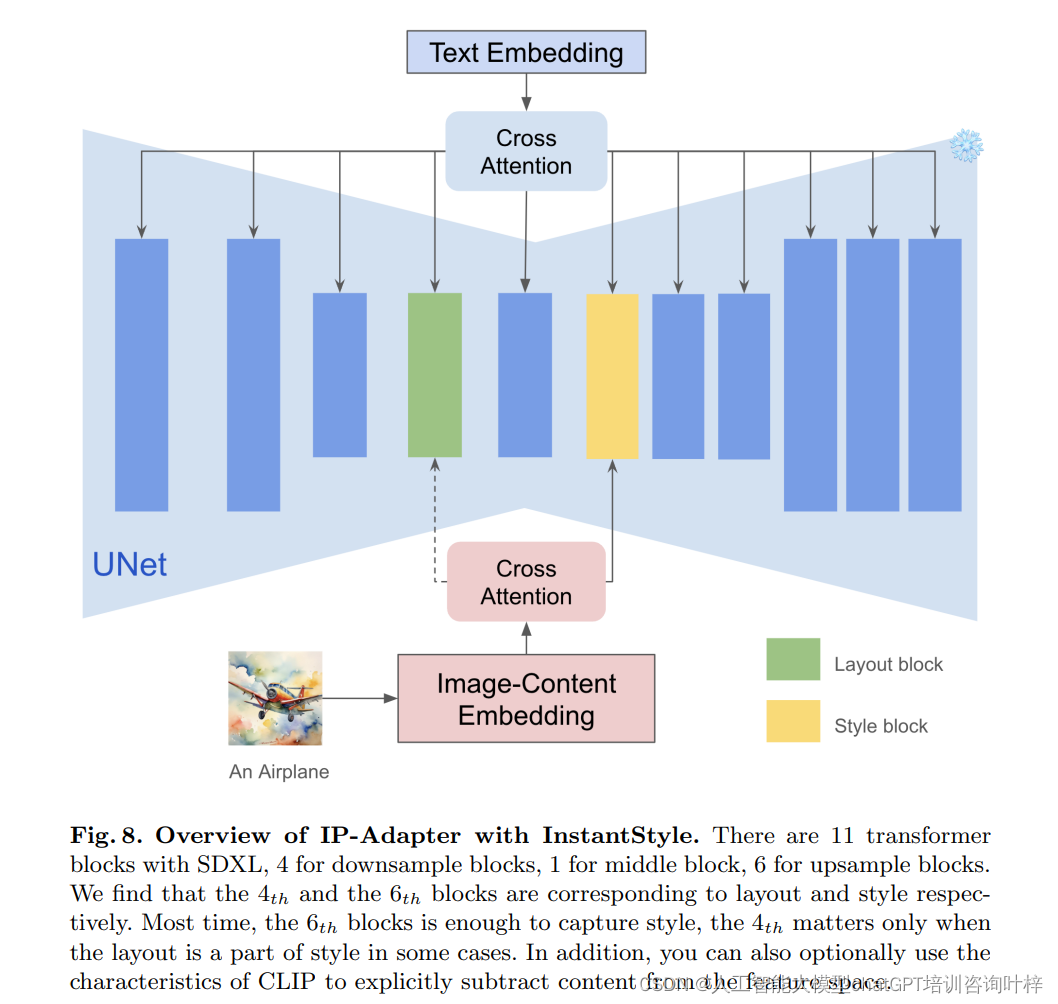

风格块的识别:在扩散模型中,某些层(称为“风格块”)被认为对风格信息更加敏感。InstantStyle通过实验发现,特定的注意力层(如模型中的上采样和下采样层)能够更好地捕捉风格信息。

-

特征注入:找到这些风格块后,InstantStyle仅将图像特征注入到这些特定的层中,而不是扩散模型的所有层。这种方法避免了在非风格相关的层中注入特征,从而减少了不必要的内容泄露。

-

隐式解耦:通过将特征注入限制在风格块内,InstantStyle能够在不需要全面调整模型权重的情况下,隐式地完成风格和内容的分离。这简化了模型的训练和微调过程,因为不需要对每个参考图像进行复杂的参数调整。

-

增强的文本控制能力:此外,由于注入的参数数量减少,模型对文本提示的控制能力得到了增强。这意味着生成的图像不仅在视觉上与风格参考一致,同时也能够根据文本描述进行有效的内容调整。

通过这两种策略,InstantStyle在保持风格一致性的同时,也提供了对生成内容的精细控制,这在文本到图像生成领域是一个重要的进步。

实验结果

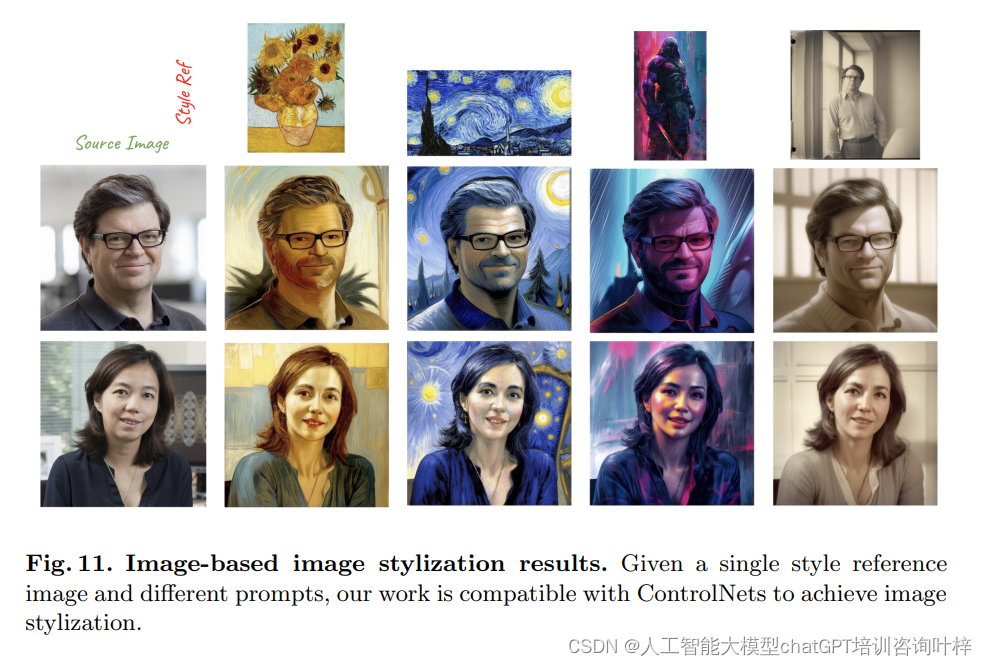

文提供了多个实验结果的例子,展示了InstantStyle在不同风格和内容上的图像生成效果。这些例子通常包括给定单一风格参考图像和不同文本提示下生成的图像,以此证明了模型在风格一致性上的能力。

-

文本驱动的图像风格化:实验结果显示,InstantStyle能够在不同的文本提示下,使用单一风格参考图像生成风格一致的图像。与手动权重调整相比,InstantStyle无需繁琐的参数调整,即可实现高保真度的风格迁移。

-

基于图像的风格化:通过与ControlNet(一种空间控制网络)结合,InstantStyle还展示了其在图像到图像的风格迁移任务中的兼容性和有效性。

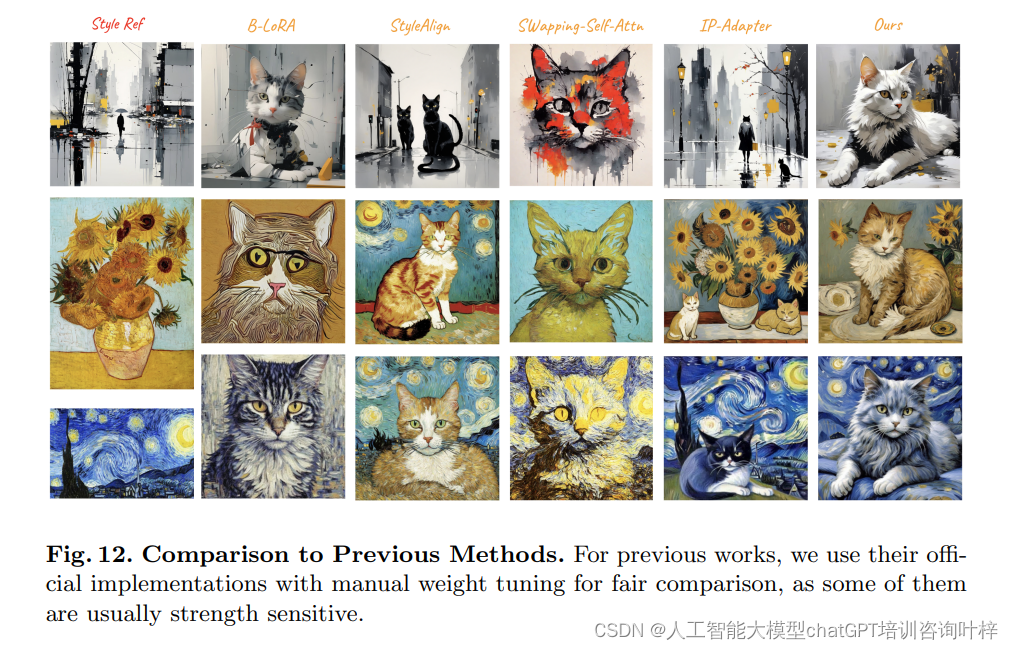

与现有方法的比较

InstantStyle在风格迁移的视觉效果上超越了现有的先进方法,如StyleAlign、Swapping Self-Attention、B-LoRA和原始的IP-Adapter。这些方法在风格定义、内容泄露和风格强度控制方面存在差异,但InstantStyle在视觉一致性和操作简便性上展现出了明显优势。

如StyleAlign、Swapping Self-Attention、B-LoRA和原始的IP-Adapter。这些例子通过视觉比较来展示InstantStyle在风格迁移任务中的优越性。

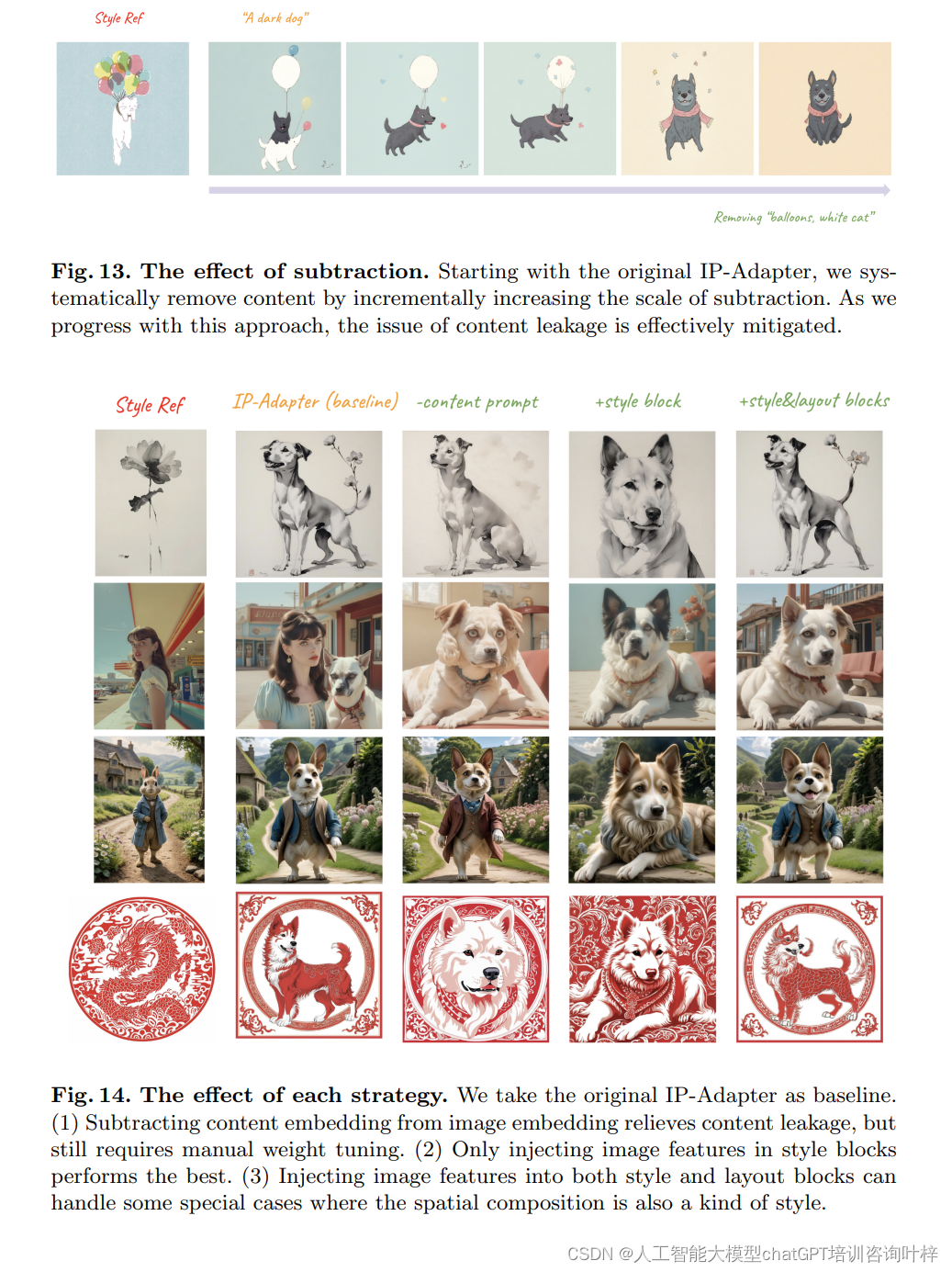

消融研究

消融研究进一步验证了InstantStyle提出的两个策略的有效性:

- 减法操作:通过从图像嵌入中减去内容嵌入,可以减少内容泄露,但仍然需要手动调整强度。

- 风格块注入:仅将图像特征注入到风格块中,不仅减少了内容泄露,而且无需手动调整强度,提供了最简洁、优雅的解决方案。

InstantStyle通过其创新的方法论,在文本到图像生成的领域中实现了风格保持的重要突破。该框架不仅提高了风格迁移的质量和可控性,而且减少了参数调整的复杂性。未来的工作将集中在进一步提升InstantStyle的性能和扩展其在视频生成等其他领域的应用。

论文链接:https://arxiv.org/abs/2404.02733

项目地址:https://instantstyle.github.io/

1095

1095

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?