第八讲 加载数据集

Dataset and DataLoader

总结:

1、Dataset和Dataloader是实现加载数据集的两个工具类,Dataset构造数据集,要使得数据集能支持下标索引,dataloader用来加载mini-batch进行使用

2、梯度下降有几种选择,一种是一次把全部数据加载,就是batch,可以充分利用向量化的优势,提升计算速度;另外一种SGD,每次只用一个样本,可以在优化当中会克服鞍点的问题,但没法利用并行计算能力,速度慢。故常用mini-batch来均衡性能和速度上的需求。

3、epoch指把所有样本拿来训练几次,batch-size指每次训练时所用的样本数量、iteration指mini-batch一共多少个。

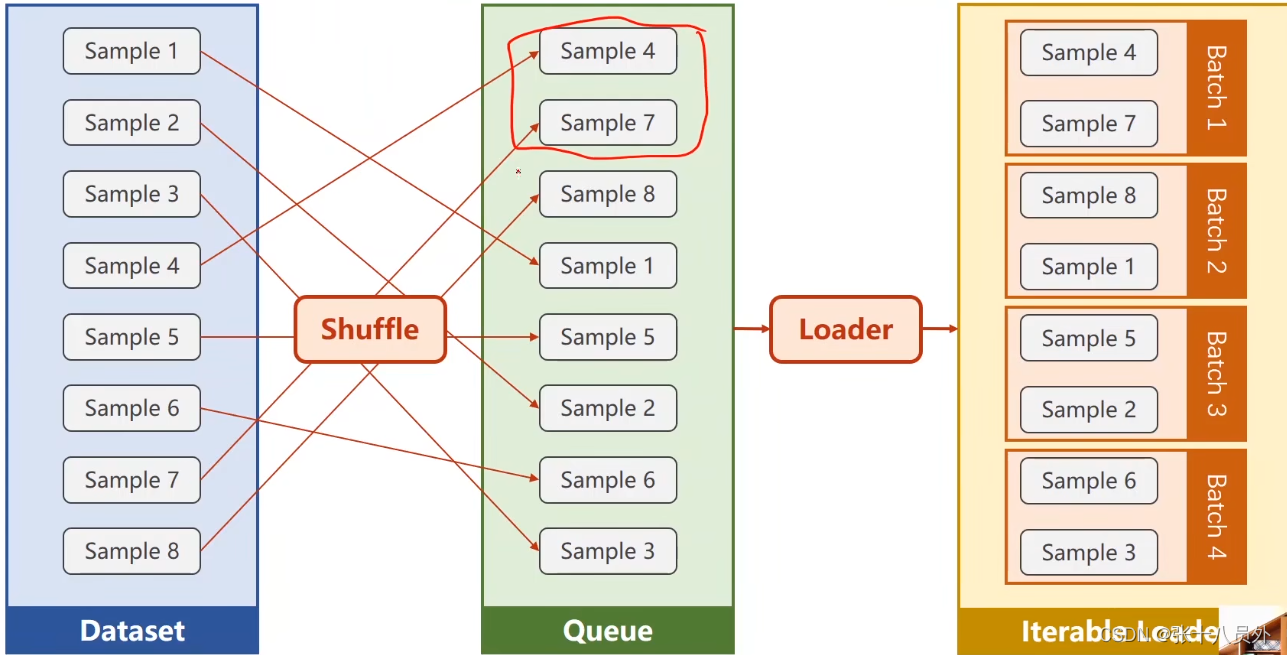

4、dataloader的作用:拿到一个数据集(该数据集支持索引,长度)确定batch-size,并随机打乱,生成一个个mini-batch,做成一个可迭代的loader,每一次迭代是给的每一个batch

5、Dataset是一个抽象类,不能实例化,只能被其他子类继承;dataloader可以实例化

6、自己定义的类继承Dataset类之后,需要定义魔法方法,getitem()方法的作用是,再用该类实例化一个对象后,该对象能支持下标索引,每次使用索引,就会调用这个魔法方法;len()同样

代码:

import numpy as np

import torch

from torch.utils.data import Dataset, DataLoader

# step 1 prepare dataset

class DiabetesDataset(Dataset): # 继承Dataset抽象类

def __init__(self, filepath):

xy = np.loadtxt(filepath, delimiter=",", dtype=np.float32)

self.len = xy.shape[0]

self.x_data = torch.from_numpy(xy[:, :-1])

self.y_data = torch.from_numpy(xy[:, [-1]])

def __getitem__(self, index):

return self.x_data[index], self.y_data[index]

def __len__(self):

return self.len

mydataset = DiabetesDataset("diabetes.csv.gz")

train_loader = DataLoader(dataset=mydataset, batch_size=32, shuffle=True)

# step2 : design model using class

class Model(torch.nn.Module):

def __init__(self):

super(Model, self).__init__()

self.linear1 = torch.nn.Linear(8, 6)

self.linear2 = torch.nn.Linear(6, 4)

self.linear3 = torch.nn.Linear(4, 1)

self.activate = torch.nn.Sigmoid()

def forward(self, x):

x = self.activate(self.linear1(x))

x = self.activate(self.linear2(x))

x = self.activate(self.linear3(x))

return x

model= Model()

# step3: construt Loss and Optimizer

criterion = torch.nn.BCELoss(size_average=True)

optimizer = torch.optim.SGD(model.parameters(), lr=0.001)

# train

if __name__ == "__main__":

for epoch in range(100):

for i, (inputs, labels) in enumerate(train_loader, start=0):

# forward

y_pred = model(inputs)

loss = criterion(y_pred, labels)

print(f"第{epoch}轮,第{i}个批次", "loss: ", loss.item())

# backward

optimizer.zero_grad()

loss.backward()

# update

optimizer.step()

9万+

9万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?