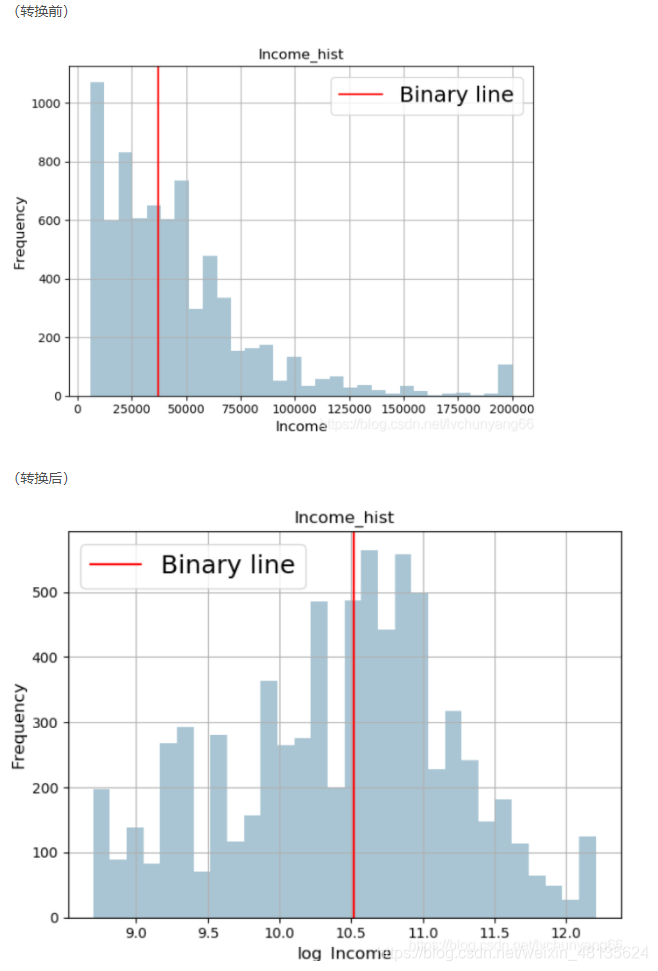

机器学习算法中,一些算法要求数据符合正态分布,但是对于一些标签和特征来说,分布不一定符合正态分布,

我们可以用np.log1p(x),即取对数,这样可以使得数据在一定程度上符合正态分布的特征。(正态分布(Normal distribution),也称高斯分布(Gaussian distribution)

数据平滑处理 -- log1p( ) 和 exmp1( )

1. 数据预处理时首先可以对偏度比较大的数据用og1p函数进行转化,使其更加服从高斯分布,此步处理可能会使我们后续的分类结果得到一个好的结果。

2. 平滑问题很容易处理掉,导致模型的结果达不到一定的标准,log1p( )能够避免复值得问题 — 复值指一个自变量对应多个因变量

log1p( ) 的使用就像是一个数据压缩到了一个区间,与数据的标准类似。其逆运算就是expm1的函数

由于使用的log1p()对数据进行了压缩,最后需要将预测出的平滑数据进行一个还原,而还原过程就是log1p的逆运算expm1.

log1p = log(x+1)

当x较大时直接计算,当x较小时用泰勒展开式计算。

#le是2.718281828459

np.log1p(1e-99)

#1e-99

np.log(1 + 1e-99)

#0.0结论:log1p函数有它存在的意义,即保证了x数据的有效性,当x很小时(如 两个数值相减后得到),由于太小超过数值有效性,用

计算得到结果为0,换作log1p则计算得到一个很小却不为0的结果,

同样的道理对于expm1,当x特别小,就会急剧下降出现如上问题,甚至出现错误值。

未经过np.log1p()处理的,经过数据后,符合正态分布图像展示:

1513

1513

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?