5月14日凌晨,OpenAI2024年春季发布会上线。

这场发布会,表面看有点简陋(全程只有26分钟,现场只有几十名观众),却是科技圈公认的魔法时刻。因为OpenAI上线了一款可以跟人“谈恋爱”的大模型——GPT-4o。

GPT-4o是GPT-4的升级版,后面的o代表“omni”(全知全能)。GPT-4o能同时输入和输出文本、音频和图像信息,反应速度最短达到了232毫秒,完全可做到与人类在正常对话中同频。

腾讯新闻评价,GPT-4o的发布,使得ChatGPT进入实时互动纪元。

图片来源:机器之心

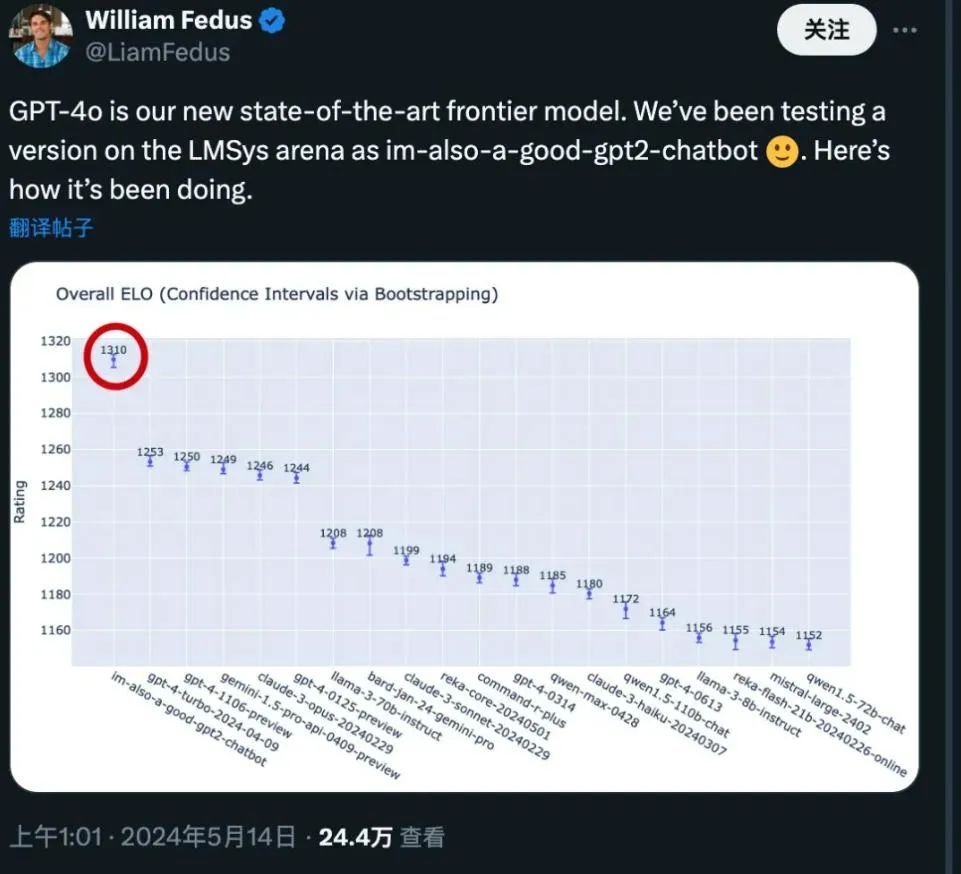

最近,专业人士曾对所有的大模型做了评分测试,结果发现,GPT-4o的得分高达1310,性能远超GPT-4 Turbo、GPT-4、Gemini等模型,刷新业界水平。 怪不得OpenAI创始人、CEO山姆·奥特曼说:“(GPT)对我来说就像魔法一样”。

在发布会上,为了展现GPT-4o的魅力,OpenAI的三位高管米拉·穆拉蒂(Mira Murati)、陈马克(Marc Chen)和巴雷特·琐法(Barret Zoph)在台上做起了演示,向观众展示了五大应用场景。

在第一个场景里,陈先生表示自己上台很紧张,然后假装喘粗气。GPT捕捉到了这个细节,就用幽默的语气安慰陈先生,“别紧张,你不是吸尘器”。然后GPT细心地指导陈先生如何做深呼吸。

图片来源:机器之心

在第二个场景里,陈先生要求GPT给巴雷特讲一个睡前故事。当GPT讲得正起劲的时候,Marc一次又一次地打岔,要求GPT一遍又一遍地重讲,还希望它以唱歌的语调结束故事。GPT没有抱怨也没有迟疑,而是很丝滑地完成了任务。

在第三个场景里,巴雷特希望GPT辅导自己做数学题,但不能直接说答案,而是要一步一步给出解题思路。这个任务对GPT-4o就是小菜一碟,于是巴雷特加大了任务难度,把一串源代码展现给GPT-4o看,然后要求GPT-4o用一句话描述这段代码的含义。没有一秒钟迟疑,GPT-4o就给出了巴雷特想要的答案。

最后一个场景是,米拉说意大利语,陈先生说英语,让GPT-4o做翻译。然后GPT-4o就做起了同声传译,效果非常好。

看完场景演示后,很多网友们都惊出一身冷汗。尤其是做心理医生、语文老师、数学老师、程序员和翻译员的朋友,没想到这么快AI杀到自家工位了。

5月14日,国际货币基金组织总裁表示,未来两年,对于发达经济体而言,人工智能可能会影响60%的工作岗位;而对于全球所有国家而言,人工智能可能将冲击40%的工作岗位。

当然也有乐观者表示,就算旧职业消失了,也会有新职业出现,没什么可担心的。他们关心的是ChatGPT的使用方法和价格变化。之前有人因为付费问题,放弃了ChatGPT。

所以当OpenAI技术总监米拉·穆拉蒂宣布“GPT-4o向所有人免费开放”开放时,现场响起了雷鸣的掌声。

OpenAI越风光,谷歌、微软等友商的压力就越大。就在OpenAI发布GPT-4o的24个小时后,谷歌召开了“I/O大会”,发布了类似GPT-4o的个人数字助理Pixie。本月21日,微软也将召开“Build开发者大会”,市场猜测其大概率会将OpenAI最新能力集成到自家产品线中。

而大洋彼岸的中国人,也时刻关注以OpenAI为代表的美国AI产业的发展进度。大家都想知道,国产大模型与GPT-4o的差距有多大。为此,我们咨询了几位技术专家和产业观察者,一起来听听他们的看法吧。

胡延平

FutureLabs未来实验室首席专家

我认为这次OpenAl发布会,准确来讲是一次伪装成春季update的智能交互变革,貌似一小步的一大步,可以说OpenAl将再次制造一波焦虑。

从这次发布会里,我觉得可以总结出6个信号。

1.大模型从此呆瓜变"真人”。

之前的模型,只能读文看图和迟滞感明显的语音交互,如今GPT-4o可以实现实时多模态的自然交互。

这意味着实时能看懂、能插嘴说、能思考响应,还能有各种小情绪自然交互的能力,让智能真正成为智能。也意味着,应用场景、用户基数等会被几何级放大。

2.GPT-4o的多模态自然交互能力,是GPT-5能力的选择性释放。

GPT-4o的能力,不只是包含了GPT4的后端能力+前端Chatbot聊天机器人,还有GPT-5的部分能力,说明OpenAI在控制节奏,不会也不愿意一次性把GPT-5全都放出来。

3.巨大的冲击。

一批基于GPT做语音等多模态自然交互的企业,一批基于家庭做情感陪伴的企业,一批基于机器人做具身智能交互界面的企业,他们的智能硬件底层逻辑都需要进一步重构,手机厂商中做自研模型的,也要更努力了。

助手、教育、翻译等岗位更危险了……套壳GPT或OTT的商业模式,都会被GPT-4o反手盖帽。

4.与其他模型拉开差距。

苹果的Siri呆若木鸡,Anthropic的Claude相形失色,谷歌的Gemini,能力有限……

客观而言,其它的或闭源或开源大模型,没有如此能打的。而且有了GPT-4o,估计付费用户里没几个人再愿用GPT-4。

5.GPT-4o免费使用,是典型的营销漏斗策略。

GPT-4o目前是免费可限次数使用,付费可无限使用,和之前开放免费的GPT-3.5类似,是典型的营销漏斗策略。

不过在付费层次上还没充分拉开梯度,估计需求量较大的非开发者和非企业用户,在使用GPT-4o时会更频繁地遭遇更严重的受限情况。

6.移动终端的生产力爆发力,将不输AI PC等生产力场景。

要重新理解摄像头、机器视觉和听觉了。未来手机等移动终端和碎片场景下的应用生产爆发力,将不输AI PC等生产力场景,甚至移动终端会率先引爆,走在最前面,这意味着,未来涉及到的改变不只是几亿用户,而是几十亿用户。

目前GPT的竞品,在一些基准测试成绩如何接近GPT-4,会是竞争维度之一,假设OpenAl手里还藏着未打出来的牌,那么接下来竞争的维度可能会有好几个,竞争对手短时间不会那么容易追赶上。

张孝荣

深度科技研究院院长

OpenAI发布的GPT-4o模型在过去的基础上,又往前迈了一大步。

简单来说,在技术层面,他们提升了机器的理解能力,反应速度和交互水平,提升了系统安全性和性价比

技术突破主要体现在5个方面:

1.多模态理解与生成: GPT-4o能够处理文本、音频和图像的任意组合输入,并生成相应的输出,且视觉能力得到了提升,能够快速回答有关图片或桌面屏幕的问题,这在图像识别和理解方面是一大突破。

2.实时推理响应: GPT-4o在音频输入的平均响应时间为320毫秒,最短响应时间为232毫秒,与人类的响应时间相似。

3.语音交互能力: GPT-4o能进行自然的对话,并且能模拟不同的情感表达,如兴奋、友好甚至讽刺,使得语音交互更加自然和人性化。同时,GPT-4o支持多达50种语言,并显著提高了非英语语言的性能,这意味着模型具有更广泛的应用范围。

4.增强安全性: GPT-4o在设计中内置了跨模式的安全性,并创建了新的安全系统,为语音输出提供护栏,这表明模型安全性更高了。

5.性能提升与成本降低: 与GPT-4 Turbo相比,GPT-4o的速度提高了2倍,价格降低了一半,速率限制提高了5倍,这在提效降本方面是重大进步。

目前GPT-4o在文本、推理、编码等方面实现了与GPT-4 Turbo相当的性能,同时在多语言、音频和视觉功能方面创下了新高,但还有待进一步测评,才能判断是否是业界性能最强的模型。

现在GPT-4o对所有用户免费开放,具有两重意义。

◎ 第一重是行业意义。

这意味着更广泛的用户群体可以接触到这一先进的AI技术,从而推动技术的普及和应用,而且可以激励开发者和企业探索新的应用场景。

当然免费提供模型,也是OpenAI扩大市场份额和影响力的一种策略,可以获取更多用户,用户的引入,会生产大量数据,从而扩大OpenAI自身数据训练范围,进一步提升模型精准度。

◎ 第二重是用户意义。

普通人可以更方便地利用AI技术解决问题。在多语言支持、音频和视觉理解方面的改进,使得普通人可以在更多场景下使用GPT-4o,比如语言学习、内容创作、编程辅助、教育辅导、日常任务处理和娱乐互动。

相比以往模型,GPT-4o新增了实时语音对话和图像识别功能。用户在使用这些功能的时候,体验也会更好一些。

接下来,GPT-4o可能替代的岗位,主要在数据处理和语言交互方面,比如客服、翻译、内容审核和数据录入等工作。

这次GPT-4o的发布,意味着美国在AI发展方向上,又前进了一步,不过AI技术成熟度依然有待提升。

张津京

BT财经创始人

这次OpenAI发布的GPT-4o,更多是进行商业化的探索,技术上并没有太先进。

因为GPT-4o基本上就是一个对话大模型,本质是将文字对话变成语音,中间加上了一部分联想,相当于把Sora对于自然语言的处理算法结合进来了,但是这部分算法结合的能力也不会太强,在使用过程中,GPT-4o的错误率也很高。

GPT-4o,底层算法还是GPT-4,而且是能力上降了级的GPT-4,但超过了GPT-3.5,相当于OpenAI把GPT-4做成了不同层级的应用。

之所以这样分层,是因为OpenAI在针对不付费、也不注册的客户,以此在免费人群里拓展,成本会受限。

而OpenAI的更深层次目的,是想不断地探索GPT商业化的前景。

目前OpenAI的商业逻辑越来越清晰了。不仅开放了GPT-4不注册也可使用的限制,而且把GPT-4的能力降级,变得更加偏功能化,这样就能在不同的应用上打造不同的模型,并形成不同的细分收费赛道,从而建立起整个商业模式。

不过OpenAI的规划虽然有一定的操作性,但能不能把GPT作为真正的必需品让大家付费,能不能持久下去,而不是用户因为觉得有意思,付一段时间后又不付了,一切都还未定。

目前来看,这种对话式大模型到底有多强的生命力,也无法确定。

OpenAI依然还是在互联网思维下做大模型产品,而我们的大模型是在不断地接近生产生活的一线,让更多的一些超乎想象的东西诞生出来。

这也是大模型现在的两个方向。

如何学习大模型 AI ?

由于新岗位的生产效率,要优于被取代岗位的生产效率,所以实际上整个社会的生产效率是提升的。

但是具体到个人,只能说是:

“最先掌握AI的人,将会比较晚掌握AI的人有竞争优势”。

这句话,放在计算机、互联网、移动互联网的开局时期,都是一样的道理。

我在一线互联网企业工作十余年里,指导过不少同行后辈。帮助很多人得到了学习和成长。

我意识到有很多经验和知识值得分享给大家,也可以通过我们的能力和经验解答大家在人工智能学习中的很多困惑,所以在工作繁忙的情况下还是坚持各种整理和分享。但苦于知识传播途径有限,很多互联网行业朋友无法获得正确的资料得到学习提升,故此将并将重要的AI大模型资料包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

-END-

👉AI大模型学习路线汇总👈

大模型学习路线图,整体分为7个大的阶段:(全套教程文末领取哈)

第一阶段: 从大模型系统设计入手,讲解大模型的主要方法;

第二阶段: 在通过大模型提示词工程从Prompts角度入手更好发挥模型的作用;

第三阶段: 大模型平台应用开发借助阿里云PAI平台构建电商领域虚拟试衣系统;

第四阶段: 大模型知识库应用开发以LangChain框架为例,构建物流行业咨询智能问答系统;

第五阶段: 大模型微调开发借助以大健康、新零售、新媒体领域构建适合当前领域大模型;

第六阶段: 以SD多模态大模型为主,搭建了文生图小程序案例;

第七阶段: 以大模型平台应用与开发为主,通过星火大模型,文心大模型等成熟大模型构建大模型行业应用。

👉大模型实战案例👈

光学理论是没用的,要学会跟着一起做,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

👉大模型视频和PDF合集👈

观看零基础学习书籍和视频,看书籍和视频学习是最快捷也是最有效果的方式,跟着视频中老师的思路,从基础到深入,还是很容易入门的。

👉学会后的收获:👈

• 基于大模型全栈工程实现(前端、后端、产品经理、设计、数据分析等),通过这门课可获得不同能力;

• 能够利用大模型解决相关实际项目需求: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。因此,掌握大模型应用开发技能,可以让程序员更好地应对实际项目需求;

• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模型部署)一站式掌握;

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握可以提高程序员的编码能力和分析能力,让程序员更加熟练地编写高质量的代码。

👉获取方式:

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

945

945

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?