关于网页端所见即所得的文献阅读需求,可以参考我之前的博客:

文献阅读web端插件1:https://blog.csdn.net/weixin_62528784/article/details/144273276

文献阅读web端插件2:https://blog.csdn.net/weixin_62528784/article/details/144328475

此处总结更新网页端LLM翻译、LLM QA插件

LLM QA插件:中文用kimi,英文用max ai(tb共享会员30/月左右)

LLM翻译插件:

事情起因:因为文本内容大多在网页上的原因,我基本上已经放弃了本地翻译软件(偶尔还会使用本地的网易有道翻译),而网页端的翻译插件(google、deepl、划词翻译等)基本上达不到需求,

使用LLM QA插件需要prompt,无法所见立即所得,

所以日益增长的文献速读翻译需求与不便利LLM插件(需要prompt)、不准确机翻(基本上都是垃圾没法读)之间的矛盾;

所以我需要一个web端随开随用(插件化)、专业化(参考网易有道有生物医学等domain knowledge语料库翻译)、智能化(优化上下文逻辑,例如使用LLM技术)的翻译插件

我并不是提倡阅读文献时经常看翻译,不然个人学术英语水平就会被限制,只是确实在平时看到很多研究生、本科生学术群体需要临时、应急、速读且不被垃圾机翻浪费时间的需求

目前推荐使用沉浸式翻译,或者是有道灵动翻译

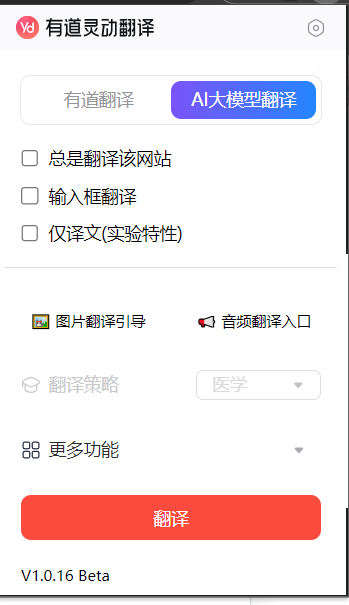

1,有道灵动翻译:的AI LLM翻译version

翻译策略:参考生物医学语料库

LLM:本身用于优化翻译逻辑链条以及文本可读性

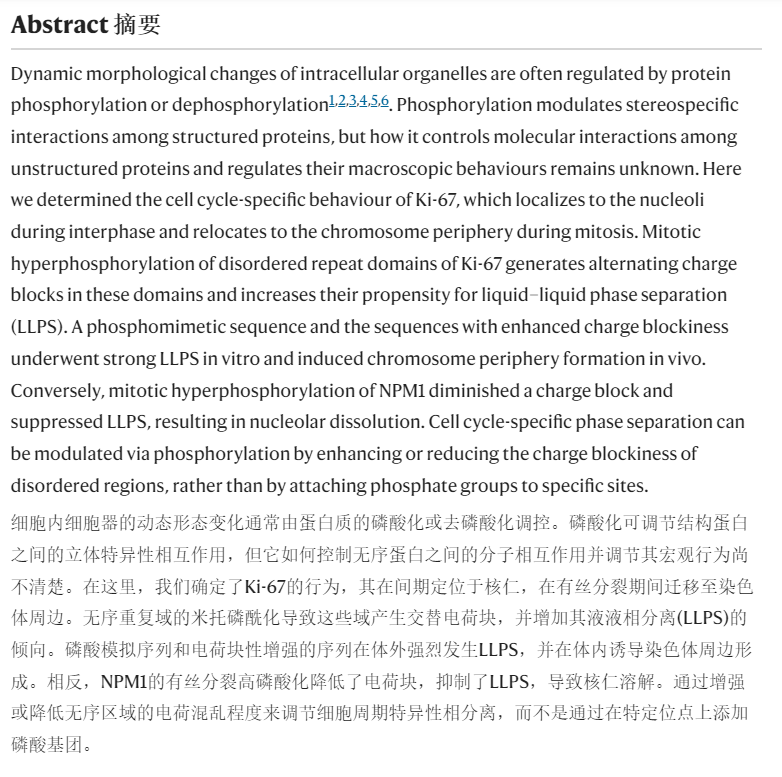

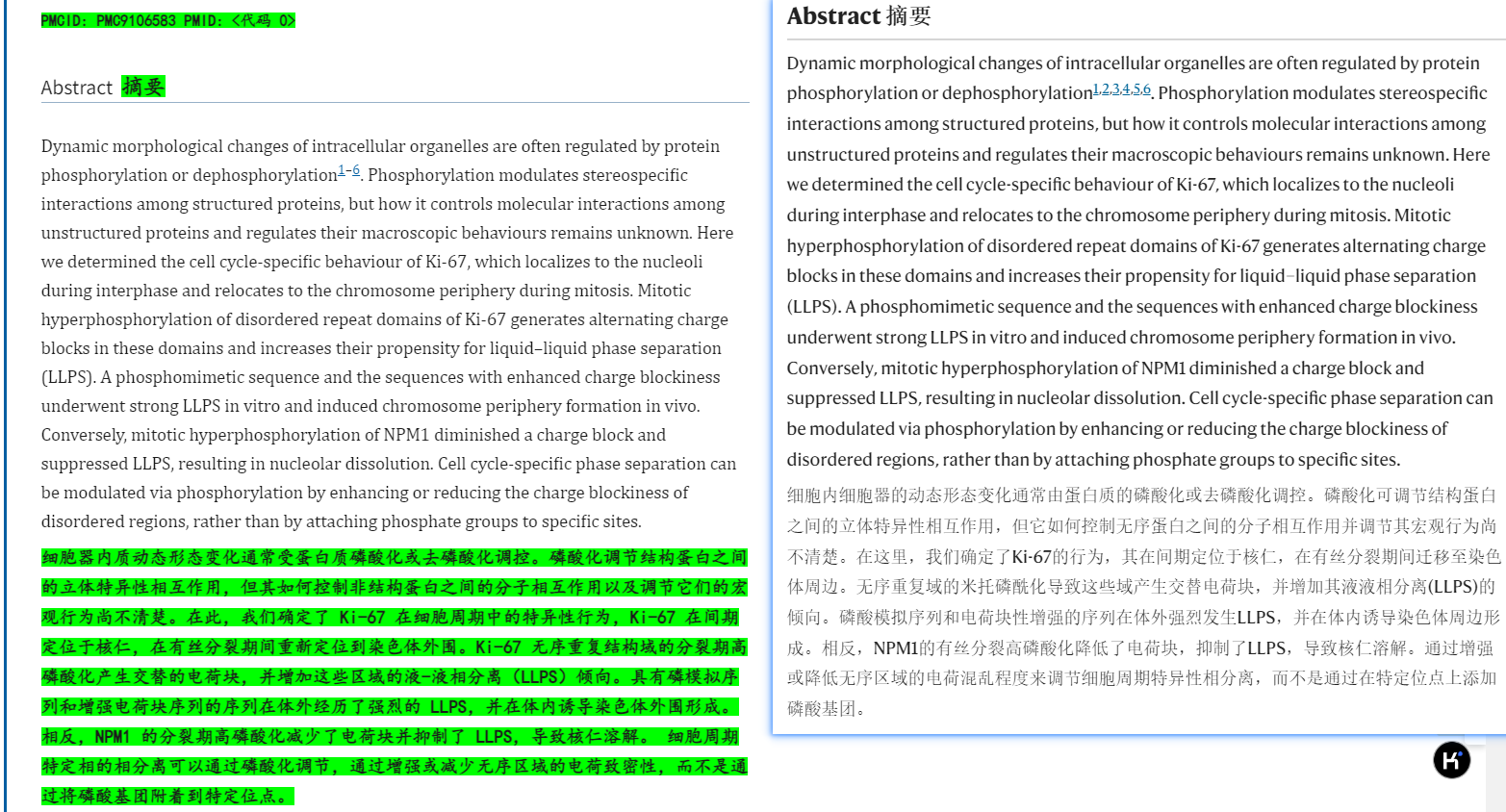

**翻译效果如下:

**

2,沉浸式翻译:

文档参考https://immersivetranslate.com/zh-Hans/docs/usage/?force=1

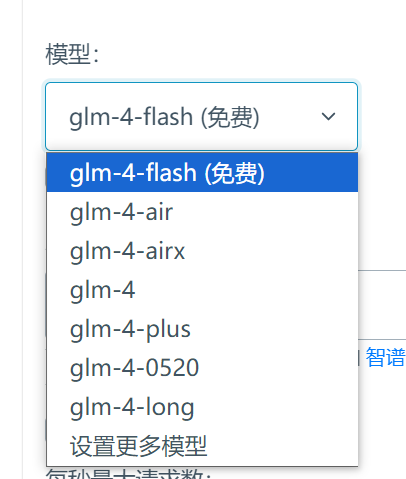

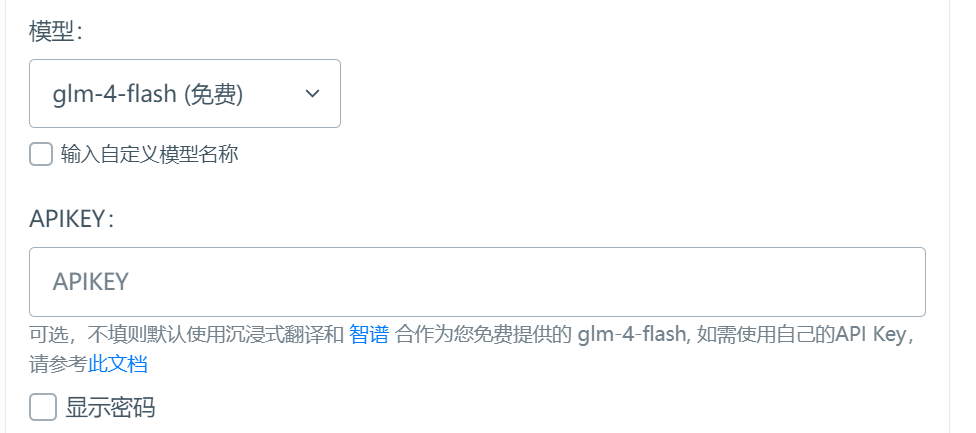

选择智谱GLM翻译

实际上是可以使用API接入其他的LLM,比如说是gemini、openai、claude、kimi之类

事实上借助各种LLM:

https://dash.immersivetranslate.com/#services

如果要使用其他LLM价格上会有点小贵:

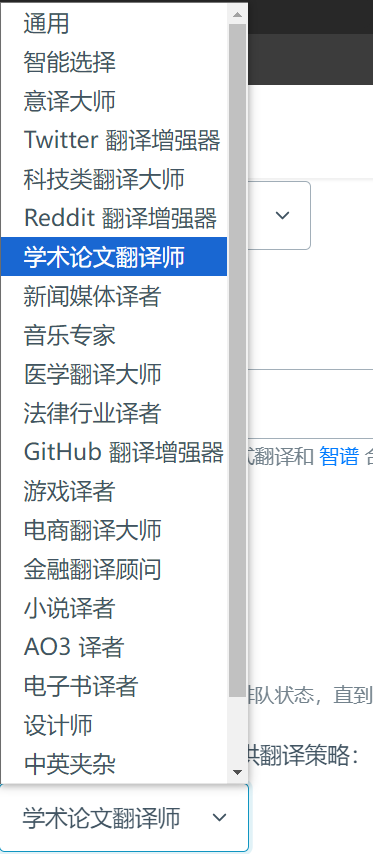

学术论文翻译或医学翻译大师(应该就是语料库提示词)

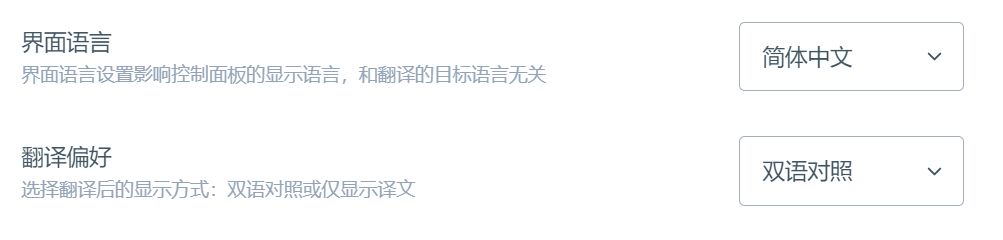

选淡绿色,护眼可持续阅读

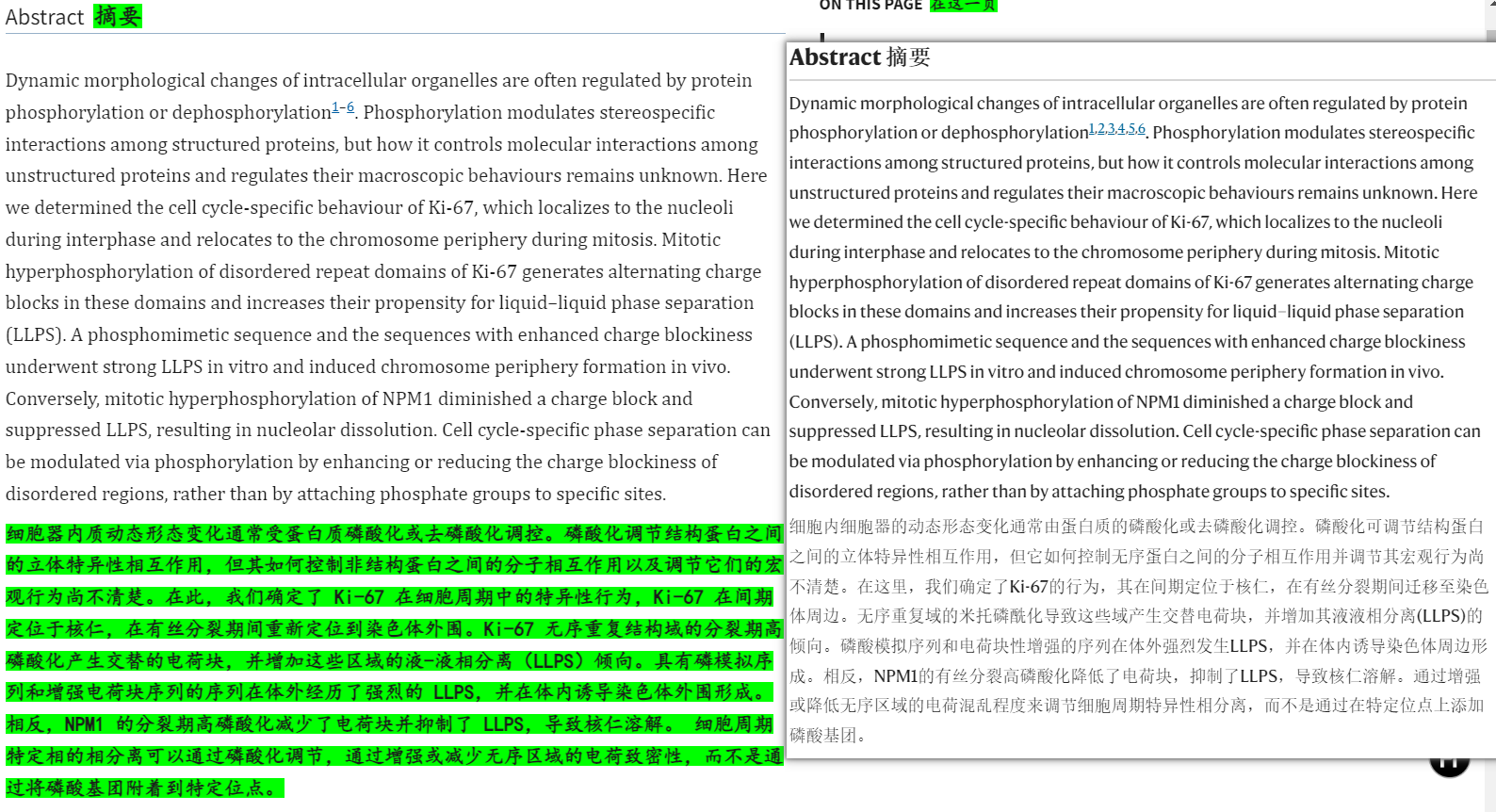

斜体、字体粗细999、楷体,大概效果如下:

最终建议效果:绿色护眼、楷体,不开斜体,字体加粗

鼠标悬停:按ctrl则对鼠标所悬停区域进行双语切换

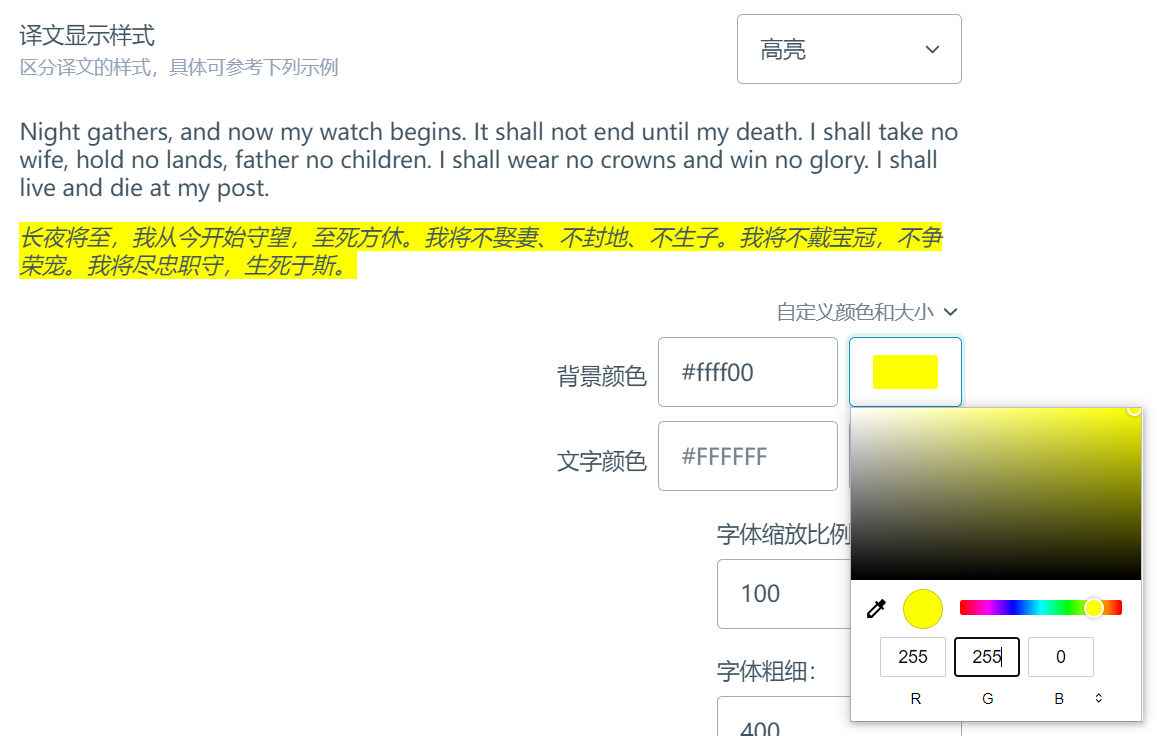

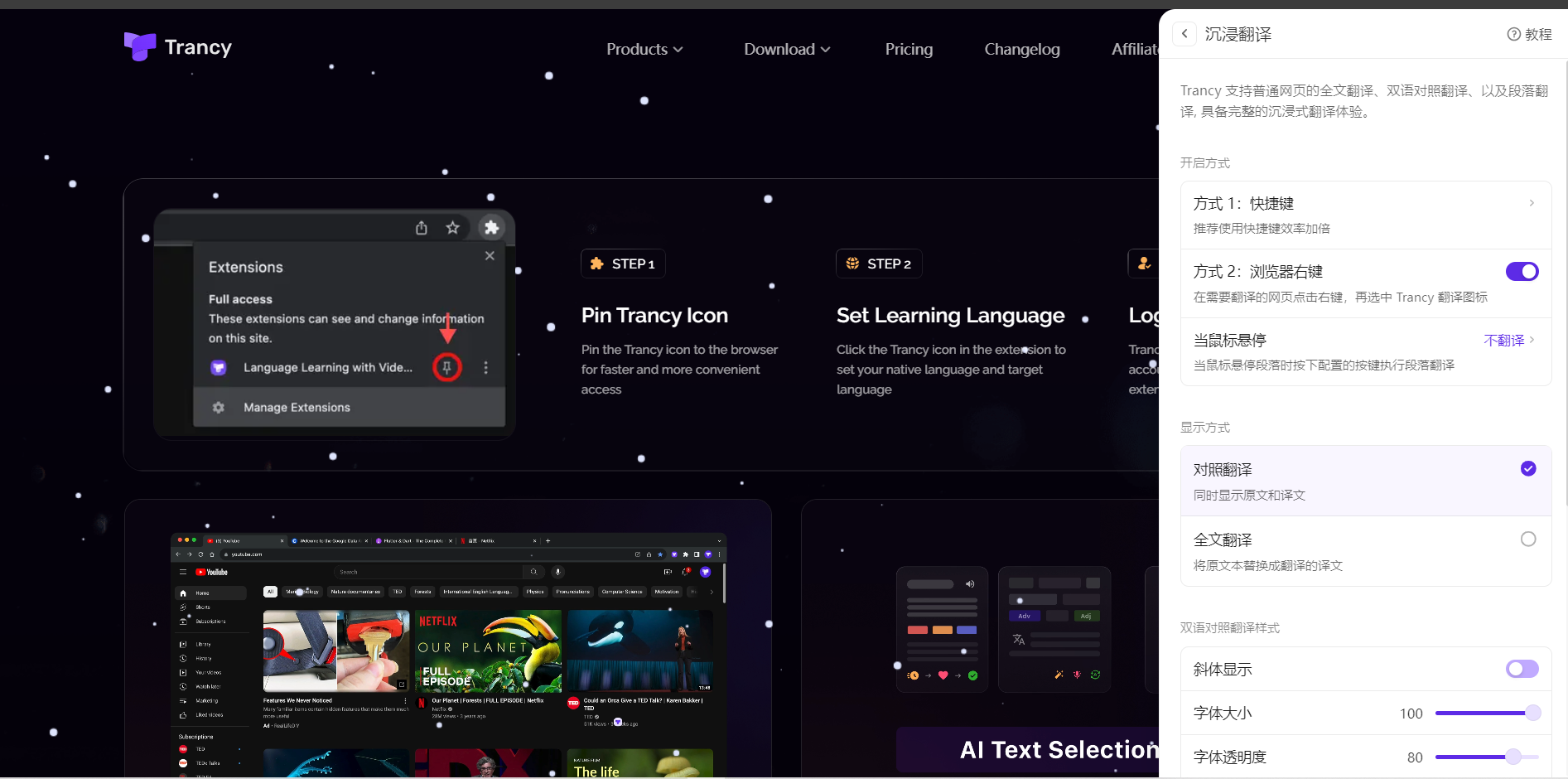

3,trancy

实际翻译效果还是弹窗式的,不简洁,效果和有道翻译类似

****

****

=======》

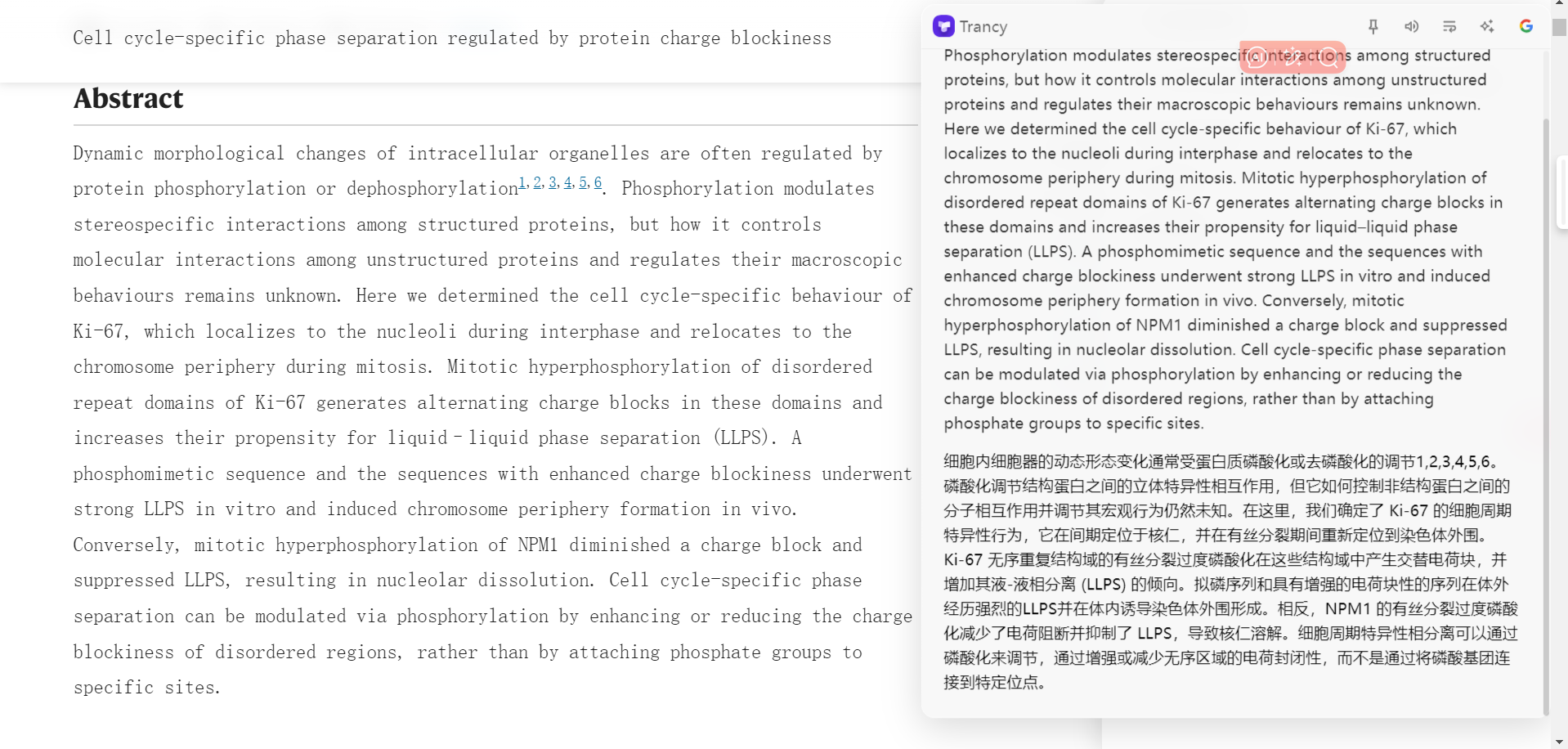

实际效果可以比对一下:主要是有道灵动翻译vs沉浸式翻译+智谱LLM

摘要效果上都差不多

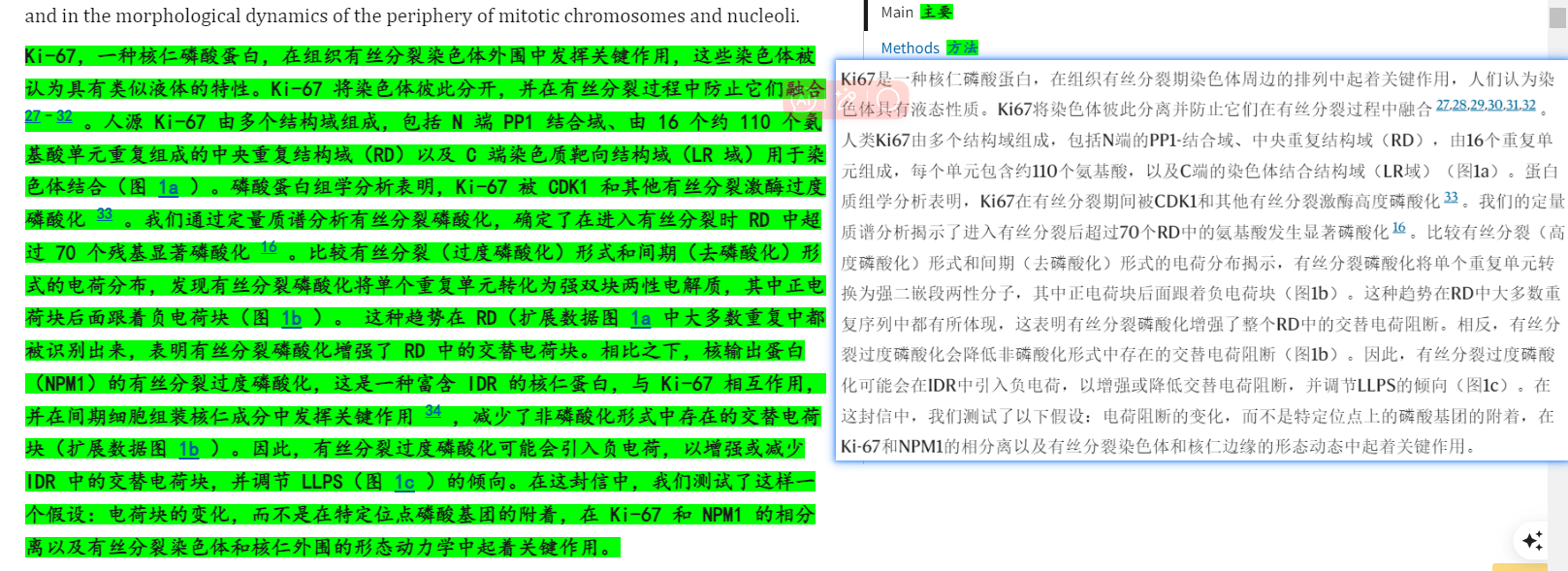

实际正文中效果:也差不多

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?