一、PCA介绍:

1. 历史由来

PCA(主成成分分析)是一种线性降维方法,于1901年由卡尔·皮尔逊(Karl Pearson)发明,作为力学中主轴定理的类比;后来由哈罗德·霍特林在20世纪30年代独立开发并命名。

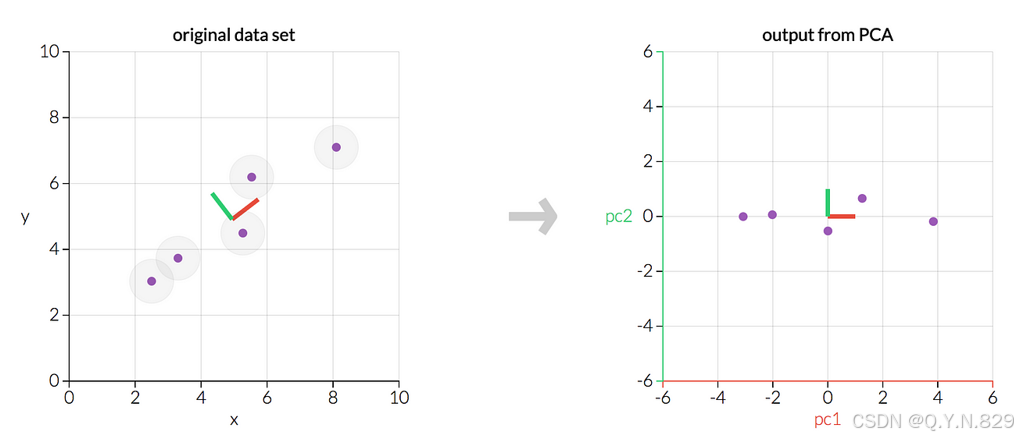

2. PCA的直观

直观来讲,PCA就是为了在数据中寻找有代表性的(有信息量的)正交基,定义新的坐标系。如下图所示:

二、PCA的几种解释

1. 最大方差:PC是数据变化最大(信息最丰富)的方向

PCA 被定义为实内积空间上的一种正交线性变换,它将数据转换到一个新的坐标系中,使数据的某个标量投影的最大方差位于第一个坐标上(称为第一个主成分),第二个最大方差位于第二个坐标上,以此类推。

下面给出这个解释的数学描述:

数据矩阵 X ( n × p ) X\quad (n\times p) X(n×p) , 其中 n n n 代表不同的重复实验(在单细胞应用场景中就代表细胞), p p p 代表不同特征(在单细胞场景中常常代表不同基因)。

下面定义一个变换矩阵 W W W ,将 X X X 的特征从 p p p 变为 l l l (一般 l < p l<p l<p 以实现降维的目的):

X ( i ) = ( x 1 , x 2 , . . . , x p ) ( i ) i = 1 : n X_{(i)}=(x_1,x_2,...,x_p)_{(i)}\quad i=1:n X(i)=(x1,x2,...,xp)(i)i=1:n 是原来的数据矩阵X的第 i 行

w ( k ) = ( w 1 , w 2 , . . . , w p ) ( k ) T k = 1 : l w_{(k)}=(w_1,w_2,...,w_p)^T_{(k)}\quad k=1:l w(k)=(w1,w2,...,wp)(k)Tk=1:l 是变换矩阵 W W W 的第 k 列

经过 W W W 变换后得到新的矩阵 T = X W T=XW T=XW ,其中第 ( i , j ) (i,j) (i,j) 元就是 t k ( i ) = X ( i ) ⋅ W ( k ) t_{k(i)}=X(i)\cdot W(k) tk(i)=X(i)⋅W(k)

这样我们就把数据矩阵从 n × p n\times p n×p 降维到了 n × l n\times l n×l 维。

之后我们需要对变换后矩阵的每个特征数据的方差进行最大化,即最大化T矩阵的每一列的数值的平方和。

我们先对第1列进行优化,即:

w ( 1 ) = a r g m a x ∣ ∣ w ∣ ∣ = 1 { Σ i ( t 1 ) ( i ) 2 } = a r g m a x ∣ ∣ w ∣ ∣ = 1 { Σ i ( x ( i ) ⋅ w ) 2 } (1) w(1)=\underset{||w||=1}{argmax}\left\{\underset{i}{\Sigma}{(t_1)_{(i)}^2} \right\}=\underset{||w||=1}{argmax}\left\{\underset{i}{\Sigma}{(x_{(i)}\cdot w)^2} \right\} \tag{1} w(1)=∣∣w∣∣=1argmax{

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

940

940

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?