💥💥💞💞欢迎来到本博客❤️❤️💥💥

🏆博主优势:🌞🌞🌞博客内容尽量做到思维缜密,逻辑清晰,为了方便读者。

⛳️座右铭:行百里者,半于九十。

📋📋📋本文目录如下:🎁🎁🎁

目录

2.1 RBFNN_Optimized_hideen_node_20

2.2 RBFNN_Lattice_hideen_node_3_6

💥1 概述

文献来源:

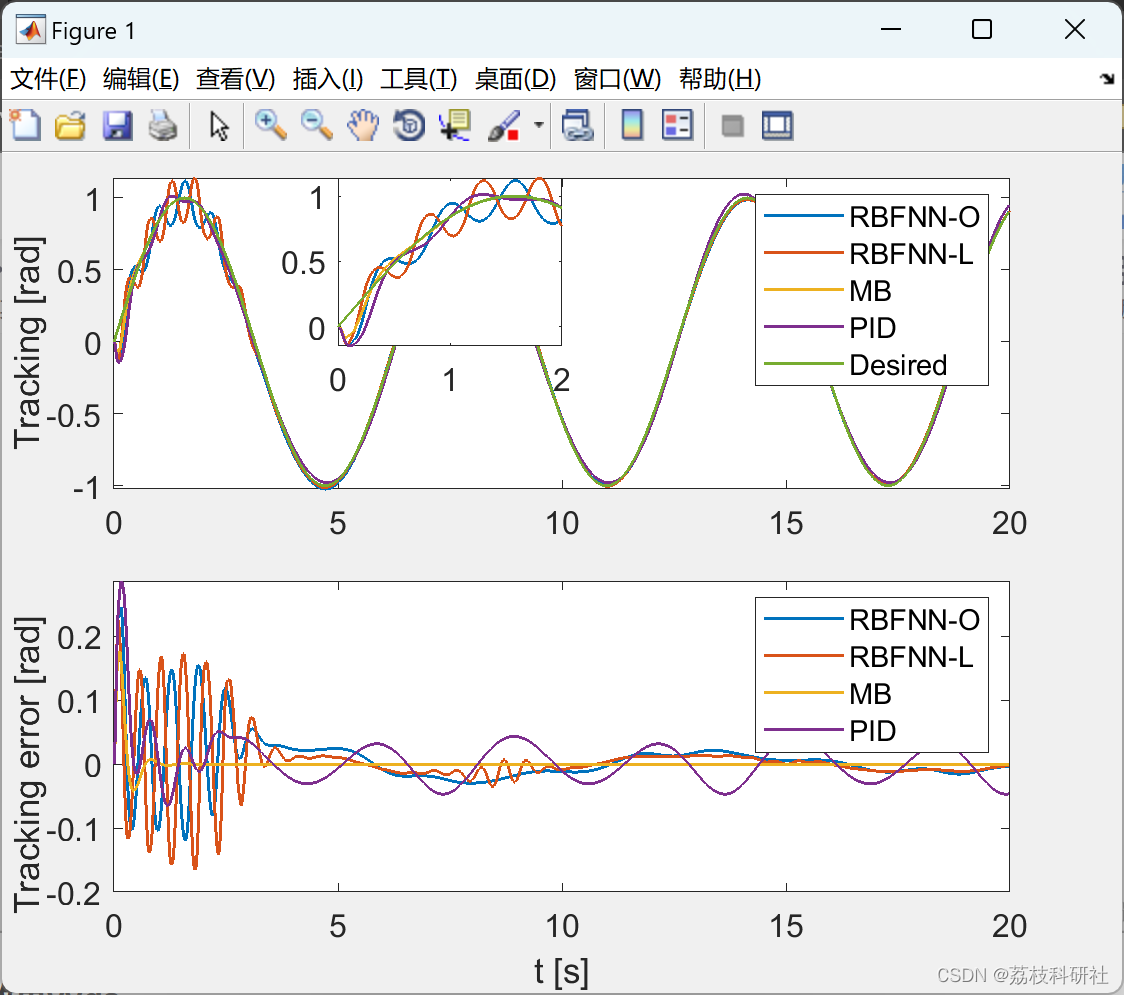

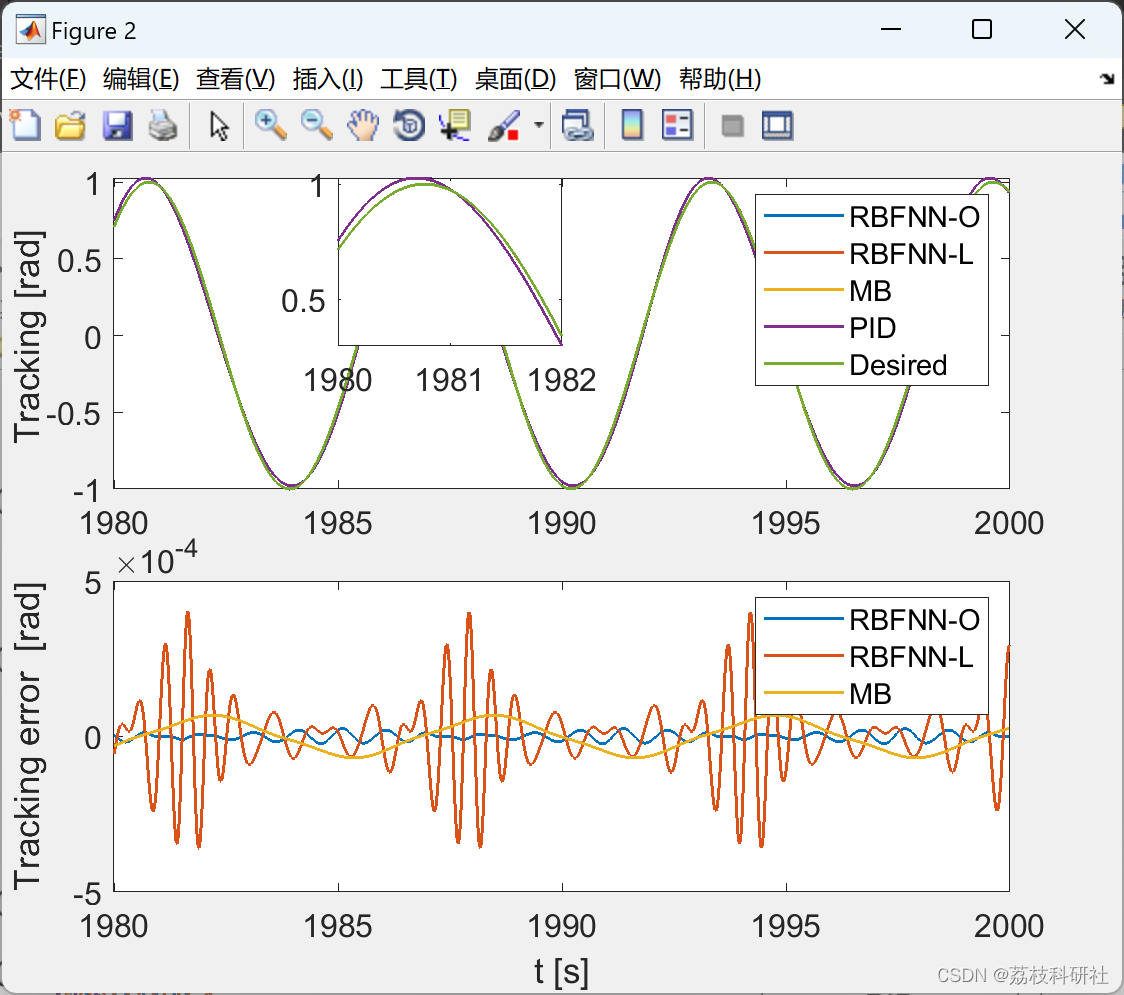

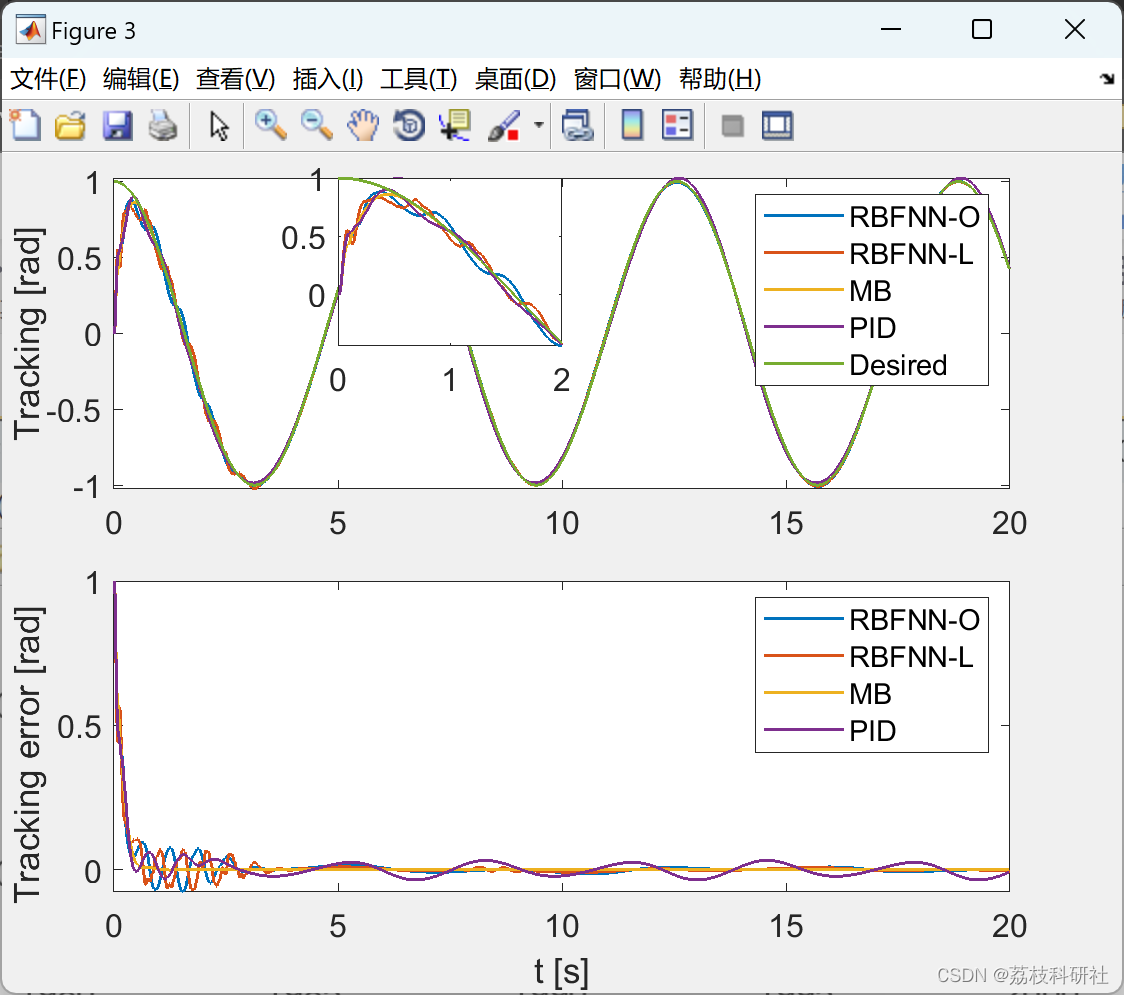

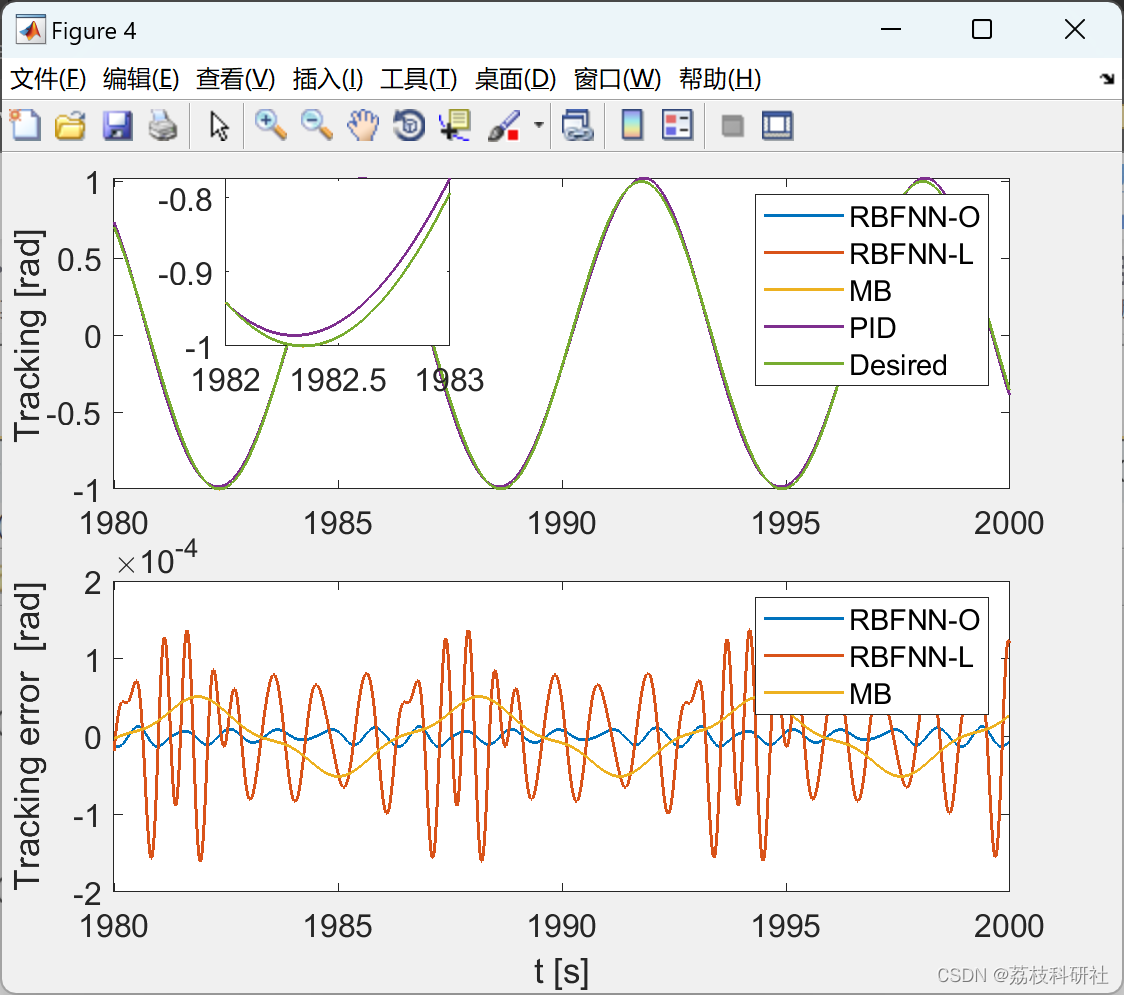

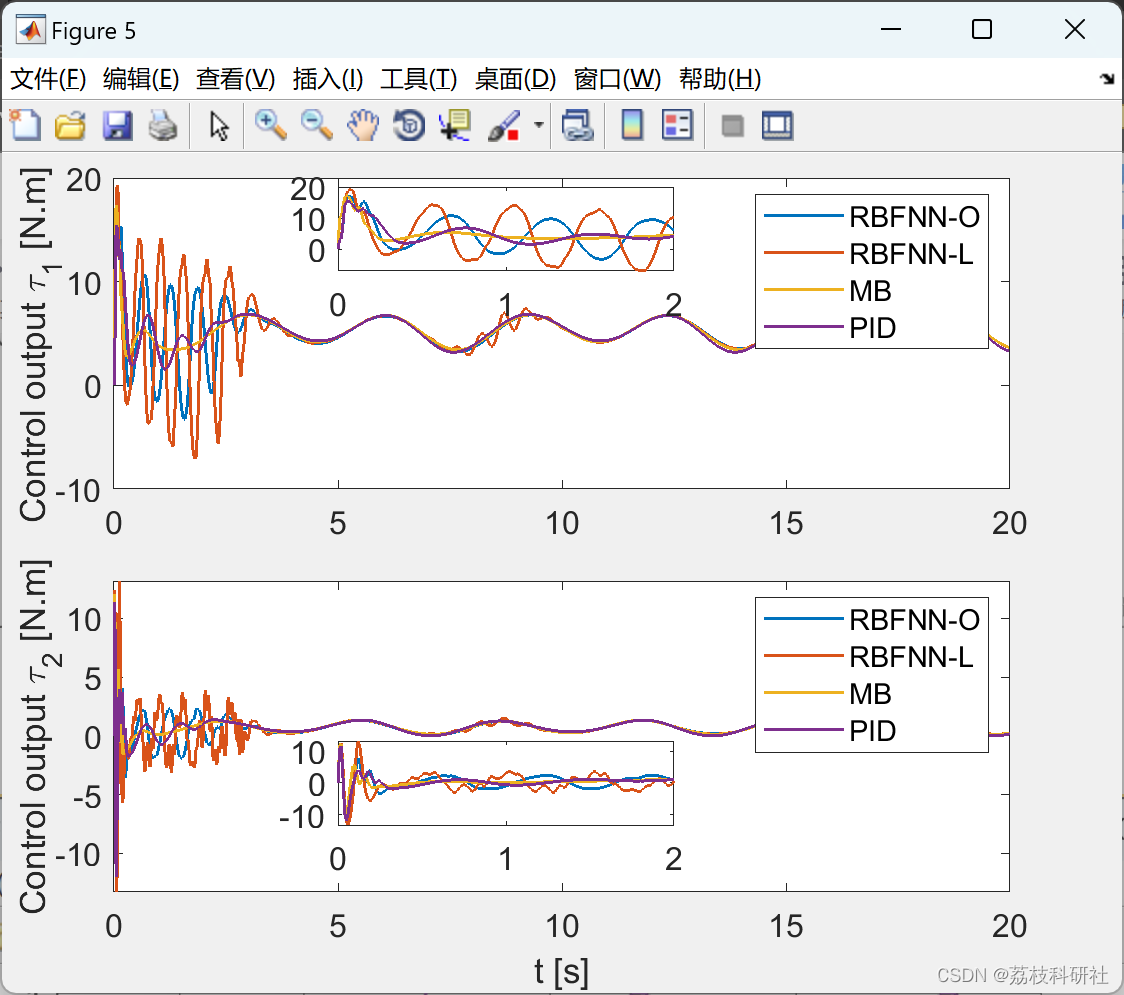

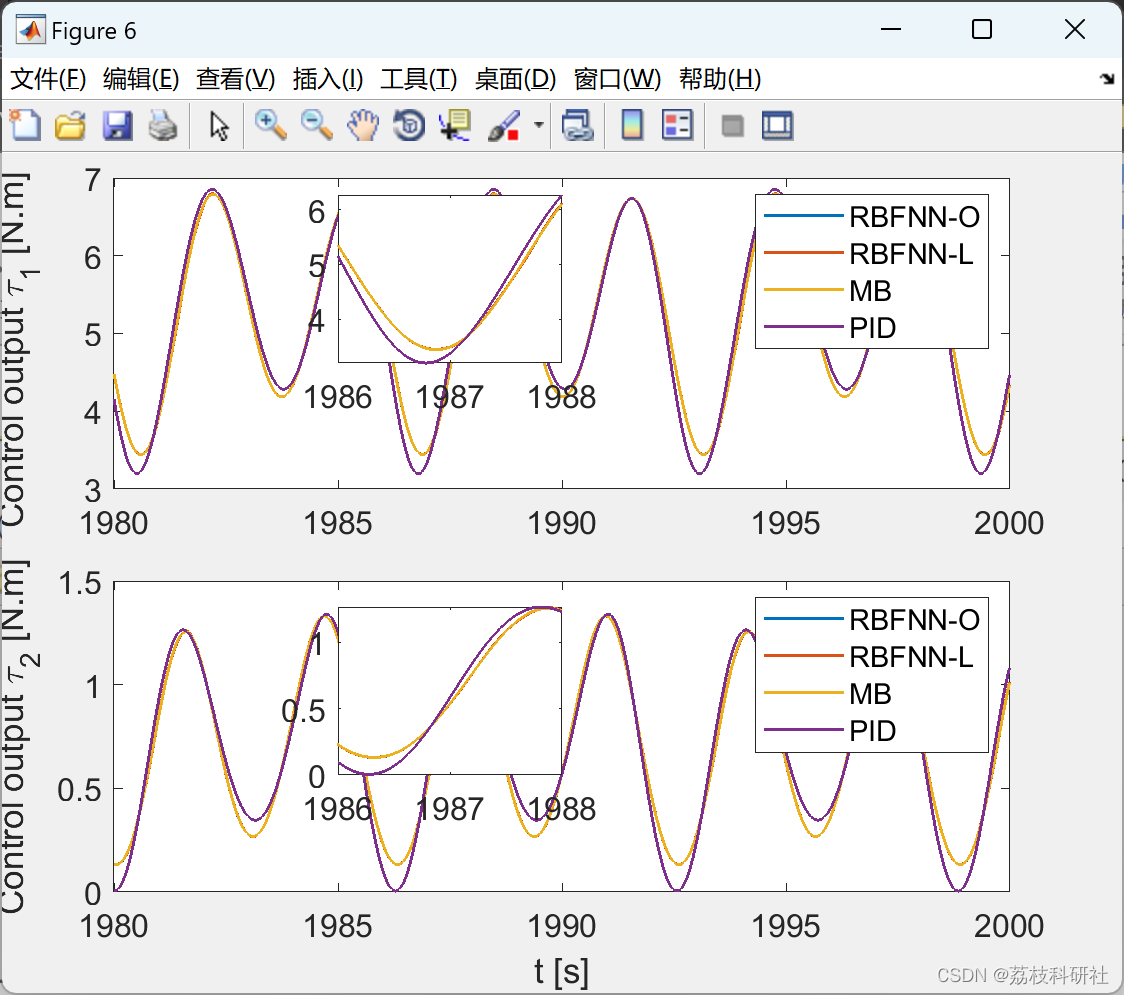

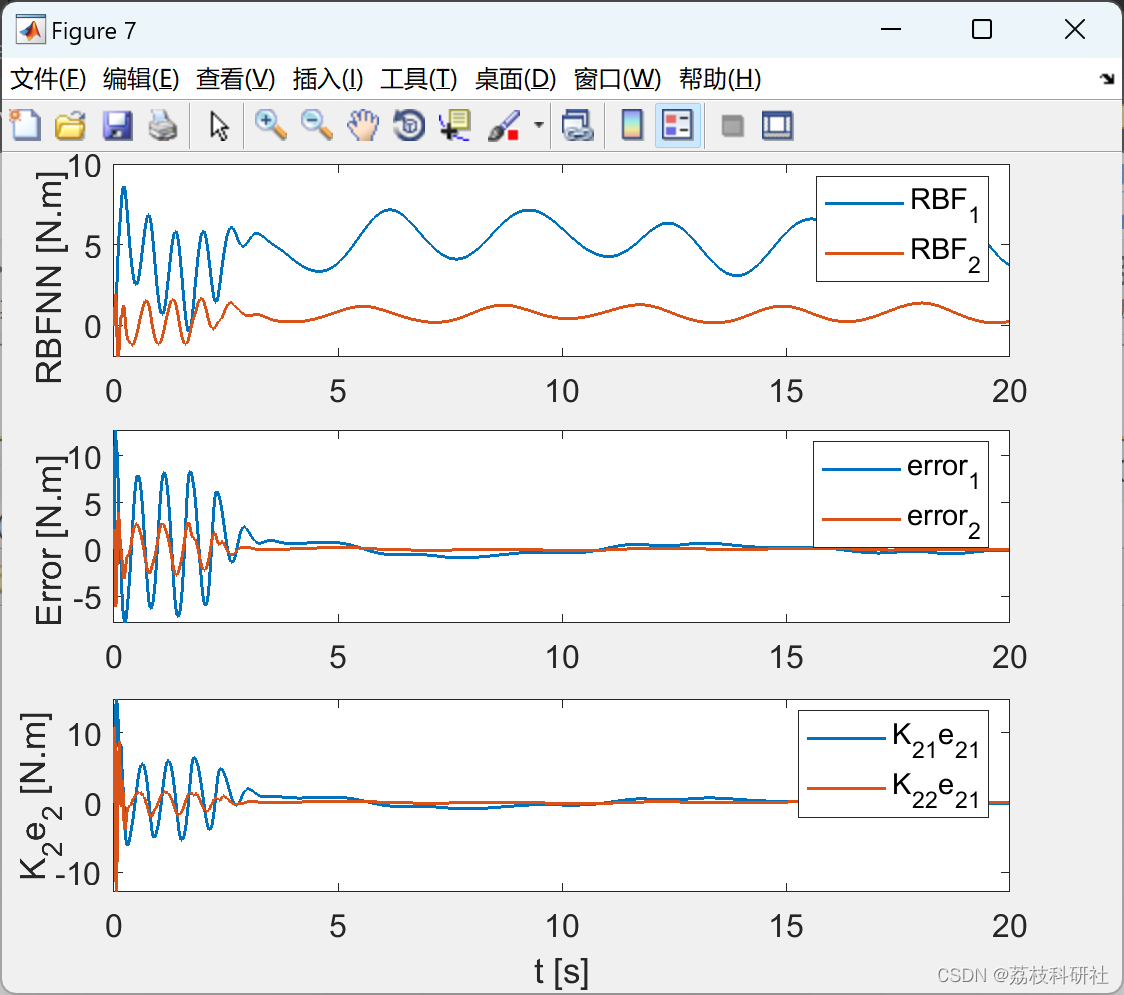

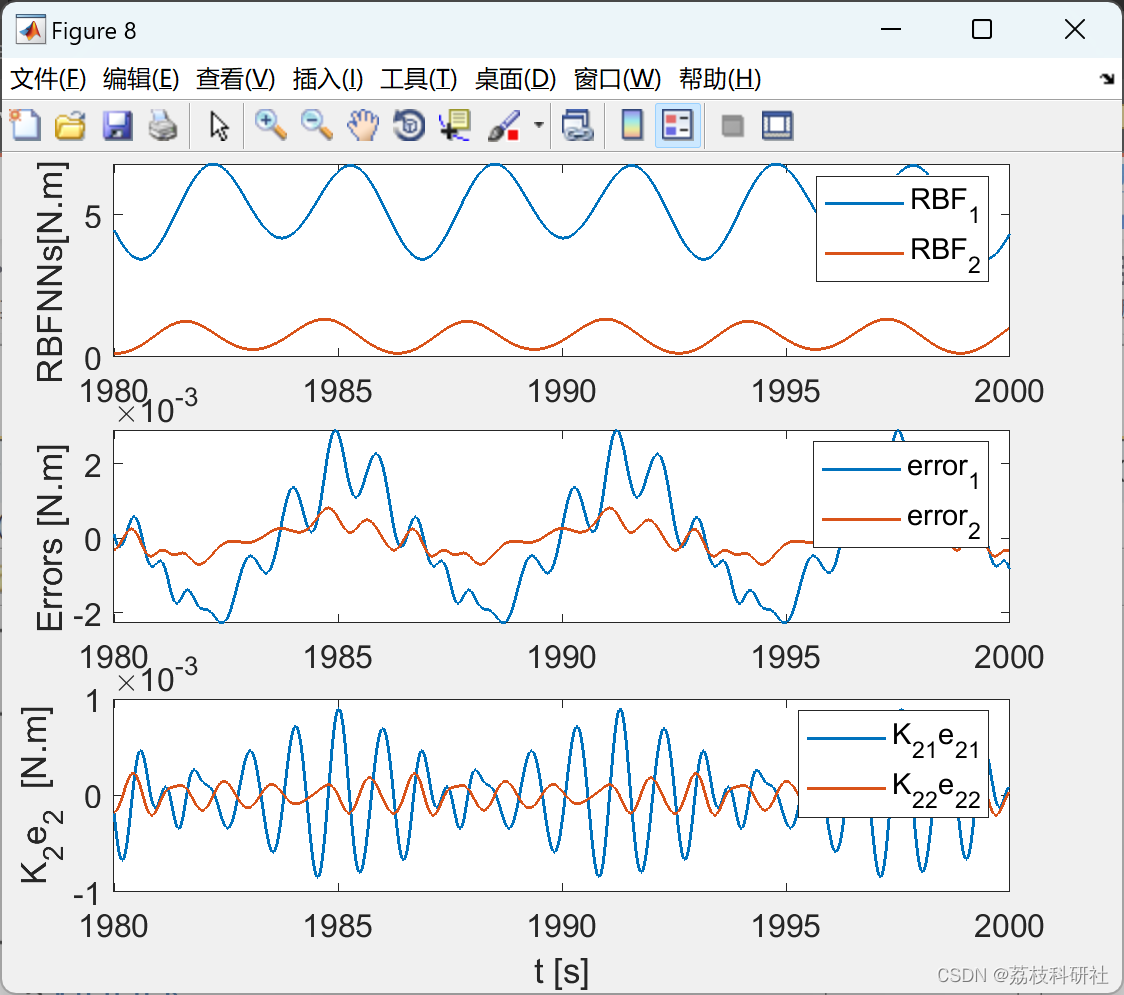

自适应RBFNN控制学习在目标机器人的结构和参数事先未知时控制机器人机械手。遗憾的是,目前的自适应RBFNN控制器需要一个大规模的神经网络来近似机器人操纵器的动力学,并且无法保证学习性能收敛。本文提出的方法不仅减小了神经网络的规模,大大减轻了计算负担,而且明显实现了更好的学习性能。仿真算例表明,与传统格方案相比,该方法的控制精度提高了35倍以上,神经网络规模缩小了<>倍

隐节点格分布的复合自适应径向基函数神经网络(RBFNN)控制存在三个固有缺点:1)自适应RBFNN的近似域难以确定 先验 ;2)只能保证部分激励(PE)条件的持久性;3)一般来说,RBFNN所需的隐藏节点数量是巨大的。本文提出一种具有优化隐藏节点分布的自适应前馈RBFNN控制器,以适当地解决上述缺点。通过 K 均值算法计算的隐藏节点的分布沿所需状态轨迹最佳分布。自适应RBFNN满足周期性参考轨迹的PE条件。所有隐藏节点的权重将收敛到最佳值。该方法大大减少了隐藏节点的数量,同时实现了更好的逼近能力。拟议的控制方案具有与...

原文摘要:

Impact Statement:

Adaptive RBFNN control learns to control a robot manipulator when both the structures and parameters of the target robot are unknown in advance. Unfortunately, current adaptive RBFNN controllers need a large-scale neural network to approximate the dynamics of the robot manipulator, and the learning performance cannot be guaranteed to converge. The proposed method in this article not only reduces the scale of neural networks to substantially alleviate the computational burden but also evidently achieves better learning performance. Simulation examples show that this method increases the control accuracy by more than nine times and reduces the scale of neural networks by 35 times as compared to the traditional lattice scheme.

Abstract:

Composite adaptive radial basis function neural network (RBFNN) control with a lattice distribution of hidden nodes has three inherent demerits: 1) the approximation domain of adaptive RBFNNs is difficult to be determined a priori ; 2) only a partial persistence of excitation (PE) condition can be guaranteed; 3) in general, the required number of hidden nodes of RBFNNs is enormous. This article proposes an adaptive feedforward RBFNN controller with an optimized distribution of hidden nodes to suitably address the above demerits. The distribution of the hidden nodes calculated by a K-means algorithm is optimally distributed along the desired state trajectory. The adaptive RBFNN satisfies the PE condition for the periodic reference trajectory. The weights of all hidden nodes will converge to the optimal values. This proposed method considerably reduces the number of hidden nodes, while achieving a better approximation ability. The proposed control scheme shares a similar rationality to ...

📚2 运行结果

增强型PID-自适应-前馈-神经网络控制研究(Matlab代码实现)_哔哩哔哩_bilibili

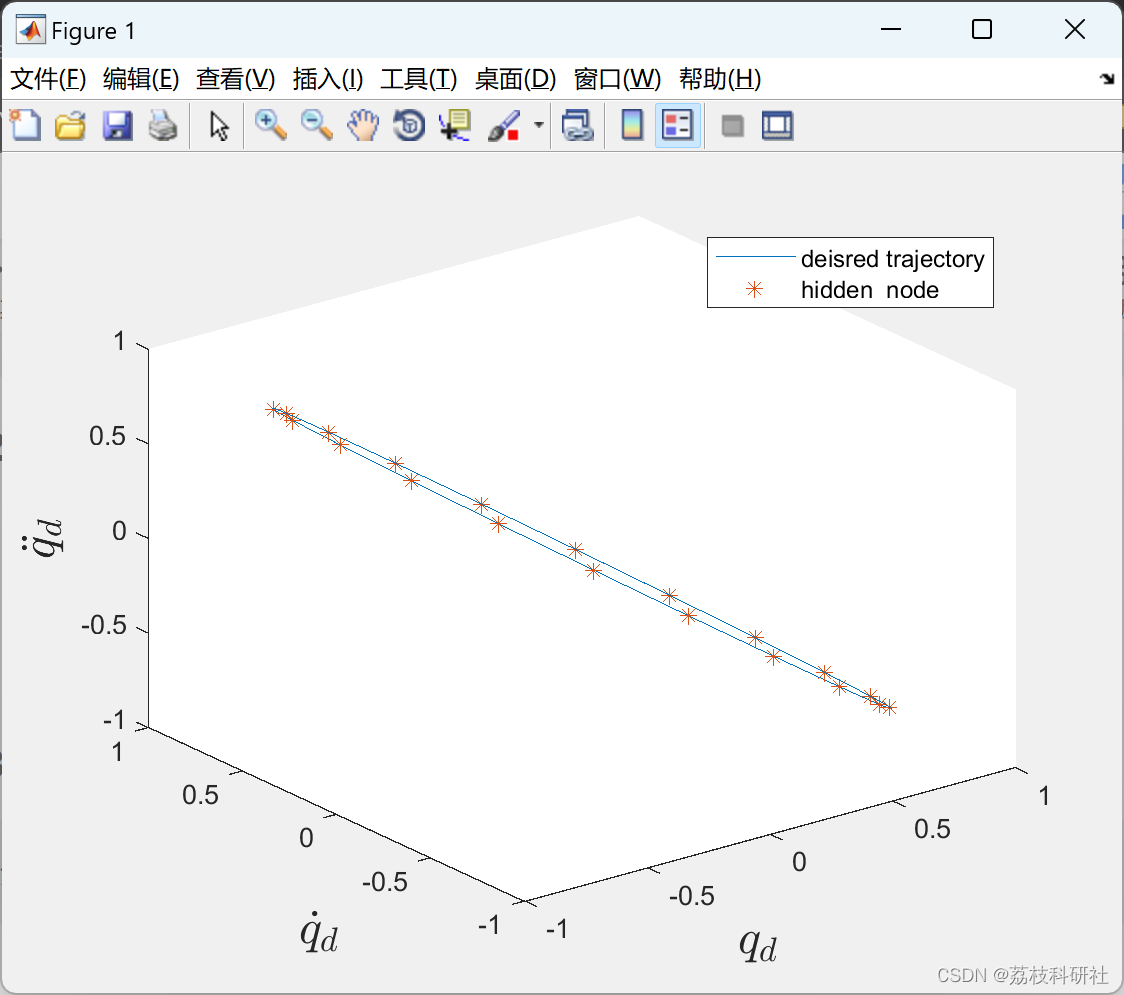

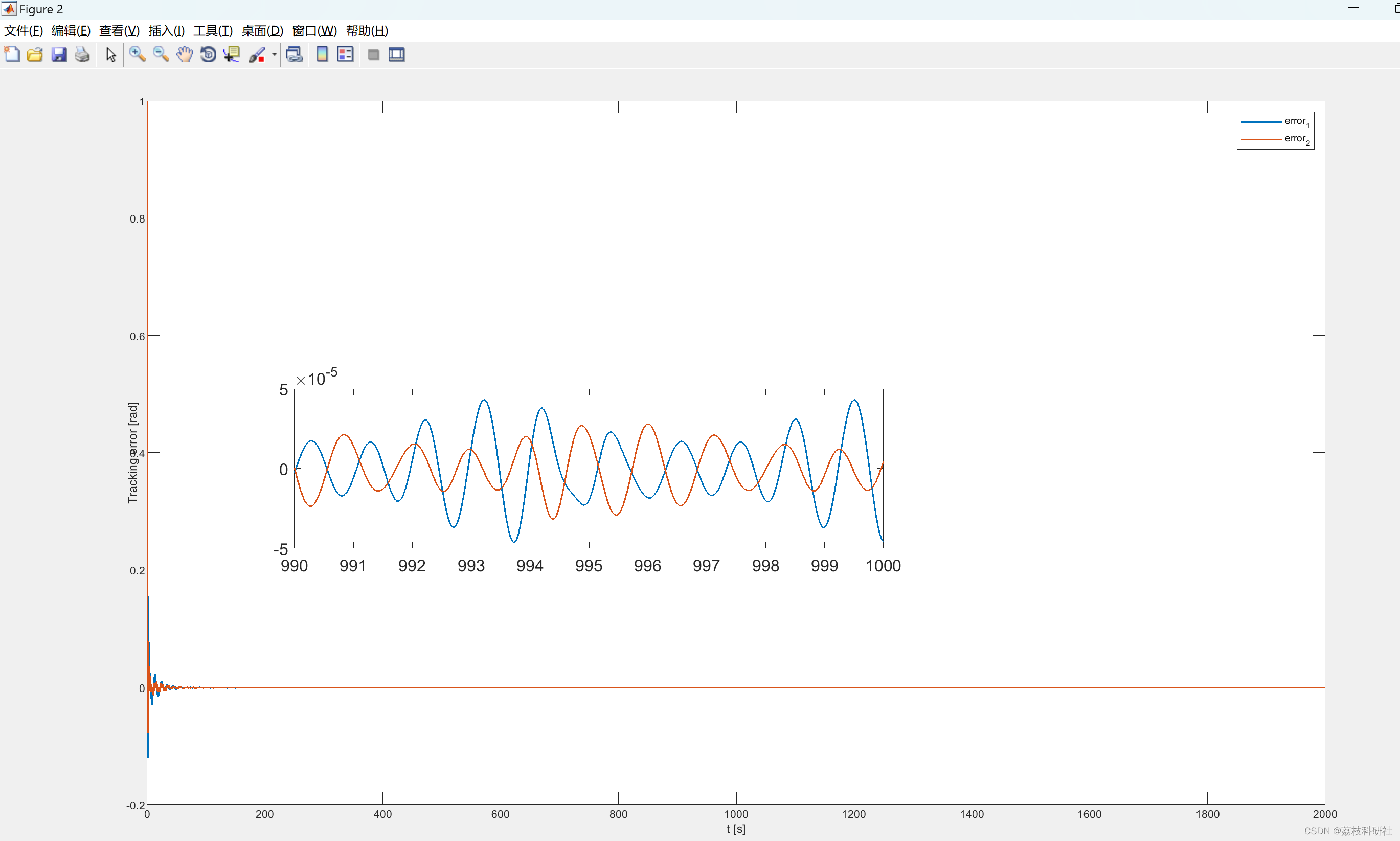

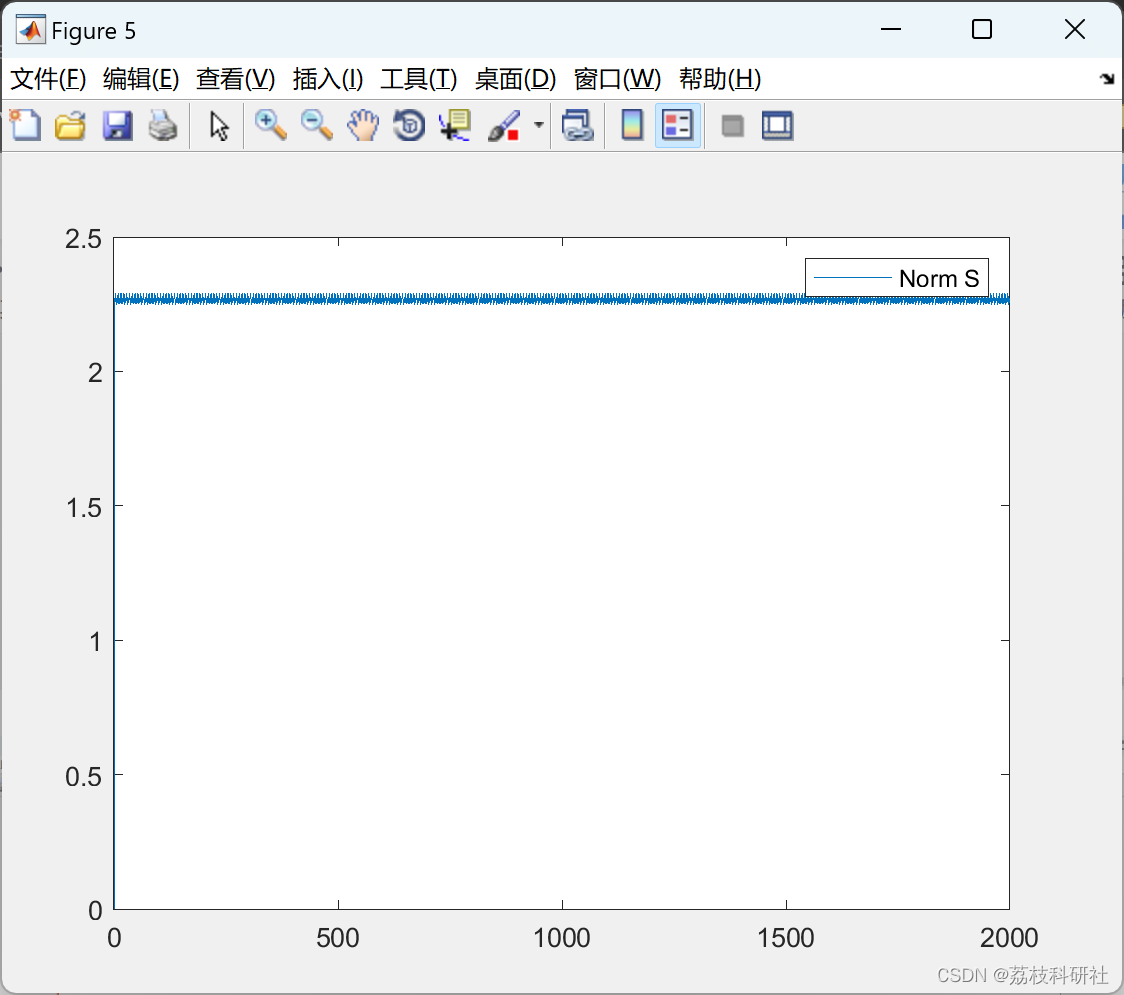

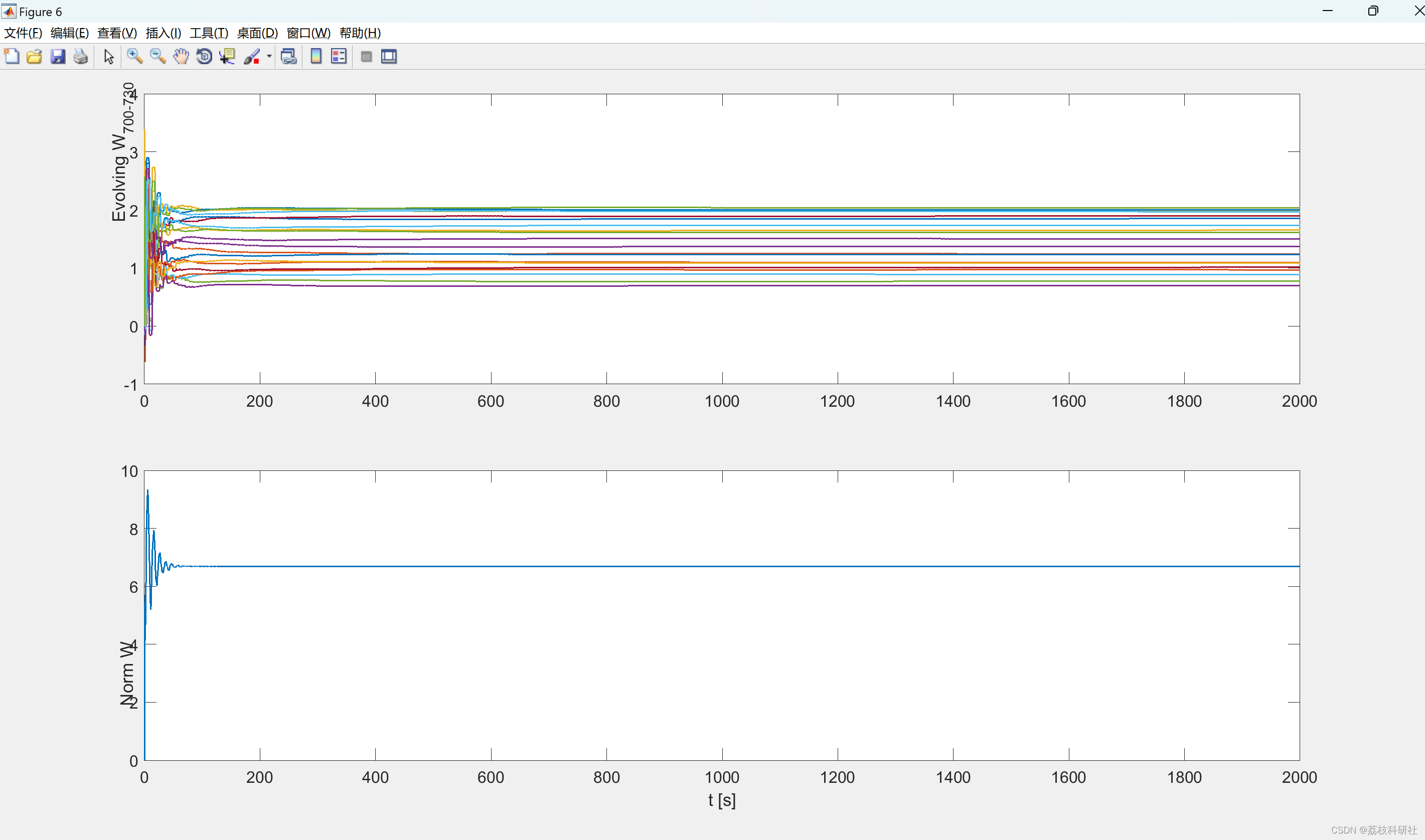

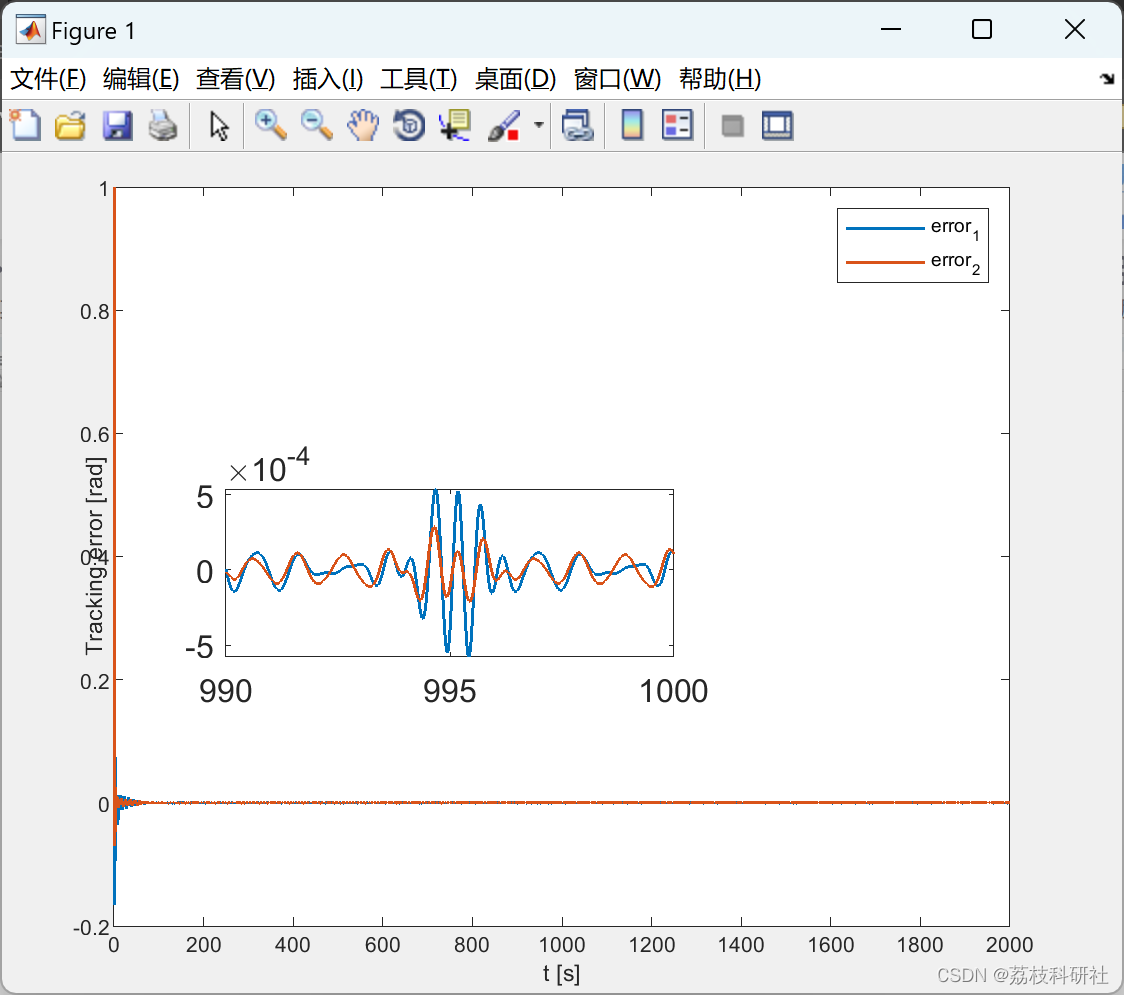

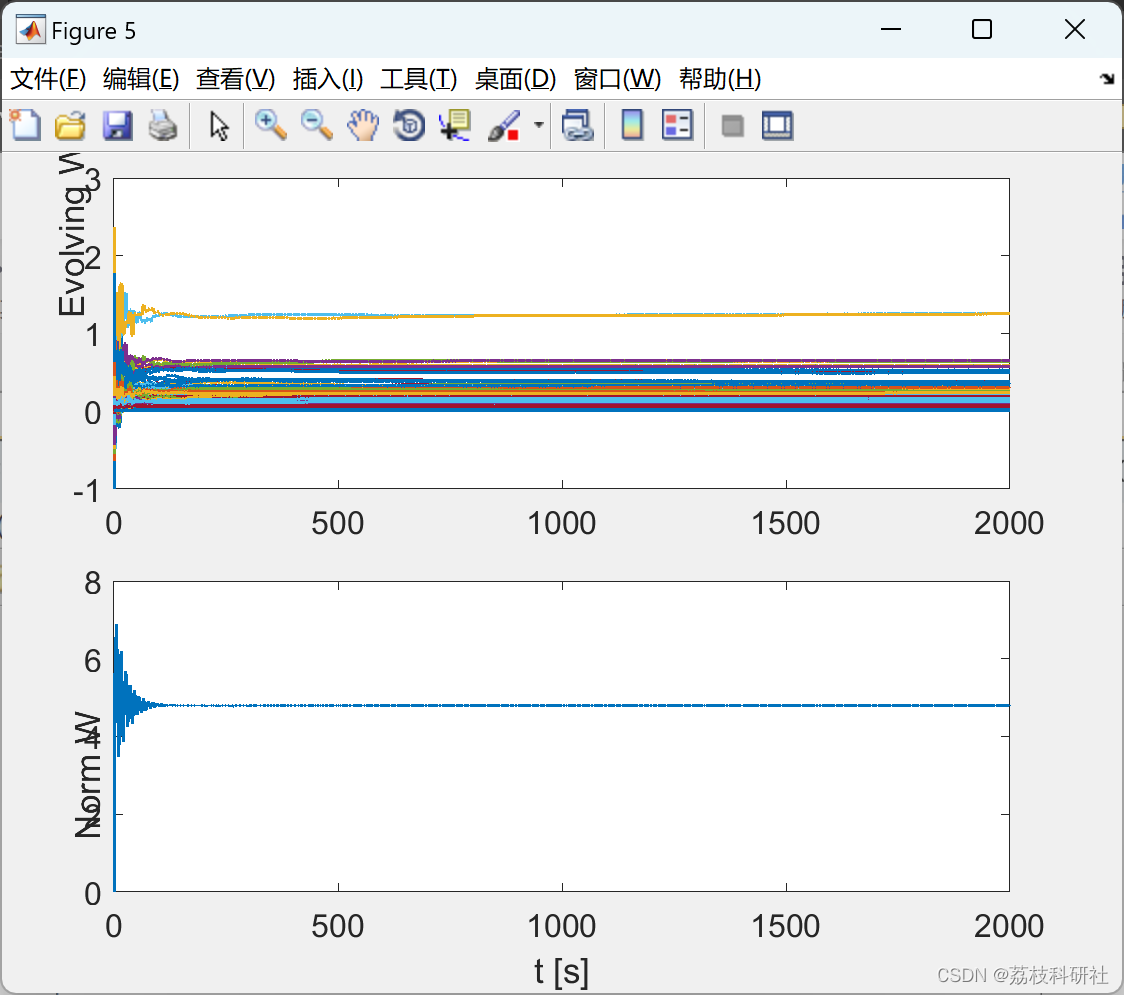

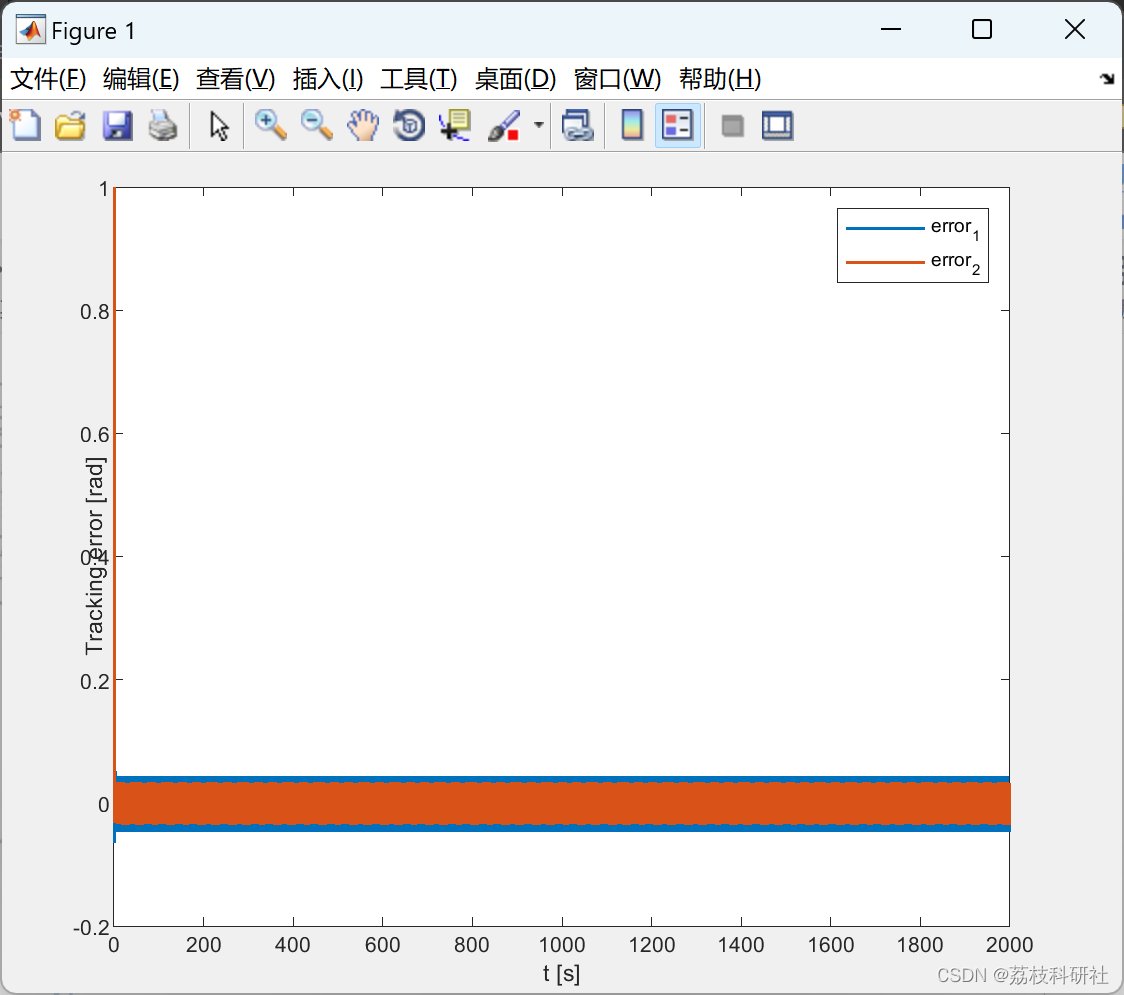

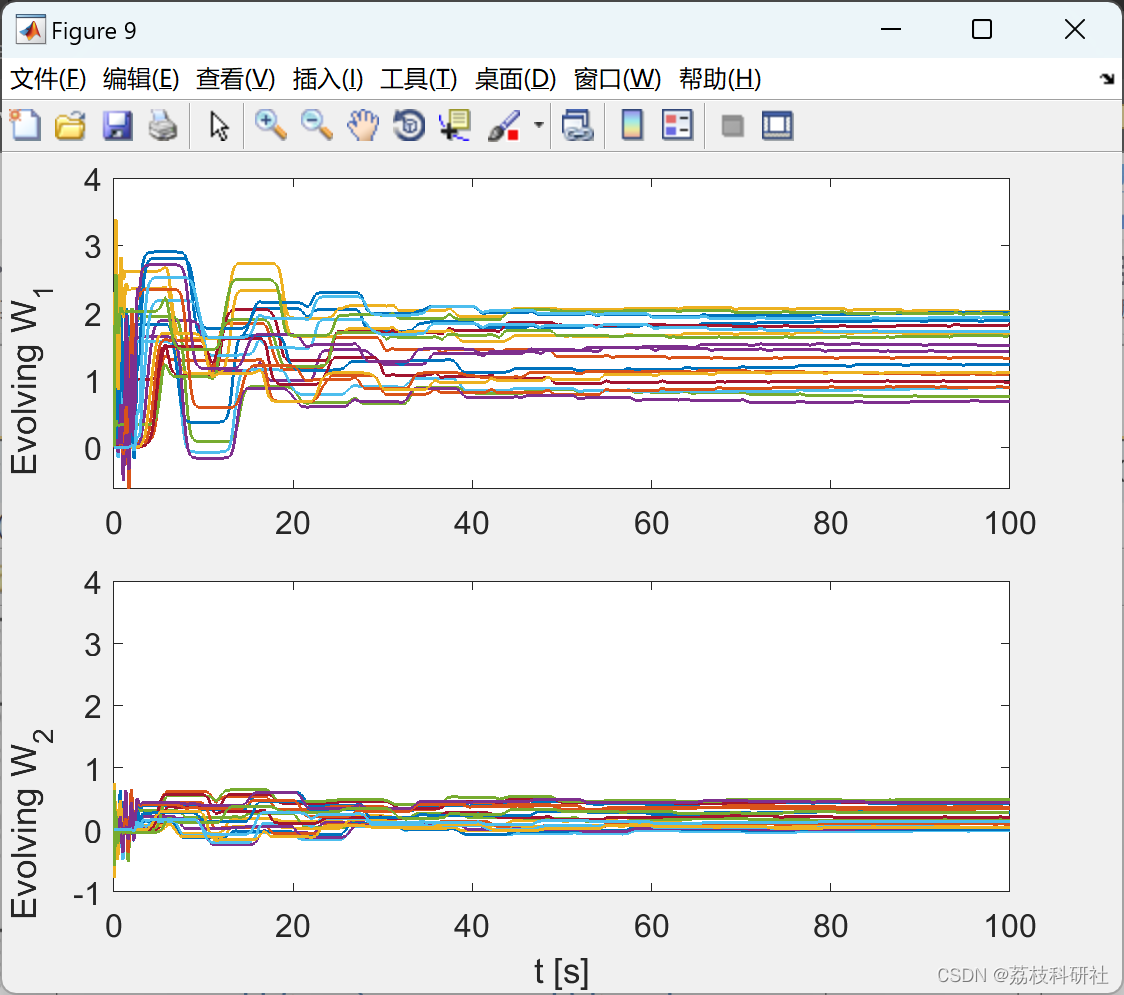

2.1 RBFNN_Optimized_hideen_node_20

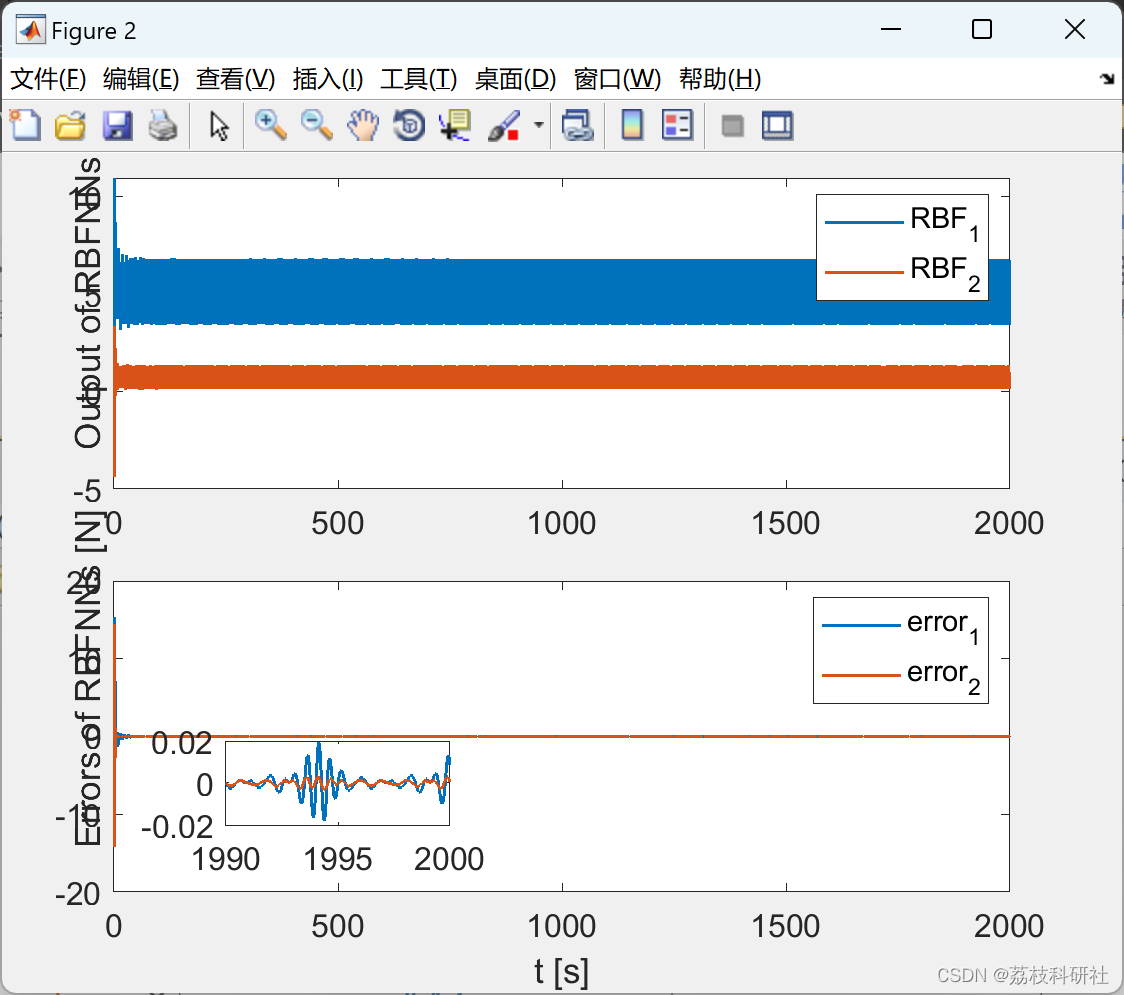

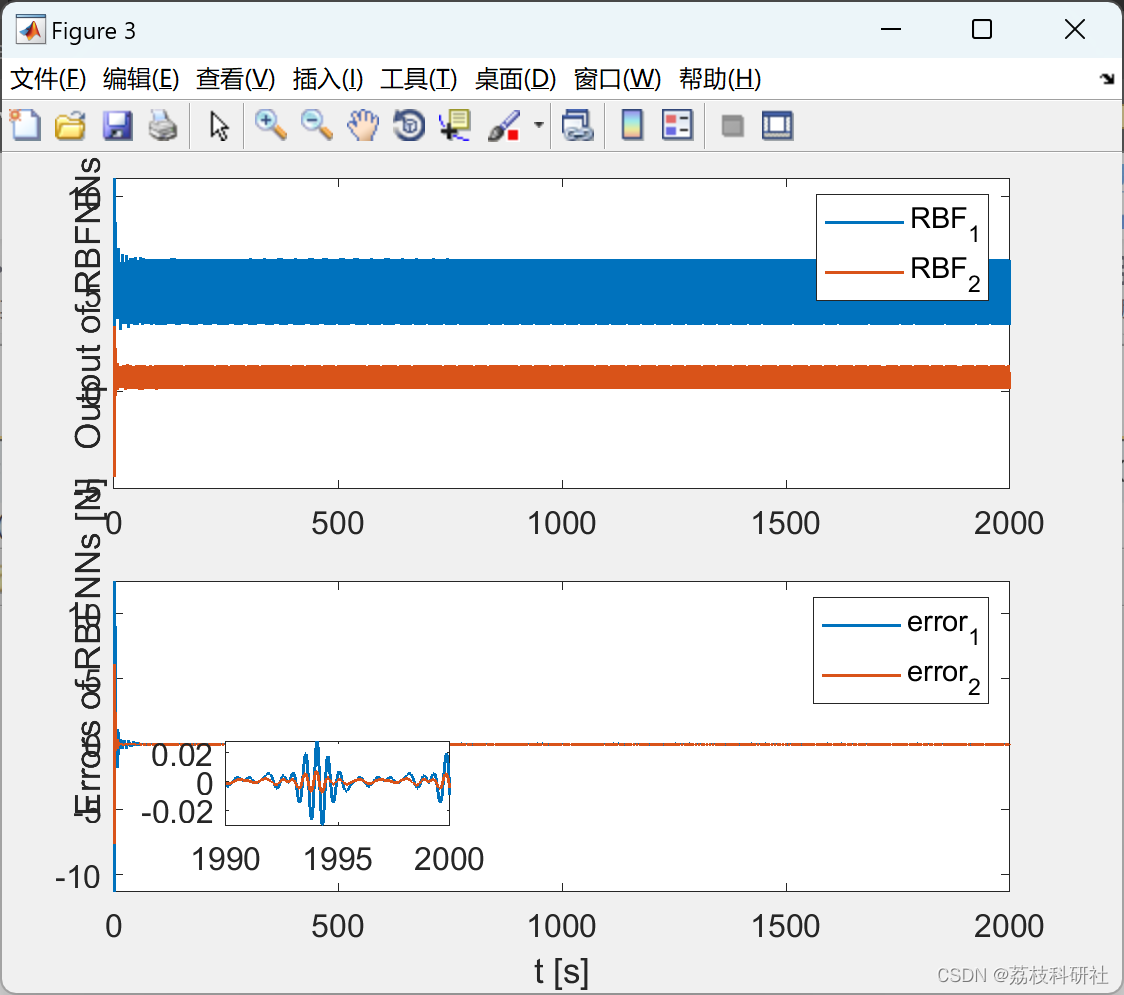

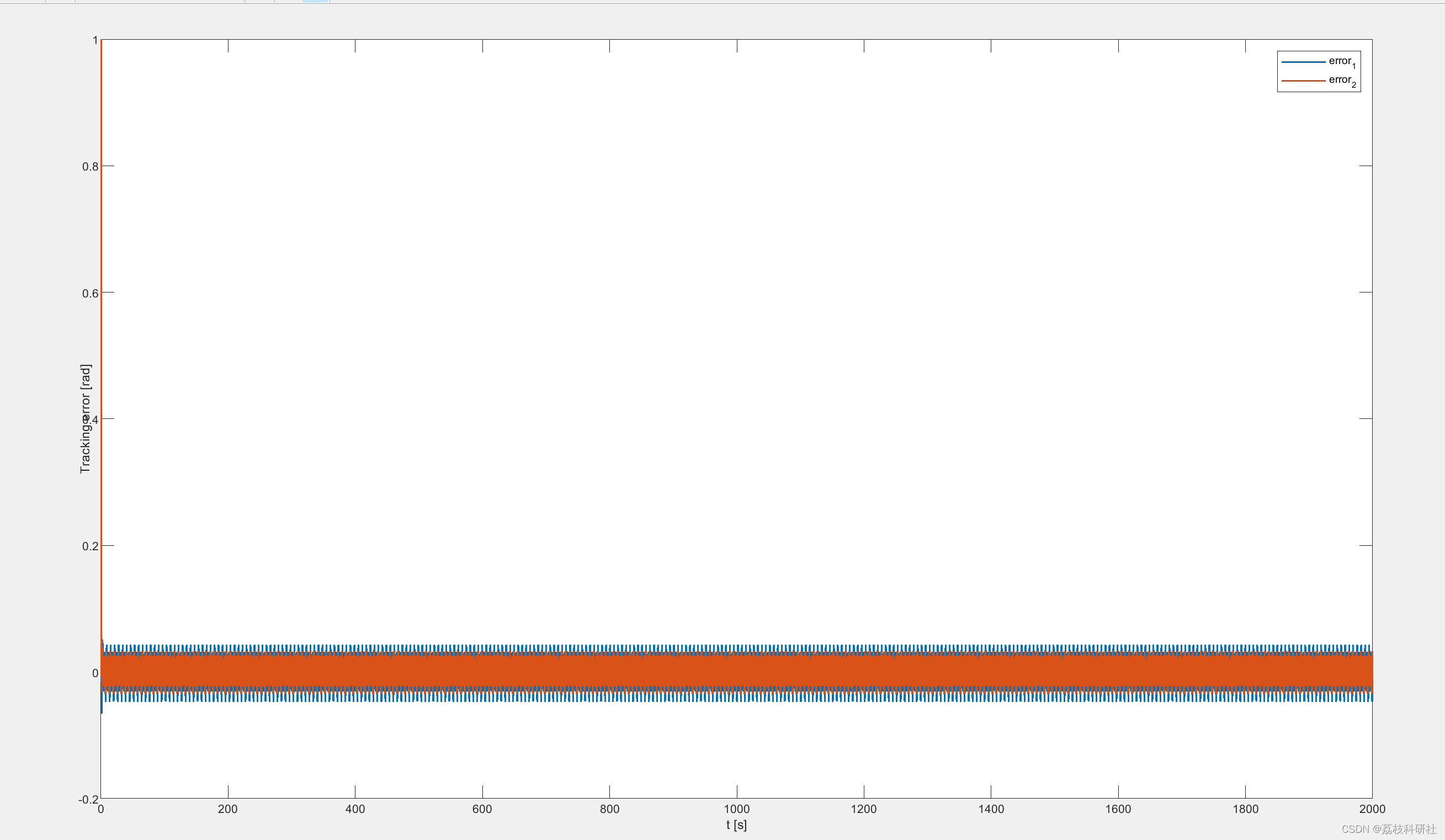

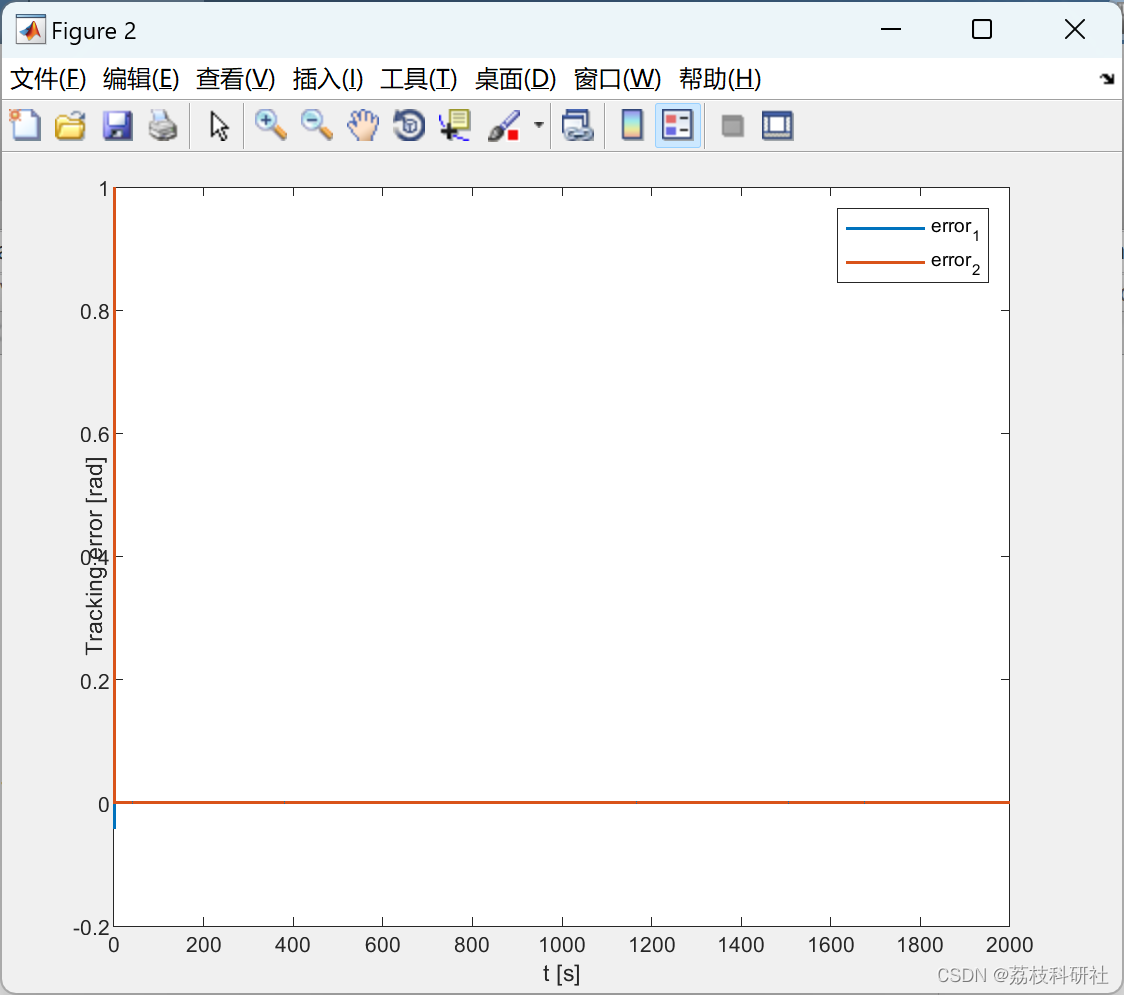

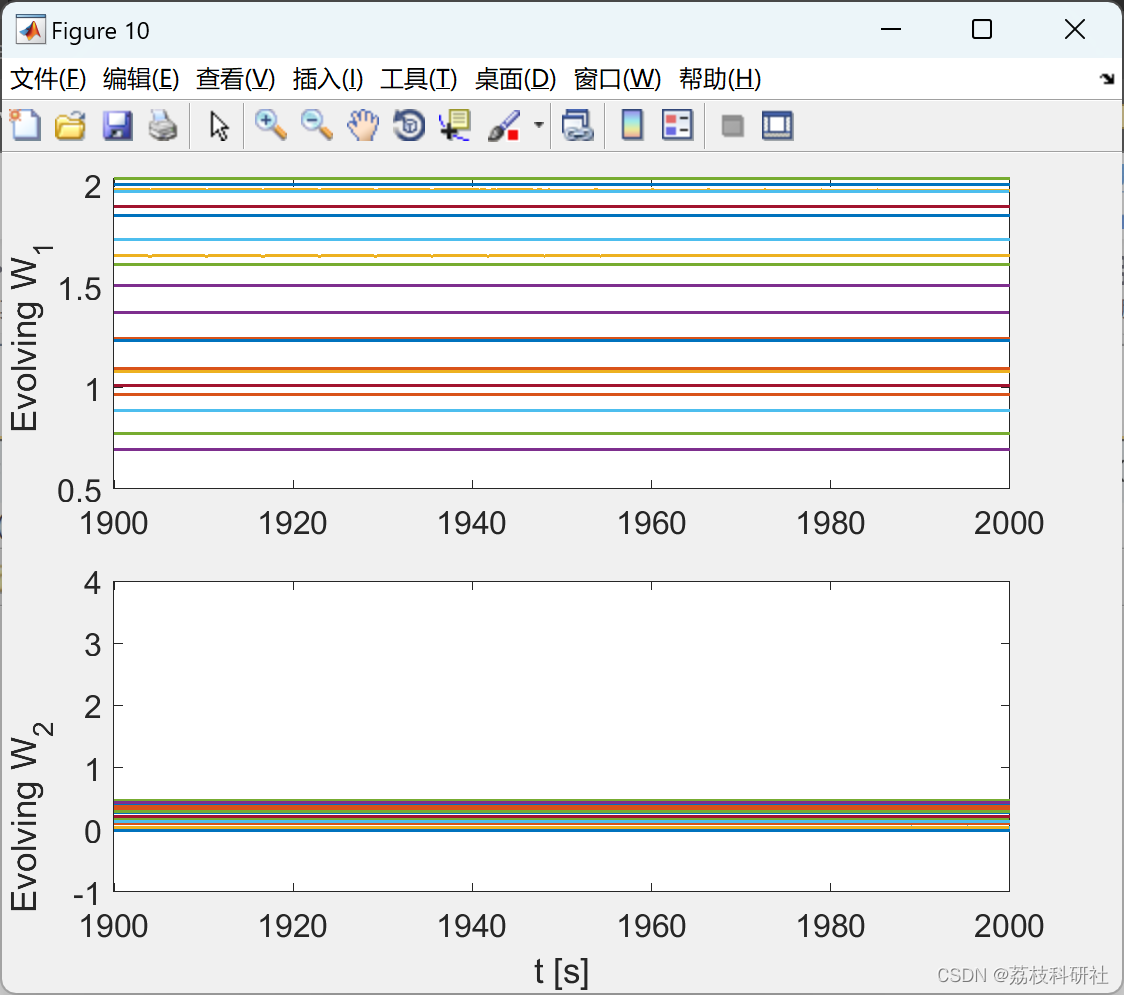

2.2 RBFNN_Lattice_hideen_node_3_6

2.2 RBFNN_Lattice_hideen_node_3_6

2.3 PID

2.4 效果yyds

🎉3 参考文献

部分理论来源于网络,如有侵权请联系删除。

9159

9159

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?