引言

在深度学习中,softmax 激活函数是一种常用的工具,特别是在多分类问题中。本文将详细介绍 softmax 函数的原理、用途、优势以及如何在神经网络中使用它,并通过代码示例进行详细讲解。

什么是Softmax激活函数?

原理

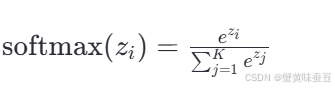

softmax 函数是一种用于将一组数值转换为概率分布的激活函数。它的主要作用是将每个元素变换成一个介于0和1之间的值,并且这些值的总和等于1。数学公式如下:

其中,( z_i ) 是输入向量中的第 ( i ) 个元素,( K ) 是输入向量的长度。

如何使用

在多分类问题中,通常会在神经网络的最后一层使用 softmax 函数。这样做的目的是将模型的输出转换为各个类别的概率分布,便于后续的概率计算和决策。

为什么使用

- 概率解释:

softmax函数的输出是一个概率分布,每个类别都有一个对应的概率值,这使得结果更具可解释性。 - 归一化:

softmax函数确保所有输出值之和为1,这对于处理分类问题非常有用。 - 优化目标:在交叉熵损失函数中,

softmax函数与交叉熵结合得非常好,能够有效地训练多分类模型。

优势和作用

- 概率解释:输出的结果可以直接解释为各个类别的概率。

- 归一化:确保输出值之和为1,便于后续处理。

- 与交叉熵损失函数配合良好:有助于提高模型的训练效率和准确性。

示例代码

下面是一个使用 softmax 函数的简单示例,包括详细的代码注释。

代码详解

-

导入必要的库

import torch import torch.nn as nn import torch.nn.functional as Ftorch: PyTorch的主要库。torch.nn: 包含构建神经网络所需的各种模块。torch.nn.functional: 包含

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

958

958

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?