课程资料

视频:LMDeploy 量化部署 LLM-VLM 实践_哔哩哔哩_bilibili

文档:GitHub - InternLM/Tutorial at camp2

基础知识

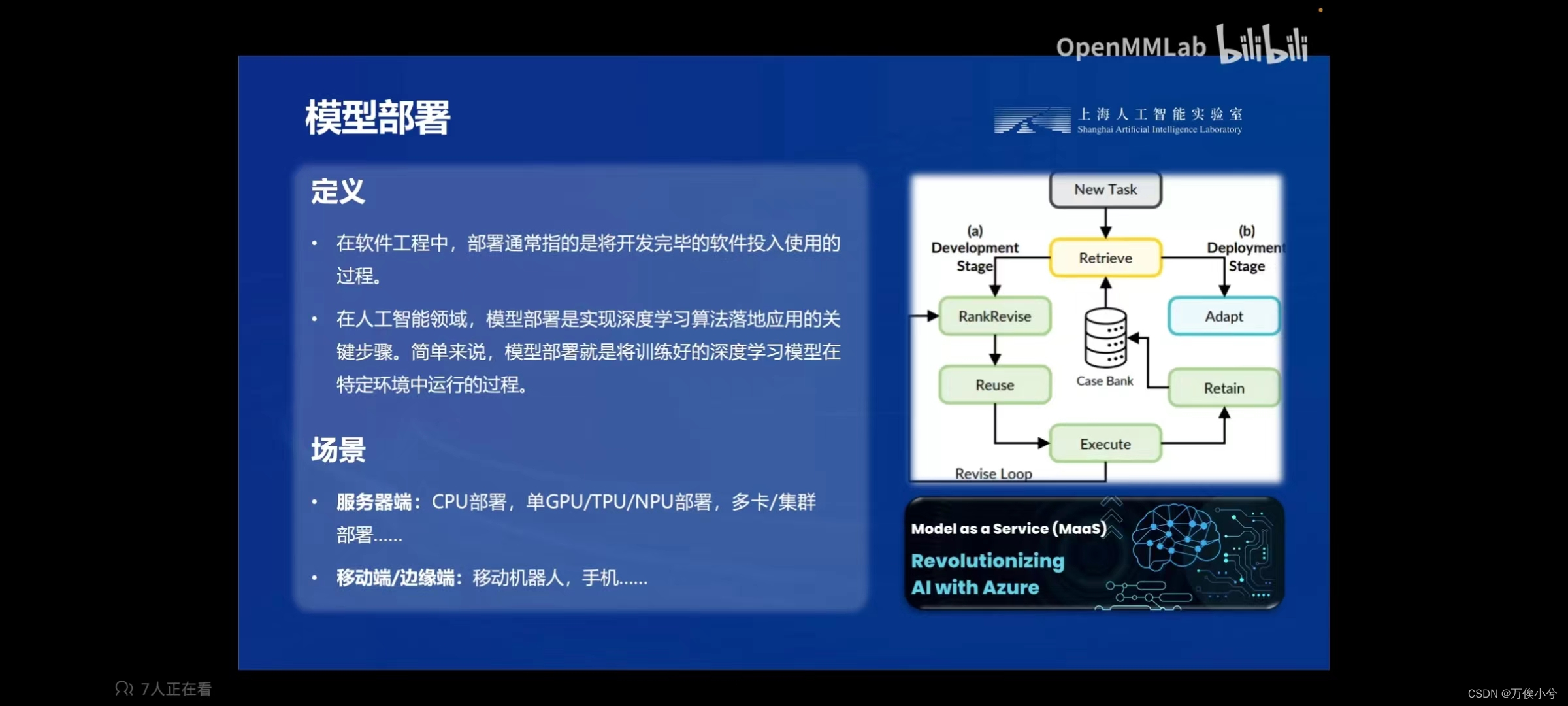

模型部署的定义

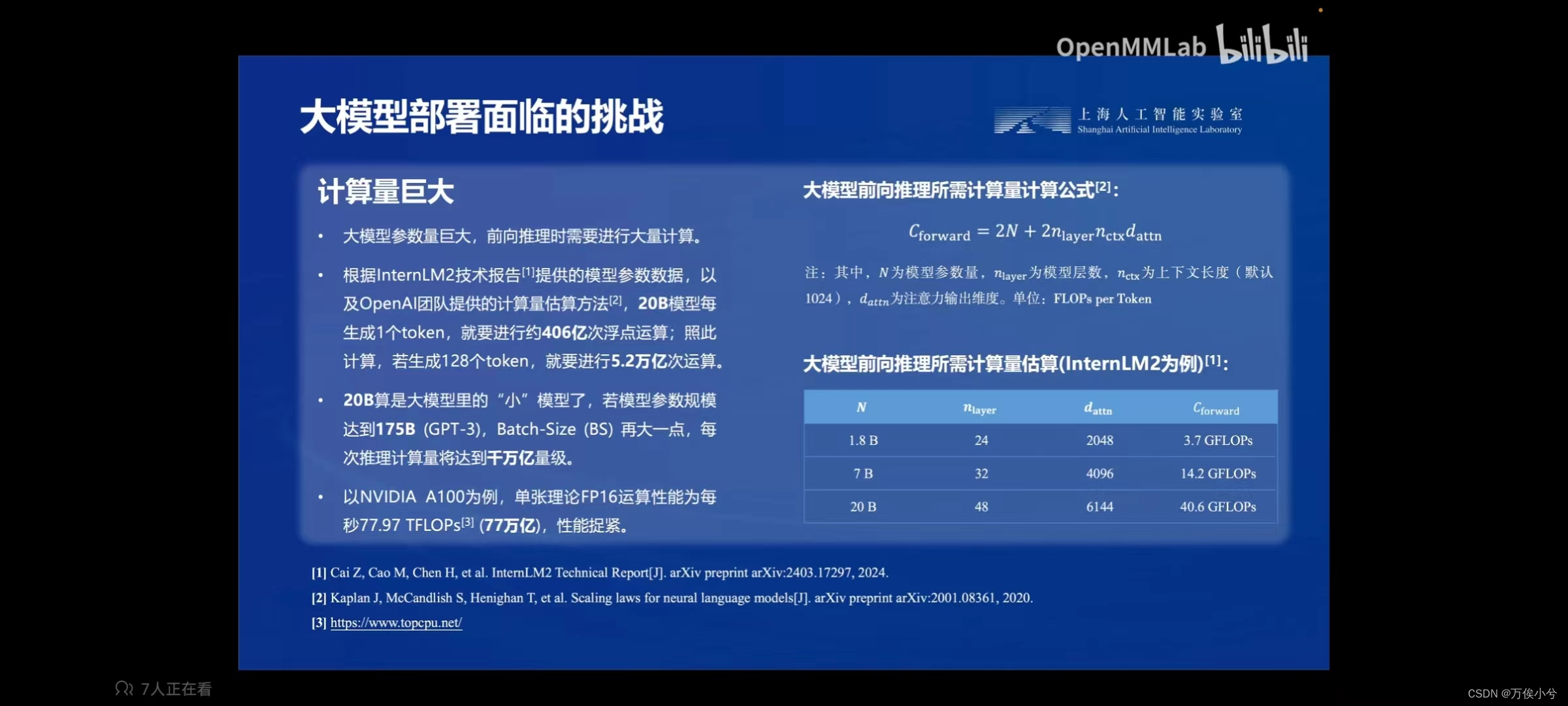

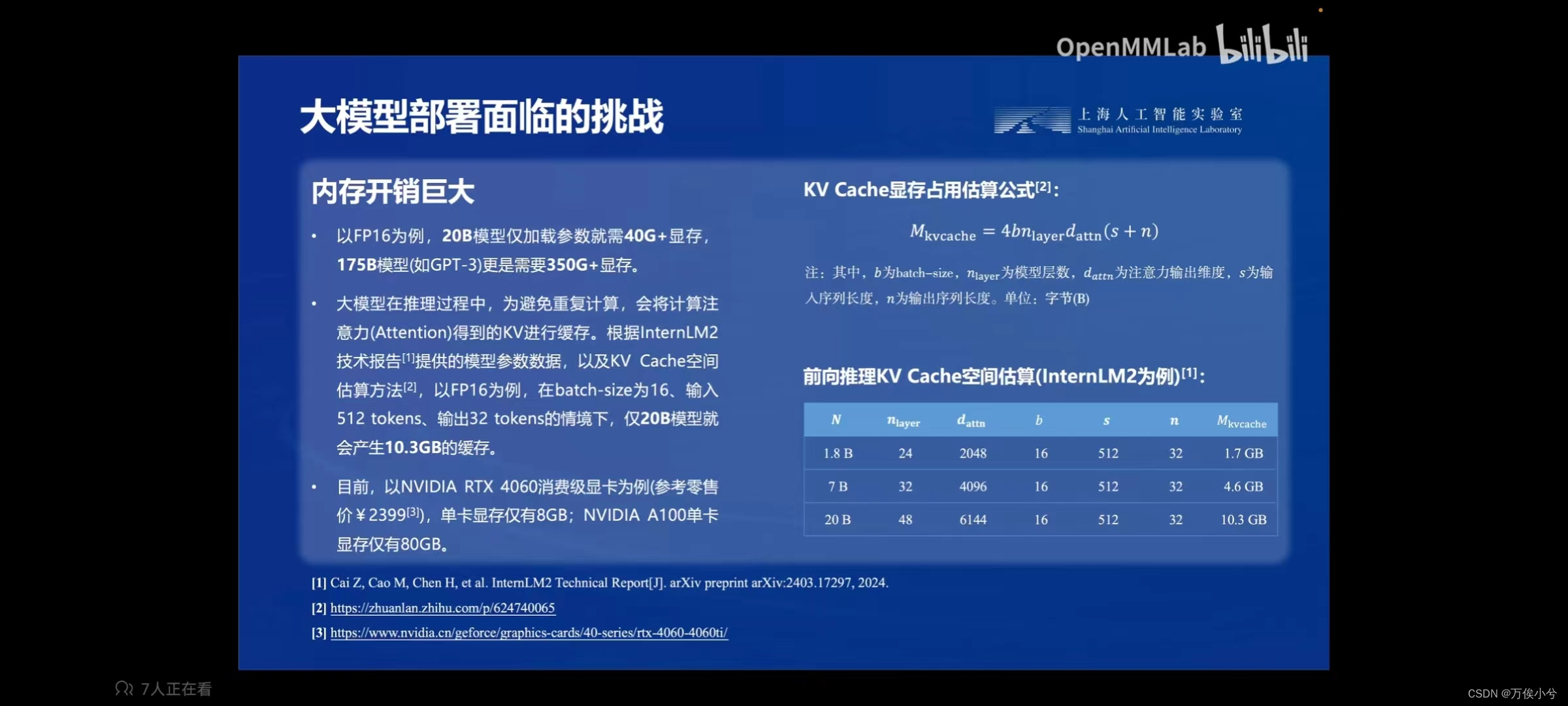

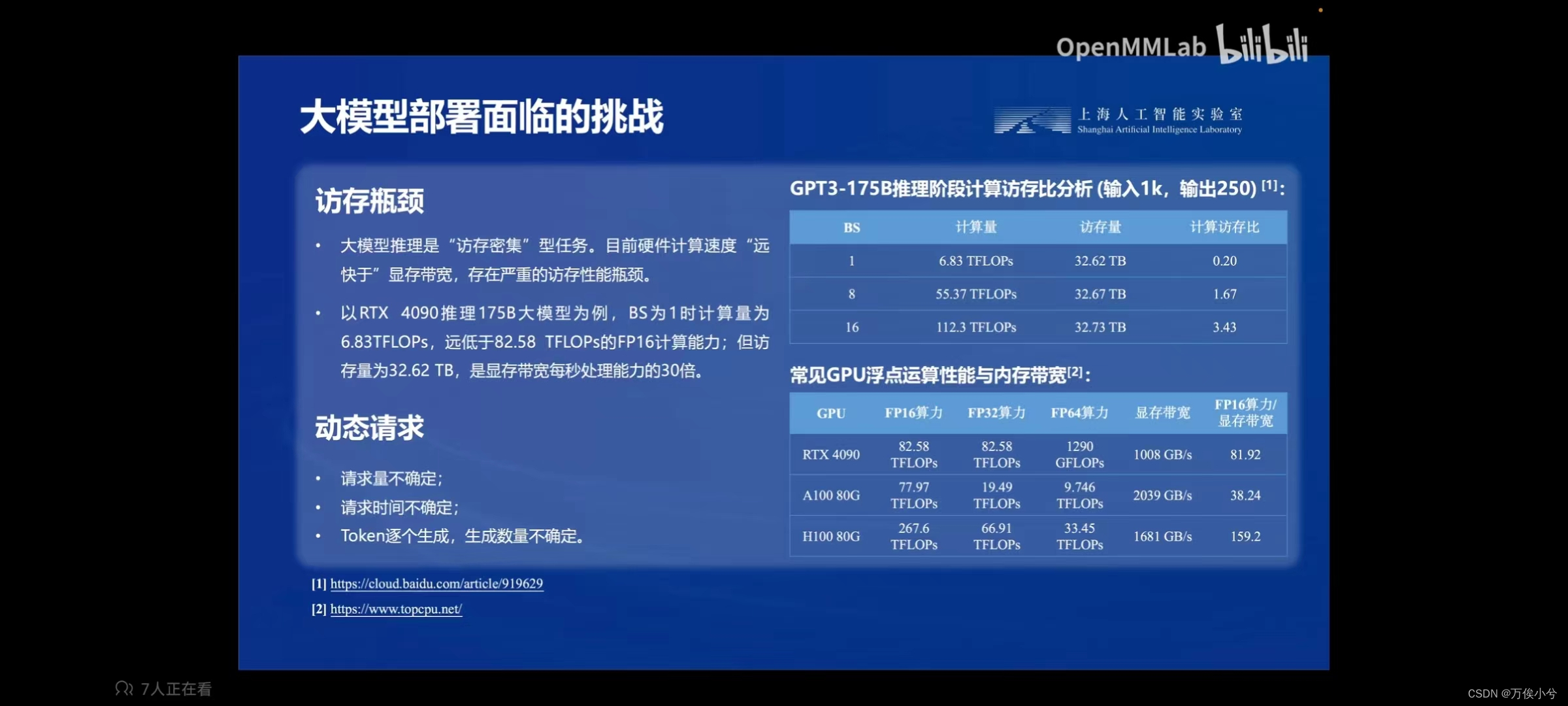

部署难点

计算量巨大

显存开销巨大

访问瓶颈

部署方法

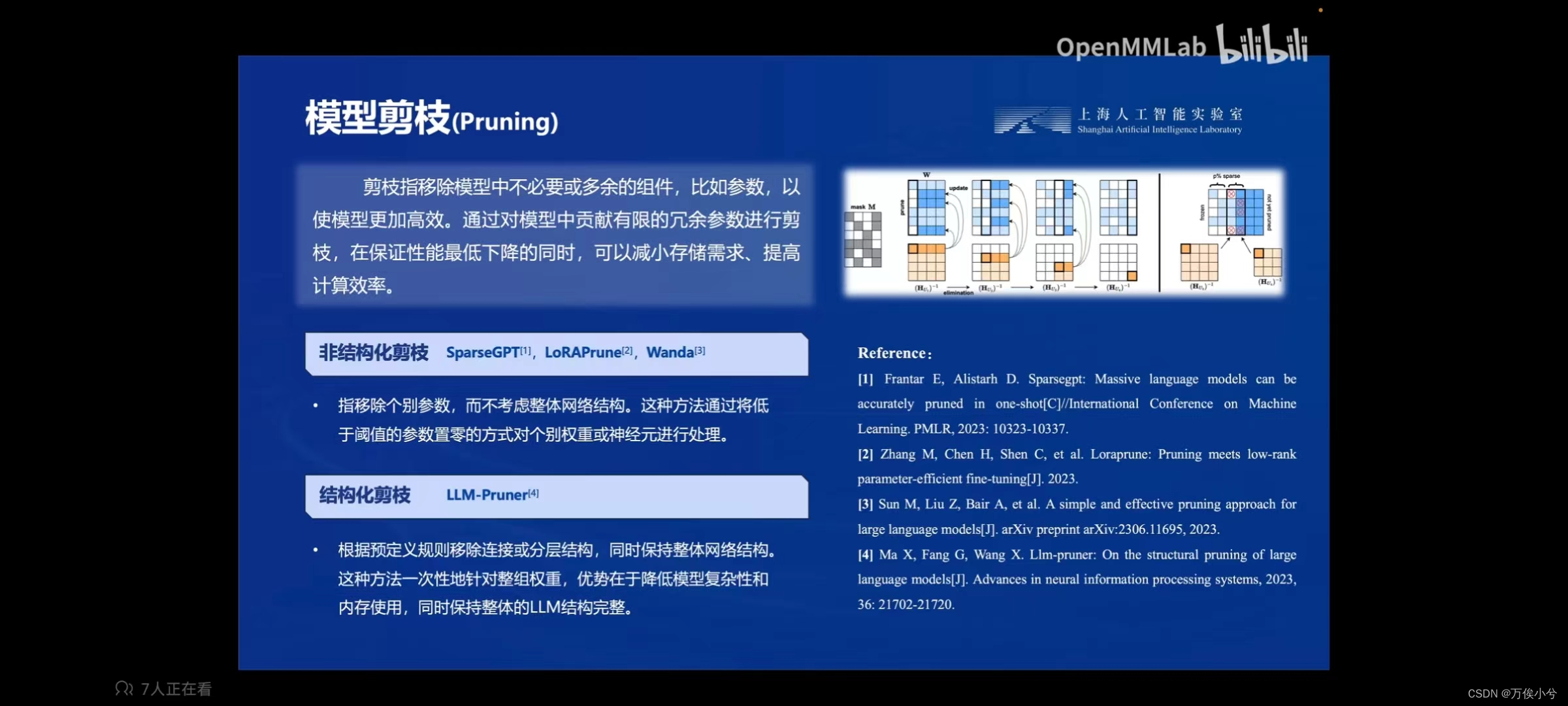

模型剪枝(Pruning)

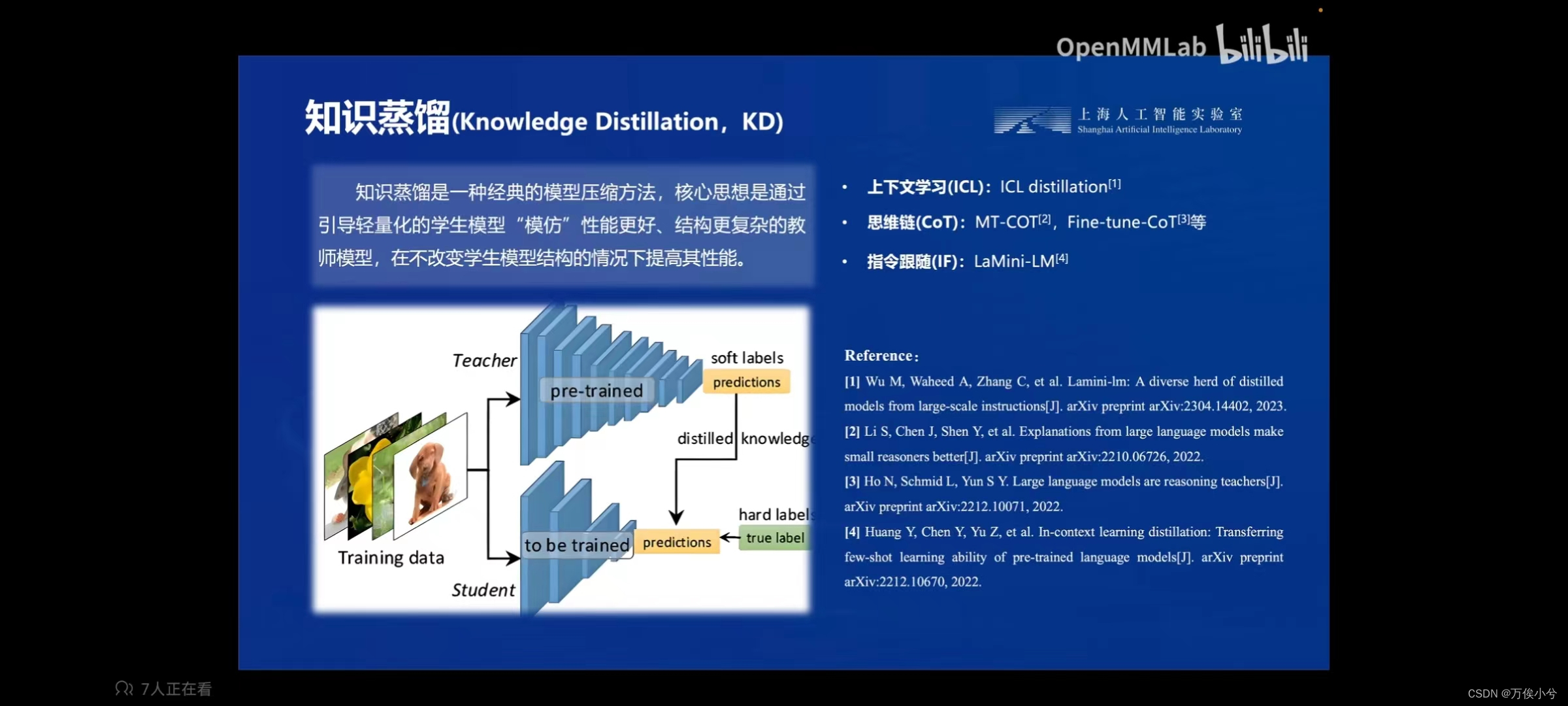

知识蒸馏(KD)

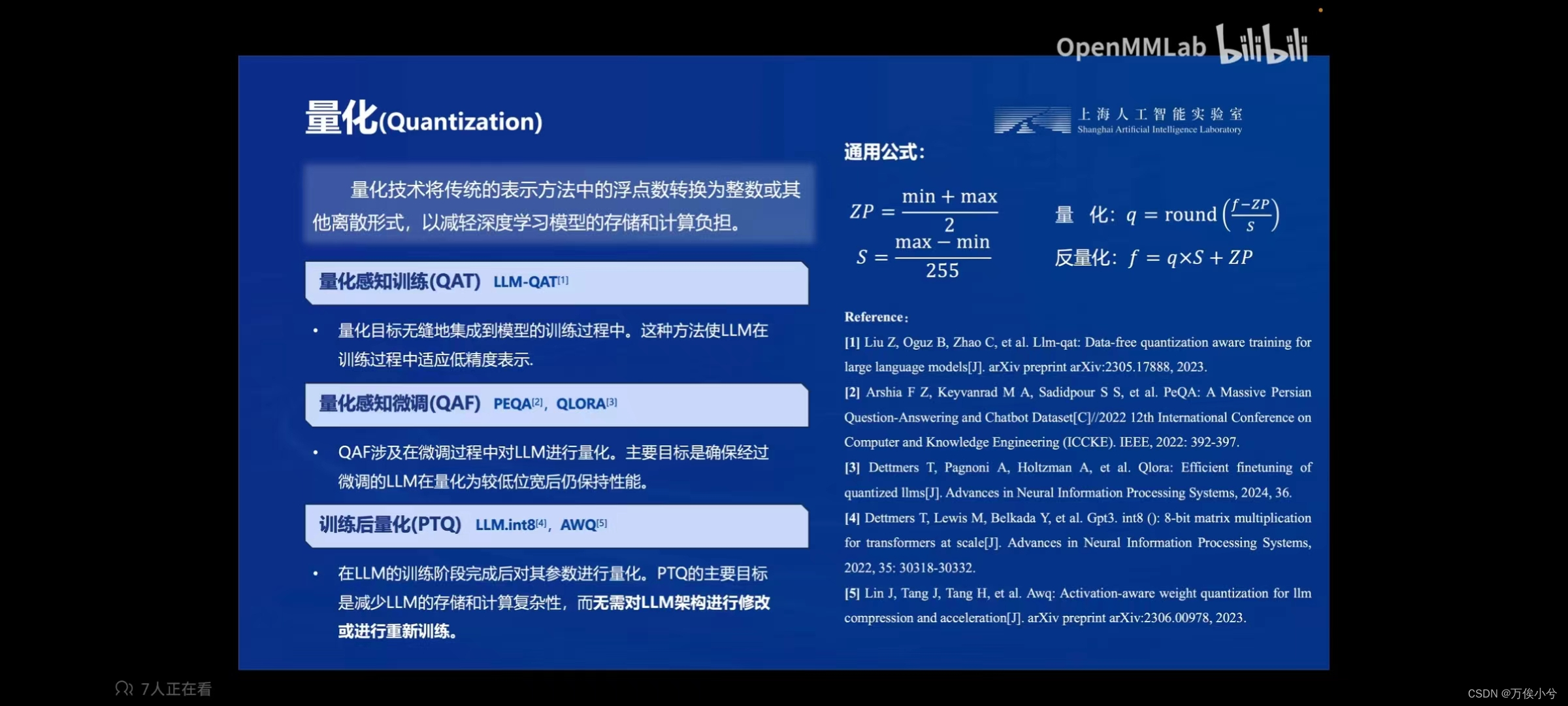

量化(Quantization)

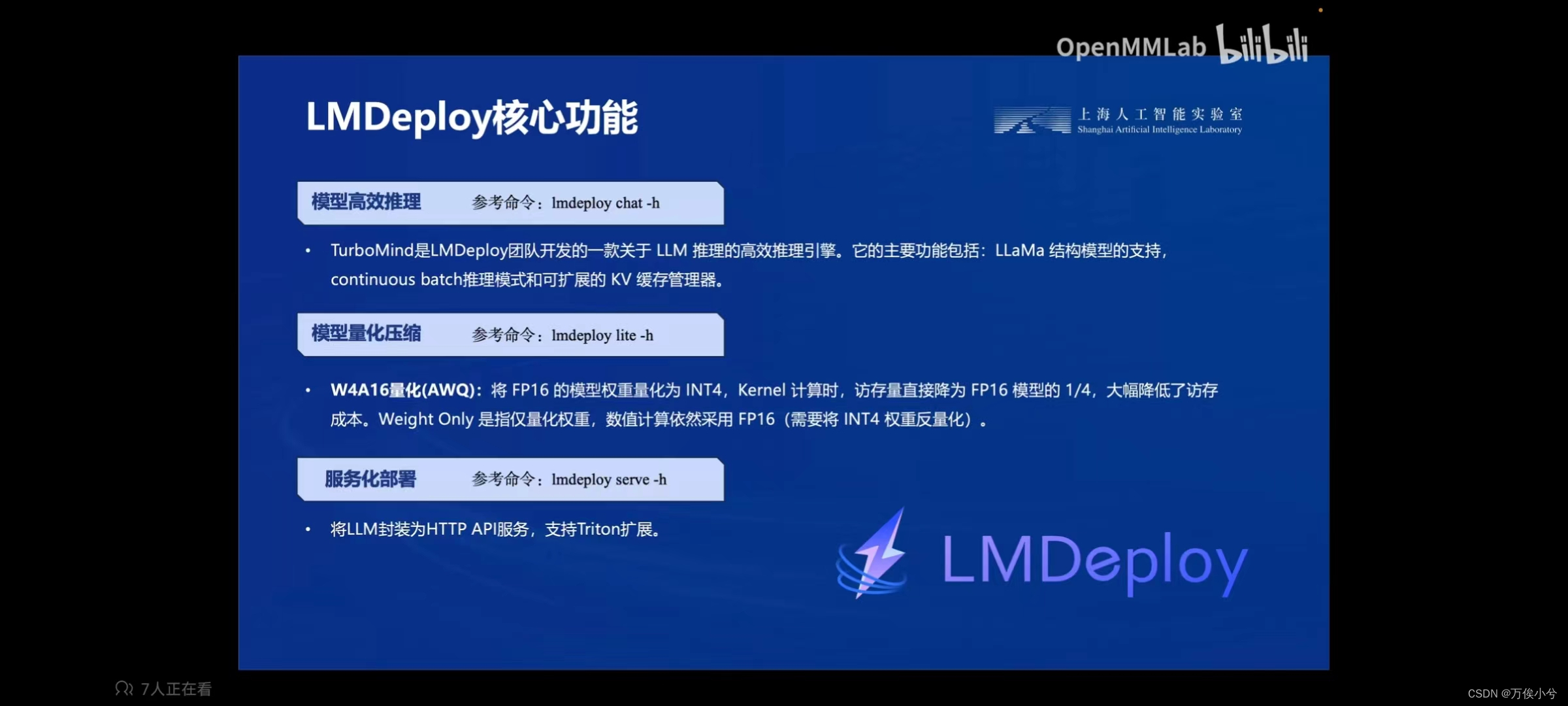

LMDeploy简介

部署实操

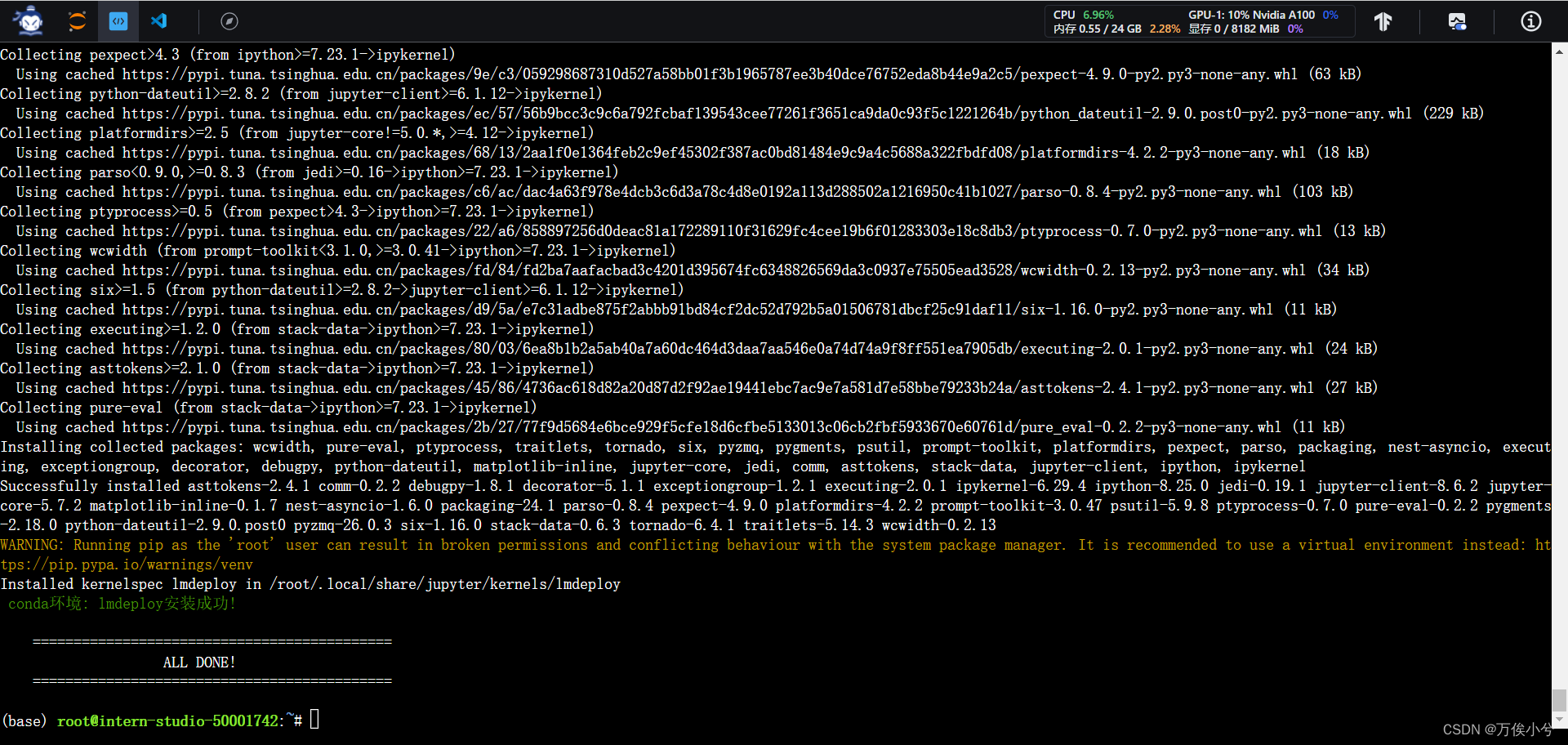

配置LMDeploy运行环境

studio-conda -t lmdeploy -o pytorch-2.1.2conda activate lmdeploy

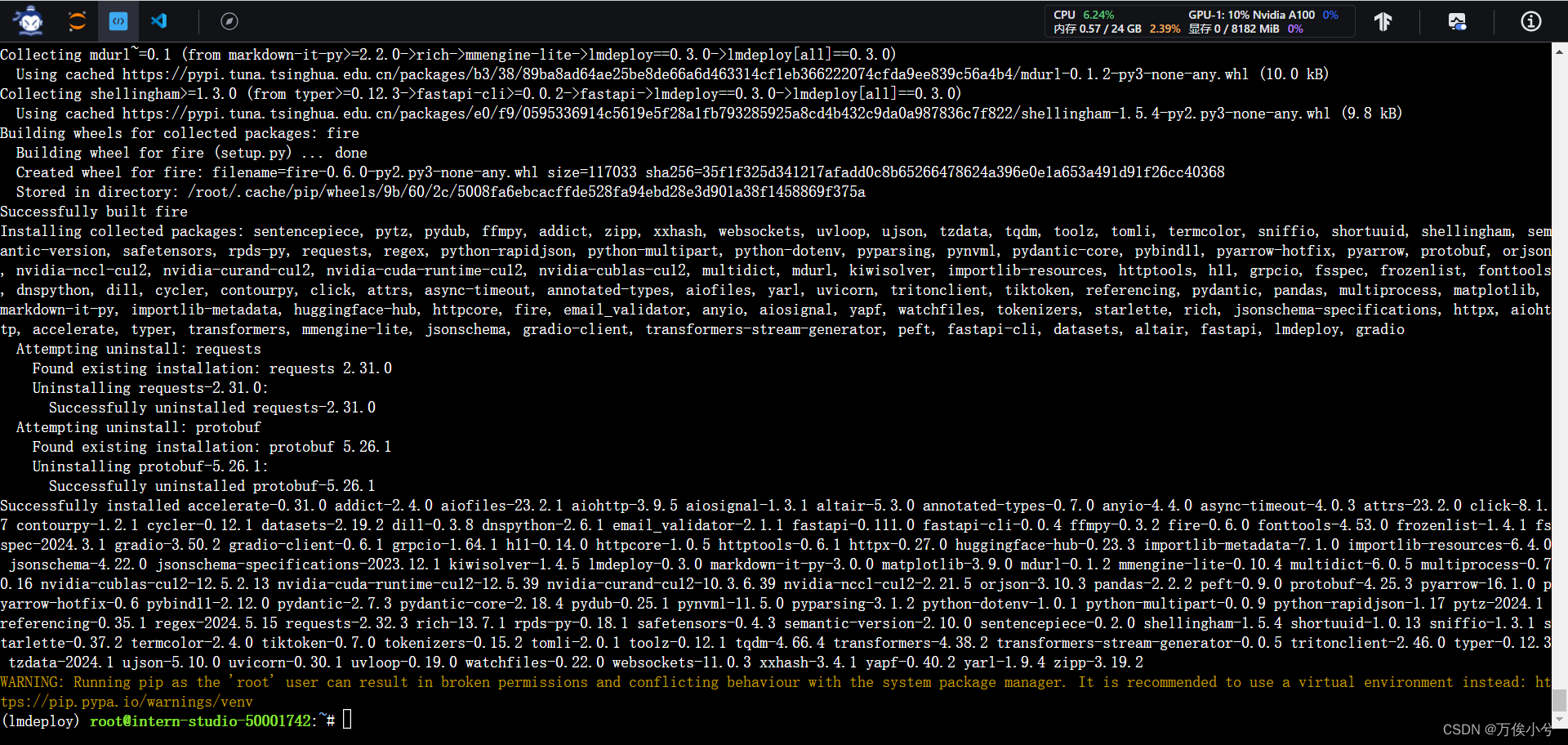

pip install lmdeploy[all]==0.3.0以命令行方式与InternLM2-Chat-1.8B模型对话

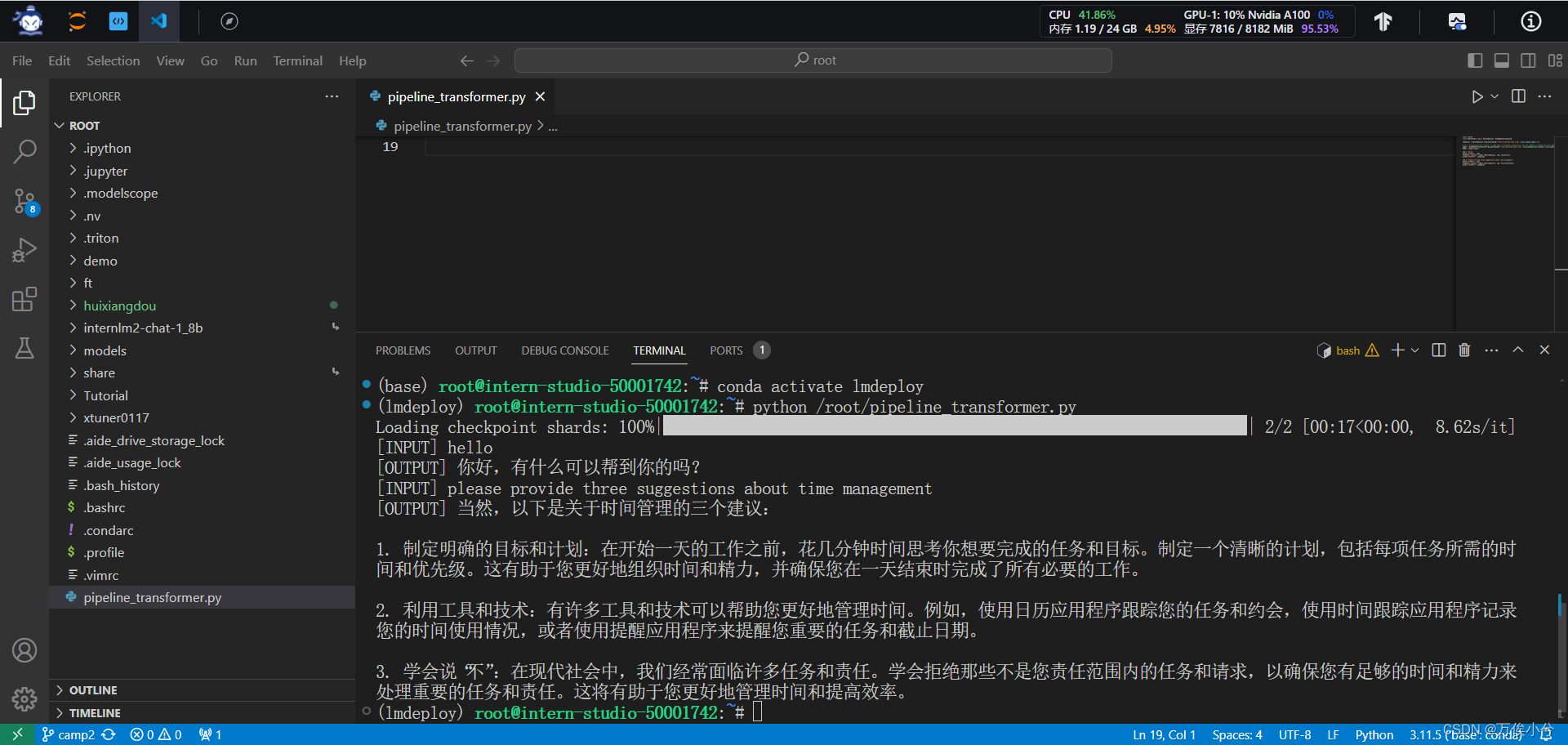

体验transformer推理速度

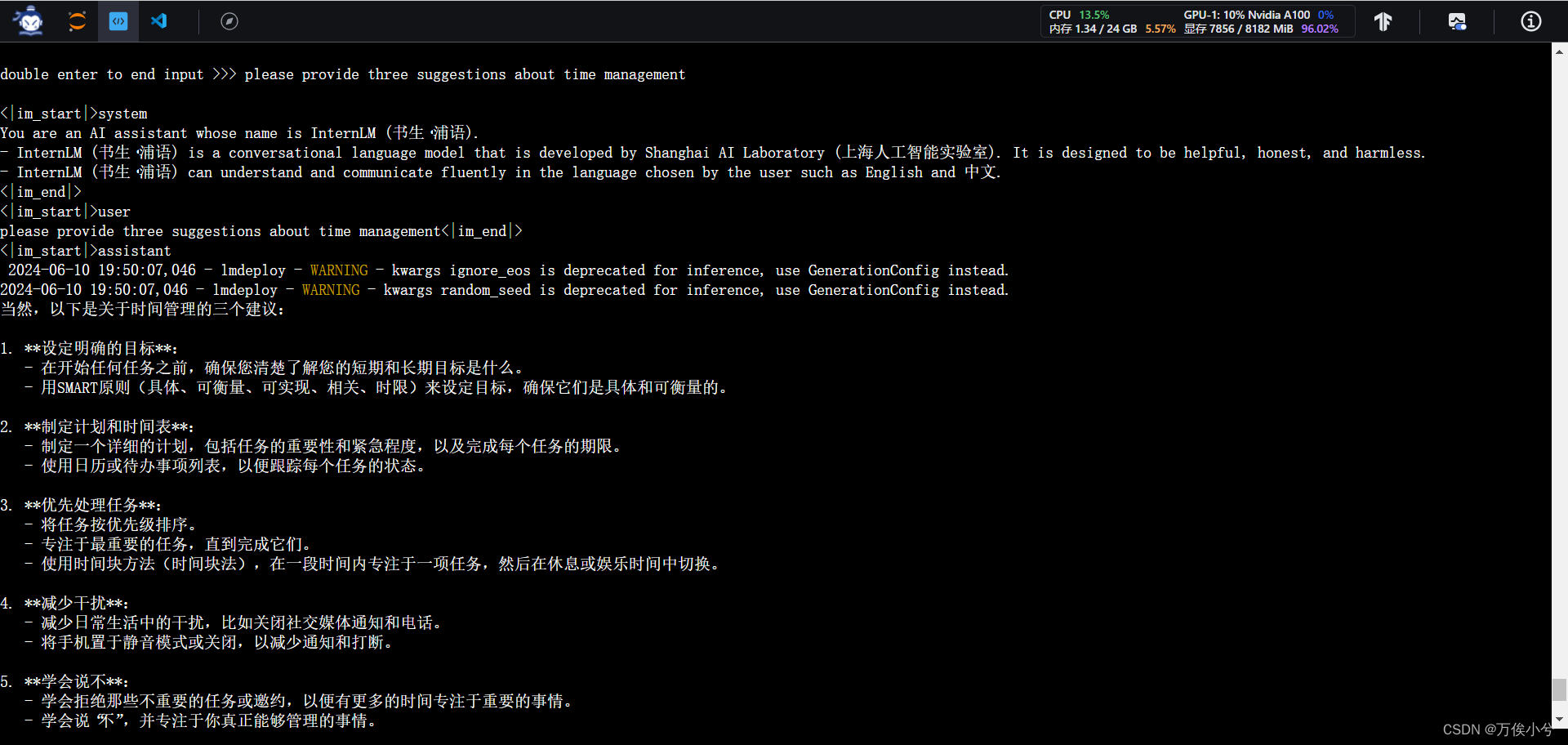

体验LMDeploy推理速度

Transformer运行到输出结果共计3分钟,输入问题后,回答有明显卡顿感。使用LMDeploy流畅多了。

951

951

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?