近年来,人工智能领域取得了重大进展,人工智能代理现在能够处理复杂的任务。尽管取得了这些进展,但有效地并行和协调多个人工智能代理协同工作仍然是一个挑战。

一群智能体可以理解为一组智能体在单个环境中共同共存,该环境可以相互协作解决问题。一个去中心化的代理生态系统非常类似于多个“智能”微服务,它们一起用于解决问题

Agent 历史

“Agent”是一个有着悠久历史的概念,在许多领域都得到了探索和解释。

关于AI Agent的最早起源,还要从能够启发人类思考的哲学领域开始探寻。一些论文将其追溯到公元前350年左右的亚里士多德(Aristotle)时期,当时的一些哲学家就曾在哲学作品描述过一些拥有欲望、信念、意图和采取行动能力的实体。

若从古代哲学家的思想著述中寻找Agent踪迹,还可以把时间继续上溯到公元前485年左右的中国春秋时代,老子在其对后世影响深远的思想巨著《道德经》中也可以看到智能体的影子。

该书在四十二章写道:“道生一,一生二,二生三,三生万物”。用现在计算科学眼光来看,它所描绘的”道”或许正是一个生生不息、包容万物并且能够自身演化的实体,这种实体小到种子的生发荣枯,大到宇宙天体的周天运转,这是典型的自主智能体。

时间再晚一些的庄子,在“庄周梦蝶”的时候,他不知道自己是庄子还是蝴蝶,分不清是梦境还是现实。如果用现代计算科技技术来看,这个梦可以理解为元宇宙,那么梦里的蝴蝶包括所有具备生命的物体,便都如“西部世界小镇”游戏那样的生成智能体。

时间来到18世纪,法国思想启蒙运动时期的丹尼斯·狄德罗(Denis Diderot )也提出了类似的观点:如果鹦鹉可以回答每个问题,它就可以被认为是聪明的。虽然狄德罗在著作中写的是鹦鹉,但谁都能体会到这里的“鹦鹉”并不是指一只鸟,而是突出了一个深刻的概念,即高度智能的有机体可以有着类似于人类的智能。

是不是很有意思,我们认为近代人们在科技取得一定进展后才设想的AI Agent,其实古人早就思考并探索过。

或许正是因为这种思想,造就了人类对于各种工具的极致追求,诞生了春秋战国时期鲁班打造的能飞三天三夜的“木鹊”与墨家打造的机关城,三国时期的木牛流马和指南车,唐代“酌酒行觞”的木人“女招待”,以及明朝帮人干活的多种“机关转捩”木头人。

这些人类早期出现的自动化工具,并非具备分析及推理能力并能够采取行动的智能体。但自古至今一直存在的这些想法与做法,恰恰也反映了人类数千年来对于智能体或者说自动化的持续追求。

当然通过这些思想我们也能获悉,Agent的哲学概念泛指具有自主性的概念或实体,它可以是人造的物体,可以是植物或动物,当然也可以是人。

发展:人工智能实体化

不管最早的Agent描述出自哪里,这些哲学思想都不同程度启发了近代Agent的发展。

20世纪50年代,阿兰图灵(Alan Turing)把“高度智能有机体”概念扩展到了人工实体,并提出了著名的图灵测试。这个测试是人工智能的基石,旨在探索机器是否可以显示与人类相当的智能行为。

这些人工智能实体通常被称为“Agent”,形成了人工智能系统的基本构建块。至此,人工智能领域提到的Agent,通常是指能够使用传感器感知其周围环境、做出决策、然后使用致动器采取响应行动的人工实体。

随着人工智能的发展,术语“Agent”在人工智能研究中找到了自己的位置,用来描述显示智能行为并具有自主性、反应性、主动性和社交能力等素质的实体。此后,Agent的探索和技术进步成为人工智能领域的焦点。

50年代末到60年代是人工智能的创造时期,所出现的编程语言、书籍及电影到现在还在持续影响更多的人。

在经历第一次人工智能寒冬后,80年代出现了一股人工智能热潮。这段时间的各项研究都有所突破,来自政府等机构的投资也开始增多,研究者对AI Agent的探索也在逐步增加。

但这股热潮仅维持了7年,到1987年迎来了第二次人工智能寒冬。

这股寒潮延续了很多年,尽管在这期间大部分机构都缺少资金支持,人工智能还是沿着既有技术路线刚毅发展。

其中,AI Agent就在1995年被Wooldridge和Jennings定义为一个计算机系统:它位于某个环境中,能够在这个环境中自主行动,以实现其设计目标。他们还提出AI Agent应具有自主性、反应性、社会能力与主动性等四个基本属性。

而在AI Agent正式被经济学接纳后,它也被进一步定义为具备感知其环境并采取行动以最大限度地提高成功机会的系统。根据这个定义,能够解决特定问题的简单程序也是“AI Agent”,所以后来能够在各种棋类游戏中与人类对弈的机器人也算是AI Agent的一种。

AI Agent范式将AI研究定义为“智能代理研究”,它研究各种智力,超越了研究人类智能。

在AI Agent被赋予“四种基本属性”期间,1993年到2011年,出现了很多基于当时AI技术且令人印象深刻的Agent类项目。

这些项目的出现时间和简介如下:

1997年:深蓝(由IBM开发)在一场广为人知的比赛中击败了世界国际象棋冠军加里·卡斯帕罗夫,成为第一个击败人类国际象棋冠军的程序。

1997年:Windows发布了语音识别软件(由Dragon Systems开发)。

2000年:Cynthia Breazeal教授开发了第一个可以用面部模拟人类情感的机器人,它拥有眼睛、眉毛、耳朵和嘴巴,被称为Kismet。

2002年:第一个Roomba被释放。

2003年:美国宇航局将两辆火星车(勇气号和机遇号)降落在火星上,它们在没有人类干预的情况下在火星表面航行。

2006年:Twitter,Facebook和Netflix等公司开始利用AI作为其广告和用户体验(UX)算法的一部分。

2010年:Microsoft推出了Xbox 360 Kinect,这是第一款旨在跟踪身体运动并将其转化为游戏方向的游戏硬件。

2011年:一台名为Watson(由IBM创建)的NLP计算机被编程来回答问题,在电视转播的智力比赛节目《Jeopardy》中战胜了两位前冠军。

2011年:苹果发布了Siri,这是第一个流行的虚拟助手。

进化:AI Agnet的演变

伴随着AI 技术的发展,至2000年左右,Agent已经衍生出不少种类。

根据其感知的智能和能力程度的不同,罗素、诺维格、彼得等人在《Artificial Intelligence: A Modern Approach》一书中将AI Agent分为以下五类:

简单反射智能体(SIMPLE REFLEX AGENTS)

一种简单的代理类型,它基于当前的感知而不是基于感知历史的其余部分。这种类型的问题包括智力非常有限,对状态的非感知部分一无所知,生成和存储规模巨大以及无法适应环境变化。

基于模型的智能体(MODEL-BASED AGENTS)

这种代理利用条件操作规则,通过查找允许满足基于当前情况的条件的规则来工作,通常由两个重要因素组成,即模型和内部状态。它可以通过获取有关世界如何演变以及代理的操作如何影响世界的信息来更新代理的状态。

基于目标的智能体(GOAL-BASED AGENTS)

此类型根据其目标或理想情况做出决定,以便它可以选择可以实现所需目标的操作。这种智能体可以通过搜索以及不同的计划,具备思考一长串可能的行动来确认其实现目标的能力,使代理具有主动性。

基于实用程序的智能体(UTILITY-BASED AGENTS)

公用事业代理的最终用途是其构建块,当需要从多个替代方案中采取最佳行动和决策时使用。它考虑了代理的幸福感,并给出了代理由于效用而有多幸福的想法,因此具有最大效用的行动。

学习型智能体(LEARNING AGENTS)

具有从过去的经验中学习的能力,并根据学习能力采取行动或做出决定。它从过去获得基础知识,并利用这些学习来自动行动和适应。一般由四部分组成,分别是学习元素、批评者、性能元素和问题生成器。

从这些分类和基本定义而言,很多AI工具以及早期的智能程序都可以归类为Agent的一种。包括早期的IBM用于象棋比赛的深蓝以及后文出场的AlphaGO,都算是基于当时最新AI技术的AI Agent。

当代:基于LLM的智能体

在2012年的ImageNet计算机视觉挑战赛中,AlexNet卷积神经网络的深度学习模型取得了第一名,深度学习从此真正在人工智能领域大显身手。

2016年,AlphaGO(谷歌专门从事围棋游戏的AI Agent)将击败欧洲冠军(范慧)和世界冠军(李世石),并很快被自己的兄弟(AlphaGo Zero)打败。

2017年,谷歌提出transformer。

2018年,谷歌发布基于Transformer模型的BERT,拉开了大语言模型序幕。

2019年,谷歌AlphaStar在视频游戏《星际争霸2》上达到了Grandmaster,表现优于除0.2%以外的所有人类玩家。

2019年,OpenAI发布GPT-2的自然语言处理模型,并分别在2020年和2022年发布了GPT-3、DALL·E 2及GPT-3.5,ChatGPT的火爆为AI Agent在大语言模型时代的发展与应用提供了新的契机。

从2023年1月开始,全球厂商发布了多个LLM,其中包括LLaMA、BLOOM、StableLM、ChatGLM等多个开源LLM。

与此同时,全球科技厂商所推出的数以千计的LLM,为AI Agent在各领域多元化应用提供了更广泛的基础。

2023年3月14日,OpenAI发布GPT-4。3月底,AutoGPT横空出世,迅速火遍全球。

Auto GPT是Github上由OpenAI推出的一个免费开源项目,结合了GPT-4和GPT-3.5技术,通过API创建完整的项目。

与ChatGPT不同的是,用户不需要不断对AI提问以获得对应回答,在AutoGPT中只需为其提供一个AI名称、描述和五个目标,AutoGPT就可以自己完成项目。它可以读写文件、浏览网页、审查自己提示的结果,以及将其与所说的提示历史记录相结合。

AutoGPT也是OpenAI的一个实验性项目,用以展示GPT-4语言模型的强大功能。由此开始,更多人在了解与体验AutoGPT的同时,也逐渐认知到了AI Agent。

由此开始,基于LLM的AI Agent开始雨后春笋般涌现,出现了Generative Agent、GPT-Engineer、BabyAGI、MetaGPT等多个项目,这些项目的爆发将LLM的发展与应用带入了新阶段,也将LLM的创业与落地引向了AI Agent。

5月,OpenAI拿下新一轮3亿美元融资后,创始人Sam Altman透露更加关注如何使用聊天机器人来创建自主AI Agents,并会将相关功能部署到ChatGPT助手中。

6月,扎克伯格在全体员工会议上宣布了一系列处于不同开发阶段的技术,其中一个就是将发布能为用户提供帮助或娱乐功能的具备不同个性和能力的AI Agents。

6月底,OpenAI Safety团队负责人Lilian Weng发表了一篇名为《LLM Powered Autonomous Agents》的文章,详细介绍了基于LLM的AI Agent,并认为这将使LLM转为通用问题解决方案的途径之一。

至此,人们终于对AI Agent有了全面的了解,AI Agent的神秘面纱终于被揭开。

人工智能领域对于AI Agent的探索从未停止,在每个AI技术获得全新突破之后都会有组织将其探索与应用纳入新课题。以AlphaGo为代表的深度学习与神经网络技术崭露头角后,就出现了基于深度学习及神经网络的Agent,被应用于游戏、医疗等诸多领域。

而近几年大语言模型获得突破,在谷歌发布Bert及OpenAI 发布GPT-2后,很多组织都开始与其合作开始打造基于LLM的Agent。

我们还在谈论AI Agent的时候,海外已经出现很多AI Agent框架与产品。比如在8月末刚完成1500万美金融资的Voiceflow,现在已是最受开发者欢迎的Al Agent构建平台之一,有超过13万团队在这里高效协同构建自己的Al Agent。

从这类AI Agent构建平台来看,目前已经有不少组织正在或者已经构建自己的AI Agent,且每个组织都可以面向不同业务场景的多个Agent。

王吉伟频道也在之前盘点了全球60个AI Agent项目,目前已经提出项目清单1.0,这个名单将会不断迭代,也欢迎已经推出AI Agent的团队或者AI Agent爱好者,共同完善这份清单。

定义:当代AI Agent特性

Lilian Weng在其博文《LLM Powered Autonomous Agents》 中,对基于LLM的AI Agent 做了系统综述。

原文地址:https://lilianweng.github.io/posts/2023-06-23-agent/

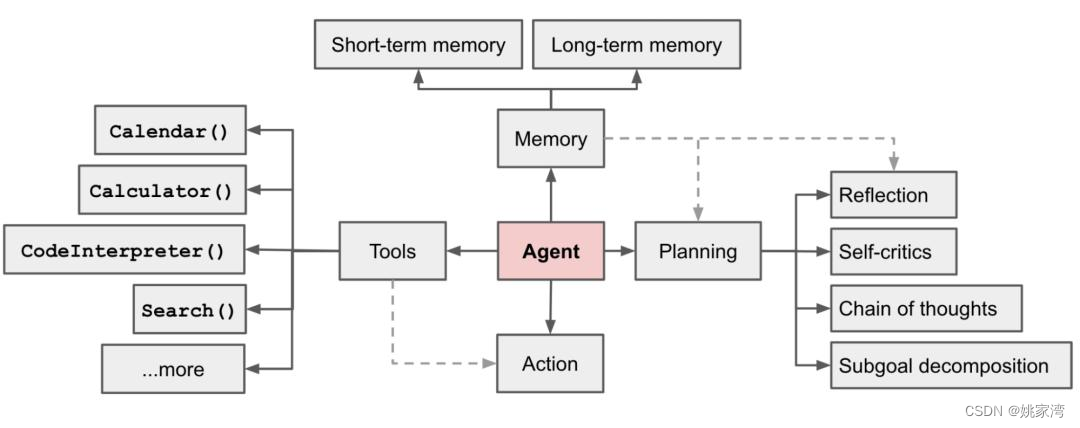

她将Agents定义为LLM、记忆(Memory)、任务规划(Planning Skills)以及工具使用(Tool Use) 的集合,其中 LLM 是核心大脑,Memory、Planning Skills 以及 Tool Use 等则是 Agents 系统实现的三个关键组件,并对每个模块下实现路径进行了细致的梳理和说明。

Agent系统架构图,出自博文《LLM Powered Autonomous Agents》

代理系统概述

在 LLM 驱动的自主代理系统中,LLM 充当代理的大脑,并由几个关键组件补充:

- 规划

- 子目标和分解:代理将大型任务分解为更小的、可管理的子目标,从而能够高效处理复杂任务。

- 反思和完善:智能体可以对过去的行为进行自我批评和自我反思,从错误中吸取教训,并为未来的步骤进行改进,从而提高最终结果的质量。

- 记忆

- 短期记忆:我认为所有的情境学习(参见提示工程)都是利用模型的短期记忆来学习的。

- 长期记忆:这为代理提供了在较长时间内保留和调用(无限)信息的能力,通常是通过利用外部向量存储和快速检索。

- 工具使用

- 代理学习调用外部 API 以获取模型权重中缺少的额外信息(在预训练后通常很难更改),包括当前信息、代码执行能力、对专有信息源的访问等。

从文章中不难看出,目前我们所说的AI Agent本质是一个控制LLM来解决问题的代理系统。LLM的核心能力是意图理解与文本生成,如果能让LLM学会使用工具,那么LLM本身的能力也将大大拓展。AI Agent系统就是这样一种解决方案,可以让LLM“超级大脑”真正有可能成为人类的“全能助手”。

在AI发展到大语言模型时代,很多AI工具看起来已经具备了初步的Agent能力。虽然AI工具包括机器人和Agent都是旨在自动化任务的软件程序,但特定的关键特征将AI智能体区分为更复杂的AI 软件。

业内认为,当AI工具具备以下特征时,就可以将该工具视为AI Agent:

自治(Autonomy)

AI 虚拟智能体能够独立执行任务,而无需人工干预或输入。

知觉(Perception)

智能体功能通过各种传感器(如摄像头或麦克风)感知和解释它们所处的环境。

反应(Reactivity)

AI 智能体可以评估环境并做出相应的响应以实现其目标。

推理和决策(Reasoning and decision-making)

AI 智能体是智能工具,可以分析数据并做出决策以实现目标。他们使用推理技术和算法来处理信息并采取适当的行动。

学习(Learning)

可以通过机器、深度和强化学习元素和技术来学习和提高他们的表现。

通信(Communication)

AI 智能体可以使用不同的方法与其他智能体或人类进行通信,例如理解和响应自然语言、识别语音以及通过文本交换消息。

以目标为导向(Goal-oriented)

它们旨在实现特定目标,这些目标可以通过与环境的交互来预定义或学习。

在这个更为广义的特征之下,今后AI Agent存在的环境将更加宽泛,种类也将更加繁多。

与此同时,在大语言模型的加持之下,AI Agent也逐步衍生出了自主智能体(Autonomous Agent)和生成智能体(Generative Agent)。

自主智能体如AutoGPT,能够根据人们通过自然语言提出的需求,自动执行任务并实现预期结果。在这种合作模式下,自主智能体主要是为人类服务,更像是一个高效的工具。

大家目前所聊的智能体多数是基于LLM自主智能体,它已被认为是通向通用人工智能(AGI)最有希望的道路。

如果说AutoGPT拉开了自主智能体的帷幕,今年4月份斯坦福和谷歌的研究者共同创建的“西部世界小镇(Westworld simulation)”则开启了生成智能体之路。小镇里的25个AI Agent,每天都在乐此不疲地散步、约会、聊天、用餐以及分享当天的新闻。

生成智能体基于GPT-3 、BERT等LLM构建,以自然语言存储代理体验的完整记录。生成智能体体系结构包括三个主要组件:观察、规划和反思。这些组件协同工作,使生成代理能够生成反映其个性、偏好、技能和目标的现实且一致的行为。此外,此体系结构允许用户、代理和其他代理之间进行自然语言通信。

简单的讲,生成智能体就像美剧《西部世界》中的人形机器人以及《失控玩家》中的智能NPC,它们在同一环境中生活,拥有自己的记忆和目标,不仅与人类交往,还会与其他机器人互动。

未来:AI Agent无处不在

Agent的核心在于LLM,可以说大语言模型的能力决定了AI Agent的能力半径,所以目前基于GPT-4的Agent表现得更加智能。未来随着更多大语言模型的完善、迭代与优化,基于这些LLM构建的Agent自然能力也会更强。

以后的AI Agnet,将主要呈现以下几种特征:

更加智能、自主并拥有更强适应性。

将能够学习和改进自己的行为,根据不同的情境和用户做出最优的决策,以及处理不确定性和复杂性。

更加人性化、友好和可信赖。能够理解和表达情感,建立和维持与用户的关系,以及遵守道德和社会准则。

更加多样化、专业化和协作化。

能够针对不同的领域和任务提供专业的服务或帮助,以及与其他AI Agent或人类进行有效的协作和协调。

Agent将会成为大模型在各行业及领域应用的主体形式,未来LLM的开发与应用的都将围绕Agent以工具或者助手的形式呈现。随着Agent以标准化产品形态出现,广大组织引入与应用AI Agent将变得更加简单。

相关企业与组织也可以基于引入的大语言模型或者垂直领域模型构建面向领域的Agent,以帮助客户高效释放LLM的能力。也可以构建内部或者面向客户的AI Agent平台及社区,方便自身及客户运营中随时构建所需的Agent。

更多的AI Agent构建平台,也将促使大量Agent的出现,个人构建与应用Agent也将更加容易。未来只要大家愿意,随时都可以通过各种Agent平台打造适合自己的个性化Agent,通过更加个性化的功能与服务增强沟通和协作、拓展知识和技能等。

甚至还能在不同业务场景构建多个不同的Agent,并让这些Agent协同工作,多Agent系统协同可以输出更加准确的结果以及完成更加复杂的任务。

AI Agent无视行业与业务场景,只要能应用LLM的地方都可以构建相应的Agent。它可以应用于各行业,例如教育、医疗、金融、制造、娱乐等,帮助提高效率、降低成本、创造价值。

未来,AI Agent可能会更加智能、自适应、多样化,能够处理更复杂的问题和场景,与人类形成更紧密的合作和共生。

如Lilian Weng在博文中所说,AI Agent可以让LLM从“超级大脑”进化为人类的“全能助手”,这意味着基于LLM的Agent助手以后将会服务更多的人与组织。

随着AI Agent的广泛应用,大语言模型时代的人机交互也将升级人类与AI Agent的自动化合作体系。这种新型人机合作可以称之为人机智能体,它将推动人类社会的生产结构进一步升级,进而影响社会的各个方面。

同时,一个具备交流能力并能自主/自动执行任务的智能网络将是互联网的下一阶段,AI Agent将是人类与之交互和执行任务的智能工具。

未来的趋势,AI agent大概率会出现在人类工作、学习、生活、娱乐的各个场景中,人人都将配备一个基于AI agent系统的智能助手,《钢铁侠》《星际穿越》《星球大战》等电影中人机协同的场景将会真正变成现实。

这,又将是一个多大量级的市场。

写在最后:本来还想在这篇文章中探讨“Agent游戏的进化”与“人类与智能体的界限”这两个话题。限于篇幅以及这两个话题与本文的相关性,只能在新的选题中与大家探讨了。对这些感兴趣的朋友,可以加微信mcjave与我交流。

早在 1950 年代,Alan Turing 就将「智能」的概念扩展到了人工实体,并提出了著名的图灵测试。这些人工智能实体通常被称为 —— 代理(Agent*)。「代理」这一概念起源于哲学,描述了一种拥有欲望、信念、意图以及采取行动能力的实体。在人工智能领域,这一术语被赋予了一层新的含义:具有自主性、反应性、积极性和社交能力特征的智能实体。

大型语言模型(LLMs)的出现为智能代理的进一步发展带来了希望。如果将 NLP 到 AGI 的发展路线分为五级:语料库、互联网、感知、具身和社会属性,那么目前的大型语言模型已经来到了第二级,具有互联网规模的文本输入和输出。在这个基础上,如果赋予 LLM-based Agents 感知空间和行动空间,它们将达到第三、第四级。进一步地,多个代理通过互动、合作解决更复杂的任务,或者反映出现实世界的社会行为,则有潜力来到第五级 —— 代理社会。

早在 1986 年,Marvin Minsky 就做出了具有前瞻性的预言。他在《心智社会》(The Society of Mind)一书中提出了一种新颖的智力理论,认为智力是在许多较小的、特定功能的代理的相互作用中产生的。例如,一些代理可能负责识别模式,而其他代理可能负责做出决策或生成解决方案。

这一想法随着分布式人工智能的兴起得到了具体实践。多代理系统(Multi-Agent System)作为其中主要的研究问题之一,主要关注代理们如何有效地协调并协作解决问题。本文作者将多代理之间的交互划分为以下两种形式:

多代理应用场景的两种交互形式:合作型互动、对抗型互动。

合作型互动

作为实际应用中部署最为广泛的类型,合作型的代理系统可以有效提高任务效率、共同改进决策。具体来说,根据合作形式的不同,作者们又将合作型互动细分为无序合作与有序合作。

无序合作

当所有代理自由地表达自己的观点、看法,以一种没有顺序的方式进行合作时,称为无序合作。

有序合作

当所有代理遵循一定的规则,例如以流水线的形式逐一发表自己的观点时,整个合作过程井然有序,称为有序合作。

对抗型互动

智能代理以一种针锋相对(tit for tat)的方式进行互动。通过竞争、谈判、辩论的形式,代理抛弃原先可能错误的信念,对自己的行为或者推理过程进行有意义的反思,最终带来整个系统响应质量的提升。

人机交互场景

人机交互(Human-Agent Interaction),顾名思义,是智能代理通过与人类交互,合作完成任务。一方面,代理的动态学习能力需要沟通交流来支持;另一方面,目前的代理系统在可解释性上的表现依然不足,可能会存在安全性、合法性等方面的问题,因此需要人类参与进行规范与监督。

作者们在论文中将 Human-Agent 的交互划分为以下两种模式:

人机交互场景的的两种模式:Instructor-Executor 模式 vs. Equal Partnership 模式。

Instructor-Executor 模式

人类作为指导者,给出指令、反馈意见;而代理作为执行者,依据指示逐步调整、优化。这种模式在教育、医疗、商业等领域得到了广泛的应用。

Equal Partnership 模式

有研究观察到代理能够在与人类的交流中表现出共情能力,或是以平等的身份参与到任务执行中。智能代理展现出在日常生活中的应用潜力,有望在未来融入人类社会。

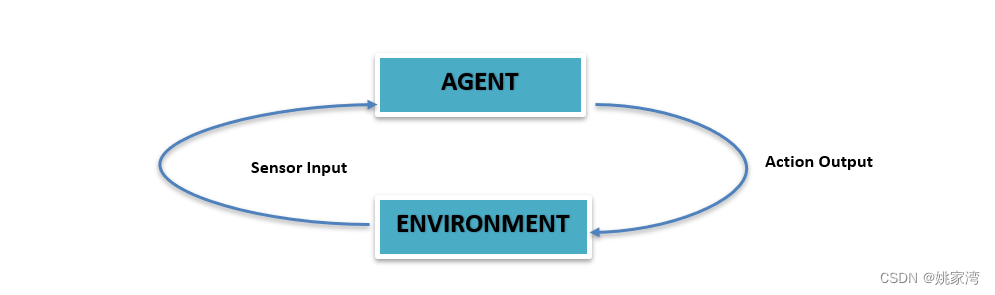

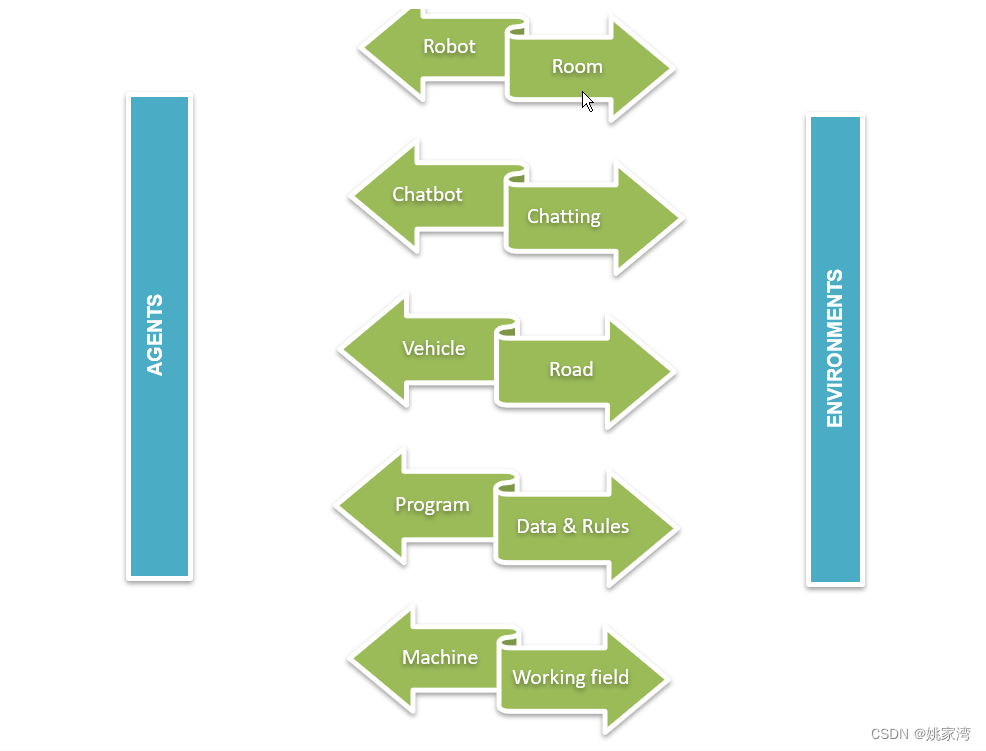

Agent Environments

“环境”一词是众所周知的。根据牛津词典的定义:“环境是人、动物或植物生活或活动的环境或条件。但是,当涉及到计算时,它是计算设备工作或操作的周围环境。在人工智能的背景下,环境只是代理的周围环境,是代理运行的地方。

现在,让我们考虑一个在路上驾驶汽车的真实例子。你能猜到谁将成为代理和环境吗?是的

- 代理商将汽车

- 环境就是道路。

- 驾驶员是感知所有警报并在危险环境中操作汽车以获得所需输出的人 - 安全驾驶。

同样,在人工智能中,我们有一个包含代理、传感器和执行器的环境。

上图显示了代理-环境交互的最简单图示形式。代理位于环境中。有传感器来感知环境,它们为代理提供感官输入。然后,代理对相应的输入执行操作,并将输出提供回环境。

对于人工智能来说,要解决的问题本身就带来了巨大的挑战。对于人工智能来说,理解给定问题本身是一项具有挑战性的任务。除了推理之外,人工智能问题最具挑战性的方面是环境。

Agent 和 Environment 可以说是 AI 悬而未决的两个钩子。或者更简单地说,环境被认为是问题,那么智能体就是问题的解决方案,或者“智能体”是在地面上玩的游戏,即“环境”。

上面显示了代理及其环境的一些示例,以便清楚地了解。对于给定的驾驶任务,车辆是代理,道路是行驶的环境。摄像头、雷达、激光雷达等传感器设备将收集有关道路的信息,例如行人的存在、道路上存在的其他车辆数量、交通信号等。然后,车辆将根据该信息采取行动,例如是否必须踩下制动踏板或油门踏板或必须转弯等。

如果一台机器是一个代理,那么它的工作地点就是它的环境。如果我们将冷却系统视为代理,那么它所服务的行业就是环境。然后,冷却液温度传感器将收集信息,机器将根据该信息采取行动。

为什么代理环境很重要?

人工智能也可以称为对理性智能体及其环境的研究。从这句话本身可以看出,代理和代理环境对人工智能的重要性。人工智能系统的工作可以用最少的文字来说明。通过不同类型的传感器,智能体将感知环境,并通过执行器,智能体将对其环境采取行动。代理环境的结构将影响整个人工智能系统本身。

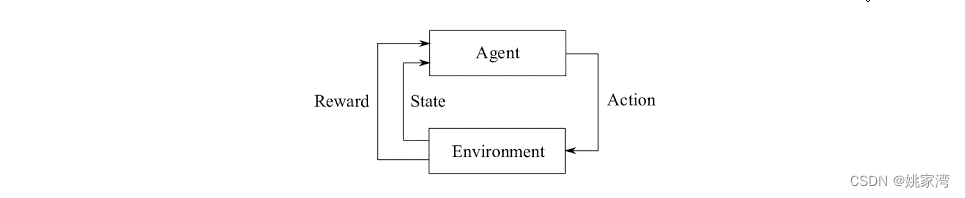

代理不能完全控制其环境,但具有部分控制权。这意味着环境会受到代理的影响。但智能体的性能直接受到环境变化的影响。也就是说,一个代理在两个不同的环境中执行相同的任务将导致两种完全不同的结果。智能体被预先编程了一组能力,它可以将其应用于其环境中可能面临的不同情况。这些预编程的能力称为效果能力。代理的传感器受到环境的严格影响。智能体使用其效应能力和来自传感器的信息来执行决策。每个动作都不适合每种情况。前提条件必须适合执行特定任务。例如,代理必须打开一扇门,它可以这样做。但只有在门解锁时才能执行(前提条件)。因此,决定在给定实例中执行的操作以实现目标或至少朝着目标努力是环境中代理的最大问题。环境的属性直接影响决策过程的复杂性。

代理将如何与环境交互?

代理与环境之间的交互是与程序有关的时间。对于每个时间步,代理都会收集有关环境状态表示的信息。根据此信息,代理将从该状态的可用操作中选择一个操作。经过一段时间步长后,代理将收到特定操作的结果数字奖励,并将自己设置为新状态。这种交互是一个连续的过程,动作由智能体选择,环境将响应这些动作并向智能体呈现新情况。

环境的类型

| 环境类型 | 描述 |

|---|---|

| 完全可观察的环境 | 代理可以在任何给定时间访问有关世界状态的完整和准确的信息。 |

| 部分可观察的环境 | 智能体对世界状态的信息有限或嘈杂,需要他们做出推断并维持信念状态。 |

| 确定性环境 | 这些环境的特点是定义明确的规则和可预测的结果,使智能体能够根据已知的行动和后果做出精确的决策。 |

| 随机环境 | 这些环境引入了随机性或不确定性,使得智能体必须结合基于概率的推理和决策策略。 |

| 情节环境 | 代理操作不会对后续剧集产生持久影响,使他们能够独立地专注于单个任务或场景。 |

| 顺序环境 | 这些环境涉及一系列相互关联的状态和操作,其中一个操作的结果会影响未来的状态和决策。 |

人工智能中的环境是智能体的周围环境。智能体通过传感器从环境中获取输入,并通过执行器将输出传递到环境。有几种类型的环境:

- 完全可观察与部分可观察

- 确定性与随机性

- 竞争与协作

- 单代理与多代理

- 静态与动态

- 离散与连续

- 情节与顺序

- 已知与未知

. 完全可观察与部分可观察

- 当智能体传感器能够在每个时间点感知或访问智能体的完整状态时,它被称为一个完全可观察的环境,否则它是部分可观察的。

- 维护一个完全可观察的环境很容易,因为不需要跟踪周围环境的历史。

- 当代理在所有环境中都没有传感器时,环境称为不可观察。

- 例子:

- 国际象棋 – 棋盘是完全可观察的,对手的动作也是如此。

- 驾驶 – 环境部分是可观察的,因为拐角处的情况是未知的。

2. 确定性与随机性

- 当智能体当前状态的唯一性完全决定了智能体的下一个状态时,环境被称为确定性环境。

- 随机环境本质上是随机的,它不是唯一的,不能完全由智能体确定。

- 例子:

- 国际象棋 – 在当前状态下,棋子只有几步棋,这些棋子可以确定。

- 自动驾驶汽车 - 自动驾驶汽车的动作并不是独一无二的,它会不时变化。

竞争与协作

- 当一个智能体与另一个智能体竞争以优化输出时,它被称为处于竞争环境中。

- 国际象棋游戏是竞争性的,因为代理相互竞争以赢得比赛,这就是输出。

- 当多个代理合作产生所需的输出时,称为代理处于协作环境中。

- 当在道路上发现多辆自动驾驶汽车时,它们会相互合作以避免碰撞并到达目的地,这是所需的输出。

4. 单代理与多代理

- 仅由一个代理组成的环境称为单代理环境。

- 一个人独自留在迷宫中是单代理系统的一个例子。

- 涉及多个代理的环境是多代理环境。

- 足球比赛是多主体的,因为它涉及每支球队的 11 名球员。

5. 动态与静态

- 当代理采取某些行动时,不断变化的环境被称为动态环境。

- 过山车是动态的,因为它是动态的,环境每时每刻都在变化。

- 状态没有变化的空闲环境称为静态环境。

- 空房子是静态的,因为当特工进入时,周围环境没有变化。

6. 离散与连续

- 如果一个环境由有限数量的操作组成,这些操作可以在环境中进行审议以获得输出,则称为离散环境。

- 国际象棋游戏是离散的,因为它只有有限的步数。每场比赛的移动次数可能会有所不同,但它仍然是有限的。

- 执行动作的环境不能编号,即不是离散的,可以说是连续的。

- 自动驾驶汽车是连续环境的一个例子,因为它们的行为是驾驶、停车等,无法编号。

7.情节与顺序

- 在情节任务环境中,智能体的每个动作都分为原子事件或事件。当前事件和以前的事件之间没有依赖关系。在每个事件中,代理从环境中接收输入,然后执行相应的操作。

- 示例:以拾取和放置机器人为例,该机器人用于检测传送带上的缺陷零件。在这里,每次机器人(代理)都会对当前部分做出决定,即当前和以前的决定之间没有依赖关系。

- 在顺序环境中,以前的决策可能会影响所有未来的决策。代理的下一步行动取决于他之前采取的行动以及他将来应该采取的行动。

- 例:

- 跳棋 - 前一步棋可以影响所有后续棋。

8. 已知与未知

- 在已知环境中,会给出所有可能操作的输出。显然,在未知环境的情况下,代理要做出决定,就必须了解环境是如何工作的。

904

904

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?