Dify、Coze、ChatWiki 与 FastGPT 这四大智能体平台,各有千秋。

一、Dify

Dify 是一款开源的大语言模型(LLM) 应用开发平台。它融合了后端即服务(Backend as Service)和 LLMOps 的理念,使开发者可以快速搭建生产级的生成式 AI 应用。即使你是非技术人员,也能参与到 AI 应用的定义和数据运营过程中。

Github:https://github.com/langgenius/dify

1.功能优势

①工作流: 在画布上构建和测试功能强大的 AI 工作流程,利用以下所有功能以及更多功能。

②全面的模型支持: 与数百种专有/开源 LLMs 以及数十种推理提供商和自托管解决方案无缝集成,涵盖 GPT、Mistral、Llama3 以及任何与 OpenAI API 兼容的模型。

③Prompt IDE: 用于制作提示、比较模型性能以及向基于聊天的应用程序添加其他功能(如文本转语音)的直观界面。

④RAG Pipeline: 广泛的 RAG 功能,涵盖从文档摄入到检索的所有内容,支持从 PDF、PPT 和其他常见文档格式中提取文本的开箱即用的支持。

⑤Agent 智能体: 您可以基于 LLM 函数调用或 ReAct 定义 Agent,并为 Agent 添加预构建或自定义工具。Dify 为 AI Agent 提供了50多种内置工具,如谷歌搜索、DALL·E、Stable Diffusion 和 WolframAlpha 等。

⑥LLMOps: 随时间监视和分析应用程序日志和性能。您可以根据生产数据和标注持续改进提示、数据集和模型。

⑦后端即服务: 所有 Dify 的功能都带有相应的 API,因此您可以轻松地将 Dify 集成到自己的业务逻辑中。

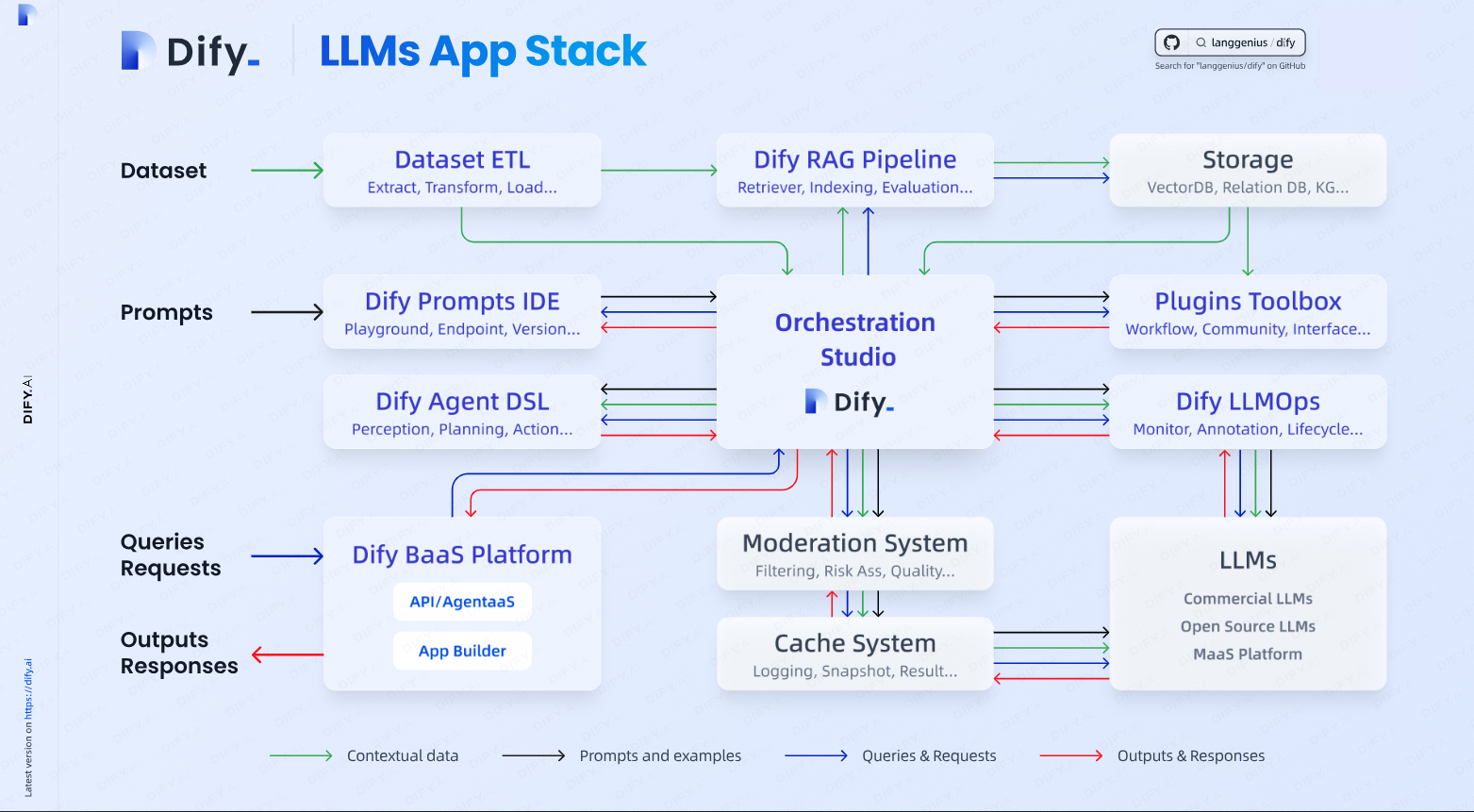

2.系统框架

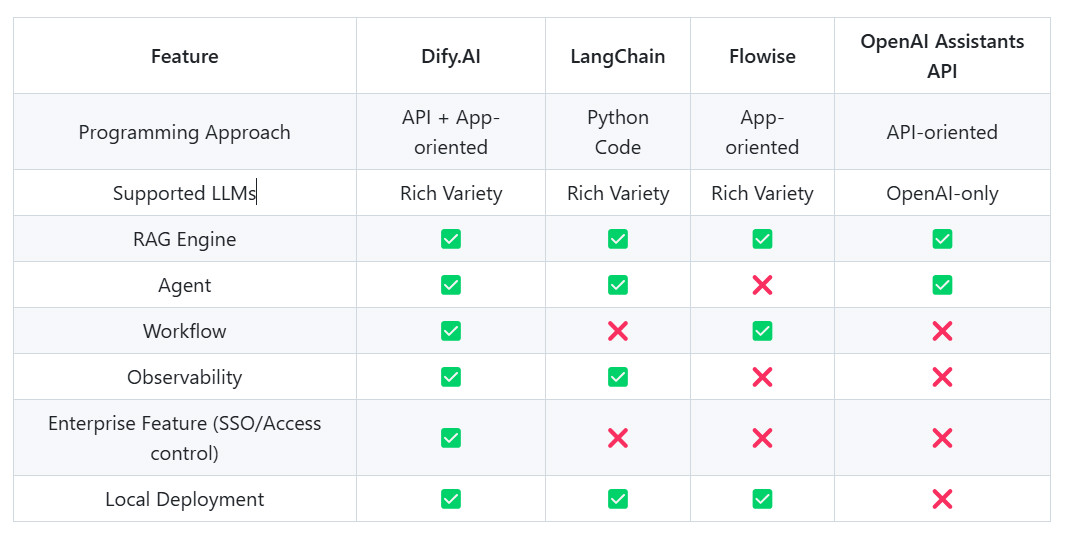

3.技术栈

Dify 内置了构建 LLM 应用所需的关键技术栈,包括对数百个模型的支持、直观的 Prompt 编排界面、高质量的 RAG 引擎、稳健的 Agent 框架、灵活的流程编排,并同时提供了一套易用的界面和 API。这为开发者节省了许多重复造轮子的时间,使其可以专注在创新和业务需求上。

二、Coze

扣子是新一代 AI 应用开发平台。无论你是否有编程基础,都可以在扣子上快速搭建基于大模型的各类 AI 应用,并将 AI 应用发布到各个社交平台、通讯软件,也可以通过 API 或 SDK 将 AI 应用集成到你的业务系统中。

借助扣子提供的可视化设计与编排工具,你可以通过零代码或低代码的方式,快速搭建出基于大模型的各类 AI 项目,满足个性化需求、实现商业价值。

官网:扣子

Github:https://github.com/cloudwego/eino

1.功能优势

①灵活的工作流设计:扣子的工作流功能可以用来处理逻辑复杂,且有较高稳定性要求的任务流。扣子提供了大量灵活可组合的节点包括大语言模型 LLM、自定义代码、判断逻辑等,无论你是否有编程基础,都可以通过拖拉拽的方式快速搭建一个工作流。例如创建一个撰写行业研究报告的工作流,让智能体写一份 20 页的报告。

②无限拓展的能力集:扣子集成了丰富的插件工具,极大地拓展智能体的能力边界。扣子官方发布了多款能力丰富的插件,你可以直接将这些插件添加到智能体中。例如使用新闻插件,打造一个可以播报最新时事新闻的 AI 新闻播音员。扣子平台也支持创建自定义插件。 你可以将已有的 API 能力通过参数配置的方式快速创建一个插件让智能体调用。自定义插件也可以发布到商店,供其他用户使用。

③丰富的数据源:扣子提供了简单易用的知识库功能来管理和存储数据,支持智能体与你自己的数据进行交互。无论是内容量巨大的本地文件还是某个网站的实时信息,都可以上传到知识库中。这样,智能体就可以使用知识库中的内容回答问题了。

④持久化的记忆能力:扣子提供了方便 AI 交互的数据库记忆能力,可持久记住用户对话的重要参数或内容。创建一个数据库来记录阅读笔记,包括书名、阅读进度和个人注释。有了数据库,智能体就可以通过查询数据库中的数据来提供更准确的答案。

2.代码框架

三、ChatWiki

ChatWiki是一款开源的知识库 AI 问答系统。系统基于大语言模型(LLM )和检索增强生成(RAG)和GraphRAG知识图谱构建,提供开箱即用的数据处理、模型调用等能力,企业,高校和政务部门可快速搭建私有的知识库AI 问答系统。

官网链接:ChatWiki言之AI-开源大模型问答知识库AI机器人

github开源链接:https://github.com/zhimaAi/chatwiki

1.功能优势

①简单易用的企业专属AI问答智能体,通过导入企业已有知识构建知识库,让 AI 机器人使用关联的知识库回答问题,快速构建企业专属 AI 问答系统。支持DeepSeek R1、doubao pro、qwen max、Openai、Claude 等全球20多种主流模型。

②灵活的工作流配置,提供灵活的工作流配置功能,支持多步骤任务编排与自动化处理。用户可根据业务需求自定义问答流程、数据流转,实现复杂场景下的智能化协作与管理。通过工作流,可以实现聊天机器人与业务系统的互通。

③提供了多样化的调用渠道,支持 嵌入网站、桌面客户端、WebApp、微信小程序、微信公众号、微信客服、抖音企业号、快手号、视频号 及API调用等,全面覆盖企业多终端业务场景需求。

④支持Graph RAG,Graph RAG(图检索增强生成)是一种结合了图数据库(Graph Database)与检索增强生成(Retrieval-Augmented Generation, RAG)技术的新型知识增强生成框架。它通过图结构(节点和边)组织知识,利用图数据库的高效关联查询能力,提升大语言模型(LLM)在复杂推理和多跳问题中的表现。

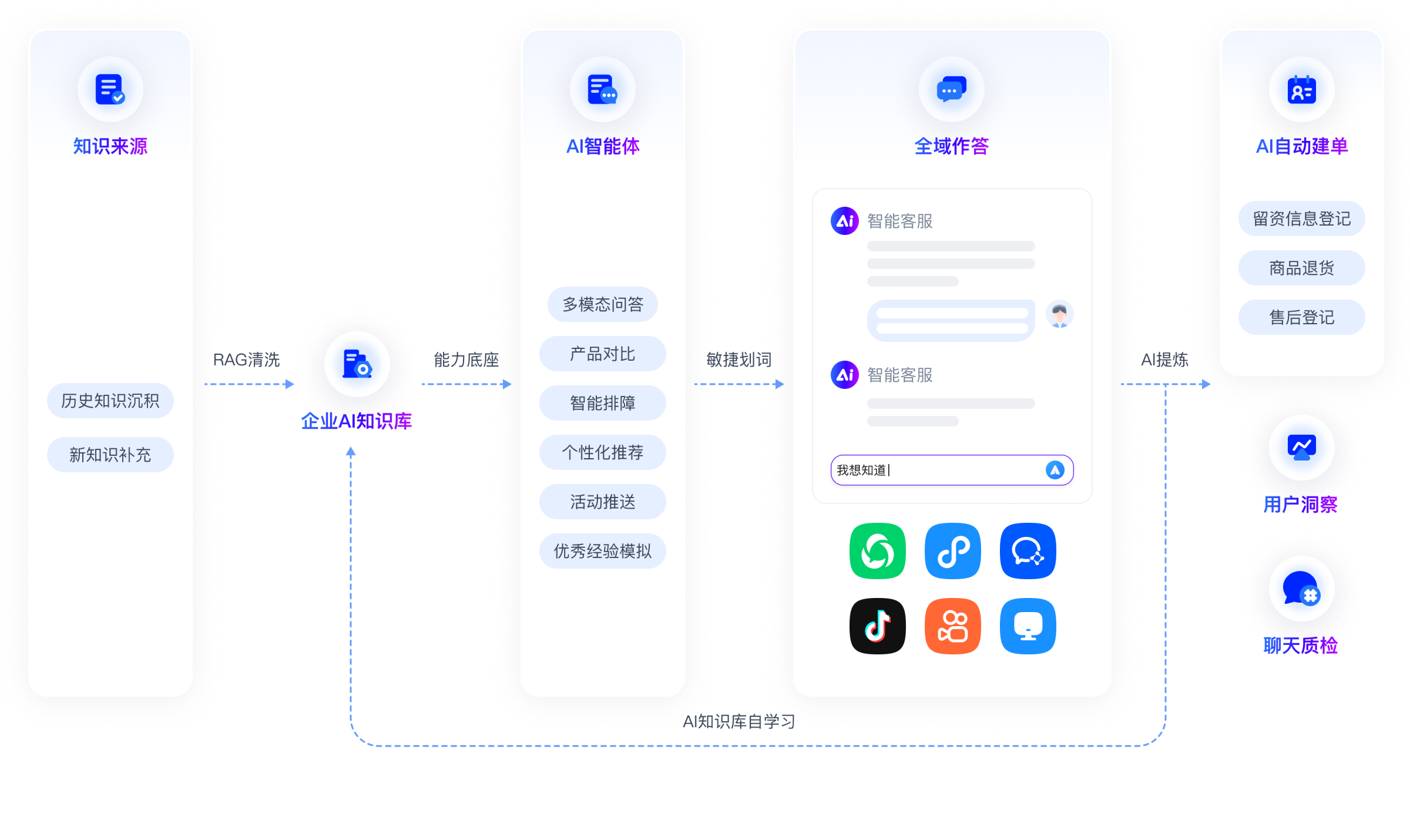

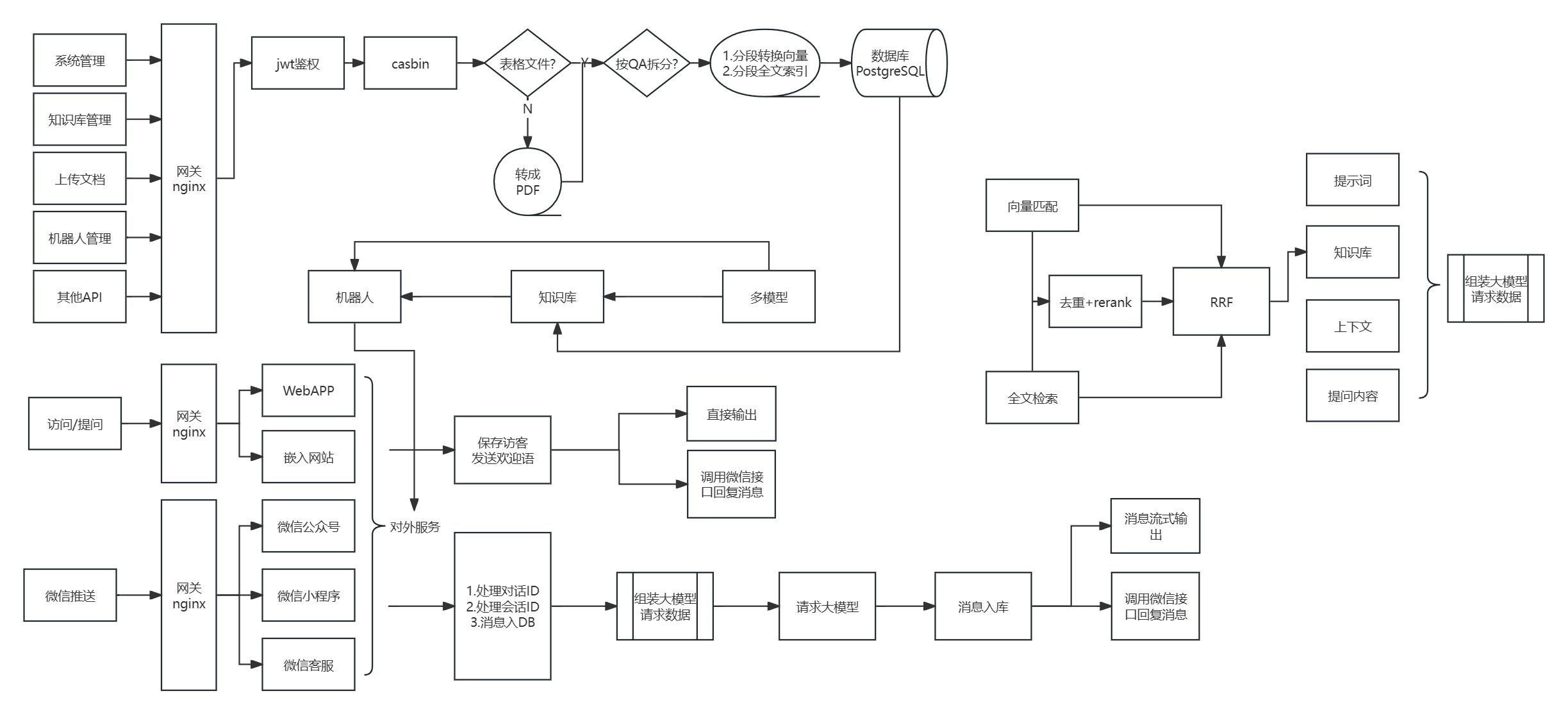

2.系统框架

3.技术栈

-

前端:vue.js

-

后端:golang +python

-

数据库:PostgreSQL16+pgvector+zhparser

-

缓存:redis5.0

-

web服务:nginx

-

异步队列:nsq

-

进程管理:supervisor

-

模型:支持OpenAI、Google Gemini、Claude3、通义千文、文心一言、讯飞星火、百川、腾讯混元等模型。

四、FastGPT

FastGPT是一个功能强大的平台,专注于知识库训练和自动化工作流程的编排。它提供了一个简单易用的可视化界面,支持自动数据预处理和基于Flow模块的工作流编排。FastGPT支持创建RAG系统,提供自动化工作流程等功能,使得构建和使用RAG系统变得简单,无需编写复杂代码。

官方链接:https://fastgpt.in/

Github:https://github.com/labring/FastGPT

1.功能优势

-

项目开源:FastGPT 遵循附加条件 Apache License 2.0 开源协议,你可以 Fork 之后进行二次开发和发布。FastGPT 社区版将保留核心功能,商业版仅在社区版基础上使用 API 的形式进行扩展,不影响学习使用。

-

独特的 QA 结构:针对客服问答场景设计的 QA 结构,提高在大量数据场景中的问答准确性。

-

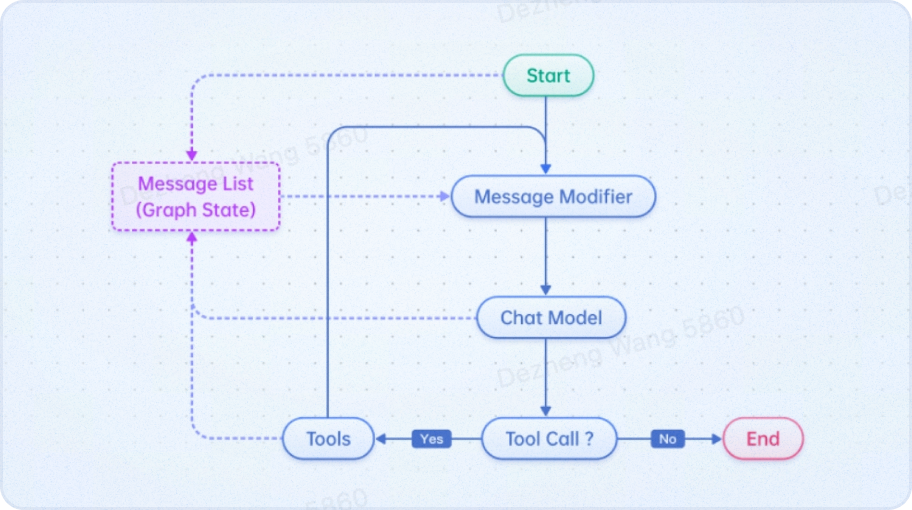

可视化工作流:通过 Flow 模块展示了从问题输入到模型输出的完整流程,便于调试和设计复杂流程。

-

无限扩展:基于 API 进行扩展,无需修改 FastGPT 源码,也可快速接入现有的程序中。

-

便于调试:提供搜索测试、引用修改、完整对话预览等多种调试途径。

-

支持多种模型:支持 GPT、Claude、文心一言等多种 LLM 模型,未来也将支持自定义的向量模型。

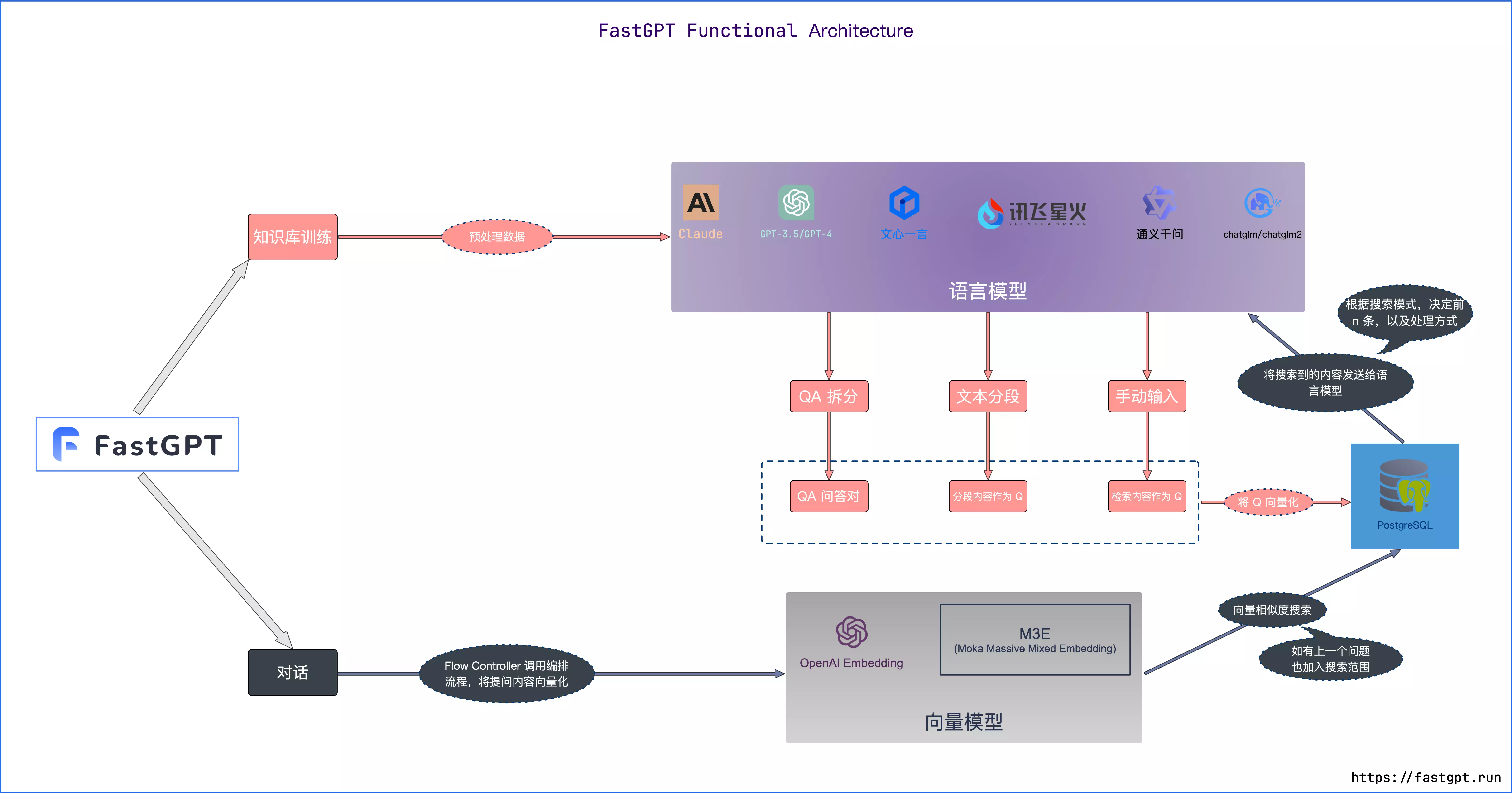

2.知识库核心流程图

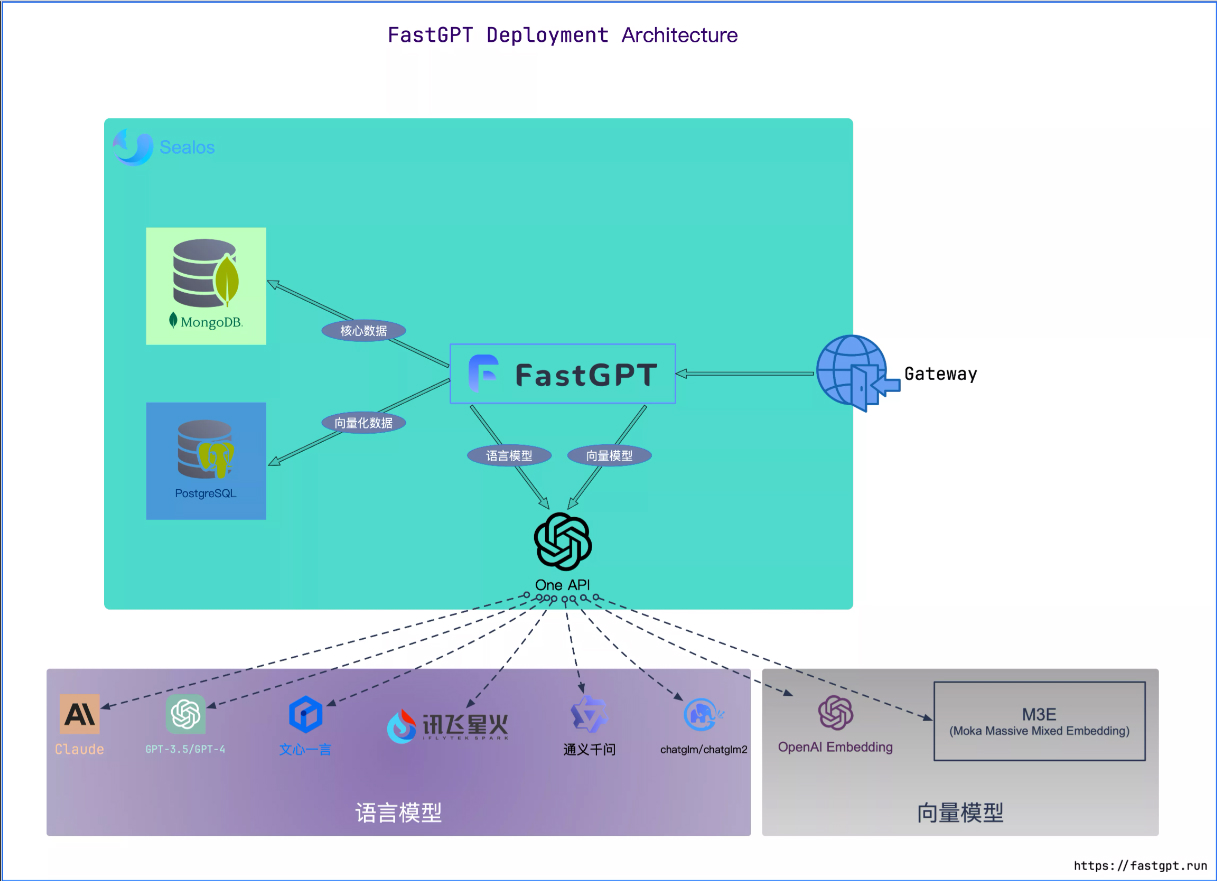

3.部署架构图

2086

2086

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?