Self-Attention ConvLSTM for Spatiotemporal Prediction

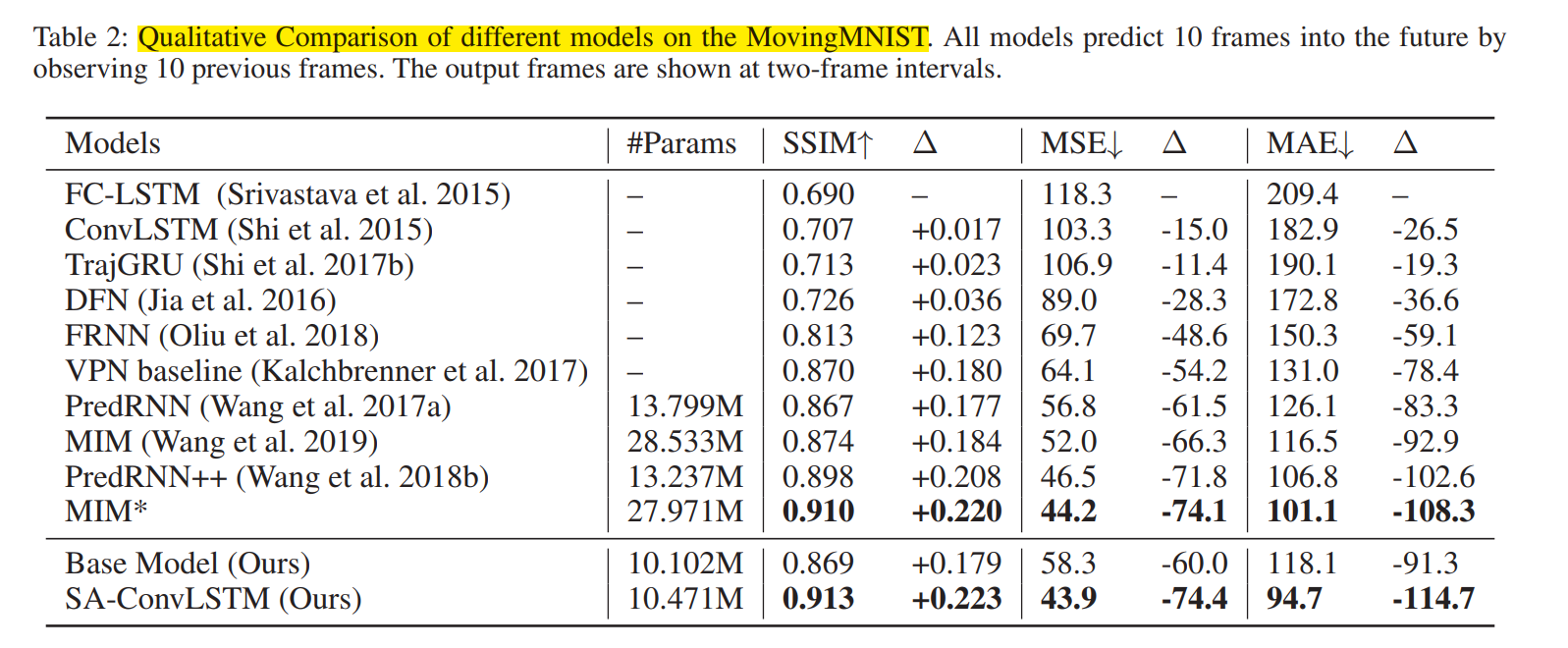

现有的工作集中于在标准的ConvLSTM中嵌入额外的单元来记忆预测过程中的空间表象。这些模型总是依赖于卷积层来获取空间相关性,这是局部的和低效的。然而,长程空间依赖性对空间应用意义重大。为了提取具有全局依赖和局部依赖的空间特征,我们在ConvLSTM中引入了自注意机制。提出了一种新的自我注意记忆(self-attention memory, SAM)方法,用于记忆具有长期空间和时间依赖性的特征。该方法基于自我注意,通过对相似度评分对输入本身和记忆特征的所有位置进行特征聚合,从而产生特征。此外,附加存储器通过对聚合特性和具有前一个时间步的存储器的已建立的门控机制来更新。因此,通过SAM,我们可以提取具有较长时空相关性的特征。此外,我们还将其嵌入到一个标准的ConvLSTM中,构建了一个用于时空预测的自注意ConvLSTM (SA-ConvLSTM)。在实验中,我们采用SA-ConvLSTM对MovingMNIST和KTH数据集进行帧预测,对TexiBJ数据集进行交通流预测。我们的SA-ConvLSTM在两个数据集上都获得了最先进的结果,与以前最先进的方法相比,参数更少,时间效率更高。

论文贡献:

1.我们提出了一种新的ConvLSTM变种,命名为SAConvLSTM来执行时空预测,它可以成功地捕获长期空间依赖性。

2.我们设计了一个基于记忆的自我注意模块(SAM)来记忆预测过程中的全局时空相关性

Methods

为了评估自我注意在时空预测中的有效性,我们通过将自我注意模块与标准ConvLSTM级联构建了一个基本的自我注意ConvLSTM模型。然后,在自我注意内存模块的基础上,构建了一个更先进、更复杂的模型SAConvLSTM

Self-Attention Memory Module

我们认为,对当前时间步长的预测可以受益于过去的相关特征。因此,我们通过构造一个带有自我注意机制的新内存单元M,提出了一个自我注意内存模块。我们使用所提出的记忆单元来表示一般的时空信息,它具有全局的时空感受野

Self-Attention ConvLSTM

我们把自我注意记忆模块嵌入构造SA-ConvLSTM

Experiments

1205

1205

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?