Section5.2: Smooth saddle-point representation of a non-smooth function

- Quite often the non-smoothness of a function f comes from a max operation.

5.2.1: Saddle point computation

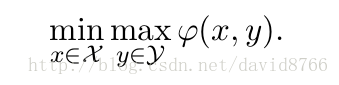

计算表达式;

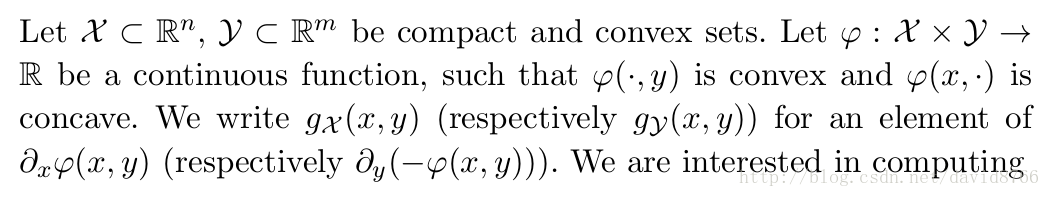

函数需满足条件:紧凑凸集,并且连续,f(.y) is convex and f(x.) is concave;

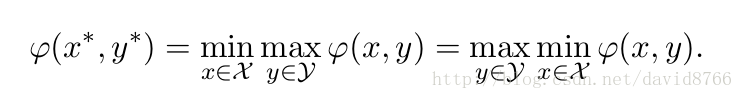

最优解为x*,y*,满足

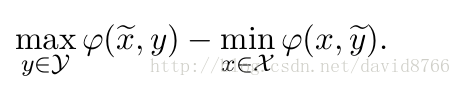

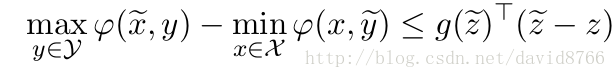

通过算法我们能得到一些列候选解x’,y’,通过duality gap来评价the quality of (x’,y’)

可以证明这个评价表达式也满足凸性

证明过程:

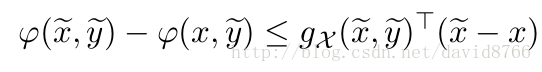

由函数的凸性:

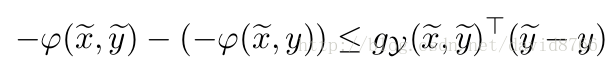

由函数的凹性:

两式相加得到前面的表达式总结:由于Saddle Point的最优解和候选解的评价表达式具有凸性,所以我们可以利用凸优化问题的一些方法来考虑有关Saddle Point的问题

5.2.2:Saddle Point Mirror Descent (SP-MD)

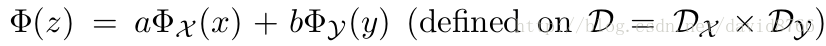

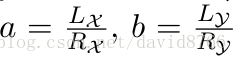

定义mirror map:

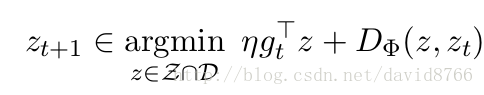

联系Mirror Descent概念得到迭代式

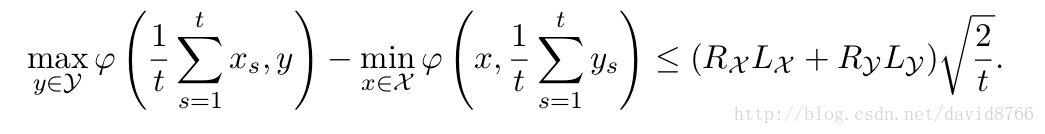

SP-MD的收敛性

证明详细见论文

5.2.3: Saddle Point Mirror Prox (SP-MP)

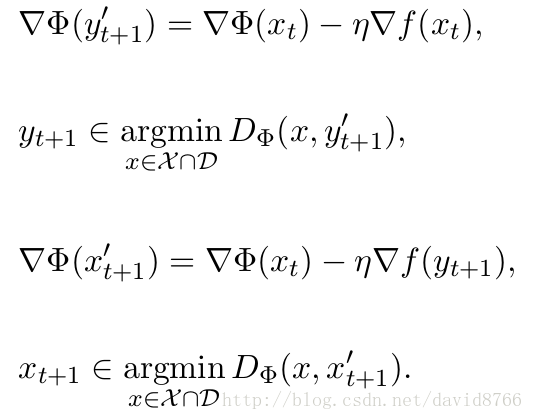

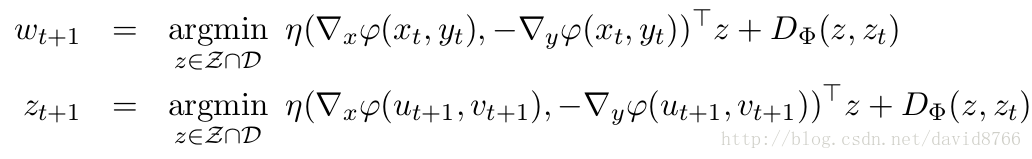

Mirror Prox的迭代式

联系Mirror Prox得到SP-MP的迭代式

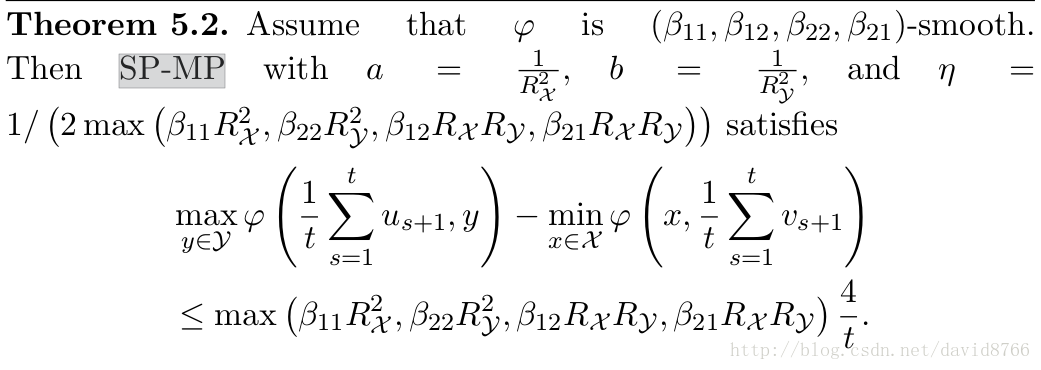

SP-MP的收敛性

证明详细见论文

5.2.4: Applications

- Three applications for SP-MD and SP-MP

8663

8663

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?