1.定义

根据查阅相关资料,知相对熵(relative entropy)又称为KL散度(Kullback–Leibler divergence,简称KLD),信息散度(information divergence),信息增益(information gain)。

KL散度是两个概率分布P和Q差别的非对称性的度量。

对一个离散随机变量的两个概率分布P和Q来说,他们的KL散度定义为:

对于连续的随机变量,定义为:

。

。

注:

(1)p(x) 和q(x)分别是pq两个随机变量的PDF,Dkl(P||Q)是一个数值,而不是一个函数

(2)KL散度并不满足距离的概念,应为:1)KL散度不是对称的;2)KL散度不满足三角不等式。

(3)P通常指数据集,我们已有的数据集,Q表示理论结果

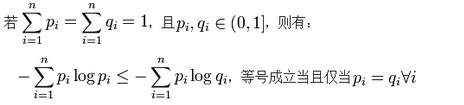

2.性质

(1)尽管KL散度从直观上是个度量或距离函数,但它并不是一个真正的度量或者距离,因为它不具有对称性,即D(P||Q) ≠ D(Q||P)

(2)相对熵的值为非负值,即Dkl(P||Q)≥0,只有 P(x)=Q(x) 几乎处处成立的时候,Dkl(P||Q)=0.

证明:利用 Jensen’s Inequality(直接用,证明略),可以得到。

所以,移项即可得到KL散度的证明。

本文详细介绍了KL散度(Kullback-Leibler divergence),它是一种衡量两个概率分布差异的非对称性度量。KL散度在信息论中用于评估使用基于Q的编码来编码来自P的样本所需额外的比特数。文章还探讨了其非对称性和非负性性质,并在用户画像和推荐系统中的应用。

本文详细介绍了KL散度(Kullback-Leibler divergence),它是一种衡量两个概率分布差异的非对称性度量。KL散度在信息论中用于评估使用基于Q的编码来编码来自P的样本所需额外的比特数。文章还探讨了其非对称性和非负性性质,并在用户画像和推荐系统中的应用。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

6577

6577

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?