针对市场上存在的小车和相关ROS-SLAM课程,笔者发现他们存在以下两个问题:

-

提供实体小车的商家,一般只会提供基础的课程和小车使用说明,缺少配套实战性、操作性均优的ROS-SLAM课程。

-

提供课程的商家往往没有配套的智能小车。让学员从0到1搭建出一辆小车,对于新手来说,通常是比较困难的,容易浪费时间。

针对上述缺点,3D视觉工坊联合主讲老师大兀开发了一款性能强、通用性好、配套实战课程的NanoBot A001智能小车。

通过该小车和配套课程,学员能够快速、系统、全面地学习ROS1和2D激光SLAM,快速入门SLAM和提升自身专业技能。

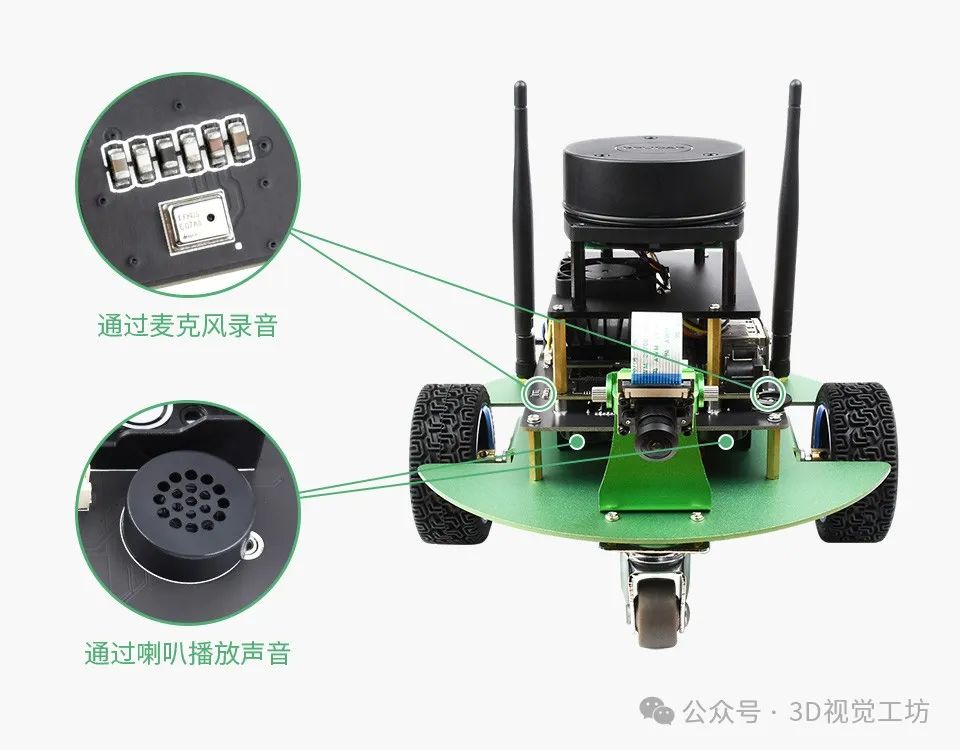

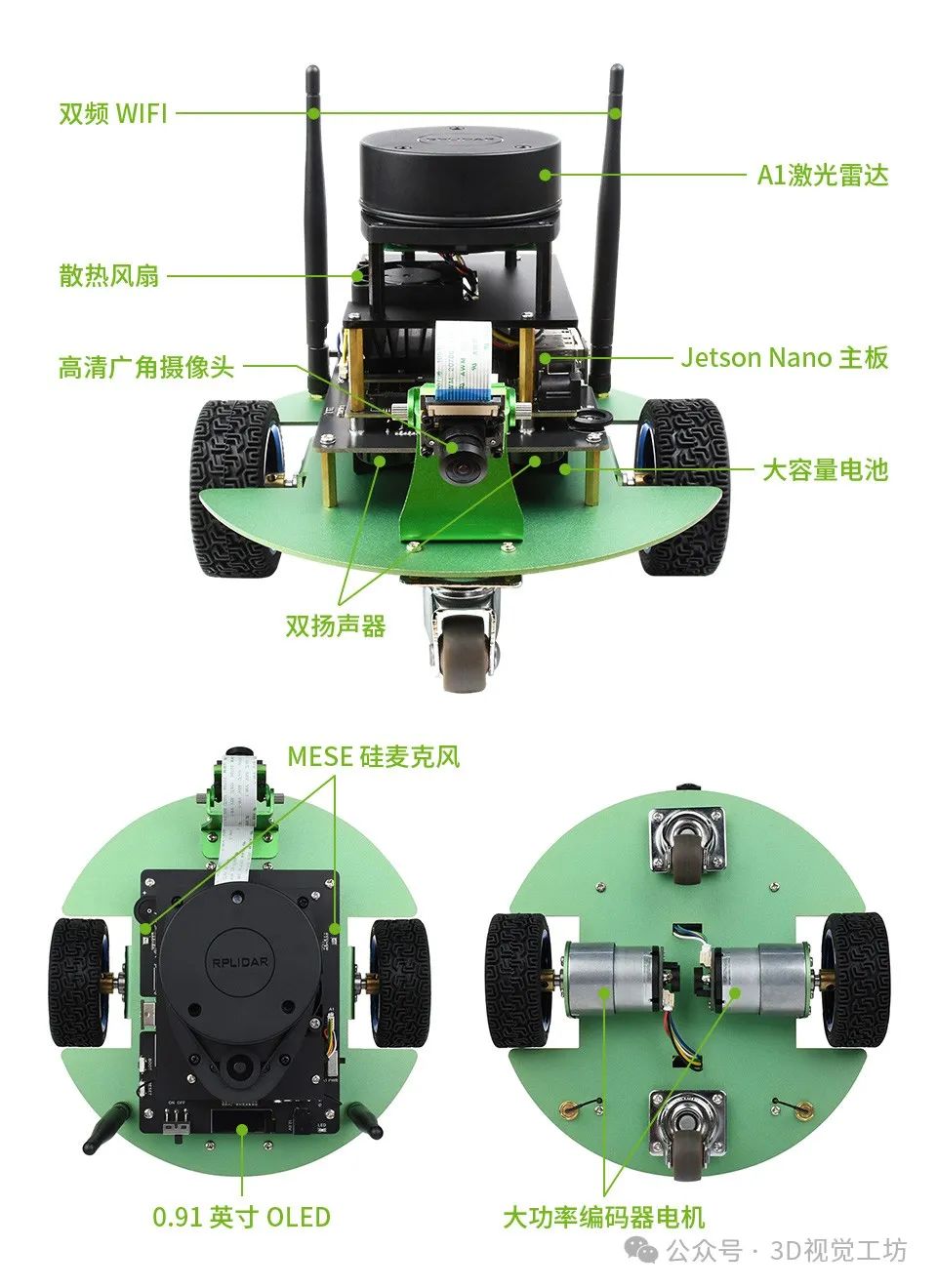

NanoBot A001智能小车实物图

ROS-SLAM两轮差速小车NanoBot A001

| NanoBot A001智能小车 | |

|---|---|

| 主控制器 | jetsonNano 4G版本 |

| 微控制器 | 树莓派主控 |

| 激光雷达 | 思岚A1 |

| 相机 | 160度镜头(CSI接口) |

| 音频 | 支持麦克风和喇叭 |

| 电机 | 高性能直流电机+高精度编码器 |

| 无线网络 | 双模无线网卡(双频wifi+蓝牙) |

| 其他配置 | 电池电压检测、1寸OLED显示屏等 |

NanoBot A001智能小车亮点在哪

1.用料扎实,选择主流、高性能的芯片、硬件等

2.支持功能丰富(详见下表)

3.课程配套完善,首期有完善的ROS和2D激光SLAM课程

4.通用性强,jetson nano主控板可拆卸复用在其它产品上。

NanoBot A001智能小车支持的功能

| NanoBot A001支持的功能 | |

|---|---|

| 功能点 | 功能介绍 |

| SLAM 激光雷达构建地图 | 支持轮式里程计,IMU,激光雷达等多传感器融合建图 |

| 路径规划 自主导航 动态避障 | 支持单、多点导航,路径规划,动态避障等 |

| 视觉处理 AI检测 | 支持AI目标检测,目标分割,物体追踪,目标测距等 |

| 视觉SLAM应用开发 | 支持视觉slam建图 |

| 音频应用开发 | 同时支持“听”、“说” |

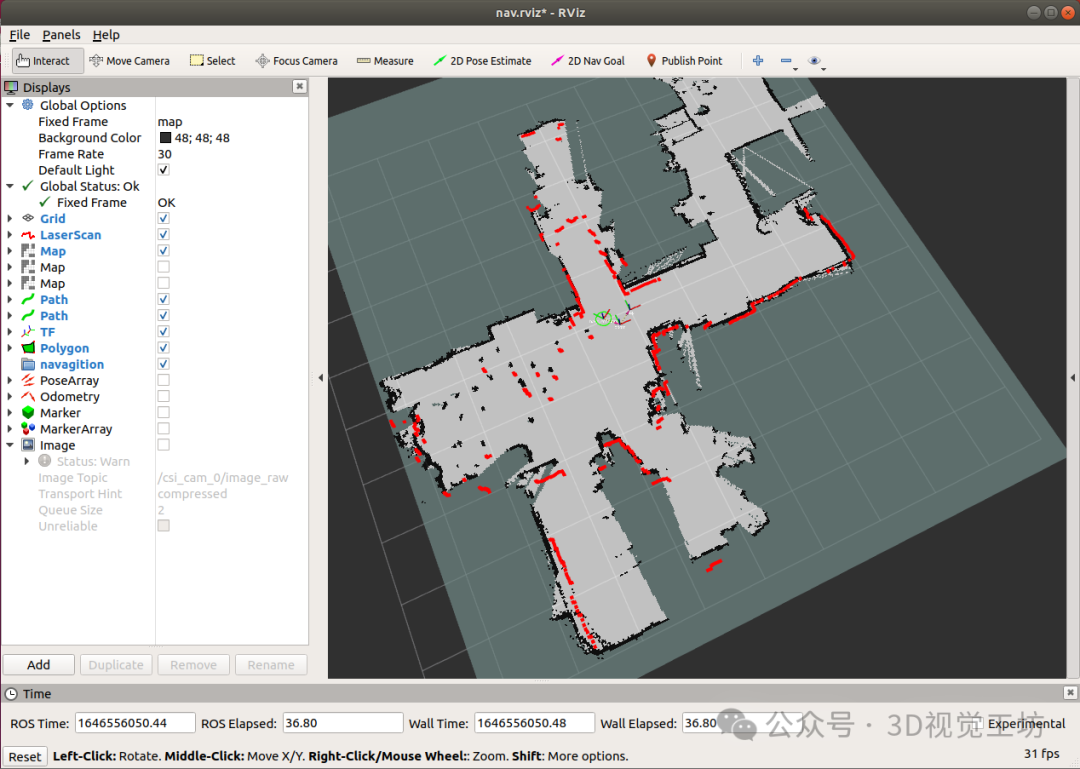

SLAM 激光雷达构建地图

支持轮式里程计,IMU,激光雷达等多传感器融合建图

如Gmapping, Hector, Karto, Cartographer等建图算法

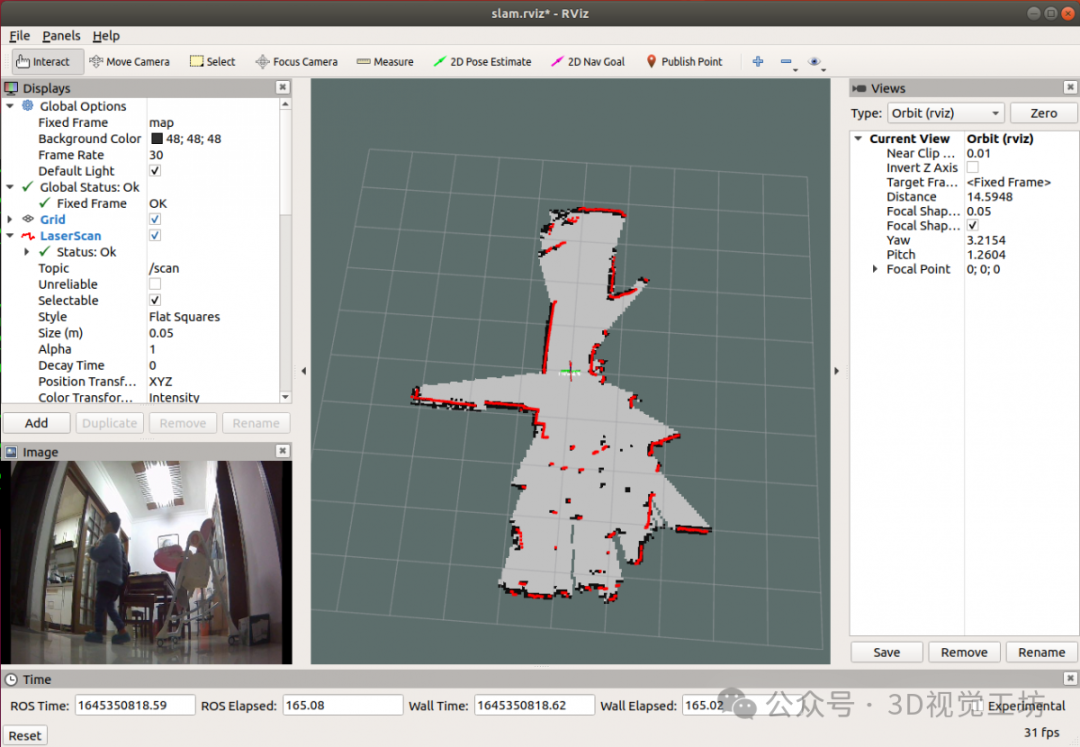

Gmapping算法建图效果

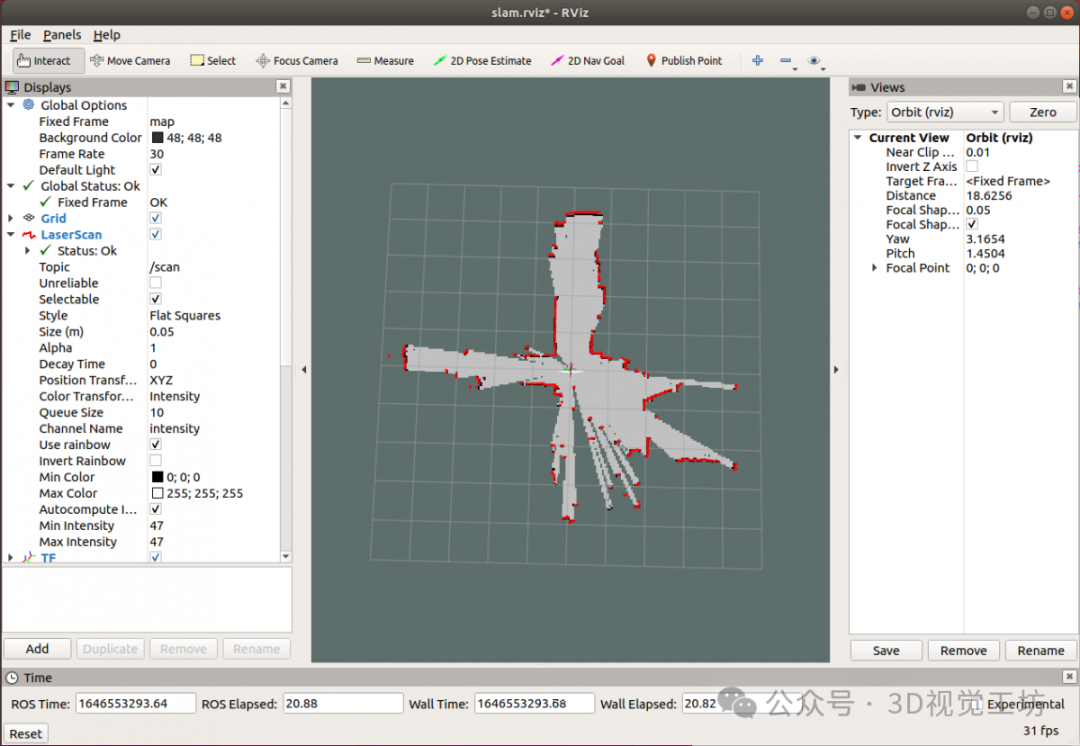

Hector算法建图效果

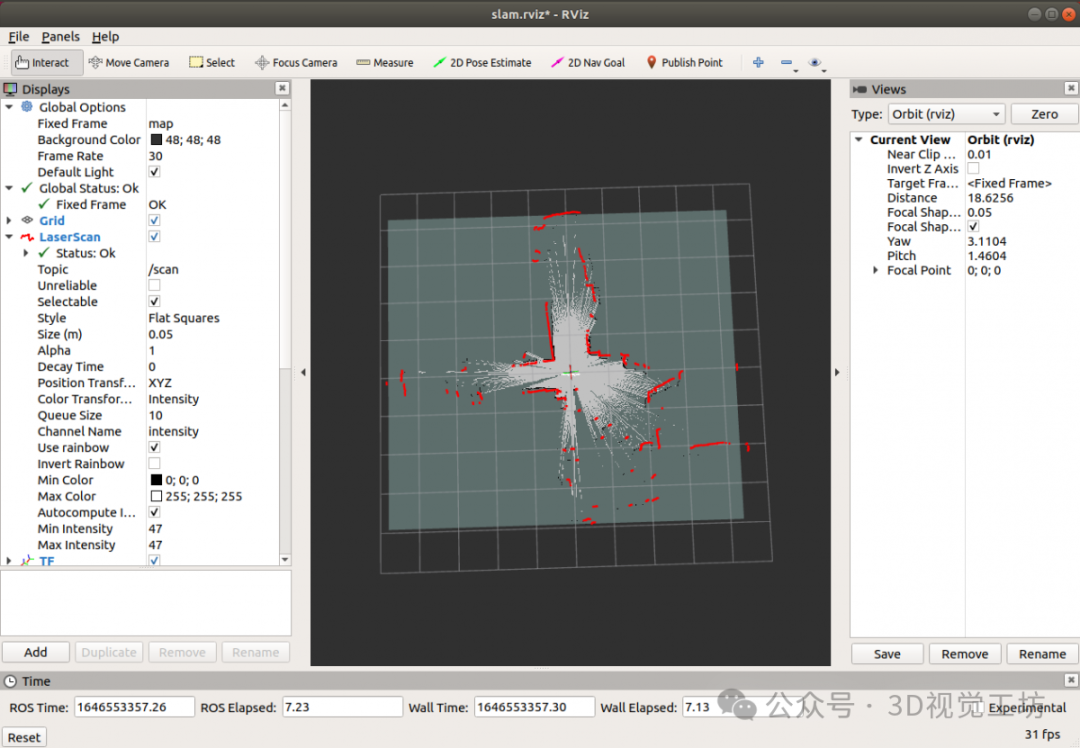

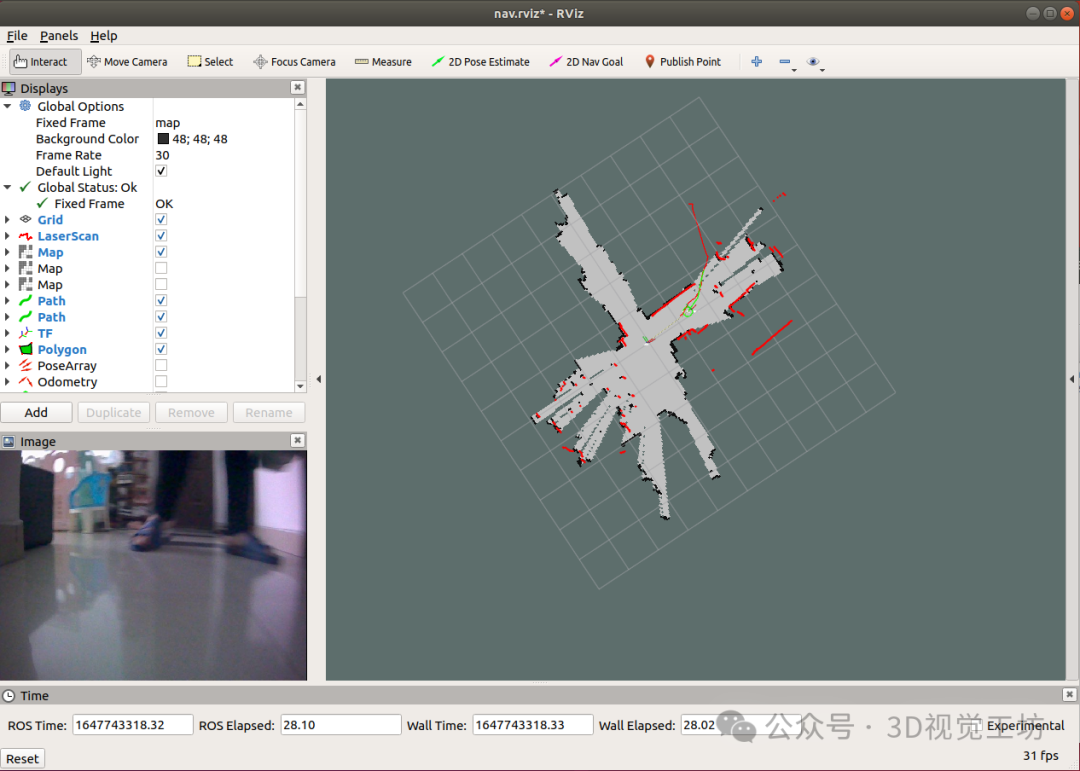

karto算法建图效果

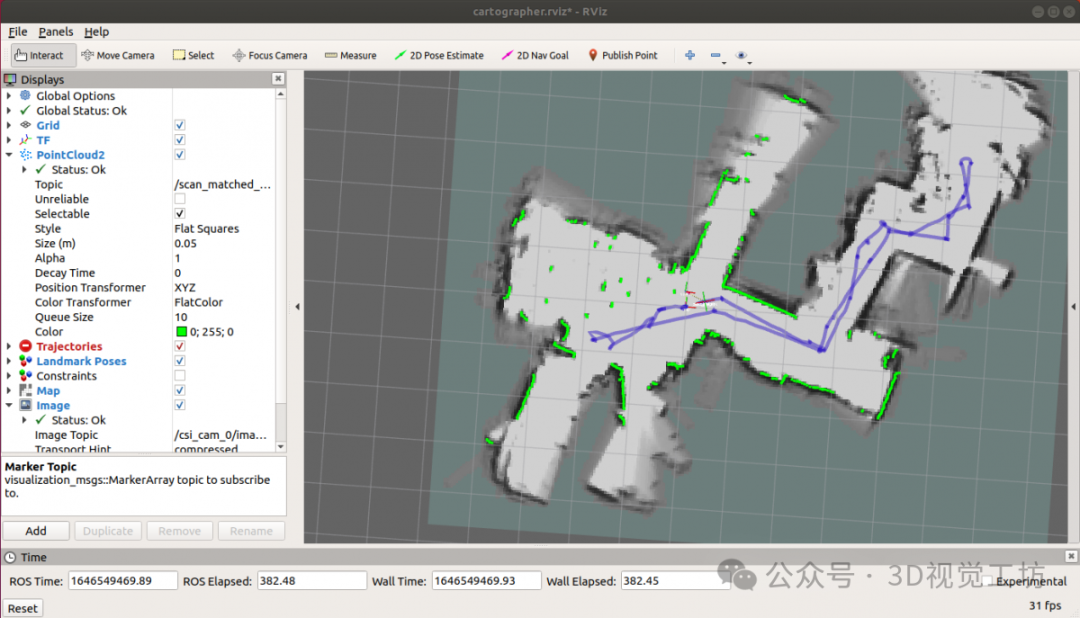

cartographer算法建图效果。图中绿色点为点云数据而非雷达数据,蓝色为小车运动路径

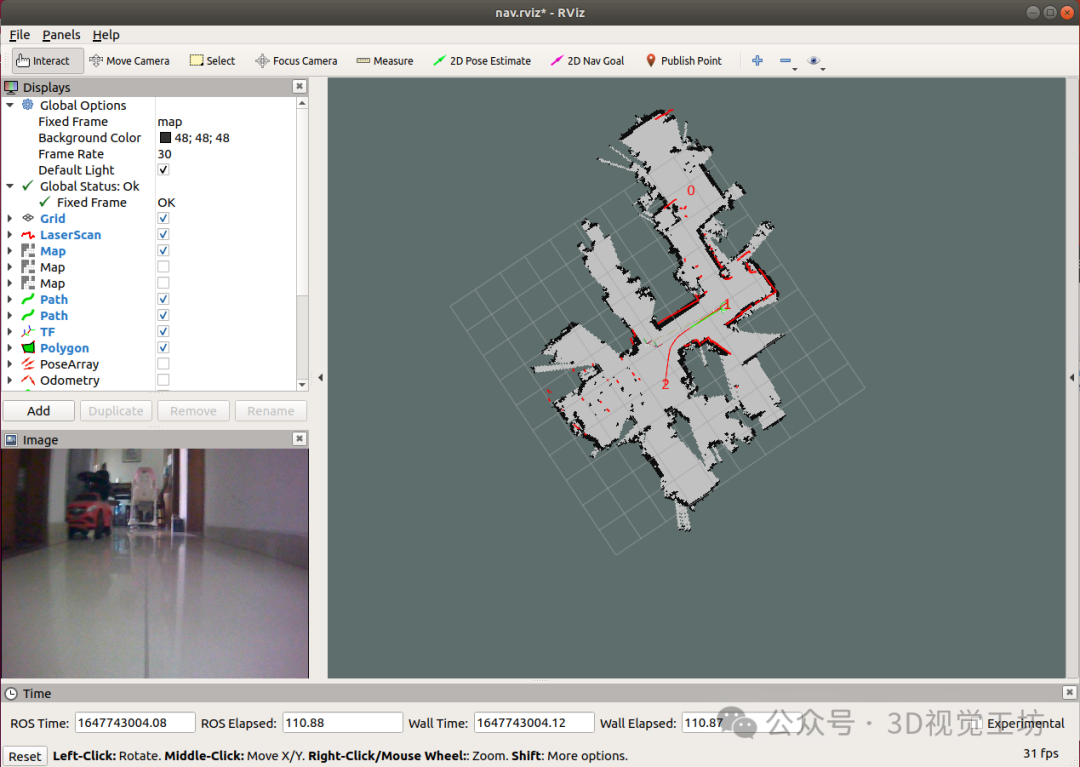

路径规划 自主导航 动态避障

AMCL自适应蒙特卡洛定位

支持单点导航,多点巡逻导航,边导航边建图

单点导航:发布导航目标位置,机器人将自动规划路径导航到目标位置

多点巡逻导航:添加导航点,机器人将在导航点之间巡航导航

边导航边建图:可以发布导航目标位置,机器人将自动探索路径导航到目标点,而且边扫描地图边发布

视觉处理AI检测

适合OpenCV视觉开发,AI目标检测,物体追踪,自动驾驶等AI功能

视觉SLAM应用开发

4G版jetson Nano支持开发视觉slam应用(3D视觉工坊官方示例开发中,尚未发布)。

音频应用开发

板载两个高质量 MEMS 硅麦克和双喇叭,支持立体声录音和立体声播放, 从此机器人也有了耳朵和嘴巴,能"听"会"道",轻松实现智能语音交互

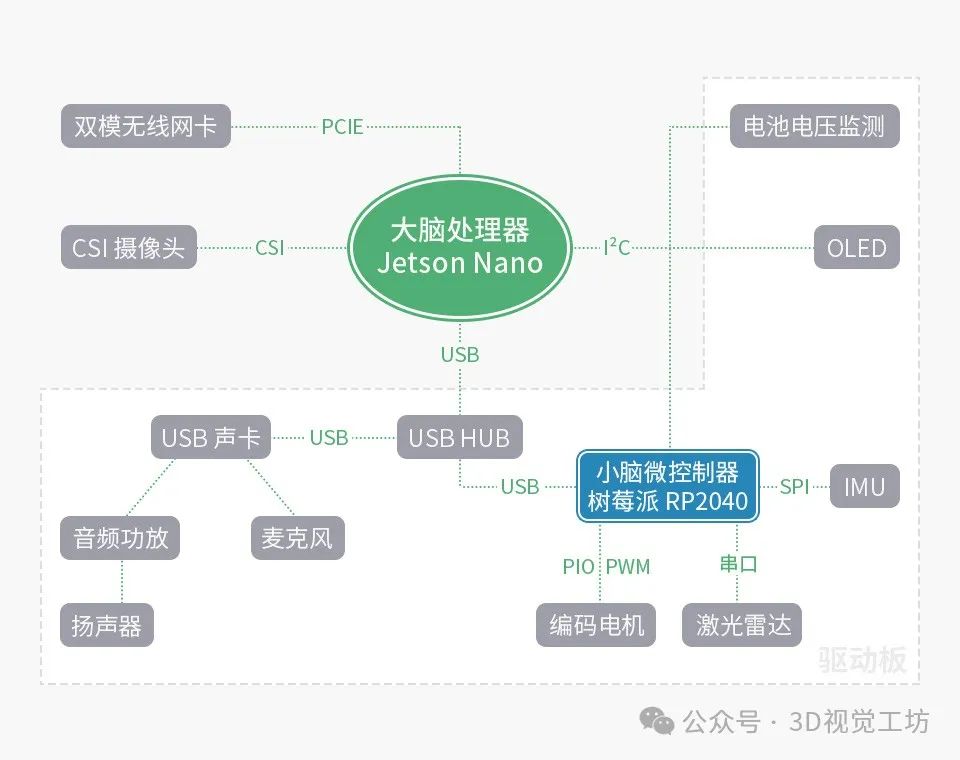

系统框图

产品结构解析

产品尺寸

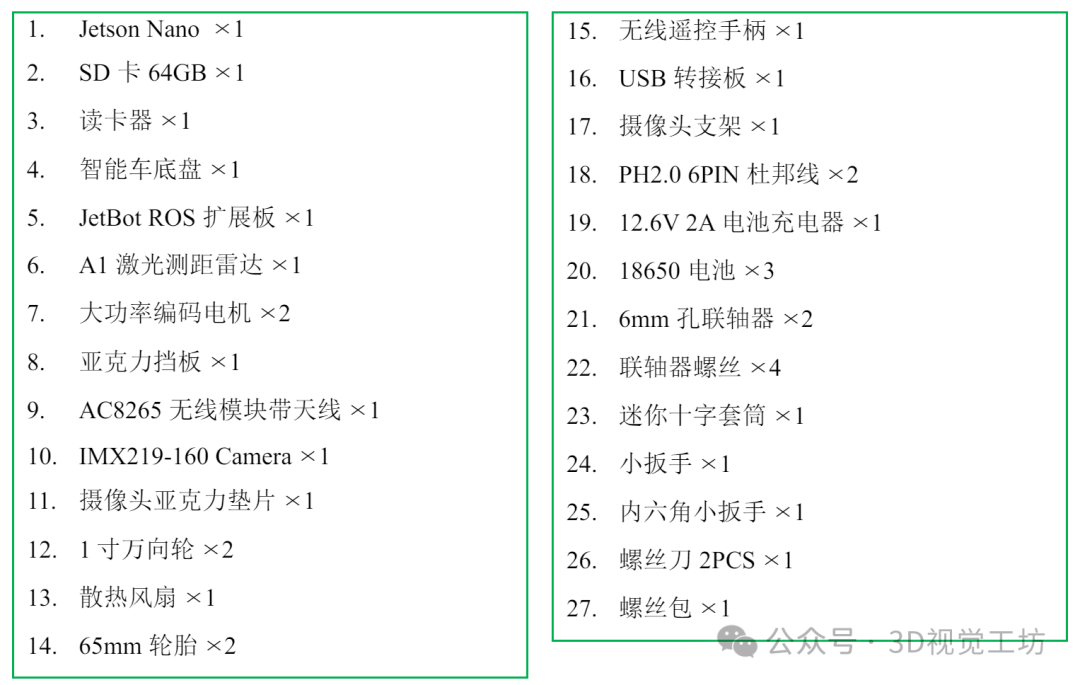

发货清单

配套课程

本硬件搭配视频课程为《零基础入门ROS-SLAM小车仿真与实践[理论+仿真+实战]视频课》,体验更佳。

学完课程,可以掌握哪些技能?

1.掌握ROS1基础的、核心的知识

2.看懂ROS1代码,会用C++编写ROS节点

3.掌握2D激光SLAM基础的、核心的知识

4.会用C++实现SLAM核心算法

5.会使用gazebo、rviz进行2d激光slam仿真

6.会使用C++编写一个2d激光slam简易仿真

7.对智能小车硬件和系统组成有直观认识和理解

8.在智能小车上修改和部署自己的算法和功能

购买硬件

扫码购买相关硬件

硬件咨询

扫码添加微信咨询相关硬件

651

651

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?