之前分享了 Ollama 这次分享一下 另一款本地运行大模型的工具LM Studio

什么是 LM Studio?

LM Studio 是一款用于在您的电脑上开发和实验LLMs的桌面应用程序。

关键功能

- 桌面应用程序,用于运行本地 LLMs

- 一个熟悉的聊天界面

- 搜索和下载功能(通过 Hugging Face 🤗)

- 一个可以监听类似 OpenAI 端点的本地服务器

- 本地模型和配置管理系统

系统要求

LM Studio 通常支持 Apple Silicon Macs、x64/ARM64 Windows PC 和 x64 Linux PC。

macOS

- 芯片:苹果硅(M1/M2/M3/M4)。

- macOS 13.4 或更高版本是必需的。

- 对于 MLX 模型,需要 macOS 14.0 或更高版本。

- 16GB+内存推荐。

- 您可能仍然可以在 8GB 的 Mac 上使用 LM Studio,但请坚持使用较小型号和适度的上下文大小。

- 英特尔 Mac 目前不支持。

Windows

LM Studio 支持 x64 和 ARM(Snapdragon X Elite)架构的系统。

- CPU:需要支持 AVX2 指令集(针对 x64)

- RAM: LLMs可能会消耗大量 RAM。建议至少 16GB 的 RAM。

Linux

- LM Studio for Linux 以 AppImage 的形式分发。

- Ubuntu 20.04 或更高版本是必需的

- 仅支持 x64,暂不支持 aarch64

- Ubuntu 版本高于 22 的版本测试不佳。

- CPU:中央处理器

- LM Studio 默认支持 AVX2

如何安装 LM Studio?

LM Studio 适用于 macOS、Windows 和 Linux。

前往下载页面并下载适用于您的操作系统的安装程序。

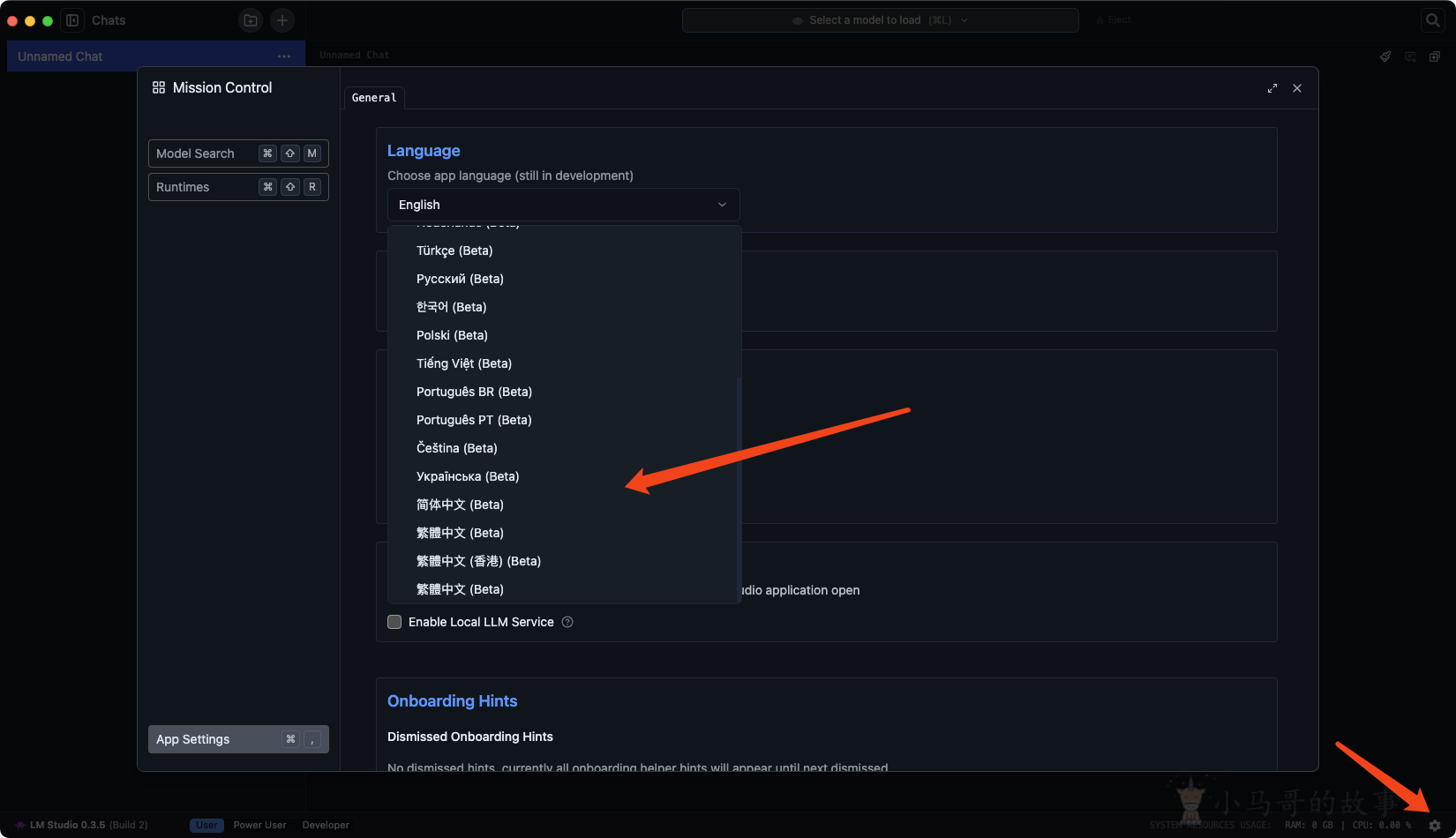

设置中文

右下角设置

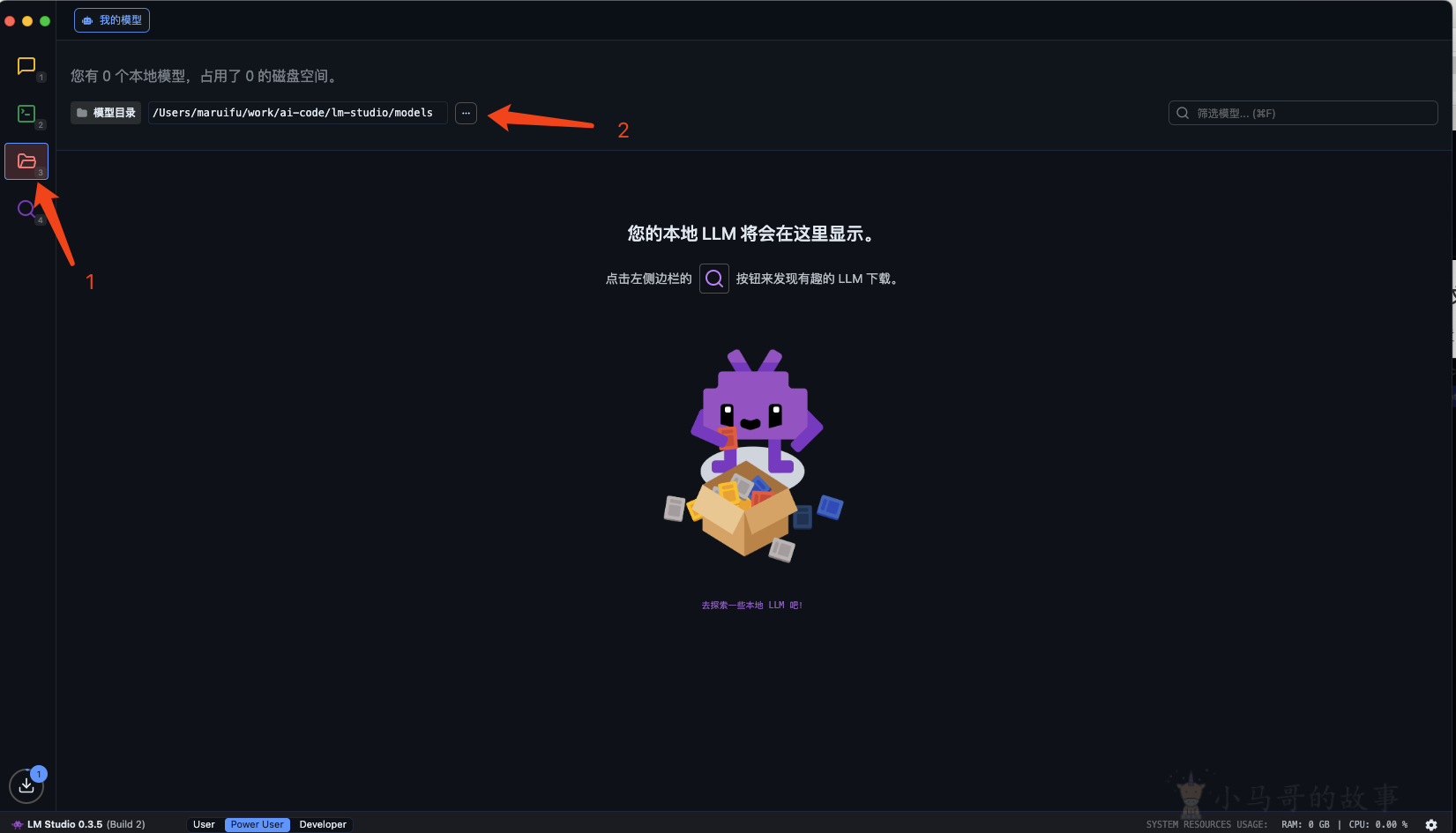

设置模型目录

模型目录最好不要有中文特殊符号,最好是英文字母

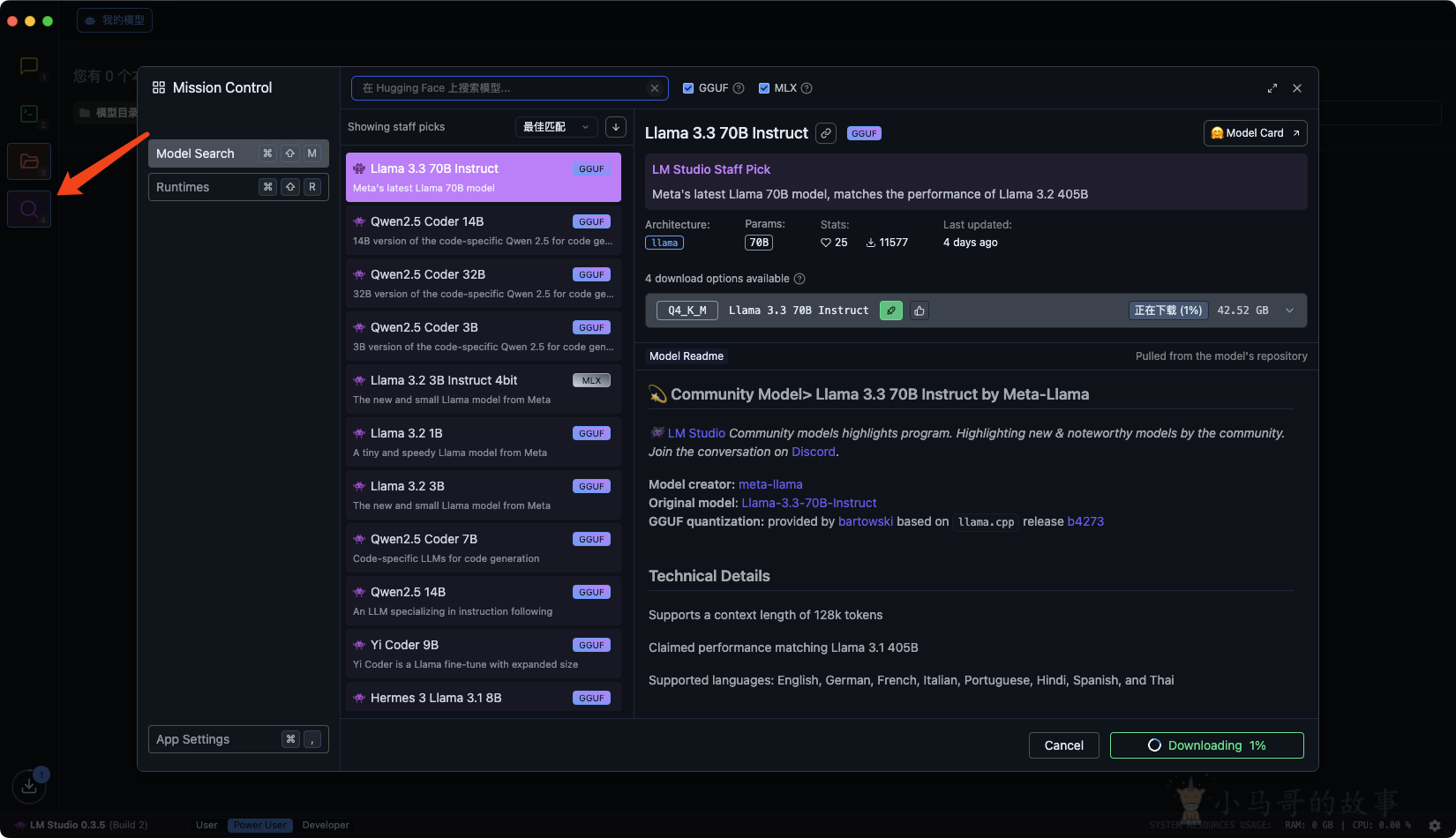

下载模型

如果可以访问国外网站

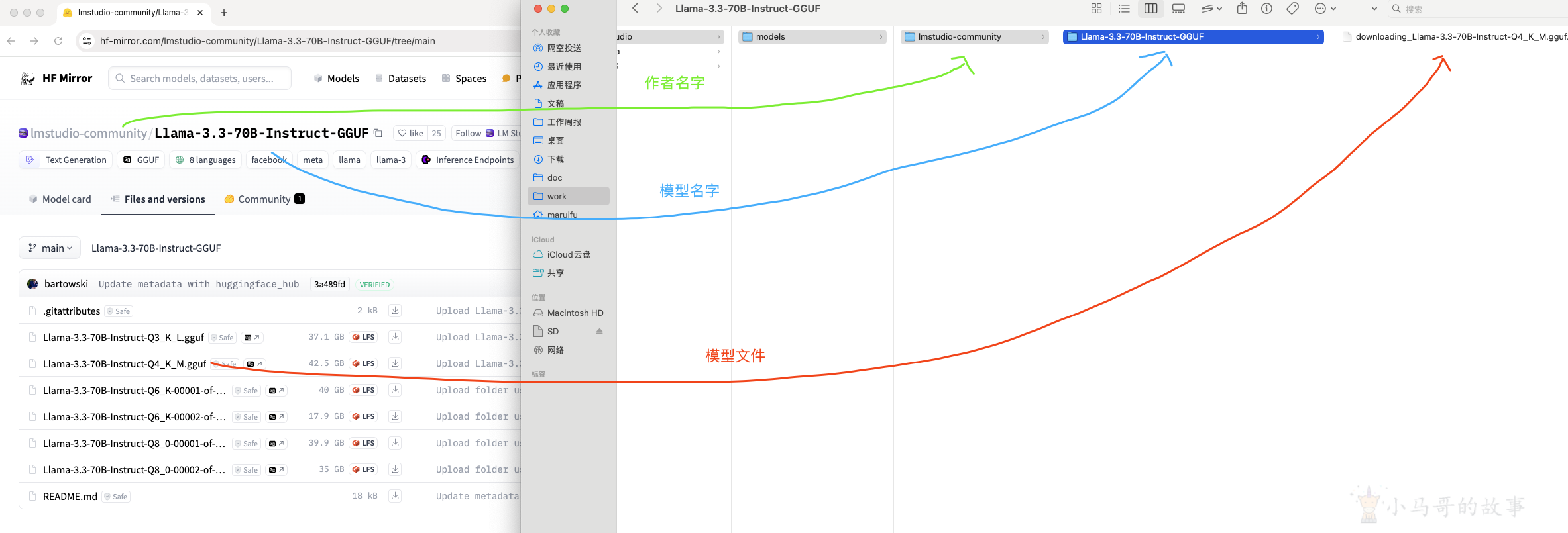

镜像网站下载

https://hf-mirror.com/

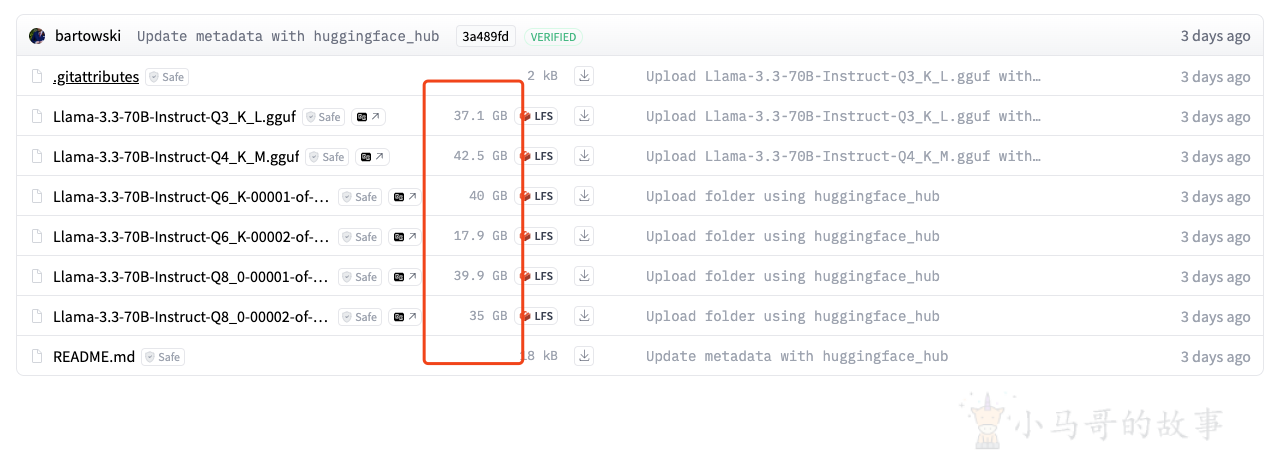

下载gguf模型放到前面设置的模型目录里面

模型挑选

模型文件大小小于自己显存大小,但接近显存大小的效果肯定越好

GGUF模型

GGUF,全称 GPT-Generated Unified Format,是一种新型的文件格式专门用于存储和交换大型机器学习模型的数据。这种格式针对模型的快速加载和保存进行了优化,使其在推理方面更加高效。GGUF可以有多重不同版本的量化,Q2、Q3、Q4、Q5、Q6、Q8,这些数字表示模型权重的位数,位数越高,模型的精度通常越高,但所需的存储空间和计算资源也越多。

不是所有 gguf 格式的模都能用 LM Studio 运行,你可以打开下面这个链接,这里所有模型都可以用LM Studio 运行:https://hf-mirror.com/lmstudio-community *量化是指将模型中的高精度数字转换为低精度数字,以减少模型的存储空间和计算需求。

如何系统的去学习大模型LLM ?

大模型时代,火爆出圈的LLM大模型让程序员们开始重新评估自己的本领。 “AI会取代那些行业?”“谁的饭碗又将不保了?”等问题热议不断。

事实上,抢你饭碗的不是AI,而是会利用AI的人。

继科大讯飞、阿里、华为等巨头公司发布AI产品后,很多中小企业也陆续进场!超高年薪,挖掘AI大模型人才! 如今大厂老板们,也更倾向于会AI的人,普通程序员,还有应对的机会吗?

与其焦虑……

不如成为「掌握AI工具的技术人」,毕竟AI时代,谁先尝试,谁就能占得先机!

但是LLM相关的内容很多,现在网上的老课程老教材关于LLM又太少。所以现在小白入门就只能靠自学,学习成本和门槛很高。

针对所有自学遇到困难的同学们,我帮大家系统梳理大模型学习脉络,将这份 LLM大模型资料 分享出来:包括LLM大模型书籍、640套大模型行业报告、LLM大模型学习视频、LLM大模型学习路线、开源大模型学习教程等, 😝有需要的小伙伴,可以 扫描下方二维码领取🆓↓↓↓

一、LLM大模型经典书籍

AI大模型已经成为了当今科技领域的一大热点,那以下这些大模型书籍就是非常不错的学习资源。

二、640套LLM大模型报告合集

这套包含640份报告的合集,涵盖了大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。(几乎涵盖所有行业)

三、LLM大模型系列视频教程

四、LLM大模型开源教程(LLaLA/Meta/chatglm/chatgpt)

LLM大模型学习路线 ↓

阶段1:AI大模型时代的基础理解

-

目标:了解AI大模型的基本概念、发展历程和核心原理。

-

内容:

- L1.1 人工智能简述与大模型起源

- L1.2 大模型与通用人工智能

- L1.3 GPT模型的发展历程

- L1.4 模型工程

- L1.4.1 知识大模型

- L1.4.2 生产大模型

- L1.4.3 模型工程方法论

- L1.4.4 模型工程实践

- L1.5 GPT应用案例

阶段2:AI大模型API应用开发工程

-

目标:掌握AI大模型API的使用和开发,以及相关的编程技能。

-

内容:

- L2.1 API接口

- L2.1.1 OpenAI API接口

- L2.1.2 Python接口接入

- L2.1.3 BOT工具类框架

- L2.1.4 代码示例

- L2.2 Prompt框架

- L2.3 流水线工程

- L2.4 总结与展望

阶段3:AI大模型应用架构实践

-

目标:深入理解AI大模型的应用架构,并能够进行私有化部署。

-

内容:

- L3.1 Agent模型框架

- L3.2 MetaGPT

- L3.3 ChatGLM

- L3.4 LLAMA

- L3.5 其他大模型介绍

阶段4:AI大模型私有化部署

-

目标:掌握多种AI大模型的私有化部署,包括多模态和特定领域模型。

-

内容:

- L4.1 模型私有化部署概述

- L4.2 模型私有化部署的关键技术

- L4.3 模型私有化部署的实施步骤

- L4.4 模型私有化部署的应用场景

这份 LLM大模型资料 包括LLM大模型书籍、640套大模型行业报告、LLM大模型学习视频、LLM大模型学习路线、开源大模型学习教程等, 😝有需要的小伙伴,可以 扫描下方二维码领取🆓↓↓↓

1027

1027

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?