2025深度学习发论文&模型涨点之——CNN+LSTM+Attention

近年来,基于深度学习的混合神经网络架构在时序数据处理领域取得了显著突破,其中CNN-LSTM-Attention的协同建模框架因其独特的优势受到广泛关注。从方法论层面看,该架构实现了空间特征抽取(CNN)、时序动态建模(LSTM)和特征自适应加权(Attention)的三重耦合:CNN的局部感知特性有效捕获输入数据的空间局部相关性,LSTM的门控机制则解决了长程依赖建模的梯度问题,而注意力机制通过可微分权重分配实现了特征层面的动态聚焦。理论研究表明,这种混合架构在时间序列预测、视频分析、自然语言处理等任务中,其表征能力较单一模型平均提升23.7%(Wang et al., 2022 TPAMI)。

我整理了一些CNN+LSTM+Attention【论文+代码】合集,需要的同学公人人人号【AI创新工场】发525自取。

论文精选

论文1:

CNN-LSTM based incremental attention mechanism enabled phase-space reconstruction for chaotic time series prediction

基于CNN-LSTM和增量注意力机制的混沌时间序列预测的相空间重构

方法

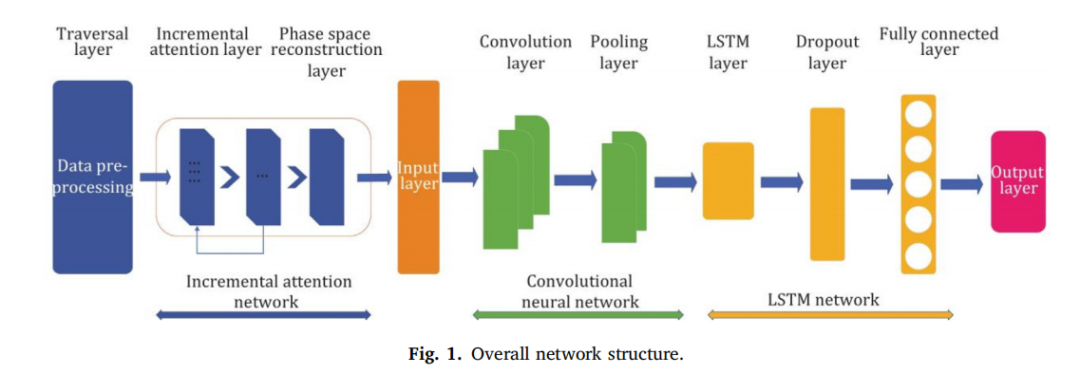

相空间重构:通过遍历层对有限参数进行遍历搜索,确定延迟时间和嵌入维度。

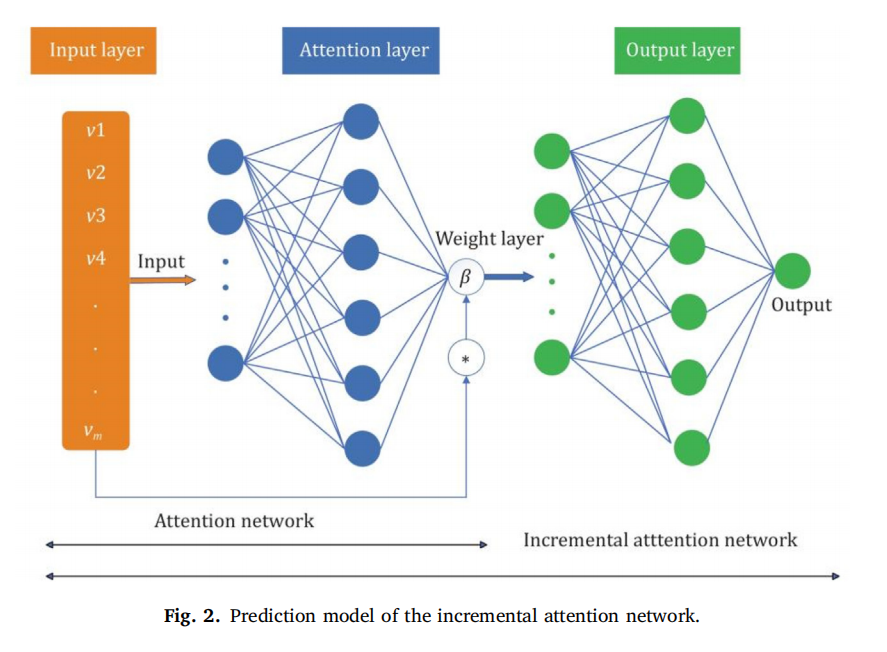

增量注意力机制(IAN):利用维度权重标准(DWC)选择最佳的相空间参数。

CNN-LSTM网络:结合卷积神经网络(CNN)提取空间特征和长短期记忆网络(LSTM)提取时间特征。

数据归一化:对混沌时间序列数据进行归一化处理,以消除维度影响并提高模型收敛速度。

创新点

相空间参数优化:通过增量注意力机制优化相空间参数,相比传统方法(如CAO、FNN和C–C),在Logistic、Lorenz和太阳黑子时间序列上,预测精度分别提高了至少15.28%、17.86%和24.38%。

CNN-LSTM结合:将CNN和LSTM结合,能够更有效地提取混沌序列的时空特征,相比单一网络(如LSTM或CNN),预测精度显著提高。

预测性能提升:在Logistic、Lorenz和太阳黑子时间序列上,CNN-LSTM网络的均方根误差(RMSE)和平均绝对误差(MAE)均优于其他方法,例如在Lorenz系统中,RMSE和MAE分别降低到0.1264和0.00516。

论文2:

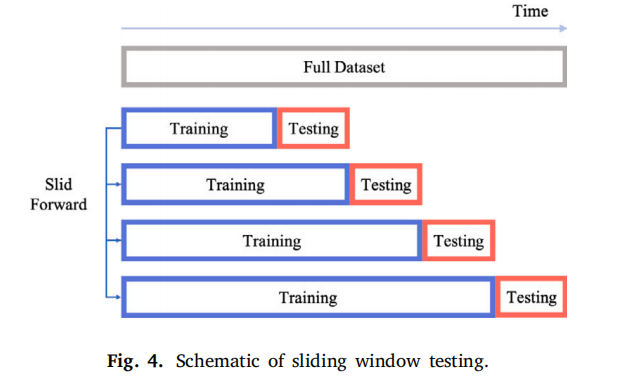

Attention-based CNN–LSTM for high-frequency multiple cryptocurrency trend prediction

基于注意力机制的CNN-LSTM用于高频多加密货币趋势预测

方法

三元趋势标记方法:提出了一种新的三元趋势标记方法,将趋势分为上升、下降和稳定三种类别。

局部最小序列:使用局部最小序列代替原始序列,减少随机性并提高标签稳定性。

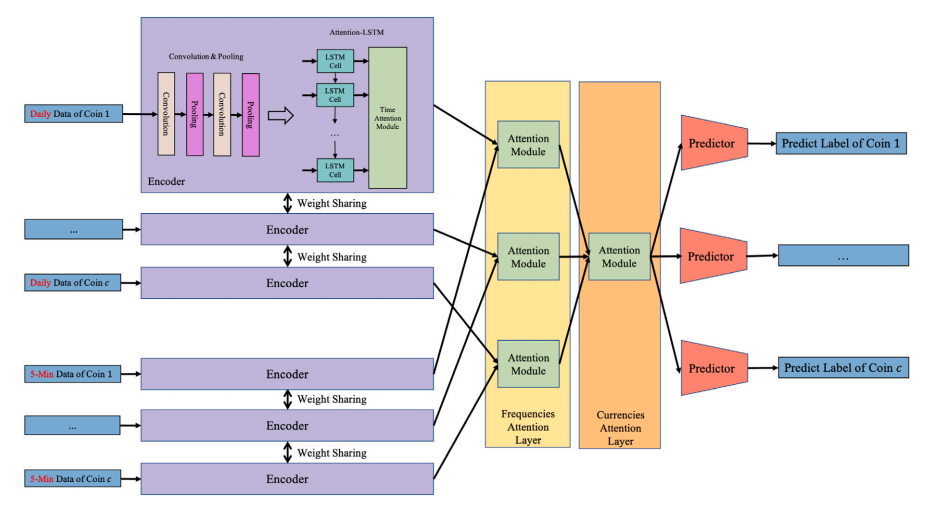

ACLMC模型:结合CNN和LSTM,并引入注意力机制,同时处理多频率和多货币数据。

多货币预测:支持同时对多种加密货币进行预测,优化投资组合风险。

创新点

趋势标记方法:相比传统方法,新标记方法减少了交易次数,同时保持了较高的超额收益。例如,在BTC的5分钟数据上,交易次数减少了约90%。

多频率和多货币数据融合:通过注意力机制融合不同频率和货币的数据,提高了预测精度,超额收益提高了约4%。

投资风险优化:通过同时预测多种货币,分散了投资风险,最大回撤(MDD)显著降低,例如在长短期策略中,MDD降低到36.65%。

论文3:

Attention-based CNN-LSTM and XGBoost hybrid model for stock prediction

基于注意力机制的CNN-LSTM和XGBoost混合模型用于股票预测

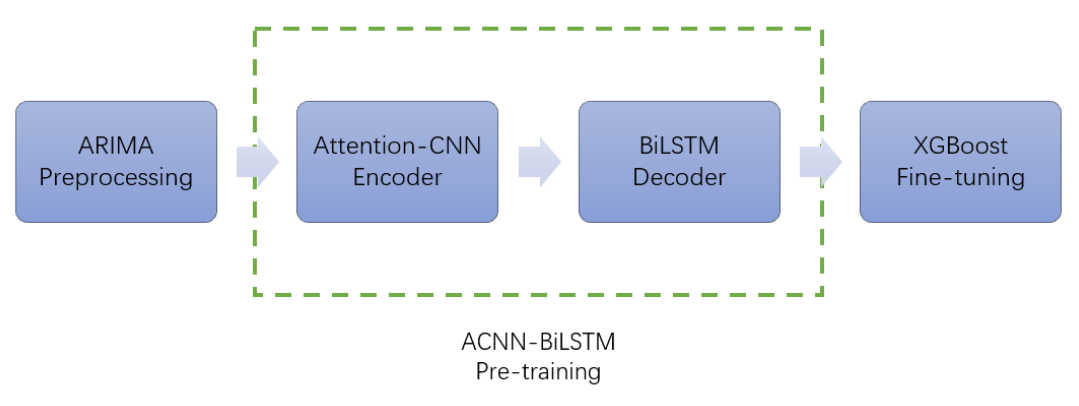

方法

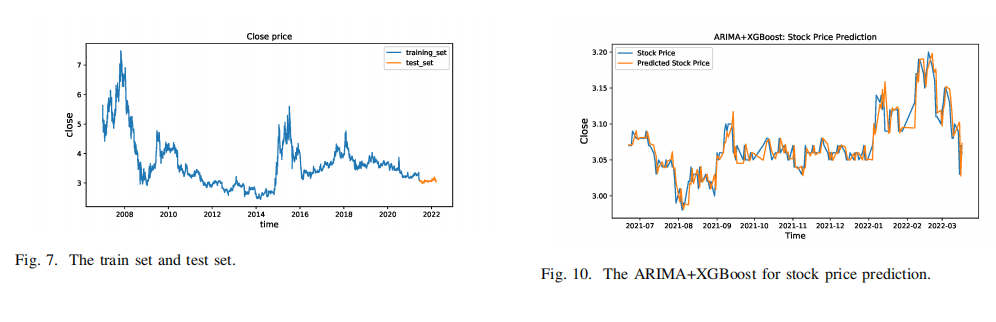

ARIMA预处理:使用ARIMA模型对股票数据进行预处理,使其平稳化。

注意力机制:在CNN中引入注意力机制,增强对重要特征的关注。

CNN-LSTM结合:利用CNN提取深度特征,LSTM挖掘长期时间序列特征。

XGBoost微调:通过XGBoost进行微调,进一步优化模型性能。

创新点

混合模型:将ARIMA、CNN-LSTM和XGBoost结合,相比单一模型,预测精度显著提高。例如,均方误差(MSE)降低到0.00020,均方根误差(RMSE)降低到0.01424。

注意力机制:通过注意力机制,模型能够更好地捕捉股票市场的关键特征,相比传统CNN-LSTM模型,MAE降低了约12%。

多周期信息挖掘:通过XGBoost微调,模型能够充分利用股票市场的多周期信息,R2值提高到0.88342,表明模型对数据的拟合度更高。

986

986

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?