卷积神经网络(CNN)是深度学习领域中应用广泛的神经网络架构,特别适用于图像识别和计算机视觉任务。在CNN的核心中,有一个重要组件称为全连接层,它在网络的顶部扮演着关键的角色。

一、CNN的基本结构

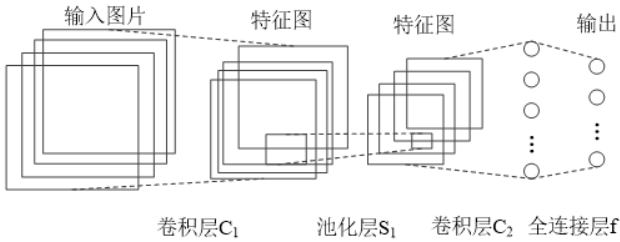

在介绍全连接层之前,让我们简要回顾一下CNN的基本结构。CNN通常由多个层组成,包括卷积层、池化层和全连接层。这些层一起构成了一个层次化的特征提取和分类网络。

-

卷积层(Convolutional Layers):卷积层是CNN的核心。它使用卷积核(也称为过滤器)来提取输入数据中的特征,例如图像中的边缘、纹理等。卷积操作有助于减少参数数量,从而提高网络的计算效率和泛化能力。

-

池化层(Pooling Layers):池化层用于降低卷积层输出的空间分辨率,同时保留关键信息。常见的池化操作包括最大池化和平均池化。

-

全连接层(Fully Connected Layers):全连接层位于CNN的顶部,通常用于分类任务。这是我们将要深入探讨的层级。

二、全连接层的原理

全连接层的原理非常简单,它与前一层的每个神经元都有连接,以及与后一层的每个神经元都有连接,创建了一个密集的连接结构。这意味着每个神经元都与整个相邻层的神经元相连接。这些连接由权重(weights)和偏置(bias)参数控制。

-

权重(weights):每个连接都有一个相关联的权重,用于表示连接的强度。权重决定了前一层神经元的输出如何影响后一层神经元的输入。权重是在训练过程中学习的,以最小化网络的损失函数。

-

偏置(bias):每个后一层神经元都有一个偏置项,用于调整神经元的激活。偏置的作用是使神经元对某些输入更容易激活。类似于权重,偏置也是在训练过程中学习的。

三、全连接层的作用

全连接层的主要作用是将卷积和池化层的输出转换为最终的分类或回归结果。它通过在网络的最后一层引入全连接操作,将之前层级提取的特征映射转化为类别概率或数值预测。

具体来说,全连接层执行以下功能:

-

特征整合:卷积神经网络(CNN)的前面层级,包括卷积层和池化层,负责提取输入数据的各种特征。全连接层将这些特征整合在一起,将它们结合成更高级别的表示,以便网络能够进行更复杂的决策和分类。

-

分类决策:全连接层通常位于神经网络的顶部,它将整合后的特征传递给激活函数,然后生成每个类别的得分或概率。对于分类任务,通常使用softmax函数来将这些得分转化为类别概率,从而决定输入数据属于哪个类别。

-

参数学习:全连接层包含大量的可学习参数,这些参数在训练过程中通过反向传播和梯度下降来调整。这使得网络能够适应训练数据并进行准确的预测。通过学习适当的权重和偏置,网络能够进行特定任务的学习和泛化。

-

非线性建模:全连接层中通常包含激活函数,如ReLU(Rectified Linear Unit),用于引入非线性性质。这是神经网络具有强大表示能力的一个重要因素,允许它们学习复杂的数据关系。

四、防止过拟合

全连接层的参数数量通常很大,这可能导致过拟合问题,特别是在数据集相对较小的情况下。为了应对这个问题,研究人员常常采用以下策略:

-

正则化:通过添加L1或L2正则化项来惩罚权重的大小,以减小模型的复杂性。

-

丢弃(Dropout):丢弃是一种正则化技术,随机关闭一部分神经元,以防止它们过于依赖特定的输入。

-

批标准化(Batch Normalization):批标准化有助于加速训练过程并提高网络的稳定性,通常应用于全连接层之前的层级。

五、总结

全连接层是卷积神经网络中的关键组件,它将前面层级提取的特征映射整合成最终的分类或回归结果。通过合适的正则化和优化技巧,我们可以更好地应对全连接层的参数量大和过拟合的挑战,从而构建更强大的CNN模型。

1029

1029

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?