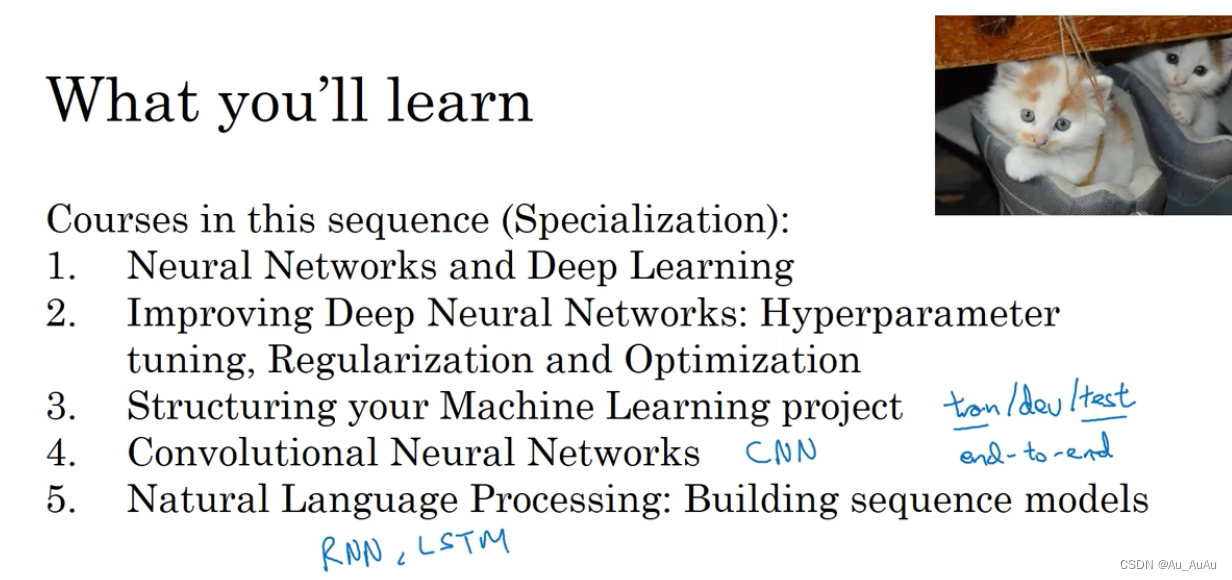

本节课是该系列的1.神经网络和深度学习

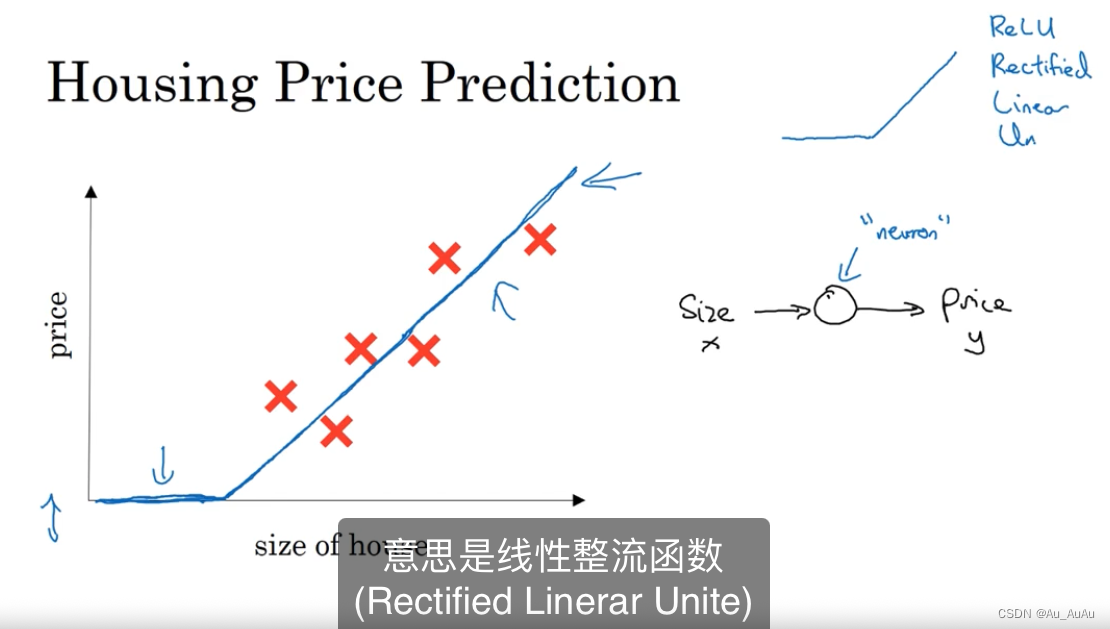

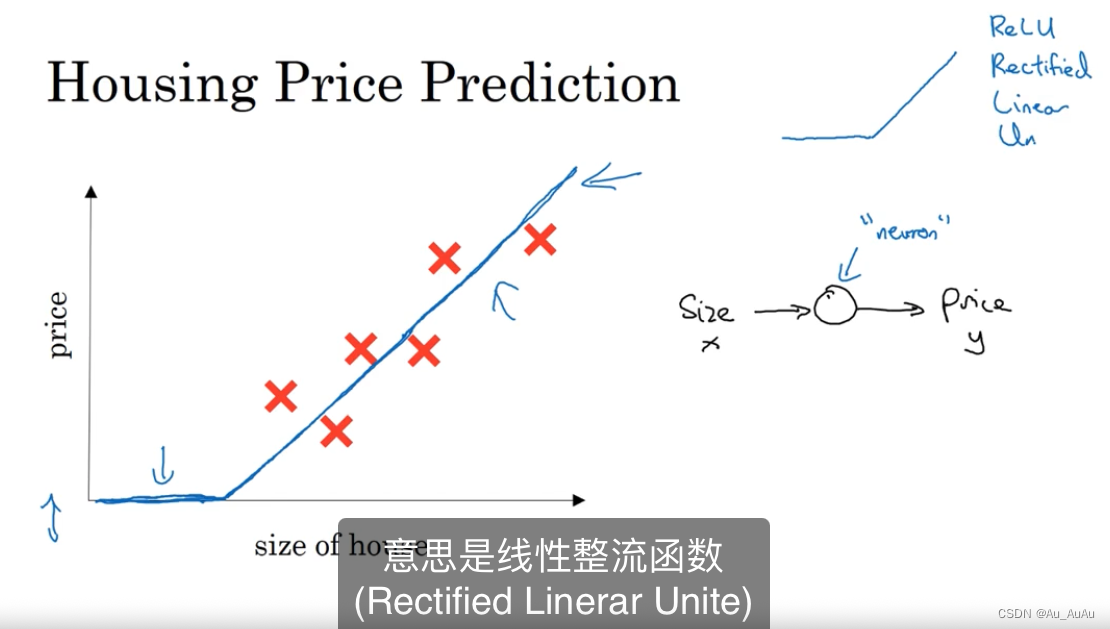

ReLu函数:线性整流max(0,y)

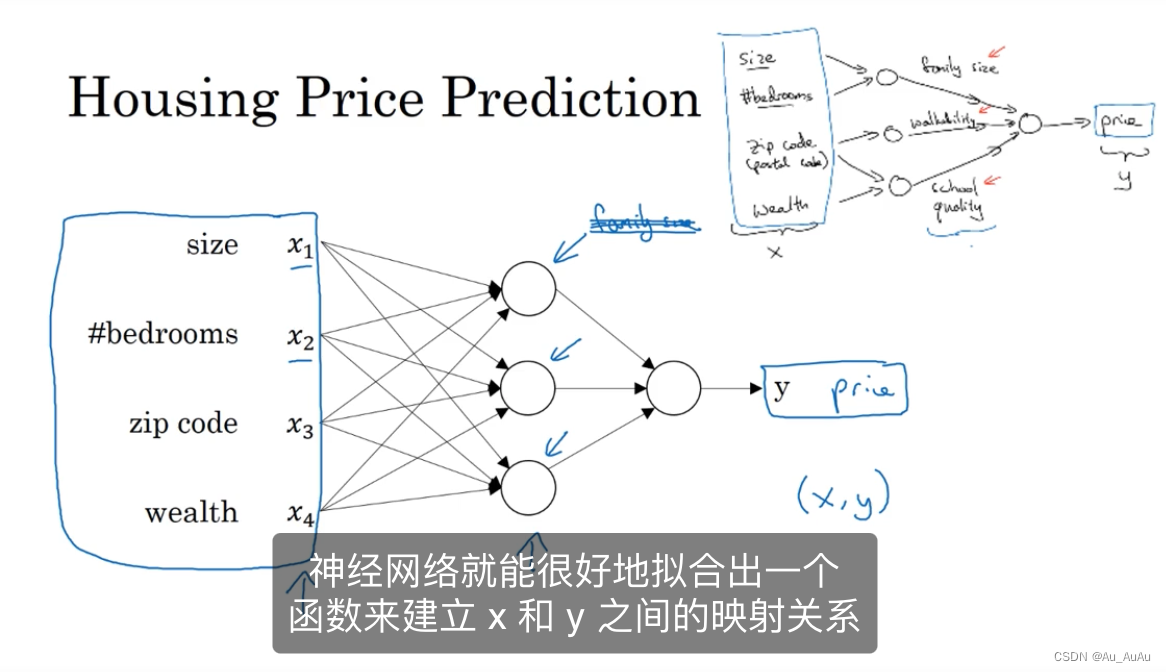

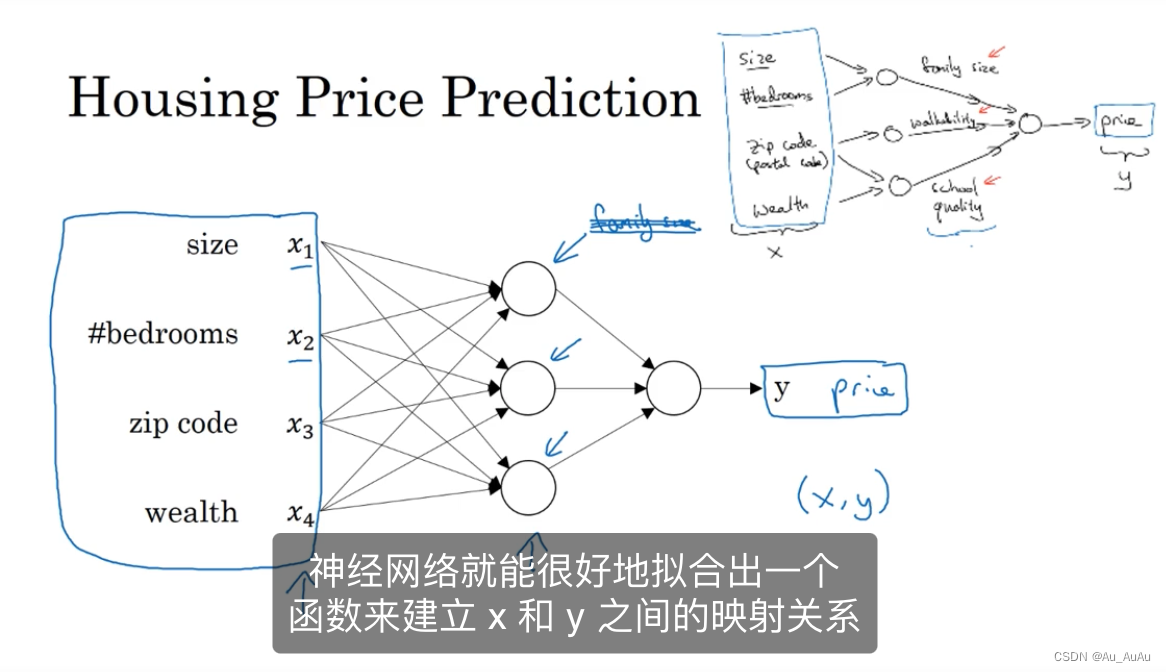

x1, x2, x3, x4是输入,中间的圆圈是隐藏层,右边是输出层。

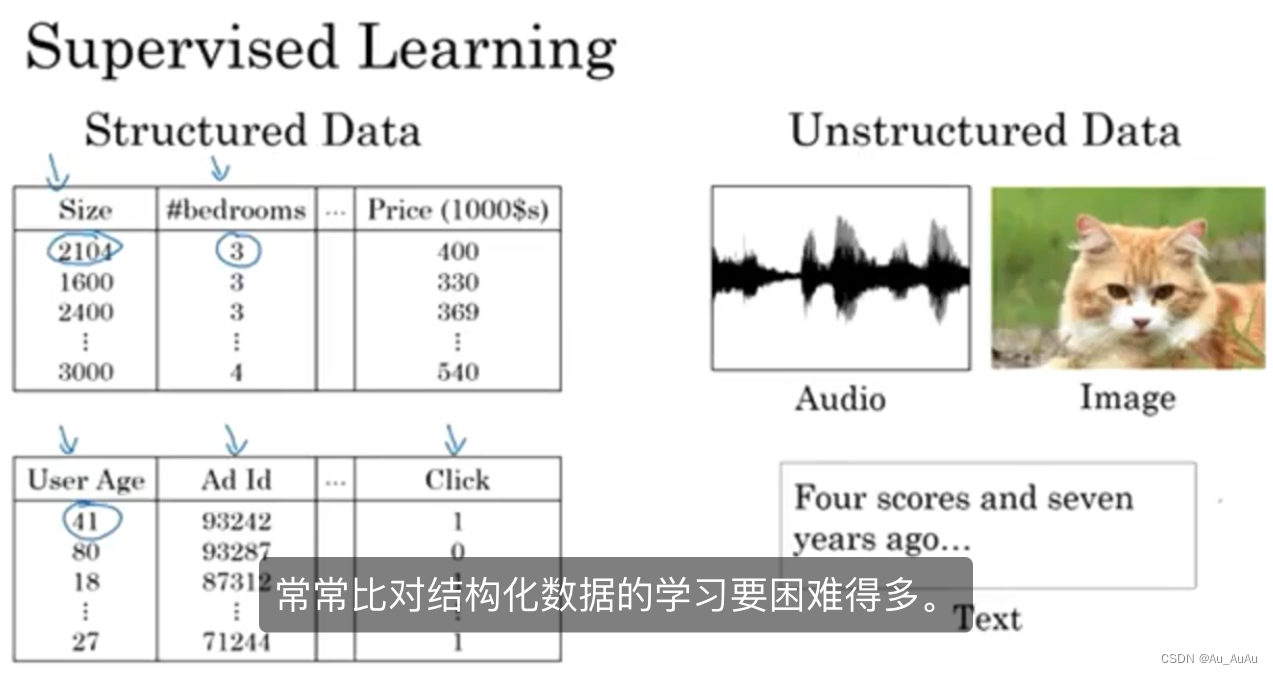

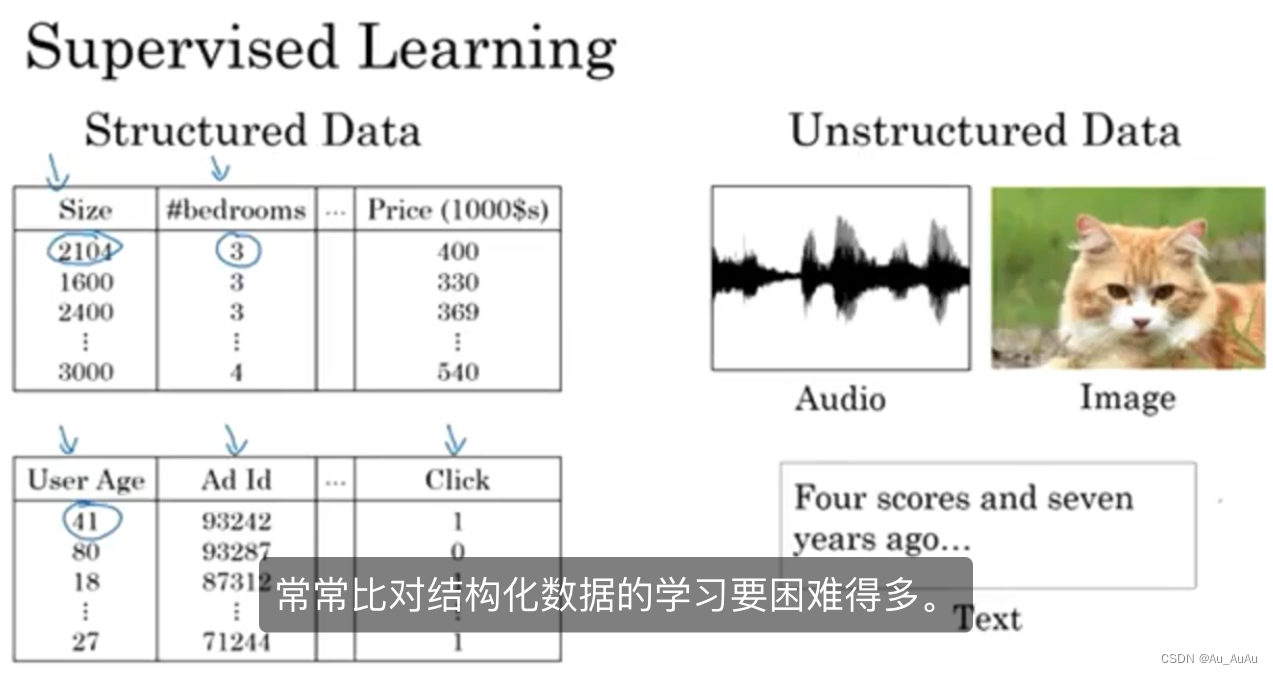

有监督学习:在结构化数据和非结构化数据上。

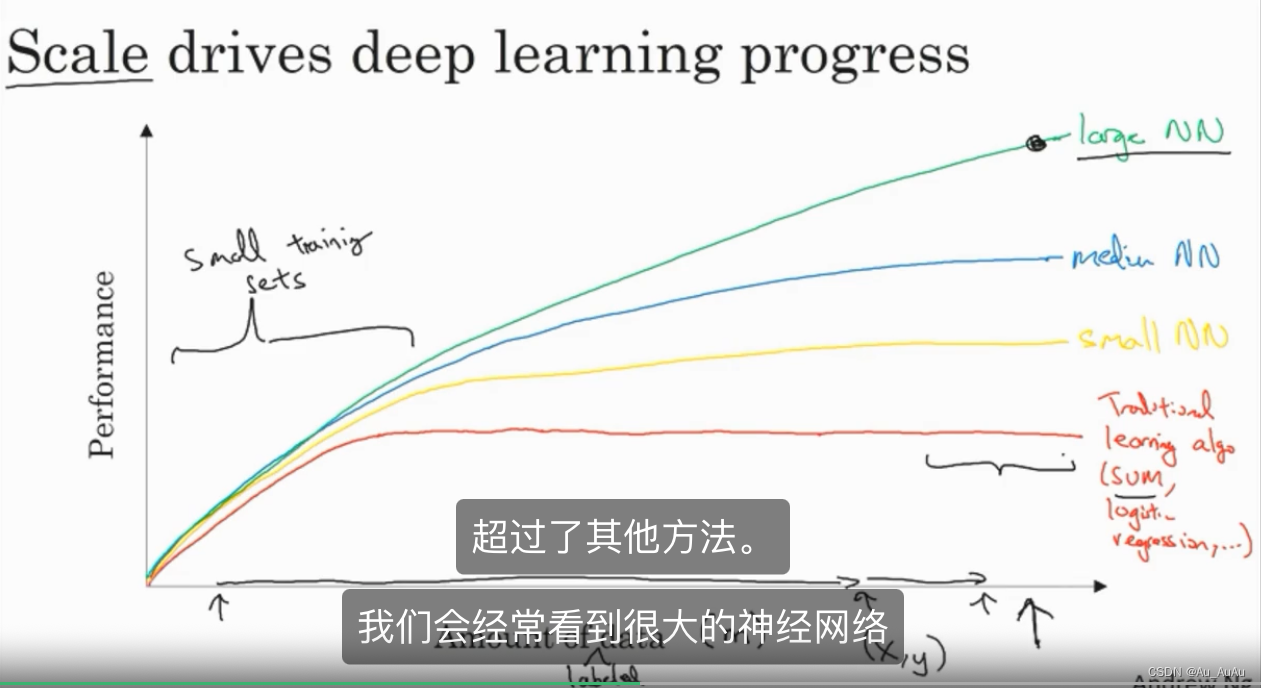

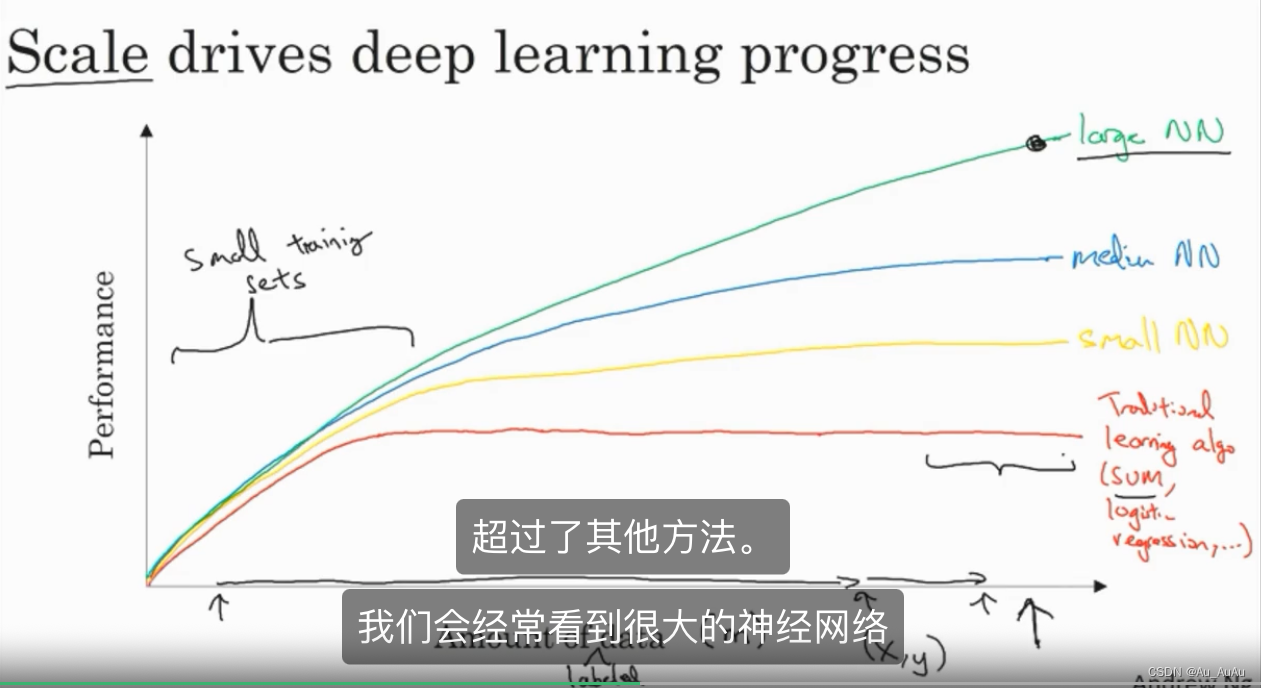

传统算法、小神经网络、中神经网络、大神经网络随着有标签数据量增加的表现。

在左侧区间,SVM可能表现更好;在右侧区间,大神经网络表现更好。

本节课是该系列的1.神经网络和深度学习

ReLu函数:线性整流max(0,y)

x1, x2, x3, x4是输入,中间的圆圈是隐藏层,右边是输出层。

有监督学习:在结构化数据和非结构化数据上。

传统算法、小神经网络、中神经网络、大神经网络随着有标签数据量增加的表现。

在左侧区间,SVM可能表现更好;在右侧区间,大神经网络表现更好。

200

200

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?