点击下方卡片,关注“具身智能之心”公众号

作者 | 具身智能之心 编辑 | 具身智能之心

本文只做学术分享,如有侵权,联系删文

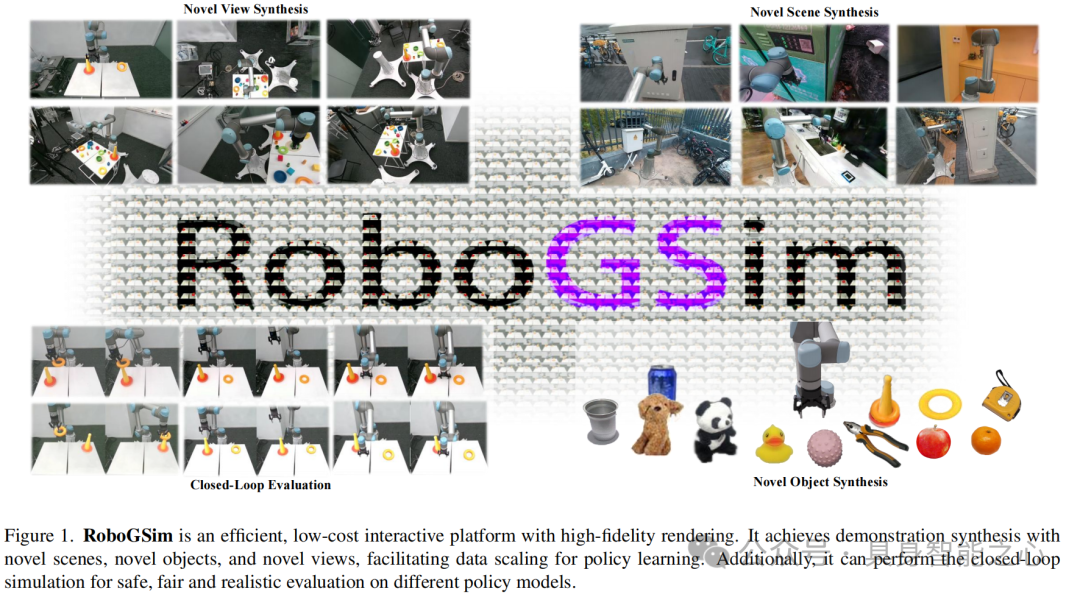

随着具身智能的高速发展,真实环境下的高效数据获取变得愈发重要。然而,通过遥操捕获或真机现场采集的数据收集往往成本极高,且难以高效扩展数据规模。在仿真环境中采集任务序列是一种实现大规模数据采集的有前景方案,但现有模拟器在纹理和物理建模的高保真度上存在不足。为了解决这些问题,我们结合了 3D 高斯泼溅技术(3DGS)和物理引擎提出了 RoboGSim,一个基于 Real2Sim2Real 的机器人模拟器。RoboGSim 主要包括四个模块:高斯重建器、数字孪生生成器、场景组合器和交互引擎。它能够生成包含新视角、新物体、新轨迹和新场景的合成数据。此外,RoboGSim 提供了一种在线的、可重复的、安全的评估方式,用于不同抓取策略的评测。Real2Sim 和 Sim2Real 的交叉验证实验表明,RoboGSim 在纹理和物理表现上具有高度一致性。此外,我们在真实世界的抓取任务中验证了合成数据的有效性。我们希望 RoboGSim 能成为一个闭环模拟器,为策略学习的公平比较提供支持。项目页面:https://robogsim.github.io/

内容出自国内首个具身智能全栈学习社区:具身智能之心知识星球,这里包含所有你想要的。

一些介绍

收集大规模的抓取数据对于有效的策略学习至关重要。一些方法建议通过遥操来捕获演示和动作信息。这样的操作虽然相对提高了采集效率,但随着数据规模的增大,往往会带来极大的成本。为了解决这个问题,另有一些工作尝试在仿真环境下合成数据,进一步用于学习抓取策略。然而,这些 Sim2Real 方法受到模拟环境和现实环境之间巨大域差距的影响,使得学习到的策略无效。

最近,一些工作引入了用于机器人学习的 Real2Sim2Real (R2S2R) 范式。核心思想是通过神经辐射场方法执行真实重建,并将学习到的表示插入模拟器中。在这些方法中,典型的方法 Robo-GS 提出了 Real2Sim 管道,并引入了混合表示来生成支持高保真模拟的数字资产。然而,它缺乏对新场景、视图和物体的演示综合,以及模型学习数据的验证。此外,由于潜在表示、仿真环境和真实世界之间的不一致,它无法对不同的策略进行闭环评估。

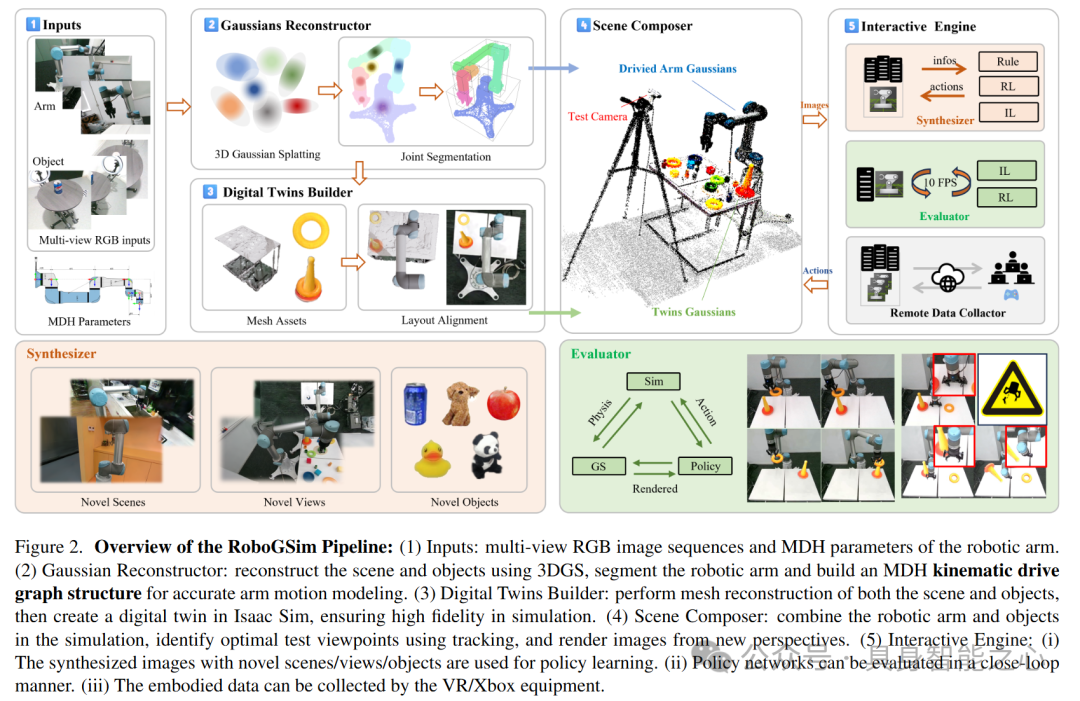

在本文中,我们提出一个名为 RoboGSim 的 Real2Sim2Real 模拟器,用于高保真演示综合和物理一致的闭环评估。主要包括四个部分:高斯重建器、数字孪生生成器、场景组合器和交互引擎。给定多视图的 RGB 图像序列和机械臂的 MDH 参数,高斯重建器基于 3DGS 构建,对场景和物体进行重建;数字孪生生成器执行网格重建并在 Isaac Sim 中创建数字孪生,同时我们提出布局对齐模块来对齐仿真环境、现实世界和 3DGS 表示之间的空间;之后,场景合成器将仿真器中的场景、机械臂和物体结合起来,并从新视角渲染图像;在交互引擎中,RoboGSim 作为合成器和评估器来执行演示合成和闭环策略评估。

与现有的 (Real2)Sim2Real 框架相比,RoboGSim 带来了许多优势。它是第一个将演示合成和闭环评测相结合的辐射场模拟器。RoboGSim 可以生成具有新场景、新视角和新物体的真实操纵演示,用以进行策略学习。它还可以对不同的策略网络进行闭环评测,确保现实环境下的公平比较。总之,我们的核心贡献可以总结为:

基于 3DGS 的真实模拟器:我们开发了基于 3DGS 的模拟器,可以从多视图 RGB 视频中重建具有真实纹理的场景和物体。RoboGSim 针对一些具有挑战性的条件进行了优化,例如弱纹理、弱光和反射表面。

数字孪生系统:我们在系统中引入了布局对齐模块。通过布局对齐的 Isaac Sim,RoboGSim 从 Real2Sim 空间映射物体和机械臂之间的物理交互。

合成器和评估器:RoboGSim 可以将真实的操纵演示与新颖的场景、视图和物体进行合成,以进行策略学习。它还可以充当评估器,以物理一致的方式执行模型评估。

RoboGsim方法说明

整体架构

如图 2 所示,RoboGSim 主要包括四个部分:高斯重建器、数字孪生生成器、场景组合器 和交互引擎。对于多视角图像和机器人臂的 MDH 参数,高斯重建器使用 3DGS 重建场景和物体,同时对机械臂进行分割,并构建 MDH 运动学驱动图结构,以实现机械臂的精确运动建模。数字孪生构建器负责场景和物体的网格重建,通过布局对齐,资产数据流可以互联,从而促进交互引擎的后续评估。场景合成器实现了新物体、新场景和新视角的合成。交互引擎可合成新视角/场景/物体的图像,并用于策略学习。同时,它还能以闭环方式评估策略网络。此外,我们还可以通过 VR/Xbox 等现实世界设备,在仿真中收集操作数据。

高斯重建器

我们采用 3DGS 对静态场景进行重建,并对机器人臂关节的点云进行分割。随后,利用 MDH 动力学模型控制对应每个关节的高斯点,从而实现机器人臂的动态渲染。

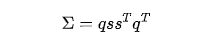

3DGS 使用多视角图像作为输入,完成高保真场景重建。3DGS 将场景表示为一组高斯分布,并采用可微分的光栅化渲染方法以实现实时渲染。具体来说,对于由 个高斯点表示的场景 ,每个高斯点可以表示为 。其中, 表示均值, 表示协方差矩阵, 表示不透明度, 表示通过球谐系数表示的颜色因子。

在渲染过程中,像素的最终颜色值 可以通过类似于 alpha 混合的渲染方法计算得到。它利用了与该像素重叠的 个有序高斯点的序列。此过程可以表示为:

其中 表示第 个高斯点对于当前像素的不透明度, 表示 2D 高斯点中心和像素中心的位移量, 表示 2D 协方差矩阵。

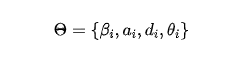

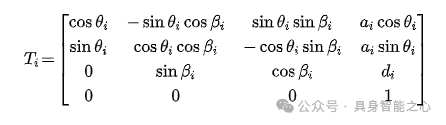

MDH是一种参数化模型,用于描述机械臂的运动链。运动链中的每个关节和连杆都由一组参数表征。在 MDH 模型中,可以为每个连杆构造一个变换矩阵,从而实现机械臂在运动过程中每个阶段姿态的精确表示。设 表示第 个关节的原点坐标。对于一个机械臂,第 个关节的配置可以表示为:

其中, 表示扭转角,即从第 个关节到第 个关节绕 轴的旋转角度。 表示连杆长度,是从 到 沿 轴的距离。 是连杆偏移,表示从 到 沿 轴的位移。 表示关节角,是从 到 绕 轴的旋转角度。

使用 MDH 参数构造的每个连杆的变换矩阵 可以写为:

通过依次相乘这些变换矩阵,可以得到从基座到末端执行器的最终变换矩阵。

我们对每个关节进行分割,并将关节内的所有高斯点视为一个质点。随后,根据 对每个关节内的所有高斯点进行移动,从而实现对高斯点的运动学驱动控制。

数字孪生生成器

数字孪生不仅应映射现实世界资产,还需要进行坐标对齐。通过 Real2Sim 布局对齐和 Sim2GS 稀疏关键点对齐,我们能够将真实世界的数字化,实现真实、仿真和 3DGS 表示之间的数字资产流动。这种方法促进了数字资产在各方向的转换,实现全面的资产整合。

3D 资产生成

我们采用两种方法生成 3D 物体资产。对于现实世界中的物体,我们通过旋转台捕获物体的高质量多视角图像,并使用 GIM 提取匹配特征,以解决纹理缺乏和反射等问题。随后,我们集成 COLMAP 管道,获得初始的 SFM 点云,并使用 3DGS 对其进行重建。此外,对于来自网络的新颖物体,我们首先使用 Wonder3D 获得几何一致的法向量和纹理网格,然后利用 GaussianEditor 中基于扩散模型的方法,在 3DGS 中完成物体重建。

布局对齐

如图 2 所示,由于我们遵循机械臂的局部坐标系统,因此世界坐标系与 Isaac Sim 仿真器间已经轴对齐。我们首先测量真实世界的场景,并对 Isaac Sim 中导入的桌面场景进行尺寸对齐。为实现坐标对齐,我们在 3DGS场景和 Isaac Sim 场景中同时在基座关节上方 1.6 米处放置向下的摄像机,通过比较从 BEV 视图渲染的场景,正面和侧面分割视图中渲染的场景,我们在 Isaac Sim 中调整偏移量以实现布局对齐。

Sim2GS 对齐

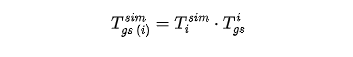

对于基于 MDH 的变换矩阵 和仿真变换矩阵 ,存在一个变换矩阵 满足以下关系:

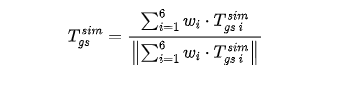

为了计算平均变换矩阵 ,我们采用加权求和并进行归一化:

其中, 为每个关节的权重。

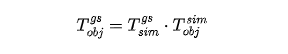

对于 Isaac Sim 中的目标物体 ,可以使用以下公式将其转换为 3DGS 坐标系:

相机定位

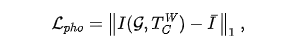

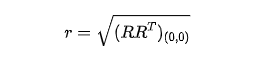

为了将现实世界的坐标系转换到 3DGS 坐标系,我们采用 GS-SLAM 中的定位方法。对于一个预训练的 3DGS 模型 ,我们冻结 3DGS 的属性,并优化外部相机参数 。

在相机定位过程中,仅优化当前相机的姿态,而不更新地图表示。对于单目情况,我们最小化以下光度残差:

其中, 表示通过高斯点 和像机参数 渲染的新视角图像, 是观测到的图像。

场景组合器

为了将点云合并到机械臂场景中,首先计算标记点的变换矩阵 。然后,基于该变换矩阵将新场景中的点云坐标投影到机器人臂的坐标系中。通过以下公式将 3DGS 中的 3D 协方差 展开为缩放因子 和旋转四元数 :

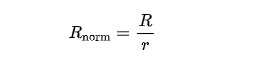

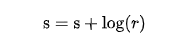

变换的比例因子 可以被分离并提取为一个独立分量:

进一步使用 对旋转矩阵 进行归一化:

调整高斯点的缩放属性 :

将变换 应用于高斯点的坐标:

物体编辑

此处的变换可以扩展自上述场景编辑的变换。不同之处在于目标物体的坐标中心由 (1) 给出。高斯点的坐标变换可以表示为:

交互引擎

我们的交互引擎可以作为数据生成器和模型评估器使用。作为数据生成器,它可以以低成本生成大量数据用于下游策略学习;作为评估器,它可以进行安全、实时且可重复的评估。

数据生成器

我们使用引擎生成多种训练轨迹,包括机器人臂运动轨迹和目标轨迹。这些轨迹驱动 3DGS 生成大规模、高度真实的模拟数据集,用于策略学习。这些多样化的数据集包括新视角渲染、场景组合和对象替换。

模型评估器

对于已训练的模型,直接在物理设备上测试可能存在安全风险或带来高昂的复现成本。因此,我们将预测的轨迹转换为 3DGS 渲染结果,以高效、快速地评估模型的预测质量。具体来说,Isaac Sim 输出目标对象和机器人臂的初始状态,3DGS 根据状态进行渲染。渲染图像被输入到策略网络中,预测下一帧的动作。预测的动作被传递到仿真环境中,用于运动学反解析、碰撞检测和其他物理交互。随后,Isaac Sim 将解析得到的六轴相对位姿发送至 3DGS 渲染器,渲染器将渲染结果作为反馈返回给策略网络。这一过程为预测下一步动作提供了视觉反馈,持续迭代直到任务完成。

实验

由于目前尚无 Real2Sim2Real 的基准,我们构建了以下四组代理实验,全面评估 RoboGSim 在模拟和现实场景中的性能。所有实验均使用 UR5 机械臂进行。机械臂的渲染部分基于 Robo-GS 的代码库实现。

Real2Sim 新位姿合成:验证从现实世界采集的机械臂位姿是否可以有效用于实现模拟器中的精准控制。

Sim2Real 轨迹重现:检查在模拟器中收集的轨迹是否能够被真实世界中的机械臂准确复现。

RoboGSim 作为数据生成器:展示 RoboGSim 生成具有新场景、新视角和新对象的高保真演示能力,并与现实世界对齐。

RoboGSim 作为评估器:展示 RoboGSim 能够高效执行策略网络的闭环评估。

Real2Sim 新位姿合成

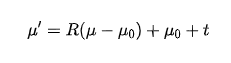

新位姿合成的目标是验证 Real2Sim 重建的性能,特别是机械臂运动的准确性和图像纹理的逼真度。静态场景使用机械臂初始姿态的第一帧 GT 进行重建。真实机械臂采集的轨迹作为驱动力,并通过运动学控制实现新位姿的渲染。

如图 3 所示,实验结果表明,我们的重建能够准确捕捉机械臂的纹理和物理动态,突显了 RoboGSim 实现的高保真度。与真实机械臂在新视点下的视频序列对比,RoboGSim 在渲染中达到了 31.3 的 PSNR 和 0.79 的 SSIM,同时保证了每秒 10 帧的实时渲染速度。

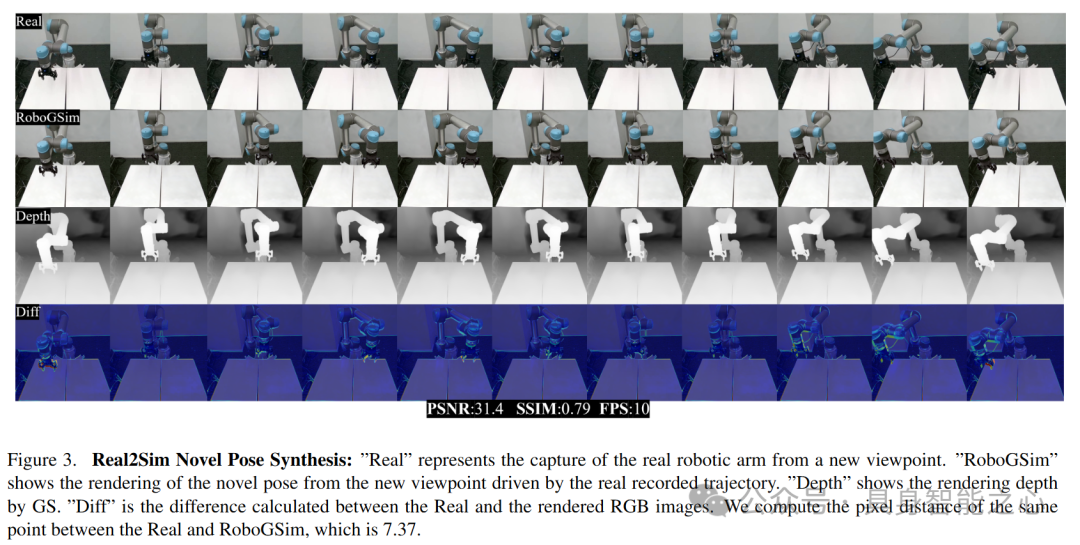

Sim2Real 轨迹重现

为了验证 Isaac Sim 中的轨迹是否能够与真实机械臂和 RoboGSim 有效对齐,我们设计了一项实验:首先在 Isaac Sim 中采集轨迹,然后利用该轨迹驱动 GS 渲染一个抓取可乐的场景,同时将相同的轨迹用于驱动真实机械臂抓取可乐罐。

如图 4 所示,实验结果显示,模拟策略与机械臂的实际物理行为之间具有较强的对齐效果,突出体现了我们系统中 Sim2Real 迁移的有效性。这些结果表明,我们的模拟可以可靠地建模现实世界的动态,促进策略从模拟到现实的成功迁移。

RoboGSim 作为数据生成器

在本部分,我们使用视觉-语言-动作 (VLA) 模型验证 RoboGSim 生成数据的有效性。我们使用 LLAMA3-8B 作为大语言模型 (LLM),CLIP 作为视觉编码器,并采用两层 MLP 作为投影网络。VLA 模型在 8xA100 (80GB) 上训练 1 个 epoch,训练过程分为三个阶段:(1)预训练阶段:仅启用连接器,使用 LAION-558K 数据集。(2)训练阶段:解冻 LLM,使用 LLaVA665K 数据集。(3) 监督微调 (SFT):使用机器人图像-动作数据进行训练,同时冻结 CLIP 权重。

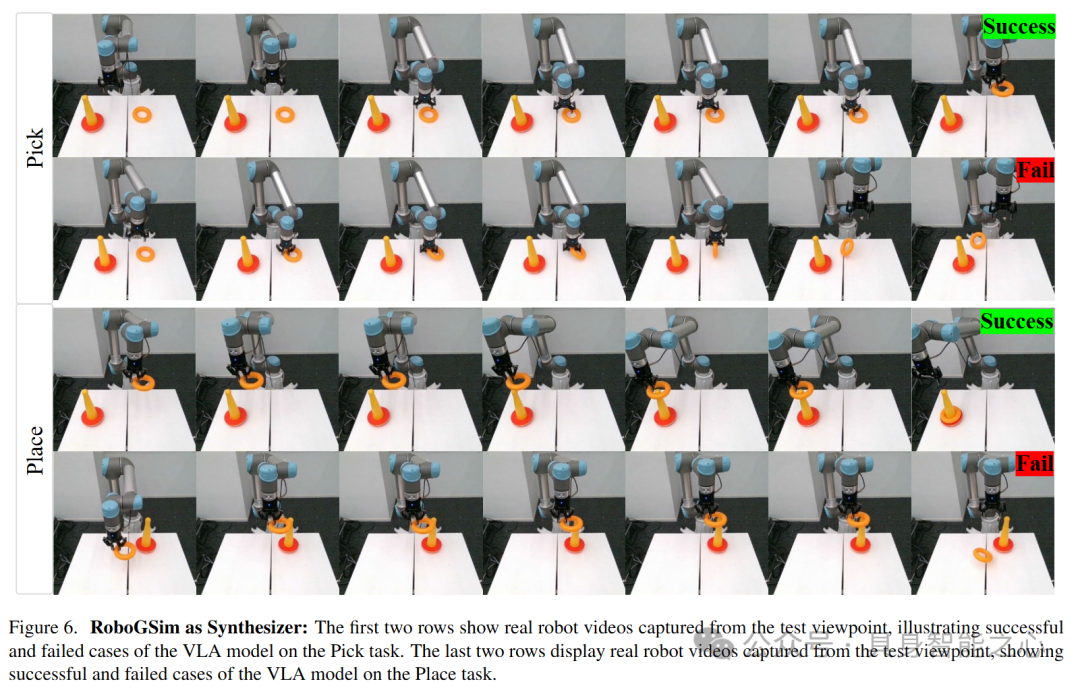

我们在具有挑战性的套圈任务上进行实验(见图6),该任务分为两个子任务:拾取套环和将其投放至目标。对于真实世界数据,人工采集了 1,000 个样本。为了公平比较,我们使用 RoboGSim 生成了 1,000 个合成样本。在测试阶段,每个模型测试 10 次,每次允许 3 次尝试。如果 3 次尝试均失败,则该次测试标记为失败。

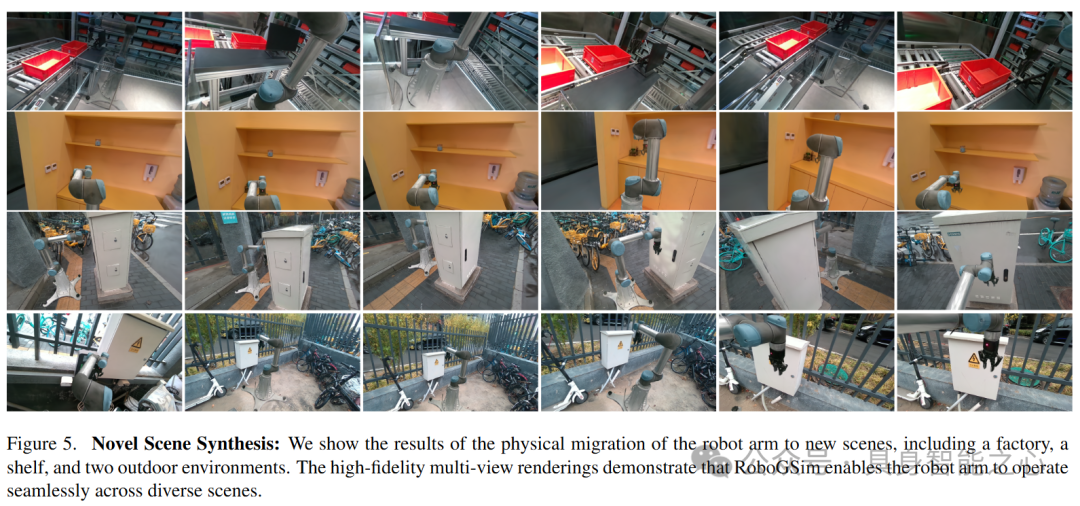

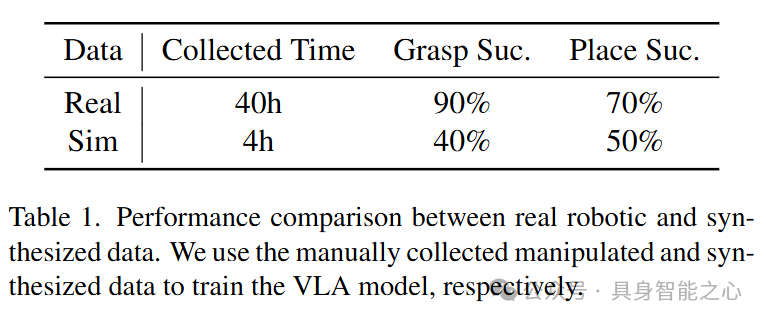

如表 1 所示,使用 RoboGSim 合成数据训练的 VLA 模型实现了 40% 的抓取成功率和 50% 的投放成功率。相比之下,使用真实数据训练的 VLA 模型抓取成功率为 90%,投放成功率为 70%。需要注意的是,人工采集数据耗时 40 小时,而 RoboGSim 的数据生成仅需 4 小时。进一步扩展合成数据规模有望提升模型性能。图 6 展示了一些成功和失败案例的可视化结果。此外,我们还提供了更多关于新场景合成的定性分析。如图 5 所示,我们展示了 UR5 机械臂在新场景中的物理迁移结果,包括工厂、货架以及两个室外环境。高保真的多视图渲染表明,RoboGSim 能够使机械臂在多样化场景中无缝操作。

RoboGSim 作为评估器

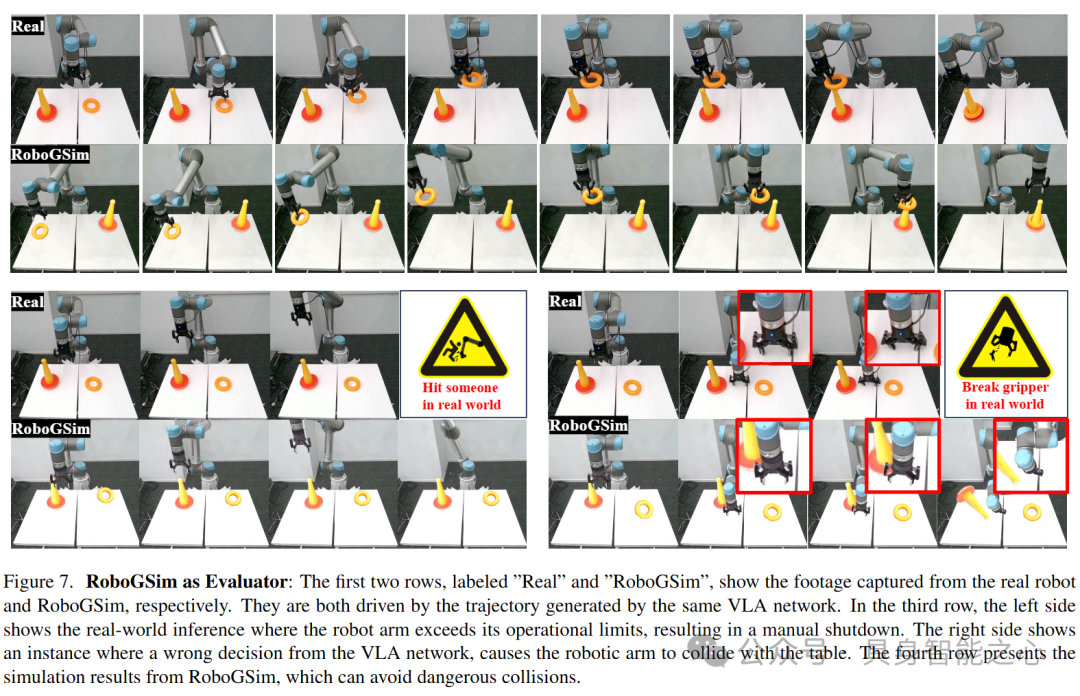

逼真的闭环评估对于验证和比较策略网络至关重要。本部分主要探索 RoboGSim 作为评估器的有效性,以展示其与现实推理的高度一致性。

在实验中,我们将训练良好的 VLA 模型分别部署到真实机器人和 RoboGSim 模拟环境中。如图 7 所示,我们的闭环模拟器 RoboGSim 可以再现与现实世界类似的结果。对于相似的错误案例,RoboGSim 能够避免现实中存在的问题,例如越界和碰撞。因此,RoboGSim 提供了一个公平、安全且高效的策略评估平台。

“具身智能之心”公众号持续推送具身智能领域热点:

【具身智能之心】技术交流群

具身智能之心是首个面向具身智能领域的开发者社区,聚焦大模型、视觉语言导航、机械臂、双足机器人、四足机器人、感知融合、强化学习、模仿学习、规控与端到端、机器人仿真、产品开发、自动标注等多个方向,目前近60+技术交流群,欢迎加入!扫码添加小助理微信邀请入群,备注:学校/公司+方向+昵称(快速入群方式)

【具身智能之心】知识星球

具身智能之心知识星球是国内首个具身智能开发者社区,近600人的社区。主要关注具身智能相关的数据集、开源项目、具身仿真平台、大模型、视觉语言模型、强化学习、具身智能感知定位、机器臂抓取、姿态估计、策略学习、轮式+机械臂、双足机器人、四足机器人、大模型部署、端到端、规划控制等方向。扫码加入星球,享受以下专有服务:

1. 第一时间掌握具身智能相关的学术进展、工业落地应用;

2. 和行业大佬一起交流工作与求职相关的问题;

3. 优良的学习交流环境,能结识更多同行业的伙伴;

4. 具身智能相关工作岗位推荐,第一时间对接企业;

5. 行业机会挖掘,投资与项目对接;

1453

1453

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?