▍文章来源于康谋自动驾驶

点击下方卡片,关注“康谋自动驾驶”公众号

获取更多自动驾驶资讯

01 前言

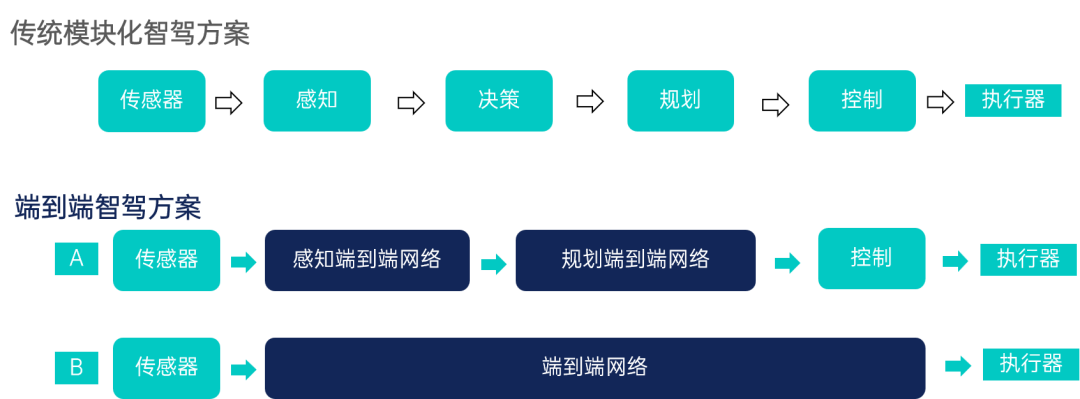

随着智能驾驶技术的发展,端到端的解决方案被越来越多的开发者提及,各大汽车企业争先恐后将端到端智驾方案部署到量产新车型上。过去,智能驾驶方案一直是按照感知、决策、规划、控制这类规则驱动(rule-based)的模块化方法推进,然而规则驱动的模块化方案存在“规则难以穷举、ODD边界模糊、扩展与维护升级困难”等局限性。因此端到端的学习驱动(learning-based)方案应运而生。

端到端的方案具有很多显而易见的优势,首先,它具备较强的泛化能力,可以通过数据发现潜在规律,适应多样化和复杂场景;其次,端到端可实现全面优化,学习驱动直接将输入(如传感器数据)映射到输出(如车辆控制指令),避免了模块化方案中的中间过程(如感知、决策和控制分离)可能导致的信息丢失或误差累积;此外,端到端可持续学习和升级,模型可以通过在线学习或周期性训练,不断吸收新数据,从而适应动态变化的环境需求,如更新的道路法规、复杂的新场景等。

图 1 自动驾驶传统模块化方案与端到端方案

可见,端到端智驾方案优势非常明显,但是对于仿真测试来说却是“灾难性的挑战”。过去模块化智驾方案中,感知与规控之间有显性接口。无论是SIL仿真还是HIL仿真,可以轻松绕过感知模块,直接对规控进行仿真测试(即使输入合成的低置信度图像或点云,也不对感知进行评测)。而端到端方案的到来,不再有所谓感知与规控接口,原有SIL或HIL仿真方案需要重构。面向端到端的智驾仿真必须从传感器输出数据切入,提供一种置信度高、一致性好、覆盖率全面、故障注入便捷的全链路闭环仿真方案。

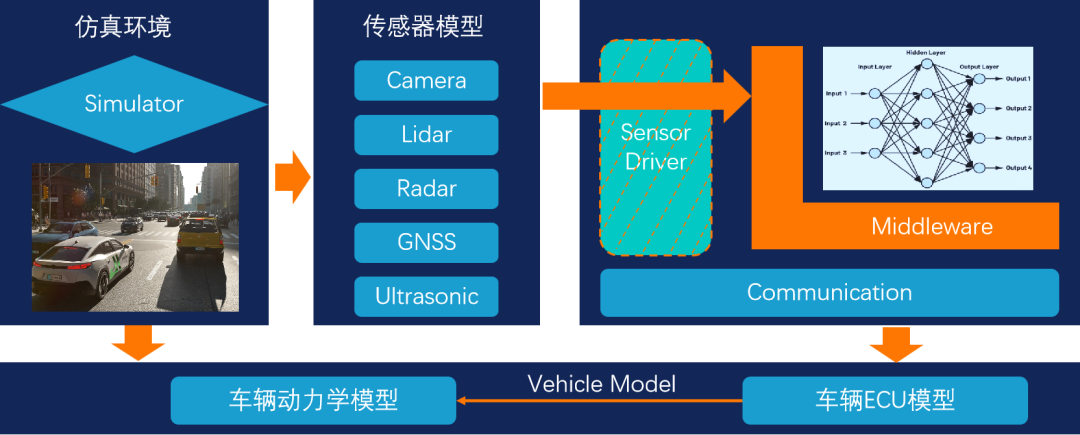

我们探索了一种有效的端到端智驾仿真解决方案,在仿真引擎和数据传输上进行了大幅优化,以应对端到端带来的挑战,整体框架如图2所示。本方案充分利用了智能驾驶的中间件技术,将仿真引擎生成的传感器原始数据(部分为结构化数据)直接传递给智驾应用层,绕过了传感器硬件和驱动,缩短了仿真数据传输链路,规避了仿真系统开发过程带来的复杂适配与调试工作。大大缩短开发周期的同时,还显著降低了整个仿真系统的成本。

图 2 基于软件定义接口和中间件的闭环测试

02 XIL架构仿真

方案核心架构基于aiSim仿真器,采用XIL架构,并提供开放灵活的API接口,满足不同仿真测试需求。无论是传感器模型、车辆动力学,还是场景构建,都有对应的功能模组来实现。

图 3 aiSim XIL架构示意图

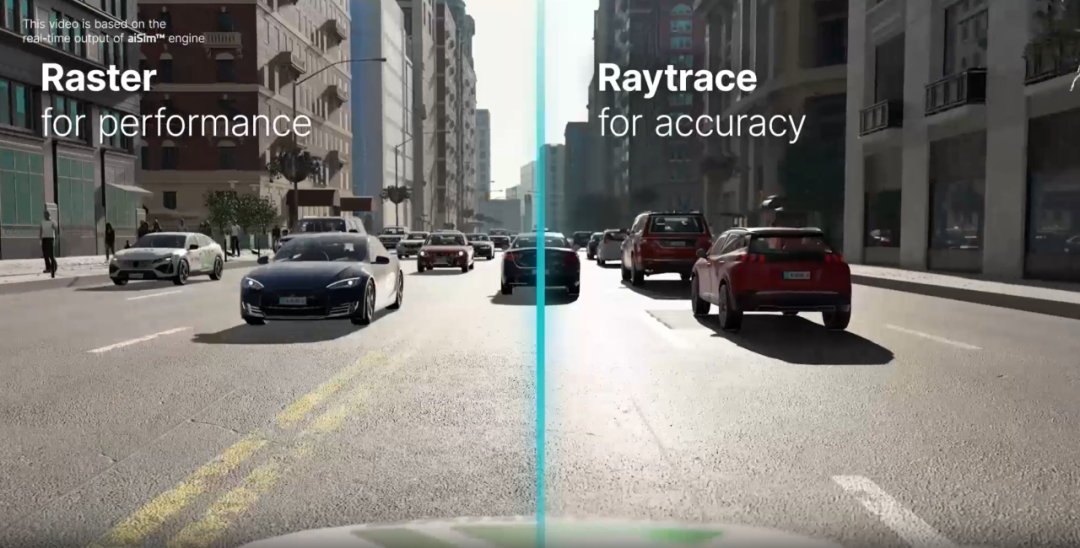

aiSim Air引擎支持如Raster、Raytrace等多种渲染方案,并兼容3DGS/NeRF等技术,能够在平衡渲染效率和置信度的同时,优化资源占用和数据传输效率。此外作为通过ISO 26262 ASIL D认证的仿真工具,aiSim能够在不同传感器和天气条件下提供完全的确定性和一致性。

图 4 Raster和Raytrace渲染支持

图 5 兼容三维重建场景

03 灵活先进的场景构建方案

此外,我们采用了多种先进的场景构建方案,极大地增强了测试的灵活性和广度。交互式图形化场景编辑工具支持OpenScenario和aiSim自定义的AimScenario两种场景格式,能够逐帧回放编辑过程。

图 6 图形化场景编辑工具

高斯泼溅渲染器(GGSR)则可以在3D重建场景中动态插入物体,优化环境条件,减少伪影,修复镜头下的非一致性问题。

图 7 非一致性修正

图 8 三维重建场景天气环境编辑

图 9 任意视角下多模态效果图

LogSim2WorldSim进一步通过云端自动化处理和分析原始数据,实现了基于EuroNCAP等法规场景的切片、预测试和回放功能。

图 10 LogSim2WorldSim方案转换流程

在完成场景构建后,通过VRU、建筑物、道路标志和天气等动静态元素,对场景的边缘条件进行探索,确保端到端测试全面覆盖。

图 11 场景泛化方案

04 高保真物理传感器模型

在传感器仿真方面,通过物理级相机、激光雷达和毫米波雷达模型等丰富模型库的支持,可以实现快速配置和参数调整。此外通过精准仿真HDR、高动态范围、动态模糊、曝光等不同的视觉效应,能够确保各种驾驶环境和天气条件下的高保真度测试。

图 12 相机模型镜头效应

图 13 镜头不同曝光次数下HDR图像

图 14 不同天气条件下镜头效果

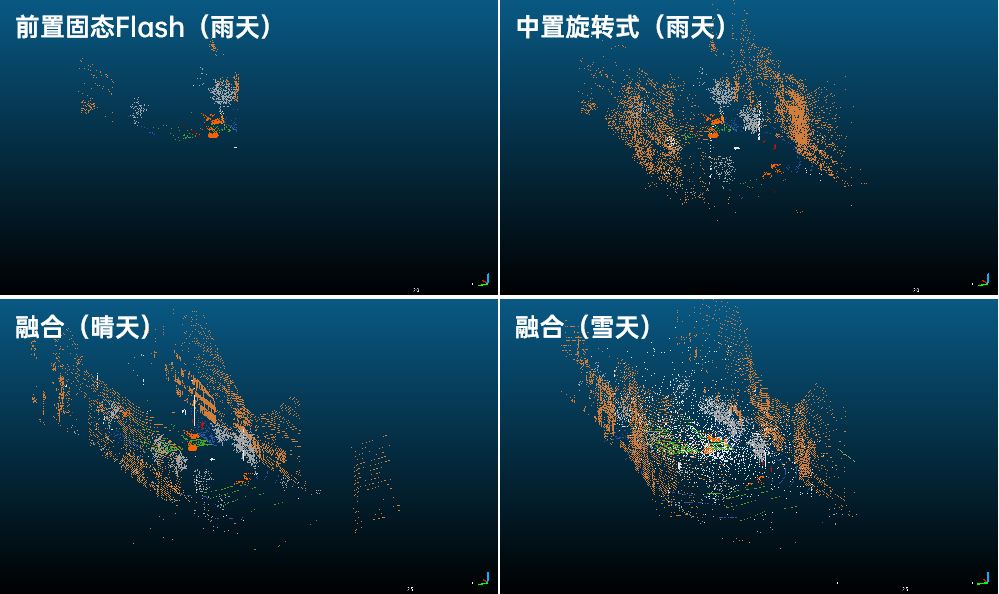

激光雷达和毫米波雷达模型也能有效模拟不同天气条件下的传感器行为,为高效的多目标检测和车道线检测任务提供可靠数据支持。

图 15 激光雷达BRDF材质反射

图 16 雨雪天气激光雷达点云输出效应

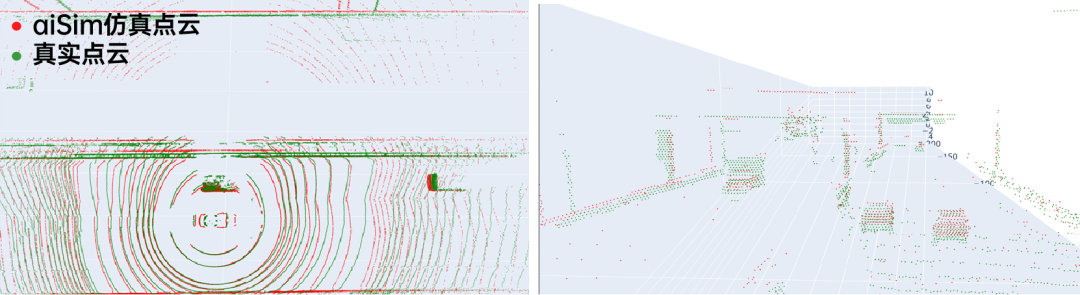

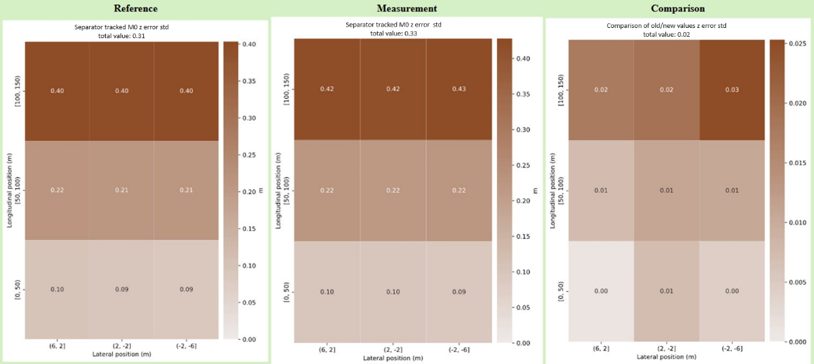

图 17 激光雷达点云置信度验证

图 18 毫米波雷达点云

05 置信度与仿真结果分析

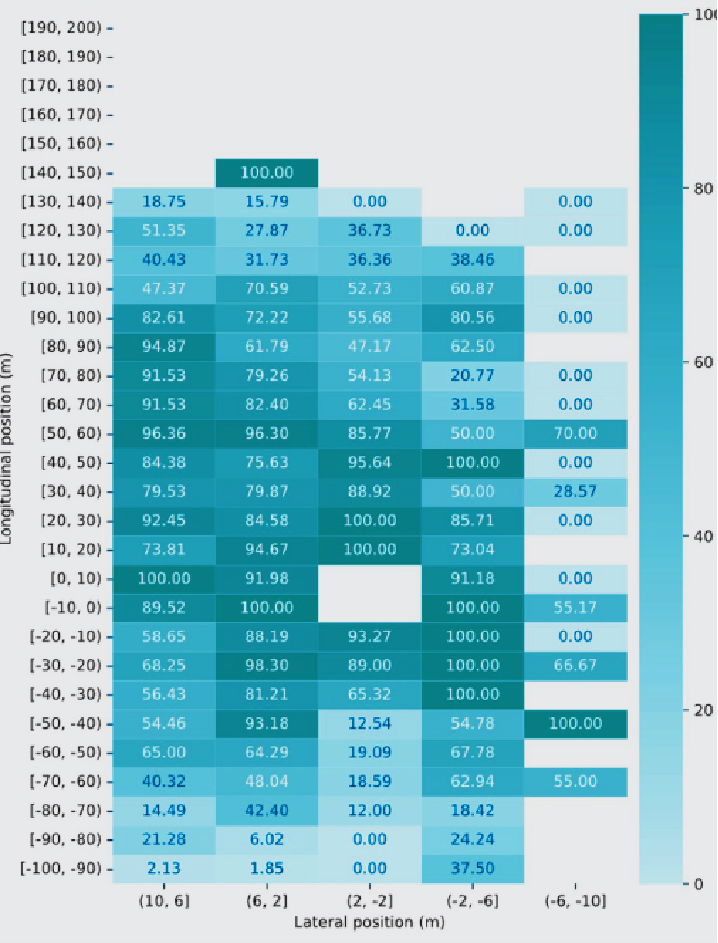

我们还对采用此方案的仿真结果进行了详细的验证。例如,在车道线检测任务中,aiSim仿真与真实世界数据之间的召回率一致,达到了98.45%的高准确率。多个目标检测任务的测试结果也表明,仿真与实际表现高度契合,尤其在近距离目标的检测中,召回率表现优异。

图 19 置信度测试1:车道线检测算法

图 20 置信度测试2:多目标检测

端到端智驾仿真方案还在多个测试环境中展现了出色的表现,包括实车静态和动态测试、车辆模型与动力学模型的集成,支持FMU接口快速接入第三方动力学模型。

图 21 动力学测量和建模

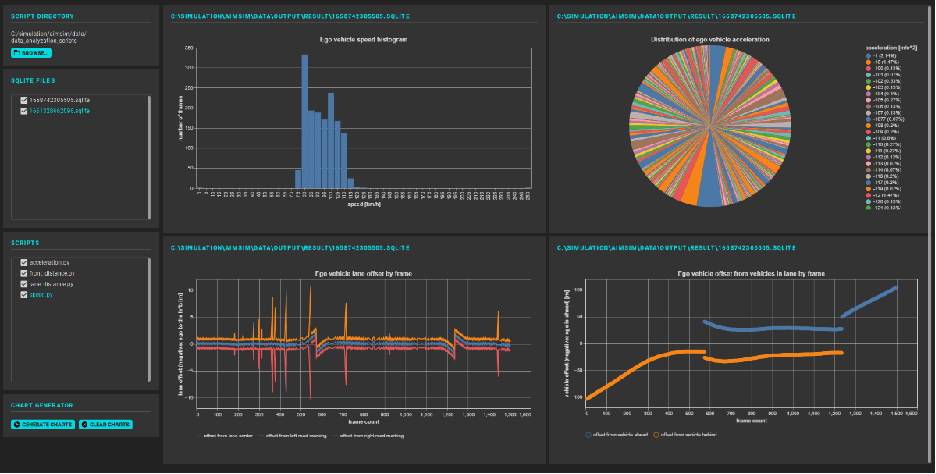

每次仿真结束后,系统会自动生成SQLite数据库文件,方便进行深入的分析和数据挖掘,确保测试结果的全面性和准确性。

图 22 测试结果可视化分析

06 应用案例分享

随着自动驾驶测试需求的日益复杂,基于aiSim为核心的端到端仿真方案凭借其易于扩展的特性,可以支持SiL/HiL等多种应用场景,并提供了与ROS2、Simulink、Matlab等系统的无缝集成。

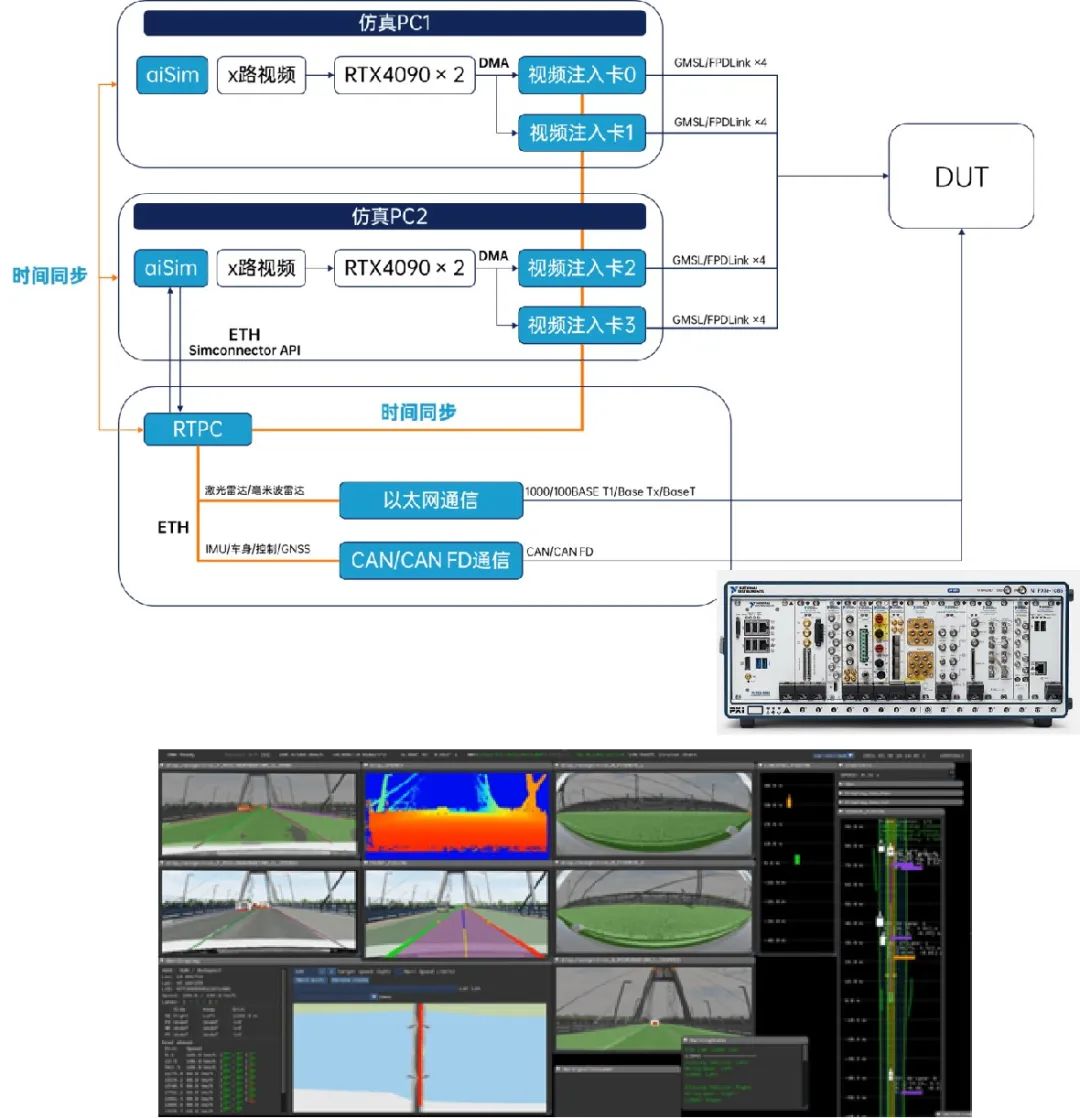

图 23 基于DMA视频注入闭环测试方案及监测窗口

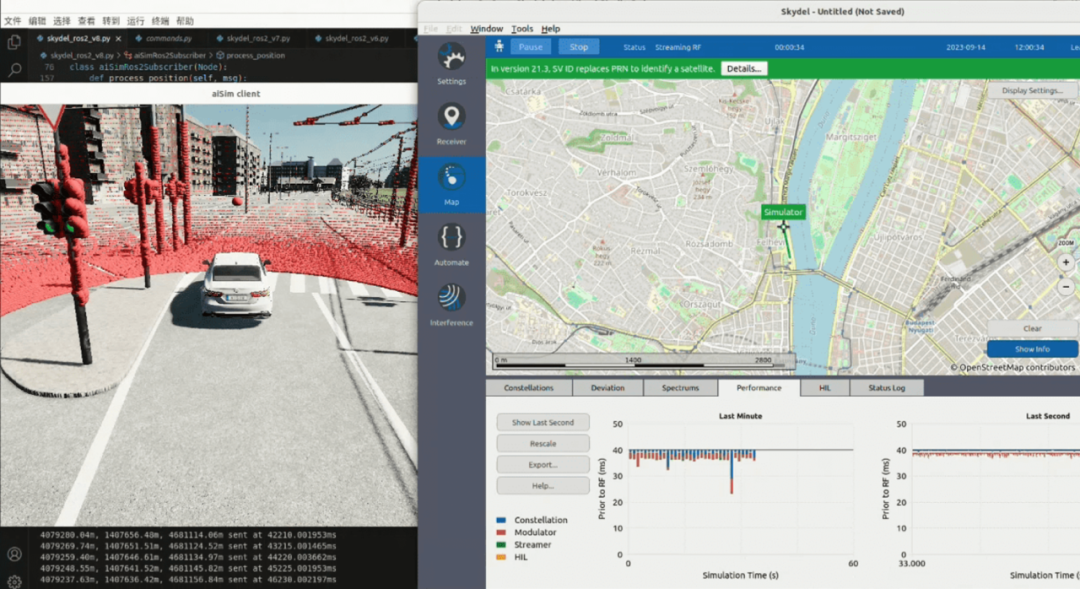

我们还尝试探索了专为GNSS集成域控制器、决策功能快速测试等场景的测试方案,进一步提高了测试效率,降低了硬件成本。

图 24 GNSS联合仿真方案

07 结语

康谋的端到端智驾仿真测试方案,以aiSim引擎和XIL架构为核心支撑,凭借其开放的接口设计、灵活的场景构建与测试功能,为自动驾驶技术的验证与优化提供了强有力的支持。无论客户面临的是提升测试效率的迫切需求,还是降低成本的现实压力,端到端智驾仿真测试方案都能帮助客户轻松应对自动驾驶测试中的种种复杂挑战,实现技术难题的快速解决。

▍关于康谋科技

康谋是一家自动驾驶解决方案供应商(前身是虹科自动驾驶事业部)。

我们以数据为驱动力,提供高性能的数据采集、记录、传输方案,针对各种驾驶场景进行精准的仿真模拟,以及对大量自动驾驶数据进行高效、高质量处理。我们的一站式服务能够满足自动驾驶领域研发测试的全流程需求。

通过深入了解客户需求,结合行业最新技术和趋势,我们致力于为客户提供最适配的自动驾驶解决方案,助力客户在自动驾驶领域取得更大突破。

更多资讯信息,请关注

直播预告 | 直面挑战,自动驾驶测试技术系列直播不容错过

合作升级,共拓未来!康谋与aiMotive签署独家合作协议

康谋技术 | 自动驾驶:揭秘高精度时间同步技术!

845

845

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?