一.多尺度特征融合的作用

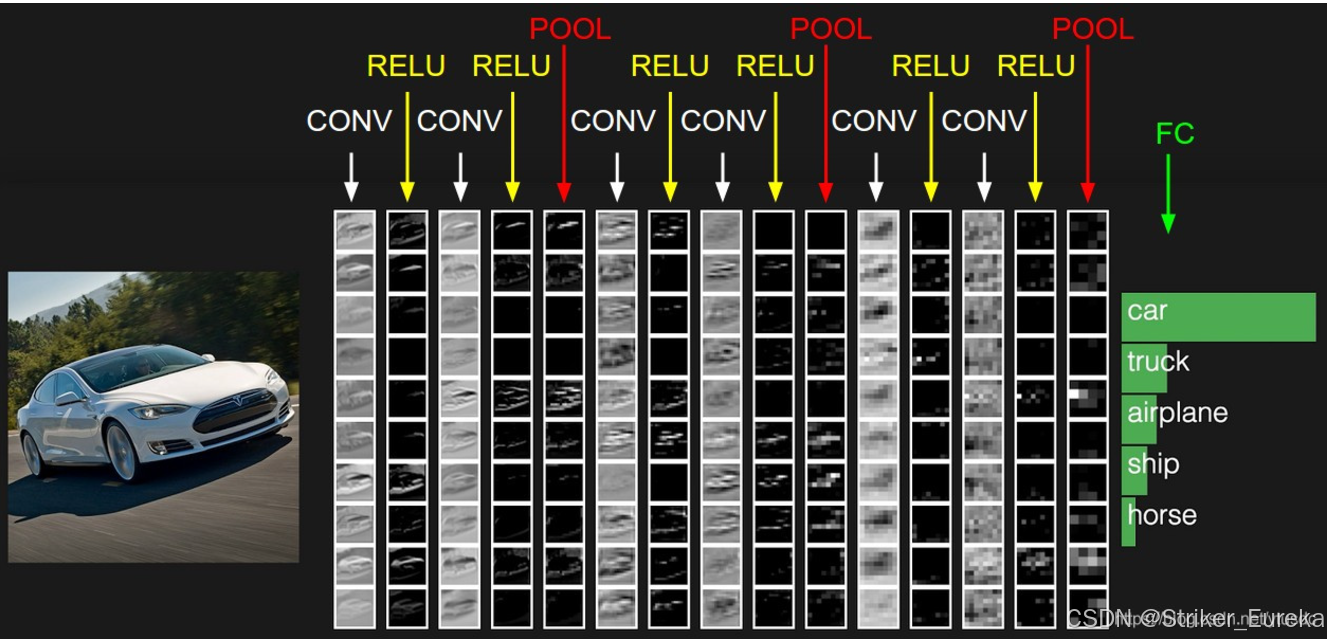

原来多数的目标检测算法仅仅根据最终的特征图输出做预测,而低层的特征语义信息比较少但目标位置准确;高层的特征语义信息丰富但目标位置粗略。识别不同尺寸的目标一直是目标检测的难点,尤其是小目标!

以VGG16为例,假如stride=16,表示若原图大小是1000×600,经过卷积层后的特征图大小为60×40,可理解为特征图上一个像素点映射原图中一个16×16的图像区域;那原图中有一个小于16×16大小的物体则会检测不到。

二.特征图金字塔网络FPN

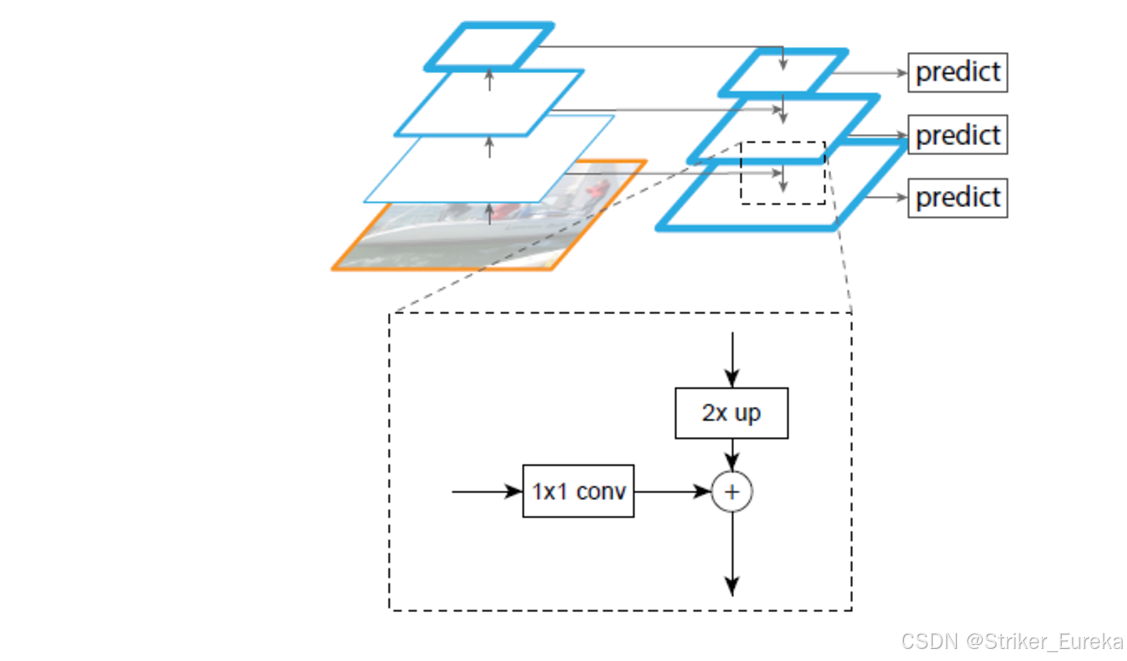

把低分辨率、高语义信息的高层特征和高分辨率、低语义信息的低层特征进行自上而下的侧边连接,使得所有尺度下的特征都有丰富的语义信息。

(1) 自底向上

自底向上的过程就是神经网络普通的前向传播过程。在前向过程中,feature map的大小在经过某些层后会改变,而在经过其他一些层的时候不会改变,作者将不改变feature map大小的层归为一个stage,因此每次抽取的特征都是每个stage的最后一个层输出,这样就能构成特征金字塔。

(2) 自顶向下

把高层特征图进行上采样(比如最近邻上采样),然后把该特征横向连接(lateral connections )至前一层特征,因此高层特征得到加强。

上采样几乎都是采用内插值方法,即在原有图像像素的基础上在像素点之间采用合适的插值算法插入新的元素,从而扩大原图像的大小。通过对特征图进行上采样,使得上采样后的特征图具有和下一层的特征图相同的大小,这样做主要是为了利用底层的位置细节信息。

(3) 横向连接

横向连接:前一层的特征图经过 1×1的卷积核卷积,目的为改变通道数,因为要和后一层上采样的特征图通道数相同。

连接方式:像素间的加法。

重复迭代该过程,直至生成最精细的特征图。得到精细的特征图之后,用 3×3的卷积核再去卷积已经融合的特征图,目的是消除上采样的混叠效应,以生成最后需要的特征图。

混叠效应:在统计、信号处理和相关领域中,混叠是指取样信号被还原成连续信号时产生彼此交叠而失真的现象。当混叠发生时,原始信号无法从取样信号还原。而混叠可能发生在时域上,称做时间混叠,或是发生在频域上,被称作空间混叠。在视觉影像的模拟数字转换或音乐信号领域,混叠都是相当重要的议题。因为在做模拟-数字转换时若取样频率选取不当将造成高频信号和低频信号混叠在一起,因此无法完美地重建出原始的信号。为了避免此情形发生,取样前必须先做滤波的操作。

所以论文中使用一个 3×3 的卷积核来卷积特征图来产生最后的参考特征图。

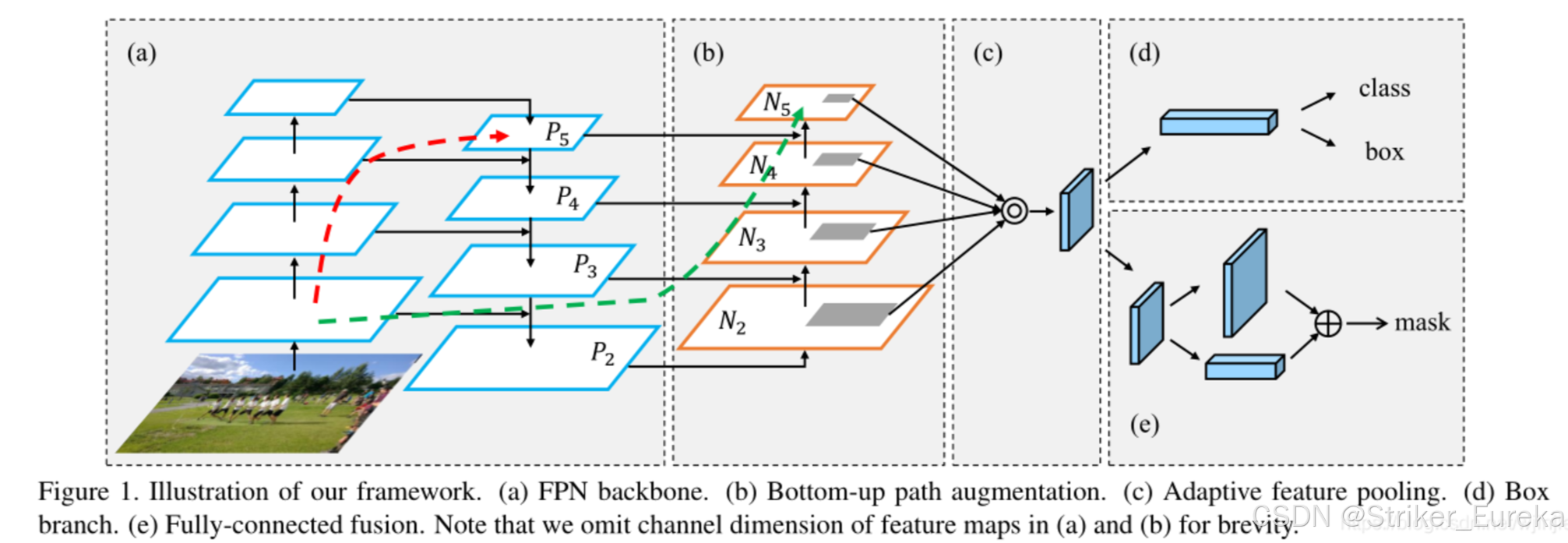

三.深度学习-路径聚合网络PANet

主要包含FPN、Bottom-up path augmentation、Adaptive feature pooling、Fully-connected fusion四个部分。FPN上面已经讲过。

(1)自底向上的路径增强(Bottom-Up Path Augmentation)

PANet 增强了 FPN 的多尺度特征聚合机制,在原本自顶向下的特征金字塔基础上,额外增加了一条 自底向上的路径。这一路径的主要目的是补充自顶向下路径中可能丢失的细节信息,使得浅层特征可以更多地参与到最终的决策中,从而提升对小目标的检测能力。

具体步骤如下:

- 在 FPN 中,网络首先通过自顶向下的路径将深层特征上采样并与浅层特征融合。

- 在 PANet 中,接下来引入了自底向上的路径增强,这个路径通过逐步将浅层的高分辨率特征向上传递,融合到更深层次的语义特征中。这种方式能够更充分地利用浅层的空间细节信息。

- 在实现上,自底向上的路径通过 3×3 卷积层进行处理,并通过相邻层的下采样操作(如最大池化)逐步汇聚特征。

这种自底向上的特征聚合与 FPN 中的自顶向下路径形成了互补,使得网络能够更好地在多尺度上利用特征。

(2)自适应特征池化(Adaptive Feature Pooling)

为了进一步提高特征利用率,PANet 中引入了自适应特征池化。这是对 FPN 中 ROI Pooling 方式的一种改进。它的目标是让网络能够更加自适应地从不同尺度的特征图中选取最优的特征进行池化操作。

在 FPN 中,ROI Pooling 通常固定从某一特征层进行特征提取,而 PANet 则让网络可以根据每个 ROI 的大小动态调整特征提取的层次:

- 对于较大的 ROI,网络会倾向于从较深的、低分辨率的特征图中提取信息;

- 对于较小的 ROI,网络则倾向于从浅层的、高分辨率特征图中获取信息。 这种自适应的方式能够更精确地提取到与物体大小相匹配的特征。

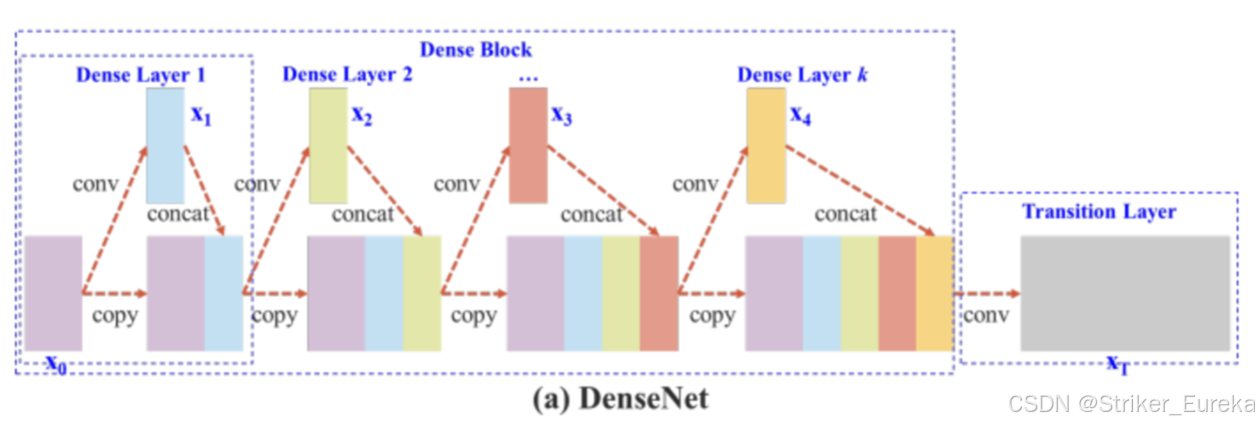

四.CSPNet网络

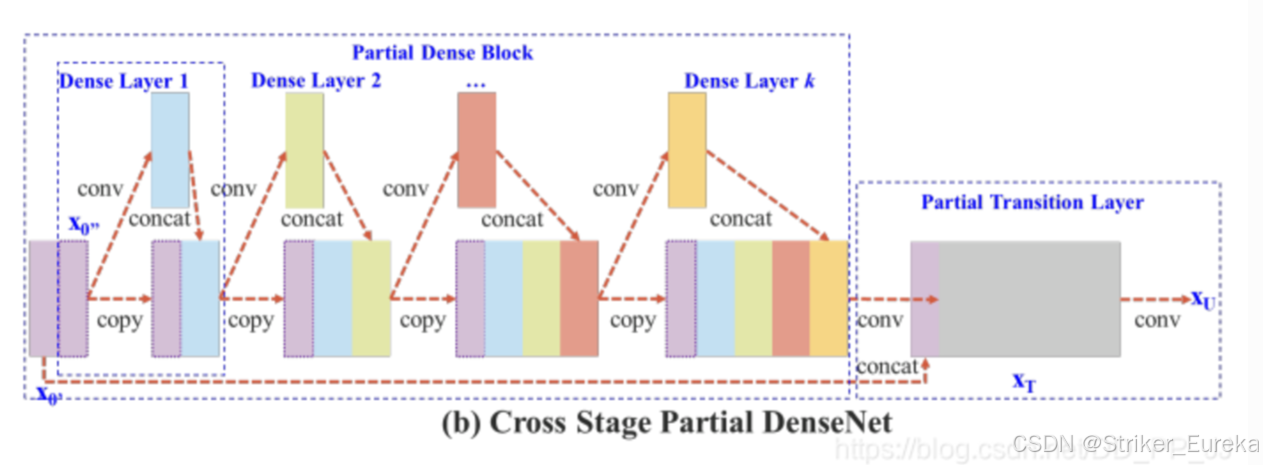

直白的来看,CSPDenseNet就是将输入的feature map按照channel分成了两个部分,其中一个部分正常进行Dense Block的操作,另一个部分直接进行Concat操作。由于每个Dense Block操作的输入通道都变少了(第一个直接减少,后面Concat的通道数变少),所以能减少计算量。

CSPNet 的工作原理:

CSPNet 的核心思想是将输入特征图划分为两部分,一部分直接传递到后面的层(即跨阶段传递),另一部分经过卷积层或残差块等处理后再与之前传递的特征进行融合。这种设计方式有效地降低了冗余计算,同时保留了原始信息和处理后的高层语义信息,从而提升模型的效率和泛化能力。

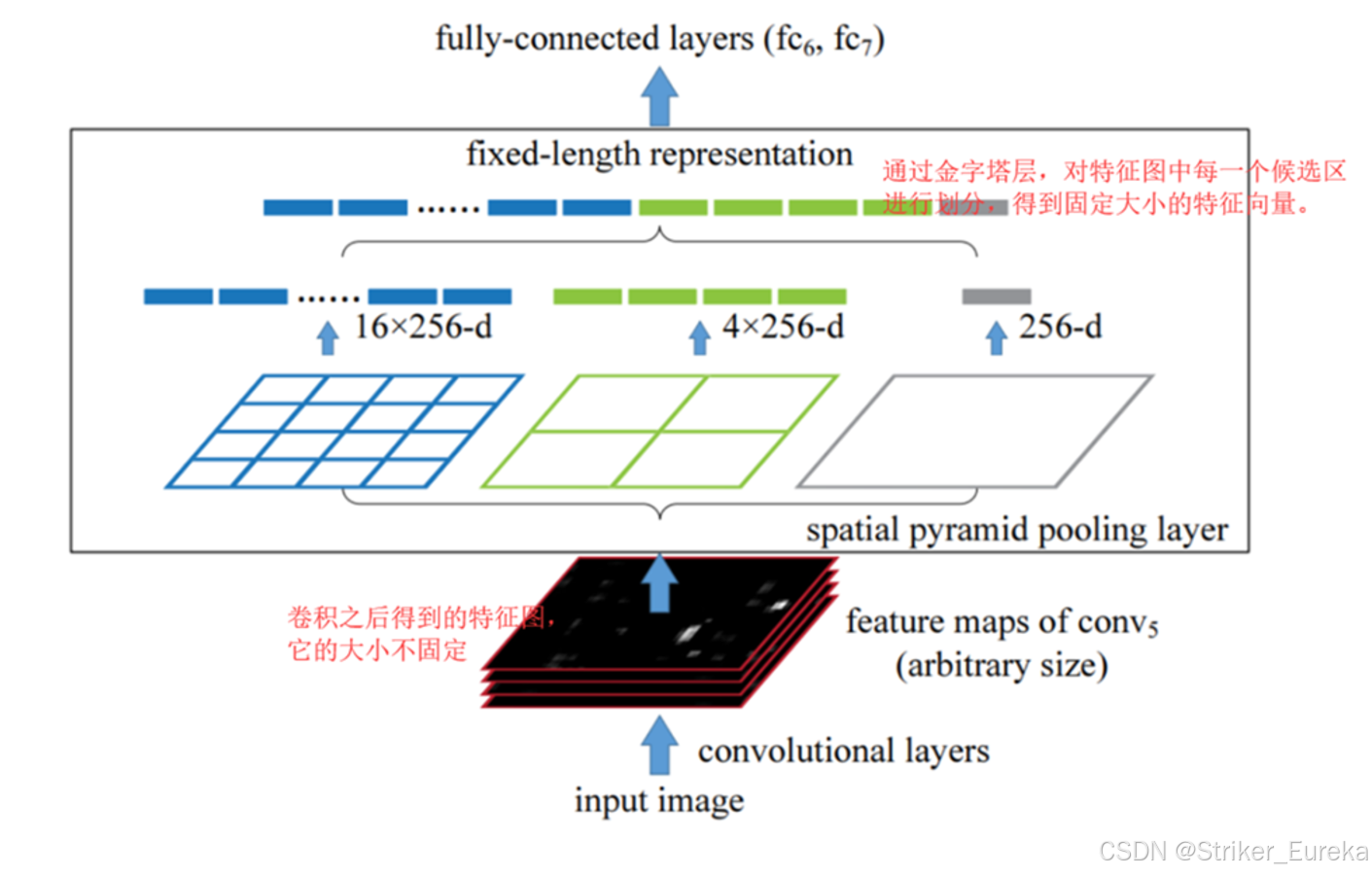

五.空间金字塔池化SPPNet

本身的核心思想不是直接通过多尺度特征融合来改进目标检测的精度,而是通过 空间金字塔池化(SPP) 层来处理不同尺度的图像特征,从而使得网络对不同尺寸的输入图像具有适应能力。

- SPP层将输入特征图划分为不同尺度的网格,并对每个网格内的特征进行池化(通常是最大池化或平均池化)。

- 这样,无论输入图像中的目标尺度如何变化,SPP层都能生成固定大小的特征表示,从而使得网络对目标的尺度变化具有鲁棒性。

说白了,就是对同一特征图进行不同尺度的池化操作,最后再将各自的结果给拼接起来而已,非常简单。

3152

3152

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?