1. 【前言】

如今各种视觉网络设计,包括卷积神经网络(Convolutional Neural Network)和视觉Transformer(Vision Transformer),都已经在计算机视觉领域取得了显著成效。但是这些网络中复杂的计算过程,又让我们难以进行实地部署,为实时应用造成困难。

研究人员试图从将模型轻量化或设计更高效的神经网络结构上入手解决上述问题,然而现有的模型在进行token混合时主要利用自注意力机制和卷积计算相结合,在轻量级网络中会造成性能上的限制,无法达到预算与实际效率间的最优平衡。

为此,来自CVRP2025的论文《LSNet: See Large, Focus Small》从人类的视觉系统中获得启发,基于人类可以捕捉大视场全景信息并将注意力引导至场景中特定小元素上的特点,提出了LS(Large-Small)卷积,通过大核感知(large-kernel perception)和小核聚合(small-kernel aggregation),在高效捕捉大范围视觉信息特征的同时,实现对动态、复杂的视觉特征的精确融合。基于LS卷积,论文中提出了一种轻量级模型LSNet,在多个领域上取得了卓越的性能。

2.【论文基本信息】

- 论文标题:LSBNet: See Large, Focus Small

- 论文链接:https://arxiv.org/pdf/2503.23135

3.【创新点概述】

3.1 LS 卷积: 受人眼视觉系统机制启发的多尺度卷积

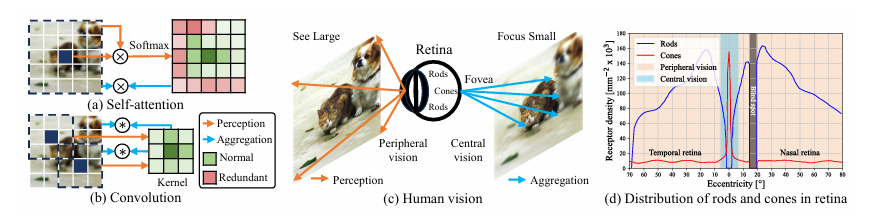

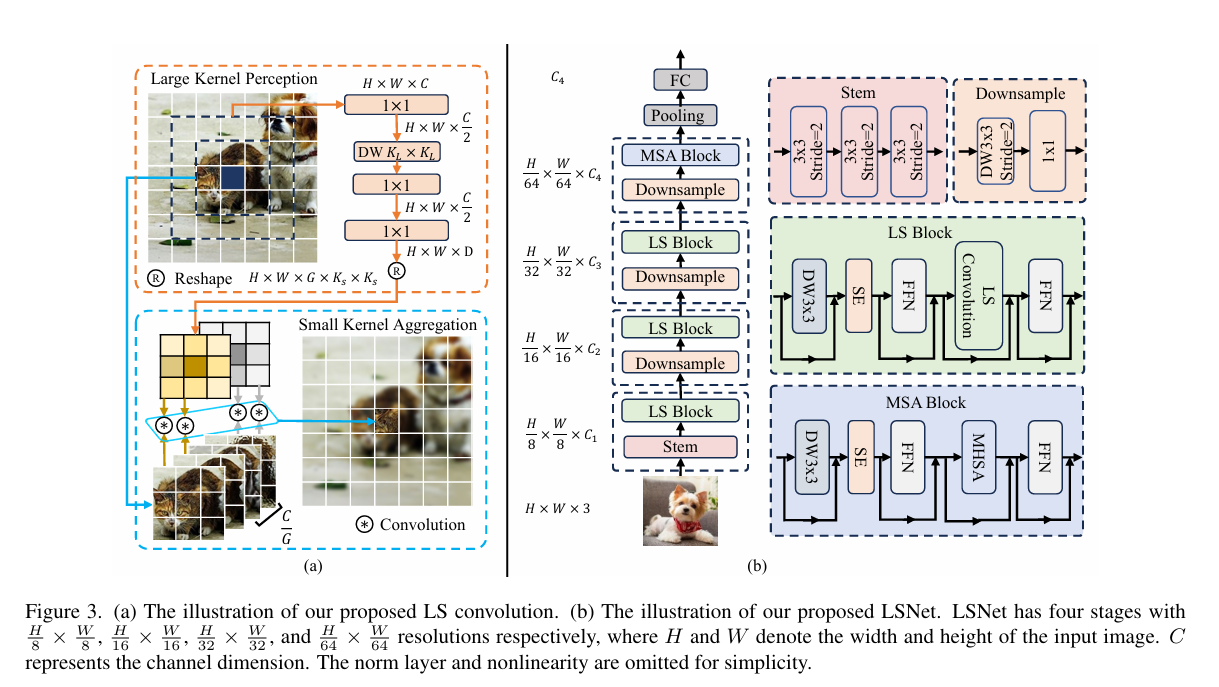

人眼视觉系统在捕获大场景信息的同时,通过聚焦的方式,将注意力引导集中在场景中的特定物体信息上,实现在接受大范围视觉信息特征的同时,可以利用聚焦的方式实现注意力的引导和集中。基于上述特点,本文提出了LS卷积,利用大尺寸深度卷积核感知(Large Kernel Perception, LKP)提取全局上下文信息,利用小尺寸核聚合(Small Kernel Aggregation, SKA),在局部区域内对信息进行精确融合。

3.2 轻量视觉网络LSNet

基于LS卷积,本文提出了轻量级网络LSNet。LSNet网络由包含LS卷积和前向反馈网络FFN的LS卷积层、 下采样层和多头注意力层等结构组成,与其他轻量级视觉网络相比,在多个任务上具有较强竞争力。

4.【整体架构流程】

4.1 Large Kernel Perception (LKP)大尺寸核感知

对与输入特征图

X

∈

R

H

×

W

×

C

X \in \mathbb{R}^{H \times W \times C}

X∈RH×W×C,分别进行逐点卷积操作(point-wise convolution, PW)和大尺寸核深度卷积(large-kernel depth-wise convolution, DW),在降低特征空间维度、减少计算消耗的同时,充分提取像素点与周围位置间的特征信息关联,实现对大尺度范围特征的提取。利用上述操作,LKP层可以为输入特征图中的每个像素点

x

i

x_i

xi赋予特定权重值

w

i

w_i

wi,权重矩阵

W

W

W中包含了像素点的特征信息程度,并为后续对局部特征进行重点关注的SKA操作提供重要输入指标。

w

i

w_i

wi的计算可以用下面的公式进行表示:

w

i

=

P

l

s

(

x

i

,

N

K

L

(

x

i

)

)

=

PW

(

DW

K

L

×

K

L

(

PW

(

N

K

L

(

x

i

)

)

)

)

\begin{aligned} w_{i} & =\mathcal{P}_{l s}\left(x_{i}, \mathcal{N}_{K_{L}}\left(x_{i}\right)\right) \\ & =\operatorname{PW}\left(\operatorname{DW}_{K_{L} \times K_{L}}\left(\operatorname{PW}\left(\mathcal{N}_{K_{L}}\left(x_{i}\right)\right)\right)\right) \end{aligned}

wi=Pls(xi,NKL(xi))=PW(DWKL×KL(PW(NKL(xi))))

4.2 Small Kernel Aggrgation(SKA)小尺寸核聚合

在SKA过程中,本文使用了小核对特征进行精细的聚合。在聚合过程中,并没有仅使用静态的小尺寸核进行卷积,而是采用了动态卷积(dynamic convolution)的方式,可以根据LKP的结果,动态调整卷积核对应权重,让模型能更好的集中于局部特征信息上;同时,本文也提出了分组卷积(group convolution)的操作运算,在卷积过程中,将特征图与卷积间相互对应的通道信息进行分组卷积,可以进一步降低计算复杂度。SKA的计算过程可以用下面的公式进行表示:

y

i

c

=

A

l

s

(

w

i

g

∗

,

N

K

S

(

x

i

c

)

)

=

w

i

g

∗

⊛

N

K

S

(

x

i

c

)

y_{i c}=\mathcal{A}_{l s}\left(w_{i g}^{*}, \mathcal{N}_{K_{S}}\left(x_{i c}\right)\right)=w_{i g}^{*} \circledast \mathcal{N}_{K_{S}}\left(x_{i c}\right)

yic=Als(wig∗,NKS(xic))=wig∗⊛NKS(xic)

5.【实验结果】

5.1 在图像分类任务上的表现

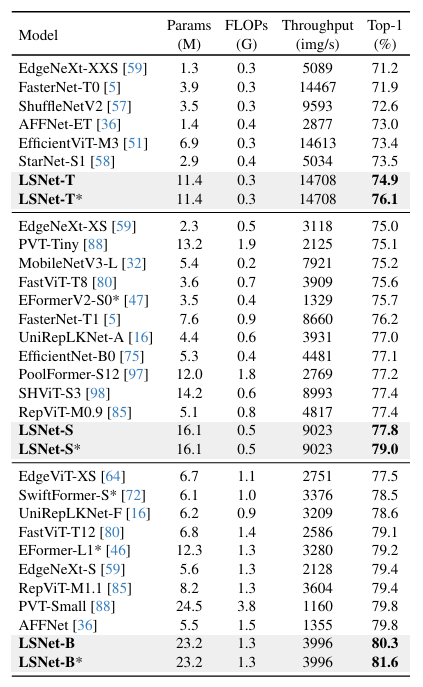

在多项视觉任务上,本文对LSNet提供了三种不同参数大小的网络LSNet-T,LSNet-S和LSNet-B,以及利模型蒸馏后的实验结果,对分别与对应参数级模型进行性能对比。

- 实验设置:在ImageNet-1K数据集上,利用Nvidia RTX 3090对不同模型进行训练对比

- 结果: 实验结果显示,不论是那种参数量级的LSNet网络,都在给任务上取得了SOTA的性能,并在三种模型量级上分别可以取得2.6%、1.6%和1.8%的准确率提升。

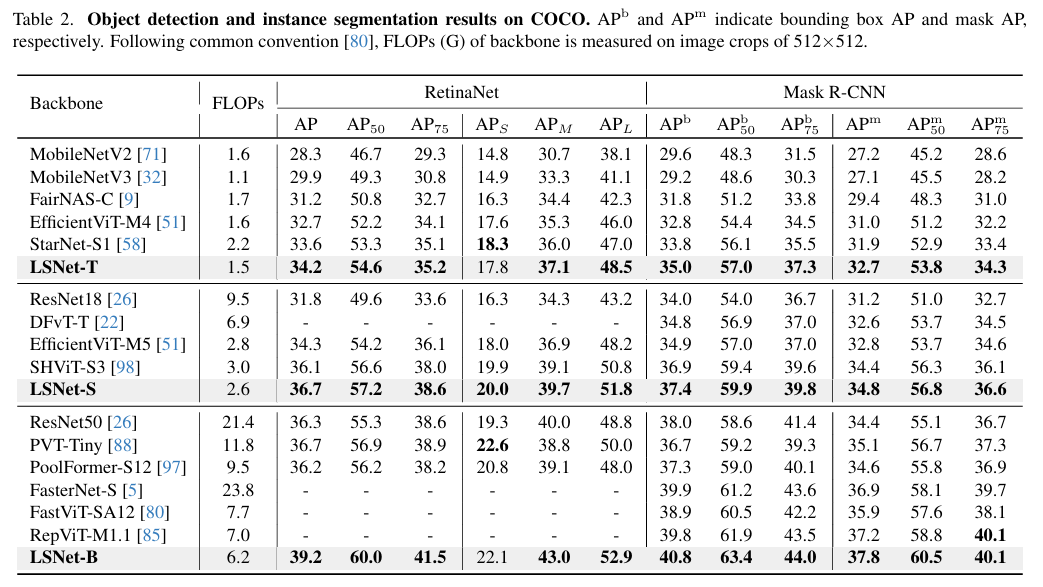

5.2 在下游任务上的表现

本文针对物体检测和实例分割两项下游任务,在COCO数据集上进行网络模型间的性能对比,实验结果表明,LSNet网络在绝大多数条件下,均可以达到SOTA的性能效果

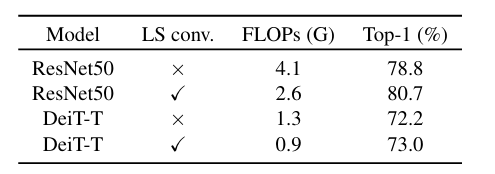

5.3 消融实验

本文在两种不同的网络架构ResNet50和DeiT-T中,将

3

×

3

3\times3

3×3卷积层和自注意力层替换为LS卷积,对LS卷积的性能进行了消融实验测试。消融实验结果表明,使用LS卷积后,分别可以为两种模型在Top-1准确率上带来1.9%和0.8%的性能提升,展示了LS卷积与传统卷积和自注意力机制机制间性能上的提升。

5.4 关键结论

- 有效性:LSNet在图像分类、物体识别和实例分割等任务中,与其他轻量级网络相比,均能带来更好的性能;同时,在不同的网络架构中使用LS卷积,也可以带来不同程度上性能的进一步提升。

- 效率:LSNet网络通过LKP,SKA等模块设计,在保证模型充分提取全局信息并能针对局部信息的同时,对模型进行轻量化设计减少了模型的计算复杂度。

6.【论文总结展望】

总结

-

LSNet 实现了从人类视觉机制中汲取灵感的“看得广、看得准”的建模策略,兼顾了性能与效率:

-

LS卷积:大感知 + 小聚合,突破卷积感受野限制;

-

高性能:在多个任务上优于现有轻量模型;

展望

-

未来可扩展到 视频理解、行为识别、多模态融合等场景;

-

与 ViT 或状态空间模型结合,兼顾感知广度与建模深度;

-

在边缘设备上部署 LSNet,有望成为 下一代轻量主干网络新标杆!

关注下方《AI前沿速递》🚀🚀🚀

各种重磅干货,第一时间送达

码字不易,欢迎大家点赞评论收藏

525

525

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?