前言

在充满活力的人工智能(AI)世界中,开源工具已成为开发人员和组织利用LLM(大型语言模型)力量的重要资源。这些工具通过提供对高级LLM模型的访问权限,使各种用户能够构建创新和前沿的解决方案。在众多可用的开源工具中,有两个平台脱颖而出:Ollama和LocalAI。Ollama和LocalAI都是功能强大且多功能的平台,提供了丰富的功能和能力。在这篇博客文章中,我们将深入比较Ollama和LocalAI,探讨它们的功能、能力和实际应用。

Ollama:开创性的本地大型语言模型

Ollama是一个创新的工具,旨在在本地运行像Llama 2和Mistral这样的开源LLM。这个开创性平台通过将模型权重、配置和数据集捆绑到一个由Model文件管理的统一的包中,简化了运行LLM的复杂过程。Ollama模型库提供了广泛的模型选择,如LLaMA-2、未审查的LLaMA、CodeLLaMA、Falcon、Mistral、Vicuna、WizardCoder和Wizard未审查 - 因此您肯定会为您的下一个项目找到完美的匹配。

特点和能力

- GPU加速:利用其支持GPU加速的能力来加快您的语言建模任务 - 让您更快速、更高效地探索AI创新的可能性。

- 轻松的模型管理:它通过将模型权重、配置和数据集集成到一个由Model文件管理的统一的包中,简化了运行LLM的复杂过程 - 提供无缝访问语言建模的最新进展。

- 自动内存管理:其智能内存管理系统自动为您的模型分配内存,确保您永远不会用完空间。此功能使您可以专注于研究,而不必担心内存限制。

- 支持广泛的模型:Ollama因其与各种模型的广泛兼容性而脱颖而出,包括Llama 2、Mistral和WizardCoder等著名模型。这种兼容性确保用户可以方便地接触语言建模技术前沿。Ollama包容性的方法简化了探索和使用该领域最新进展的过程,使其成为那些热衷于保持在AI研究和开发前沿的用户的理想平台。

- 轻松设置和无缝切换:Ollama以其用户友好的设置过程脱颖而出,从安装开始即可使用。Ollama的一个显著优势是用户可以轻松在不同的模型之间切换。这种简单明了的方法对于那些需要频繁更改的用户特别有益,因为它没有停机时间,也不需要复杂的重新配置。

- 可访问的Web用户界面(WebUI)选项:Ollama没有官方的WebUI,但有几个可用的WebUI选项可以使用。其中一个选项是Ollama WebUI,可以在GitHub上找到 - Ollama WebUI。它提供了一个简单易用的用户界面,使其成为用户的可访问选择。

LocalAI:OpenAI的开源替代品

LocalAI提供了一个无缝的、无需GPU的OpenAI替代品。它是一个完整的REST API替代品,兼容OpenAI的本地推理规范。在消费级硬件上运行LLM、生成内容并探索AI的力量。由Ettore Di Giacinto开发并由Mudler维护,LocalAI将AI民主化,使其对所有人均能访问。

特点和能力

- GPU加速:它可以在没有GPU加速的情况下运行,但如果有的话可以利用它。利用GPU加速可以提高计算速度和能效。这种设置还可以适应大型LLM模型。

- 密集型模型管理:LocalAI处理大型语言模型的方法涉及一种手动、详细的方法论。用户需要直接与AutoGPTQ、RWKV、llama.cpp和vLLM等各种后端系统进行交互,这使得可以进行更多的定制和优化。这种管理风格要求细致的配置、定期更新和维护,因此需要更高的技术水平。它提供了对模型的增强控制,使用户可以精确地将其定制以满足特定需求并实现最佳性能。

- 资源密集型内存管理:LocalAI与依赖GPU支持的系统不同,其主要利用CPU进行其进程。这种方法可能会给CPU带来巨大压力,特别是因为它至少需要10GB的RAM才能有效运行。LocalAI中的所有模型都通过CPU本地下载和执行,导致大量内存消耗。为了管理这种高内存使用情况,用户可以实施GPU加速。虽然这可以减轻CPU的一些负担,但它需要用户主动进行内存管理,以确保资源的有效分配和使用以保持最佳性能。

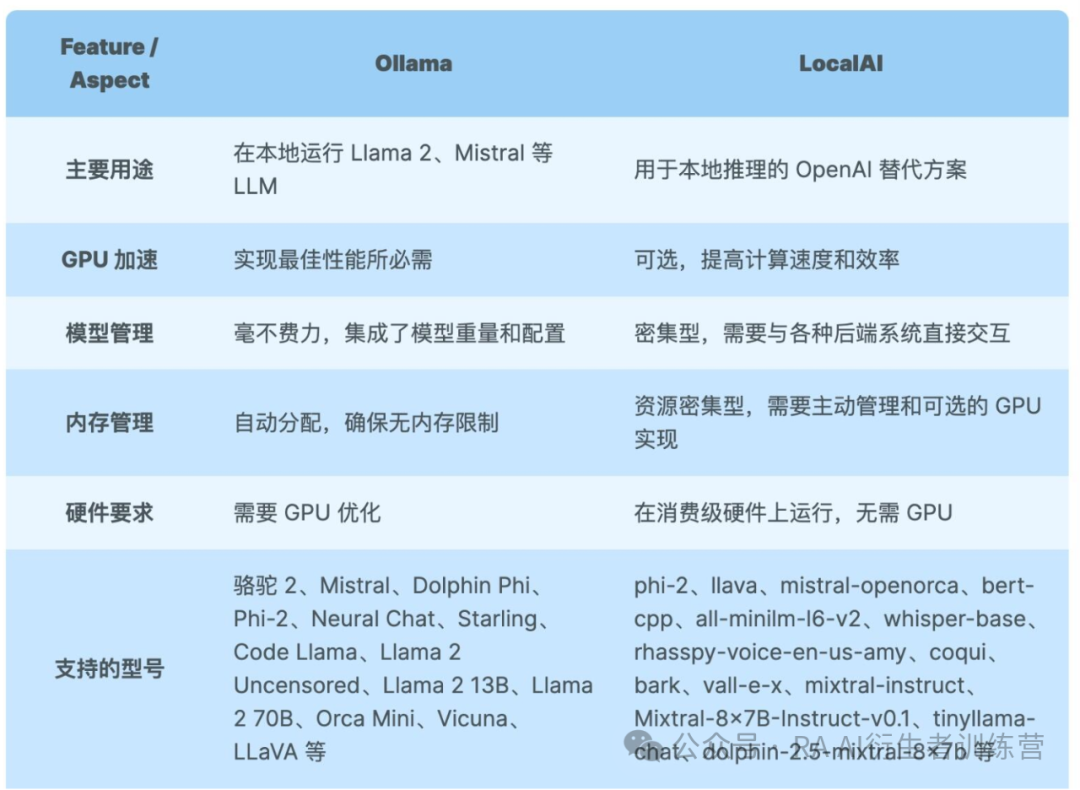

Ollama与LocalAI对比

结论

在选择Ollama和LocalAI之间时,重要的是要考虑您的特定需求和要求,以及您可用的硬件资源。

Ollama是一个专门针对运行某些大型语言模型(LLMs)进行优化的工具,例如Llama 2和Mistral,具有高效和精确性。因此,它需要GPU才能提供最佳性能。如果您有访问GPU的权限,并且需要一个强大而高效的工具来运行LLMs,那么Ollama是一个绝佳的选择。

另一方面,LocalAI是一个多功能的开源平台,为本地推理提供了OpenAI产品的替代方案。它不需要GPU,可以在消费级硬件上运行,使其成为没有访问高端计算资源的开发人员更易访问的选择。LocalAI支持广泛的模型格式和类型,使其成为一个灵活方便的工具,用于构建和部署AI解决方案。

总之,如果您需要一个易于使用的工具来高效、精确地运行LLMs,那么Ollama是首选选项;而LocalAI则是一个用户友好的替代品,用于在消费级硬件上进行本地推理。这两个工具代表了开源AI社区的重大进步,并为不同的用户需求提供了强大的解决方案。

欢迎你分享你的作品到我们的平台上. http://www.shxcj.com 或者 www.2img.ai 让更多的人看到你的才华。

创作不易,觉得不错的话,点个赞吧!!!

321

321

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?