作者丨马赫WGH@知乎

来源丨https://zhuanlan.zhihu.com/p/409884870

编辑丨3D视觉工坊

一、算法解析

这篇论文致力于解决动态环境下的建图问题。

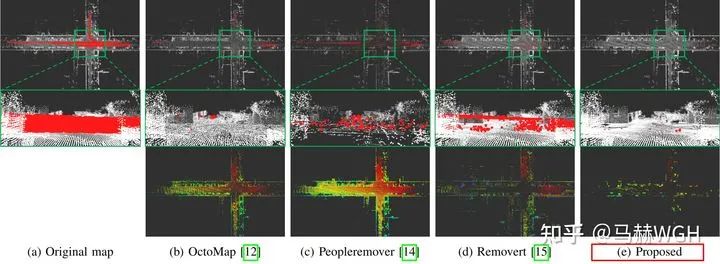

在以「城市开阔道路」为代表的动态环境下建图时,不可避免地会遇到动态物体的干扰,如行人、车辆等;这些动态物体在点云地图中形成的“鬼影”有害于后续的定位或导航任务。本文提出了一套算法 —— ERASOR,能够有效滤除地图中的“鬼影”。ERASOR 并不是在SLAM过程中在线地滤除动态点云,而是在SLAM构建好点云地图后,对地图进行一遍后处理,以达到目的。根据对比,ERASOR 明显优于已有的动态物体过滤算法,如下图所示。

图1. ERASOR与其它算法的对比

论文:https://arxiv.org/abs/2103.04316

ERASOR 是论文标题 "Egocentric RAtio of pSeudo Occupancy-based dynamic object Removal for Static 3D Point Cloud Map Building" 的缩写,这个标题直译为中文的话会很词不达意,但如果你读过 Scan Context 这篇paper 且理解 egocentric ratio 是什么的话,就不难理解这个标题了。

我将这个标题意译为:“如何构建静态地图:基于栅格中点云分布之差异的动态物体过滤方法”。

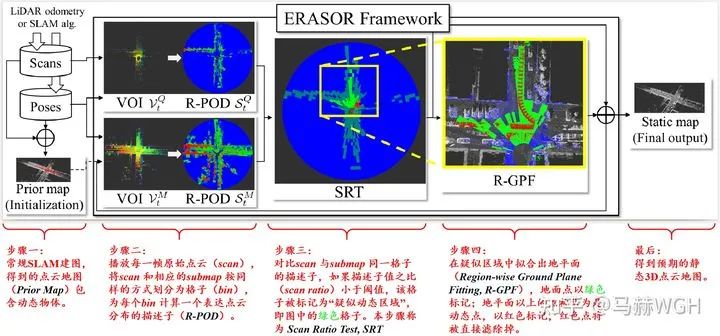

以下是 ERASOR 的算法框架,并不复杂,图片中的红色文字是我对算法各个环节的注释。下面稍微展开阐述一下。

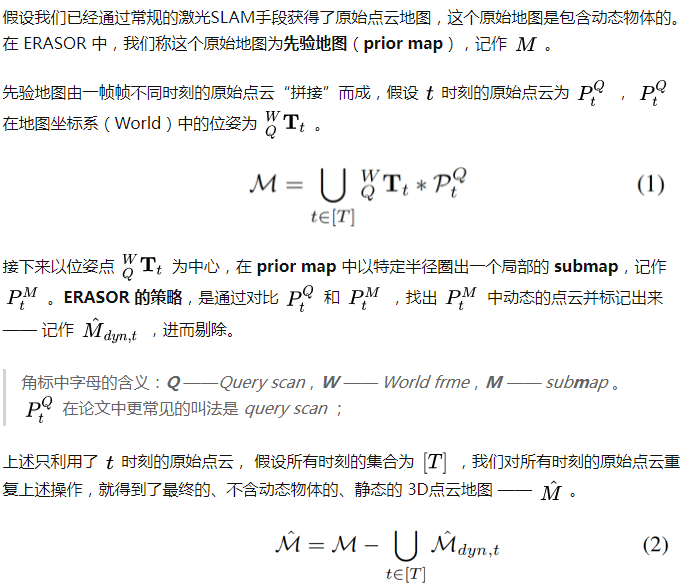

A. 问题定义与符号系统

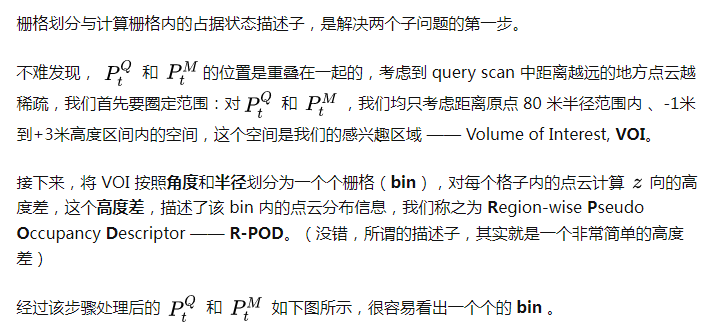

B. 栅格划分与占据状态描述子计算(R-POD)

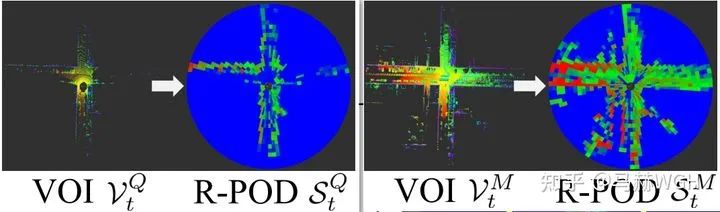

C. 根据描述子对比筛选潜在动态区域(SRT)

对所有的 bin 做 SRT 之后,得到的结果如下图所示,绿色区域是筛选出的潜在动态 bins。

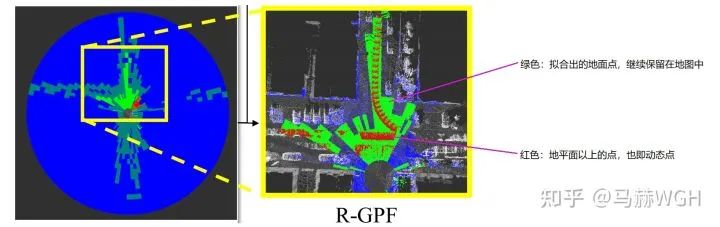

D. 地面拟合&动态点滤除(R-GPF)

接下来要做的工作,就是在潜在动态 bin 中,拟合出地面点,然后地平面以上的点,全部作为动态点滤除掉。所以本环节的核心,是如何准确地拟合出 bin 内的地平面。

注意我们上文提到的假设条件:所有的动态物体都是位于地面上的,所以潜在动态 bin 中的点,如果不属于地面,就属于动态物体。每个 bin 内的地面拟合是独立进行的,并不会参考其它 bin 中的地面分布。作者认为这种方式会更准确,因为参考整个地图的地平面拟合,可能因斜坡、路沿等的影响而失败,但在 bin 内这样一个局部空间中,斜坡的斜度可以被忽略,仍呈现出平面特征。

拟合地平面的具体方法是先选出高度最低的若干个点作为种子点,向上进行3次区域生长,找出的点为地面点。然后,用主成分分析法(Principal Component Analysis, PCA)计算地面点云的特征值和特征向量,则特征值最小的那个特征向量,最有可能是地面的法向量,据此算出地平面的平面方程。这个地面提取方法称为 Region-wise Ground Plane Fitting, R-GPF。最后将地平面以上的点作为动态点移除,结果如下图所示。

备注:感谢微信公众号「3D视觉工坊」整理。

E. ERASOR 算法小结

最后概括一下 ERASOR 的算法流程:

1.找出 query scan 对应的 submap,将两者的物理空间按相同的方式划分为一个个 bin;

2.为每一个 bin 计算占据状态描述子(点云高度差);

3.找出那些描述子之比<0.2 的 bin,作为潜在动态 bins;

4.在每一个潜在动态 bin 中拟合地平面,将地平面以上的点作为动态点滤除;

5.done!

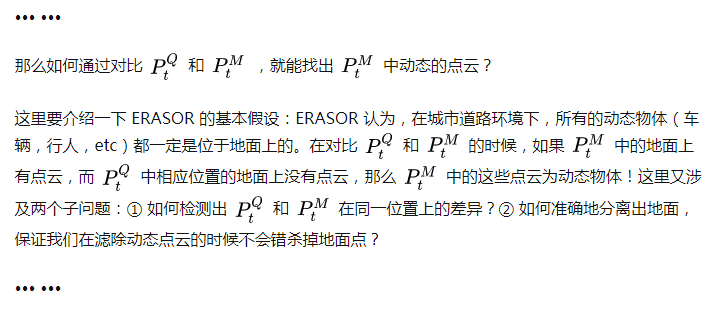

··· ···

F. 个人评价

ERASOR 的算法原理并不复杂,且代码也已开源,比较适合做demo验证。

可以看出,ERASOR 的效果依赖较为严格的假设:所有的动态物体必须位于地平面上,高度区间必须为 -1~3米之间。这一假设在标准的开阔公路路面上能够满足,但在其它不规则的环境下有很大的失效风险。

二、Related Works:SLAM中的动态物体过滤算法综述

常规的动态物体过滤方法按策略可以分为两类:(一)SLAM过程中在线去除动态点云,考虑了过往帧的信息(局部信息);(二)用后处理的方式,考虑整个地图提供的信息(全局信息),去除动态点云。

第一类策略可以细分为以下三种方法。

① segmentation-based。该类方法通常基于聚类,比如,Litomisky等人基于确定视角下的特征分布直方图(VFH, Viewpoint Feature Histogram)来从静态聚类中区分出动态聚类;Yin等人则认为相邻帧配准过程中匹配误差较大的点很可能是动态点,用这些点作为种子进行区域生长,搜索出的聚类既是动态聚类;此外,Yoon等人也提出了一种基于区域生长过滤动态聚类的方案。基于分割的方法中不得不提的还有基于深度学习的语义分割方法(deep-learning based semantic segmentation),语义分割直接label出了哪些点是动态物体,建图算法只需要直接弃掉这些点即可,简单粗暴。但是,深度学习只能分割出训练过的动态类别,对其它类别的动态物体则无能为力。

② ray tracing-based。这类方法非常典型地要结合栅格去实现,可以是普通的占据栅格或者八叉树栅格。其基本原理是,激光点打到的cell,hits计数+1,激光光束穿过的cell,misses计数+1,通过hits和misses计算cell的占据概率,占据概率低于阈值,则抹除掉这个cell内的所有点。这种方法利用了动态点只会短暂地hit到某个cell,这个cell在随后的大部分时间里都会被miss的特点。这种方法的缺点是消耗计算资源,毕竟一个激光点不仅产生了一个hit,更会在光路上产生非常多的misses!当然,ray tracing-based method也可以用后处理的方式去做,比如Cartographer 3D。

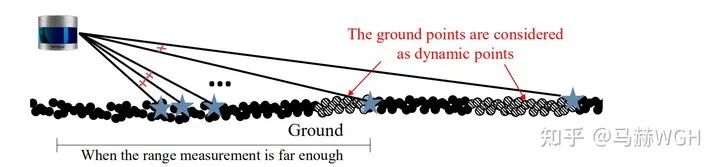

③ visibility-based (基于可见性的方法)。这类方法的基本假设是:如果一个新激光点会穿过某个旧激光点的位置(共线),那么这个旧激光点就是动态点。这个假设逻辑上说得通,但实现起来有两个问题:其一,入射角接近90度时的误杀问题,如下图所示,红色箭头指向的旧点因为与新激光点(五角星)光路很接近,会被误杀掉,考虑到激光点测量本身的角度误差、测距误差、光斑影响等,这种误杀会更严重。其二,遮挡问题,比如对于一些大型动态物体,它们完全挡住了激光雷达的视线,激光雷达没有机会看到这些动态物体后方的静态物体,意味着这些动态点永远不会被新的激光点穿过,此时就绝无可能把这些动态点滤除掉了。

本文提出的 ERASOR 按策略属于第二类,其实上述一些第一类的方法也可以按后处理的方式去用,并不局限。

本文仅做学术分享,如有侵权,请联系删文。

3D视觉精品课程推荐:

1.面向自动驾驶领域的多传感器数据融合技术

2.彻底搞透视觉三维重建:原理剖析、代码讲解、及优化改进

3.国内首个面向工业级实战的点云处理课程

4.激光-视觉-IMU-GPS融合SLAM算法梳理和代码讲解

5.彻底搞懂视觉-惯性SLAM:基于VINS-Fusion正式开课啦

6.彻底搞懂基于LOAM框架的3D激光SLAM: 源码剖析到算法优化

7.彻底剖析室内、室外激光SLAM关键算法原理、代码和实战(cartographer+LOAM +LIO-SAM)

干货领取:

1. 在「3D视觉工坊」公众号后台回复:3D视觉,即可下载 3D视觉相关资料干货,涉及相机标定、三维重建、立体视觉、SLAM、深度学习、点云后处理、多视图几何等方向。

2. 在「3D视觉工坊」公众号后台回复:3D视觉github资源汇总,即可下载包括结构光、标定源码、缺陷检测源码、深度估计与深度补全源码、点云处理相关源码、立体匹配源码、单目、双目3D检测、基于点云的3D检测、6D姿态估计源码汇总等。

3. 在「3D视觉工坊」公众号后台回复:相机标定,即可下载独家相机标定学习课件与视频网址;后台回复:立体匹配,即可下载独家立体匹配学习课件与视频网址。

重磅!3DCVer-学术论文写作投稿 交流群已成立

扫码添加小助手微信,可申请加入3D视觉工坊-学术论文写作与投稿 微信交流群,旨在交流顶会、顶刊、SCI、EI等写作与投稿事宜。

同时也可申请加入我们的细分方向交流群,目前主要有3D视觉、CV&深度学习、SLAM、三维重建、点云后处理、自动驾驶、多传感器融合、CV入门、三维测量、VR/AR、3D人脸识别、医疗影像、缺陷检测、行人重识别、目标跟踪、视觉产品落地、视觉竞赛、车牌识别、硬件选型、学术交流、求职交流、ORB-SLAM系列源码交流、深度估计等微信群。

一定要备注:研究方向+学校/公司+昵称,例如:”3D视觉 + 上海交大 + 静静“。请按照格式备注,可快速被通过且邀请进群。原创投稿也请联系。

▲长按加微信群或投稿

▲长按关注公众号

3D视觉从入门到精通知识星球:针对3D视觉领域的视频课程(三维重建系列三维点云系列结构光系列、手眼标定、相机标定、orb-slam3知识点汇总、入门进阶学习路线、最新paper分享、疑问解答五个方面进行深耕,更有各类大厂的算法工程人员进行技术指导。与此同时,星球将联合知名企业发布3D视觉相关算法开发岗位以及项目对接信息,打造成集技术与就业为一体的铁杆粉丝聚集区,近2000星球成员为创造更好的AI世界共同进步,知识星球入口:

学习3D视觉核心技术,扫描查看介绍,3天内无条件退款

圈里有高质量教程资料、答疑解惑、助你高效解决问题

觉得有用,麻烦给个赞和在看~

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?