标准卷积、分组卷积、深度卷积(此处可能指的是深度可分离卷积中的深度卷积部分)以及深度可分离卷积在深度学习中各有其特点和应用场景,以下是它们之间的主要区别:

一、标准卷积

-

定义:标准卷积是一种在输入特征图上应用卷积核,以生成输出特征图的操作。卷积核在输入特征图上滑动,计算每个位置的点积,生成新的特征图。

-

特点:

- 能够有效地提取输入数据的局部特征,通过多层卷积可以提取更高级的特征。

- 参数共享,卷积核在输入特征图上滑动时共享参数,减少了模型的参数数量,提高了计算效率。

- 具有平移不变性,即对输入数据的平移变化具有一定的鲁棒性。

- 计算量和参数数量相对较大,特别是在输入特征图和卷积核的尺寸较大时。

二、分组卷积

-

定义:分组卷积通过将输入特征通道分为若干组,并在每组内单独进行卷积操作,可以减少计算复杂度和参数量,同时有效利用模型的结构特性。

-

特点:

- 将输入特征图按通道数分组,每组使用自己的卷积核进行卷积操作。

- 输出特征图由各组的卷积输出按通道维度拼接而成。

- 当分组数等于输入通道数时,分组卷积变为深度卷积(但这里的深度卷积通常指的是深度可分离卷积中的一部分,与下文中的深度卷积有所区别,此处需注意)。

- 相比标准卷积,分组卷积能够显著减少计算量和参数数量。

三、深度卷积(深度可分离卷积的一部分)

-

定义:深度卷积是深度可分离卷积的第一步,它对每个输入通道单独进行卷积操作,不跨通道进行卷积。

-

特点:

- 每个卷积核只作用于一个输入通道。

- 输出特征图的通道数与输入特征图的通道数保持一致。

- 相比标准卷积,深度卷积的计算量和参数数量更少。

- 但由于不跨通道进行卷积,因此可能忽略了一些通道间的关联特性。

四、深度可分离卷积

-

定义:深度可分离卷积将标准卷积分解为两个独立的步骤:深度卷积和逐点卷积(通常是1x1卷积)。

-

特点:

- 深度卷积对每个输入通道单独进行卷积操作。

- 逐点卷积使用1x1卷积核对深度卷积的输出进行通道混合,生成新的特征图。

- 相比标准卷积,深度可分离卷积能够显著减少计算量和参数数量,同时保持相对较高的性能表现。

- 广泛应用于移动设备和嵌入式设备上,尤其是MobileNet等轻量级模型中。

五、深度卷积、标准卷积和分组卷积计算量对比

假设输入特征图的尺寸为 H×W×C 输出通道为N

在输入特征图尺寸为 H×W×C 且输出通道为 N 的情况下,深度卷积(Depthwise Convolution)、标准卷积(Standard Convolution)和分组卷积(Grouped Convolution)的计算量可以进行如下对比:

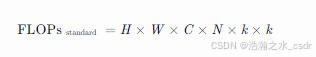

4.1. 标准卷积计算量

标准卷积中,每个输出通道都是由所有输入通道通过卷积核计算得到的。假设卷积核的大小为 k×k,则标准卷积的计算量可以表示为:

这里,H 和 W 分别是输入特征图的高度和宽度,C 是输入通道数,N 是输出通道数,k 是卷积核的大小。标准卷积需要对每个输出通道进行完整的卷积操作,因此计算量相对较大。

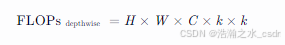

4.2. 深度卷积计算量

深度卷积中,每个输入通道都使用单独的卷积核进行卷积操作,并且每个输入通道对应一个输出通道(这里没有额外的输出通道数参数,因为深度卷积的输出通道数通常与输入通道数相同,但在此对比中,我们假设输出通道数为 N,这意味着在深度卷积后可能需要一个额外的 1×1 卷积来调整通道数)。然而,为了公平对比,我们只考虑深度卷积本身的计算量,不考虑后续的 1×1 卷积。因此,深度卷积的计算量可以表示为:

注意,这里深度卷积实际上没有直接产生 N 个输出通道,但为了与标准卷积和分组卷积的计算量进行对比,我们暂时忽略这一点,并在后续讨论中说明。在实际应用中,深度卷积后通常会接一个 1×1 卷积(即逐点卷积)来调整通道数至 N。

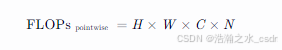

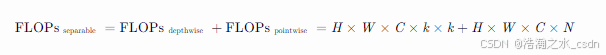

4.3. 深度可分离卷积计算量

深度可分离卷积由深度卷积和逐点卷积两部分组成。深度卷积的计算量如上所述,而逐点卷积(1x1卷积)的计算量可以表示为:

(这里C是深度卷积后的输出通道数,也即输入特征图的通道数,因为逐点卷积是在深度卷积的基础上进行的)

因此,整个深度可分离卷积的计算量为深度卷积和逐点卷积计算量之和:

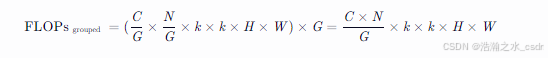

4.4. 分组卷积计算量

分组卷积将输入通道分成多个组,每个组内的输入通道使用相同的卷积核进行卷积操作。假设分组数为 G,则每个组内的输入通道数为 C/G(假设 C 能被 G 整除),每个组内的输出通道数为 N/G(同样假设 N 能被 G 整除)。因此,分组卷积的计算量可以表示为:

分组卷积的计算量取决于分组数 G。当 G=1 时,分组卷积退化为标准卷积;当 G=C 时(且 N=C 或成比例),分组卷积变为深度卷积(但通常深度卷积后还会接一个 1×1 卷积来调整通道数)。

4.5. 计算量对比

-

深度卷积 vs 标准卷积:

- 在相同输入特征图、卷积核大小和输出通道数的情况下,深度卷积的计算量比标准卷积小得多。具体来说,深度卷积的计算量是标准卷积计算量的 1/N 倍(如果仅考虑深度卷积本身,不考虑后续的 1×1 卷积)。然而,在实际应用中,深度卷积后通常会接一个 1×1 卷积来调整通道数,这部分计算量也需要考虑在内。

-

分组卷积 vs 标准卷积:

- 分组卷积的计算量取决于分组数 G。当 G 增加时,分组卷积的计算量逐渐减少。特别地,当 G=C 时(且 N=C 或成比例),分组卷积的计算量接近深度卷积(但不完全相同,因为深度卷积后通常还有 1×1 卷积)。然而,在实际应用中,分组卷积后也可能需要额外的卷积层来调整通道数或进行其他操作。

-

深度卷积(含 1×1 卷积)vs 分组卷积:

- 如果考虑深度卷积后接一个 1×1 卷积来调整通道数至 N,则整体计算量将增加。此时,深度卷积加 1×1 卷积的计算量可能与某些分组卷积的计算量相当或更大或更小,这取决于具体的分组数 G、输入通道数 C、输出通道数 N 以及卷积核大小 k。

4.6. 结论

在输入特征图尺寸为 H×W×C 且输出通道为 N 的情况下:

- 标准卷积的计算量最大,因为它对每个输出通道都融合了所有输入通道的信息。

- 深度卷积的计算量最小(如果仅考虑深度卷积本身),因为它对每个输入通道进行单独的卷积操作。然而,在实际应用中,深度卷积后通常会接一个 1×1 卷积来调整通道数,这部分计算量也需要考虑在内。

- 分组卷积的计算量介于标准卷积和深度卷积之间,取决于分组数 G。通过调整分组数,可以在计算量和模型性能之间取得平衡。

在实际应用中,应根据具体任务和数据集来选择合适的卷积方式和参数。

六、总结与对比

- 计算量:标准卷积的计算量最大,深度卷积的计算量最小(如果仅考虑深度卷积本身,不考虑后续的1x1卷积),分组卷积的计算量介于两者之间,取决于分组数。

- 模型性能:标准卷积能够融合各通道的信息,因此通常具有更好的模型性能;深度卷积由于对每个输入通道进行单独的卷积操作,模型性能可能稍差;分组卷积的模型性能取决于分组数和具体的网络结构。

- 应用场景:标准卷积适用于大多数常规的CNN任务;深度卷积广泛应用于轻量级模型和移动设备;分组卷积则在高效模型设计和特定任务(如图像分割、目标检测等)中有广泛应用。

综上所述,深度卷积、标准卷积和分组卷积在卷积神经网络中各有其独特的作用和适用场景。在实际应用中,应根据具体任务和数据集来选择合适的卷积方式和参数。

7811

7811

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?