点击下方卡片,关注“CVer”公众号

AI/CV重磅干货,第一时间送达

点击进入—>【目标跟踪】投稿交流群

添加微信号:CVer2233,小助手会拉你进群!

扫描下方二维码,加入CVer学术星球!可以获得最新顶会/顶刊上的论文idea和CV从入门到精通资料,及最前沿应用!发论文/搞科研/涨薪,强烈推荐!

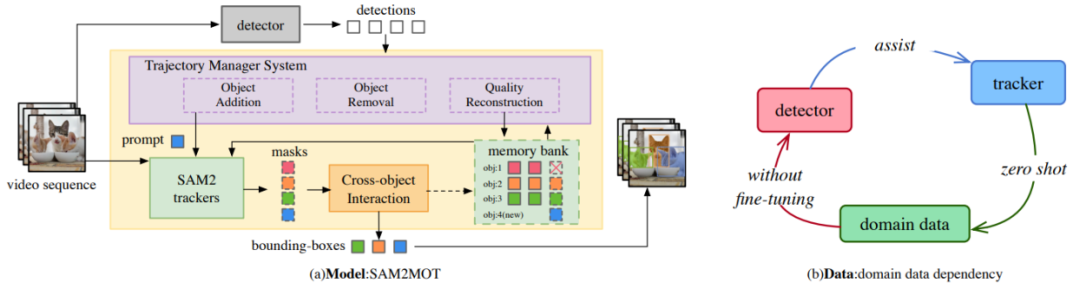

在计算机视觉领域,多目标跟踪一直是安全监控、自动驾驶等应用的核心技术。然而,传统方法依赖于目标检测的性能,需要针对不同场景单独构建数据进行训练或微调,并且常因遮挡、复杂运动以及光照变化等因素导致效果不佳。华为云盘古CV大模型团队提出的SAM2MOT架构,首次将分割策略作为核心,应用于多目标跟踪任务,成功将多目标跟踪与目标检测解耦。该架构在无需训练的模式下展现了更强的跟踪能力,并在多个基准数据集上实现了SOTA性能,彻底打破了传统方法的局限。

论文:https://arxiv.org/abs/2504.04519

代码:https://github.com/TripleJoy/SAM2MOT

一、为什么需要SAM2MOT

传统多目标跟踪方法的三大局限:

1. 数据依赖性强:现有方法通常依赖于为每个场景独立构建数据进行训练,使得模型无法在不同场景间灵活迁移,增加了训练成本和应用难度。

2. 遮挡与复杂运动问题:传统方法无法在目标遮挡或复杂运动的情况下持续保持准确性,通常需针对场景进行额外的设计。

3. 架构瓶颈明显:当前多目标跟踪架构将目标检测与跟踪紧密耦合,限制了其灵活性与扩展性。在复杂场景中,这种设计已无法满足更高的精度要求。

SAM2MOT的三大突破:

1. 无需训练:通过结合通用检测器与SAM2分割模型,SAM2MOT展现出强大的零样本能力,直接在不同场景中进行部署,即可实现SOTA精度。

2. 更强的跟踪性能:SAM2MOT利用分割的特性,并针对遮挡问题进行了通用创新设计,显著提升了目标关联能力。

3. 分割驱动的新架构:SAM2MOT打破传统方法的架构设计,首次将分割策略作为核心,提出基于分割的全新多目标跟踪范式。

二、SAM2MOT的创新设计

1. 分割驱动的目标自跟踪

SAM2MOT利用SAM2的分割能力,在视频流中对每个独立目标自生成完整轨迹,目标的跟踪框不再依赖于检测框,而是直接由目标分割掩码转换得到。

2. 多目标轨迹管理

SAM2MOT结合目标检测模型为独立目标提供初始化的提示信息,并严格管理目标的新增、删除与质量重建,确保在控制误报的同时,达到最佳跟踪效果。

3. 目标间通信

SAM2MOT引入跨目标交互机制,能够准确识别目标间遮挡情况,并判断是否存在因遮挡而导致的错误跟踪,进而通过筛选memory bank中的记忆信息来解决该问题。

三、性能碾压,全面超越主流方法

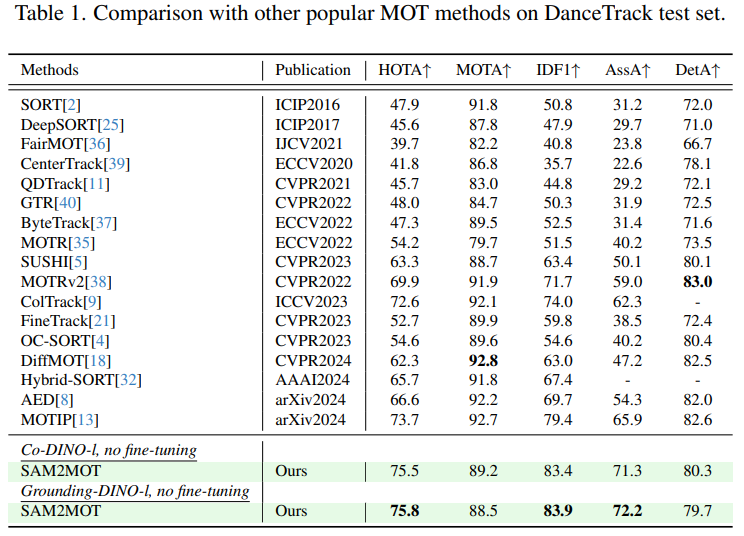

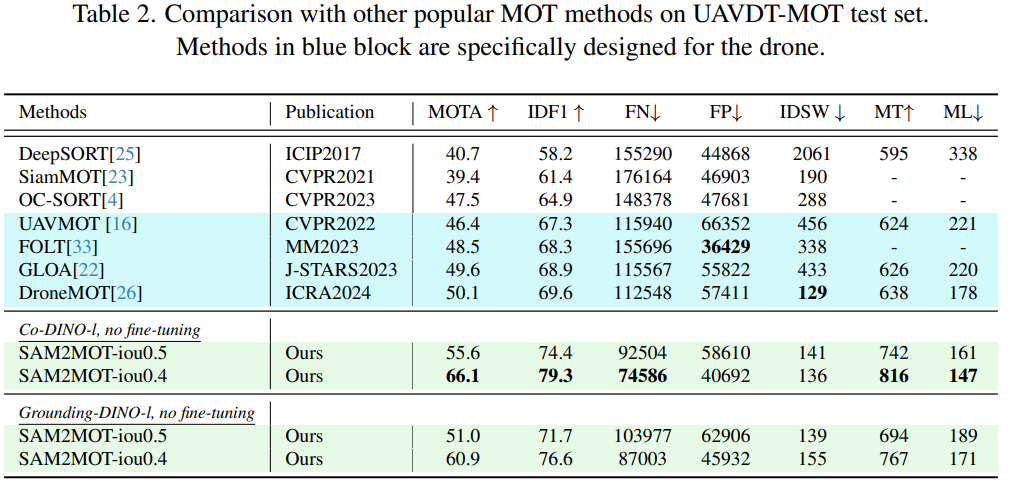

SAM2MOT在多个基准数据集上展现了卓越性能,验证了其技术优势。在DanceTrack测试集上的实验结果表明,SAM2MOT在HOTA和IDF1指标上分别超越现有方法+2.1和+4.5。在UAVDT-MOT测试集上,SAM2MOT的MOTA和IDF1指标分别领先+16.0和+9.7。另一方面,SAM2MOT通过使用闭集模型Co-DINO和开集模型Grounding-DINO两种目标检测模型进行验证。这些模型均仅在COCO数据集上进行预训练,并未在各评估数据集上进行微调。不论使用哪种检测模型,SAM2MOT都展现出稳定且高质量的跟踪性能,验证了该架构与目标检测模型的充分解耦,体现了其卓越的鲁棒性。

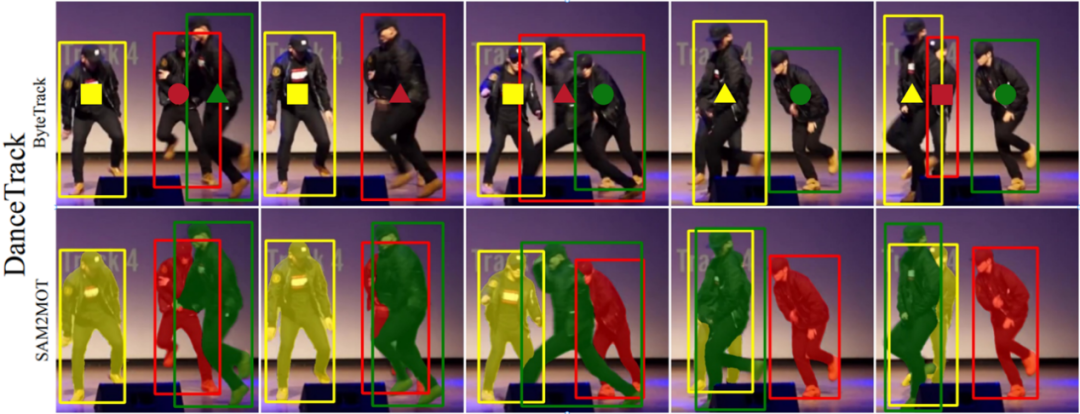

四、可视化比较

通过与传统ByteTrack方法的可视化比较,可以看出,在目标发生遮挡时,SAM2MOT凭借分割能力展现出更强的鲁棒性。

五、落地场景

1. 安全监控:实时监控多个目标,快速响应潜在威胁,有效保障公共安全。

2. 自动驾驶:精准识别并预测周围动态目标,提升决策精度和反应速度,确保行车安全。

3. 无人机巡检:实时识别并跟踪目标,提升巡检效率与精准度,广泛应用于基础设施维护。

六、结语

SAM2MOT提出了一种分割驱动的多目标跟踪新架构,突破了传统方法的局限,提升了跟踪性能。通过将分割作为核心策略,SAM2MOT有效解决了遮挡和复杂运动问题,展现出更强的鲁棒性。同时,SAM2MOT具备零样本能力,无需在不同场景中进行训练或微调,该特性减少了部署成本,推动了多目标跟踪技术的实际落地。

何恺明在MIT授课的课件PPT下载

在CVer公众号后台回复:何恺明,即可下载本课程的所有566页课件PPT!赶紧学起来!

CVPR 2025 论文和代码下载

在CVer公众号后台回复:CVPR2025,即可下载CVPR 2025论文和代码开源的论文合集ECCV 2024 论文和代码下载

在CVer公众号后台回复:ECCV2024,即可下载ECCV 2024论文和代码开源的论文合集目标跟踪交流群成立

扫描下方二维码,或者添加微信号:CVer2233,即可添加CVer小助手微信,便可申请加入CVer-目标跟踪微信交流群。另外其他垂直方向已涵盖:目标检测、图像分割、目标跟踪、人脸检测&识别、OCR、姿态估计、超分辨率、SLAM、医疗影像、Re-ID、GAN、NAS、深度估计、自动驾驶、强化学习、车道线检测、模型剪枝&压缩、去噪、去雾、去雨、风格迁移、遥感图像、行为识别、视频理解、图像融合、图像检索、论文投稿&交流、PyTorch、TensorFlow和Transformer、NeRF、3DGS、Mamba等。 一定要备注:研究方向+地点+学校/公司+昵称(如Mamba、多模态学习或者论文投稿+上海+上交+卡卡),根据格式备注,可更快被通过且邀请进群

▲扫码或加微信号: CVer2233,进交流群

CVer计算机视觉(知识星球)来了!想要了解最新最快最好的CV/DL/AI论文速递、优质实战项目、AI行业前沿、从入门到精通学习教程等资料,欢迎扫描下方二维码,加入CVer计算机视觉(知识星球),已汇集上万人!

▲扫码加入星球学习

▲扫码或加微信号: CVer2233,进交流群

CVer计算机视觉(知识星球)来了!想要了解最新最快最好的CV/DL/AI论文速递、优质实战项目、AI行业前沿、从入门到精通学习教程等资料,欢迎扫描下方二维码,加入CVer计算机视觉(知识星球),已汇集上万人!

▲扫码加入星球学习▲点击上方卡片,关注CVer公众号 整理不易,请点赞和在看

492

492

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?