简介

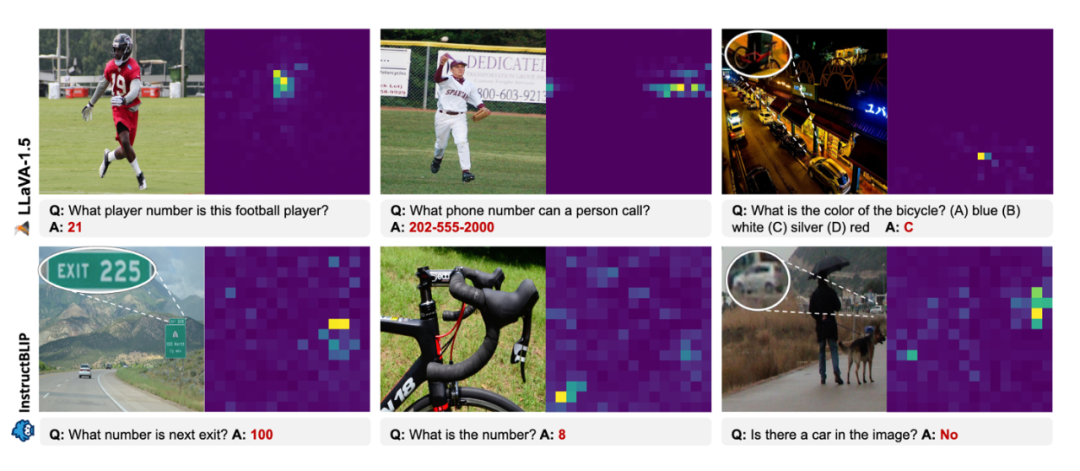

在本研究中,我们针对多模态大语言模型(MLLM)在辨识微小视觉信息时的局限性,提出了一套无需额外训练的“可视化干预”方法,巧妙地挖掘并利用模型自身的内部知识(注意力与梯度信息),从而提升模型对小尺度目标的感知能力。

具体而言,我们设计了三种自动裁剪方案,分别根据模型内在的注意力分布、梯度对目标位置的敏感性,以及组合利用这两类内部信号来确定最具辨识度的局部区域。在推理过程中,这些方法会围绕模型潜在的关注焦点动态地产生更“聚焦”的视图,帮助模型在回答视觉问题时忽略干扰并放大关键细节。

有趣的是,这些裁剪策略并不依赖针对性的数据标注或额外训练:它们仅依据模型原生的注意力机制和梯度反馈,即可更精准地定位微小目标所在。如此一来,我们不仅保留了通用型 MLLM 在海量数据中学习到的知识,还能在关键任务(如医学图像分析、安全监控等)中显著减少漏检小目标带来的风险。

我们在多项视觉问答基准上对该方法进行评估,结果表明,裁剪后的图像能够让 MLLM 在区分细微目标时表现更为准确和稳定,且这一增益在对小尺度目标尤其敏感的数据集上最为显著。

总而言之,这些训练无关的可视化干预手段充分利用了 MLLM 内在的多模态表征能力,为解决视觉细节缺失和小目标识别不佳的问题提供了一条灵活、高效且通用的新思路。

论文链接:

https://arxiv.org/abs/2502.17422

代码链接:

https://github.com/saccharomycetes/mllms_know

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

544

544

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?