目录

一、理论基础

1.1 强化学习PPO算法理论概述

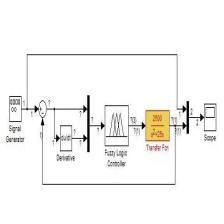

基于强化学习PPO算法的无人机姿态控制系统是一种先进的控制策略,它结合了强化学习和无人机姿态控制的知识,通过对无人机飞行姿态的精确控制,实现了无人机在复杂环境下的自主飞行。

一、基本原理

- 强化学习:强化学习是一种机器学习方法,它通过智能体与环境进行交互,通过试错学习最优策略,从而实现对环境的精确控制。在强化学习中,智能体通过执行动作并接收环境反馈的奖励或惩罚来学习最优策略。

- PPO算法:PPO算法是一种基于策略梯度的强化学习算法,它通过限制每次更新步长的方式来避免过大的策略更新,从而提高了学习效率和稳定性。

本文介绍了基于强化学习PPO算法的无人机姿态控制系统,详细阐述了PPO算法的理论基础和无人机姿态控制的数学模型,以及控制流程。在仿真测试中,PPO算法展现出优秀的控制效果,增强了无人机在复杂环境下的抗干扰能力。

本文介绍了基于强化学习PPO算法的无人机姿态控制系统,详细阐述了PPO算法的理论基础和无人机姿态控制的数学模型,以及控制流程。在仿真测试中,PPO算法展现出优秀的控制效果,增强了无人机在复杂环境下的抗干扰能力。

订阅专栏 解锁全文

订阅专栏 解锁全文

2693

2693

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?