ICML2016

Large-Margin Softmax Loss for Convolutional Neural Networks

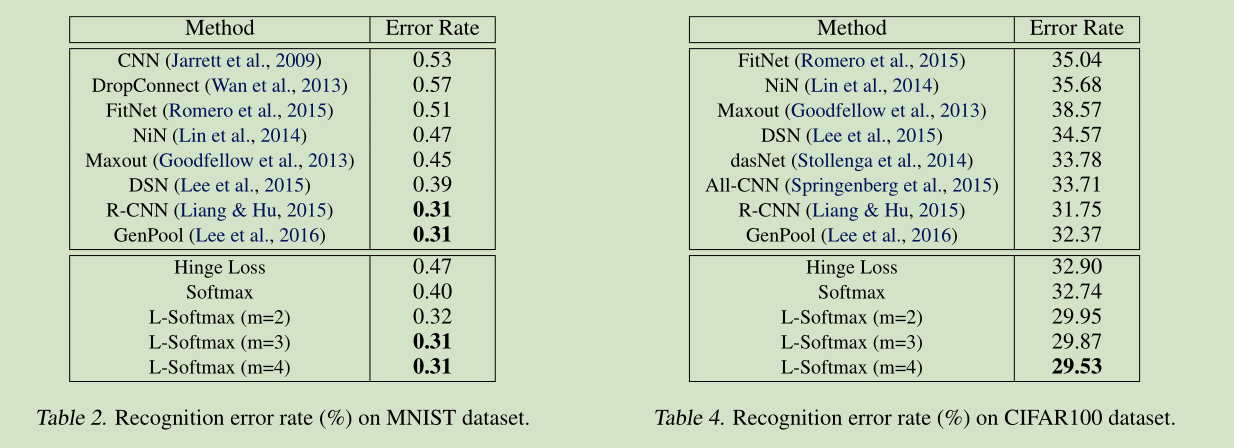

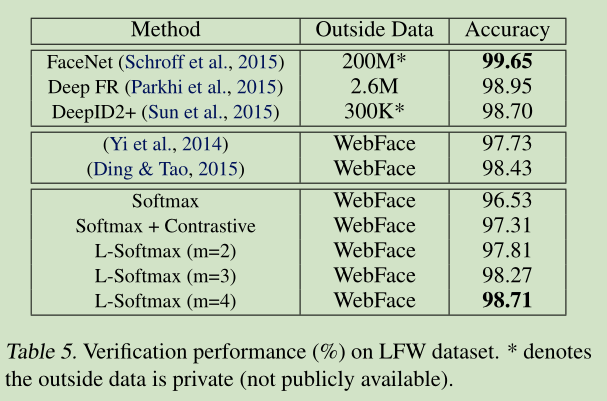

本文针对CNN网络中的 Softmax Loss 做出改进,使之成为 Large-Margin Softmax Loss

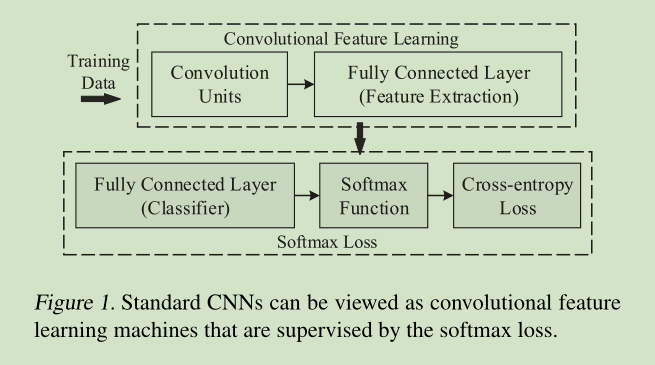

标准的CNN可以被看做由 Softmax Loss 监督的卷积特征学习机器。

当前的 Softmax Loss 没有显式的强调 intra-class compactness 和 inter-class-separability。

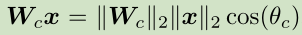

Our key intuition is that the separability between sample and parameter can be factorized into amplitude ones and angular ones with cosine similarity

其中 c 是类的序号,c类对应的线性分类器相当于 最后一层全链接层对应的参数 W 。

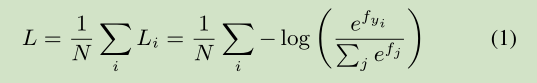

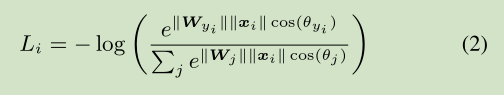

原始的 softmax loss 定义如下:

改为角度表示为

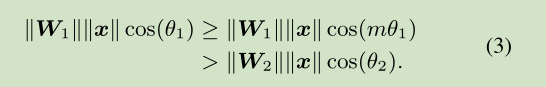

3 Large-Margin Softmax Loss

3.1. Intuition

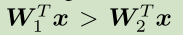

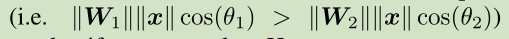

对于一个使用 softmax loss 的二分类问题,假定 x 属于类 1,如果我们希望正确分类,则需要满足

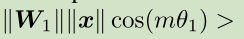

如果我们希望分类的判断具有一个大些的 Margin,则需要满足如下:

余弦函数在 0到 180 是下降函数

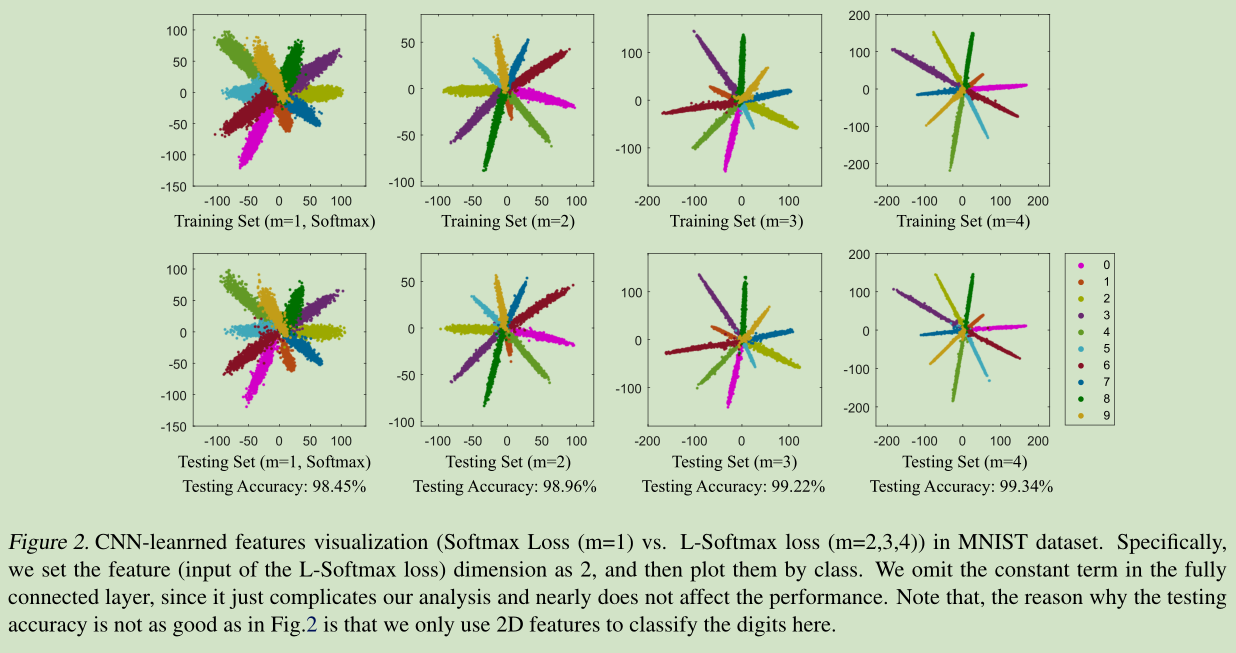

3.2. 数学公式定义

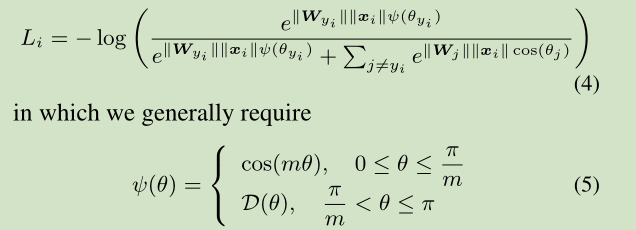

几何解析图示:

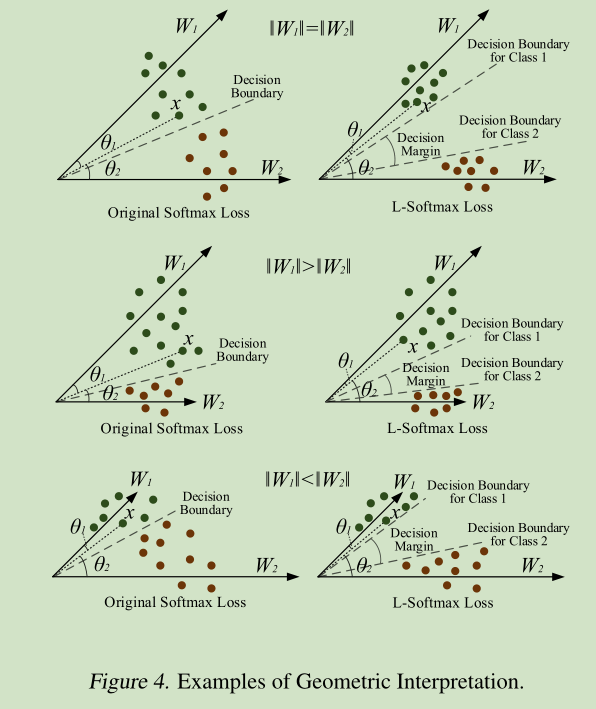

二维特征的对比图示:

3万+

3万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?