论文地址:https://arxiv.org/abs/2406.12793

摘要

主要聚焦于GLM - 4语言系列

- GLM - 4系列包括GLM - 4、GLM - 4 - Air和GLM - 4 - 9B,是能力最强的模型,融合了前三代ChatGLM的经验和教训。

- 预训练 在十万亿个主要为中文和英文的标记上进行,主要针对中文和英文进行了校准。

- 校准流程 包括有监督微调(SFT)和从人类反馈中学习(RLHF)。

- GLM - 4全工具模型 能理解用户意图,自主选择工具(如网络浏览器、Python解释器、文本到图像模型和用户自定义函数)完成复杂任务。

1 介绍

- 大型语言模型(LLMs)快速发展,OpenAI的GPT系列通过指令调整、SFT和RLHF显著改进。

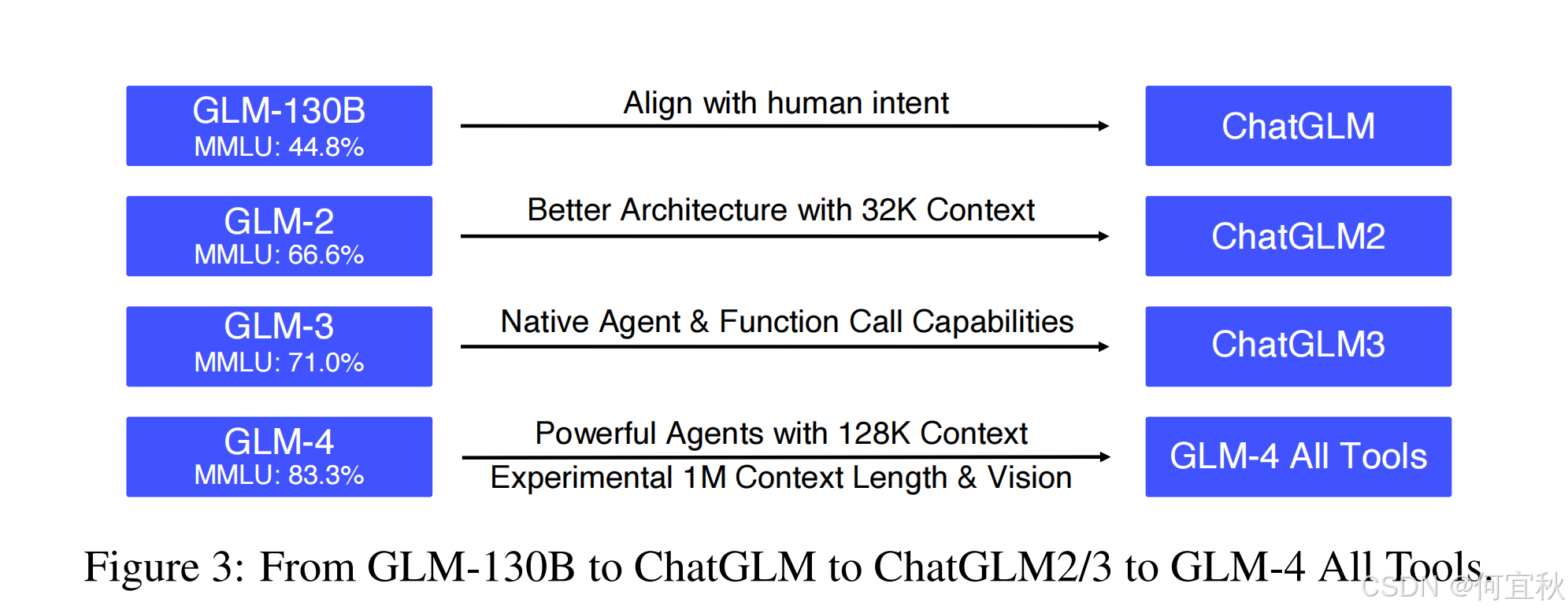

- 通用语言模型(GLM)架构 采用自回归空白填充目标,经过指令调整和校准,推出了ChatGLM系列模型。

- GLM - 4系列 经过多阶段后训练流程(SFT、RLHF、安全校准),主要针对中文和英文进行校准,支持128K上下文长度。

- GLM - 4全工具模型 能理解用户意图并自主选择工具完成任务,性能接近GPT - 4和Gemini 1.5。

GLM - 4系列模型的发展和评估

- ChatGLM2 - 6B通过更多高质量数据预训练和校准,上下文长度扩展到32K,推理速度提高42%。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

7万+

7万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?