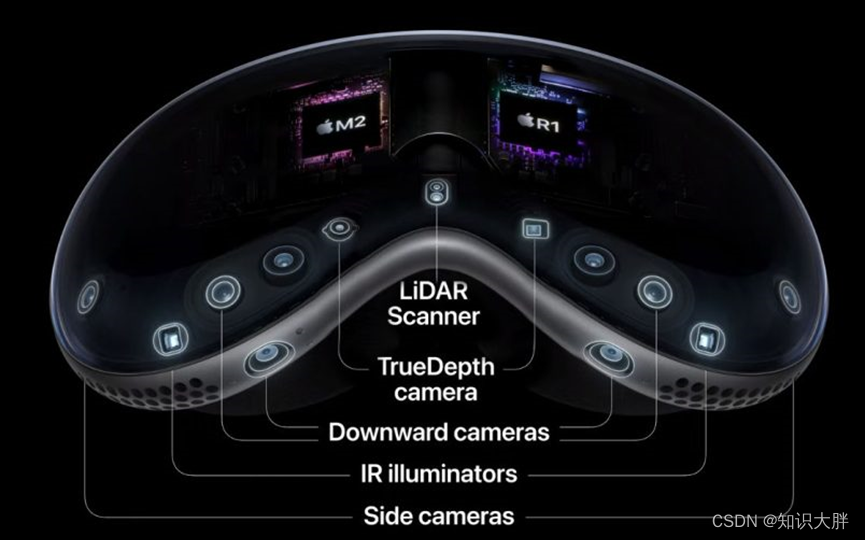

Apple Vision Pro 设备配备了多个传感器,以增强其深度感知能力,并在三维空间中创造无缝的虚拟和真实体验。包含的视觉传感器有RGB摄像头、红外摄像头、dToF LiDAR、结构光摄像头和鱼眼红外摄像头。

Apple Vision Pro 的外观特点:

2 个前向 RGB 摄像头,用于前向拍摄和 VST(虚拟空间跟踪)。

4 个面向侧面和前方的鱼眼红外摄像机,用于 6DOF(六自由度)跟踪。

2 个向下的红外摄像头,用于下方的躯干跟踪和手势跟踪。

2台红外线激光器,发射红外光照射控制范围内的躯干、腿部、膝盖、手部及周围区域,辅助红外线和鱼眼红外线摄像机捕捉这些区域的活动元素。

1颗dToF LiDAR激光雷达,类似iPhone Pro后置摄像头使用的雷达,支持3D拍摄、空间重建、深度感知和定位。

1 结构光摄像头,也称为 TrueDepth 摄像头,类似于 iPhone 上的前置结构光 Face ID。它支持 FaceTime 应用程序中的面部扫描和前方区域的精确手势跟踪。

Apple Vision Pro 内部有 4 个红外摄像头和一圈 LED。据推测,结构光方案的光场信息用于眼动追踪和眼部表情分析。

Apple 在 Apple Visi

Apple Vision Pro 搭载多种传感器,包括RGB、红外、dToF LiDAR、结构光摄像头,提供3D感知、VST、6DOF追踪等功能。设备融合LiDAR与结构光,实现无控制器手势交互,提供优秀的MR体验。Apple Vision Pro的VST技术结合LiDAR,提供实时3D环境感知,降低3D眩晕和VAC冲突,实现自然的3D视觉体验。设备在游戏、远程工作、协作等方面展现多功能性,推动AR/VR/MR领域的发展。

Apple Vision Pro 搭载多种传感器,包括RGB、红外、dToF LiDAR、结构光摄像头,提供3D感知、VST、6DOF追踪等功能。设备融合LiDAR与结构光,实现无控制器手势交互,提供优秀的MR体验。Apple Vision Pro的VST技术结合LiDAR,提供实时3D环境感知,降低3D眩晕和VAC冲突,实现自然的3D视觉体验。设备在游戏、远程工作、协作等方面展现多功能性,推动AR/VR/MR领域的发展。

订阅专栏 解锁全文

订阅专栏 解锁全文

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?