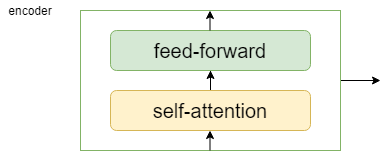

1、transform整个网络的结构主要是由attention组成(仅由self-attention和Feed Foward neural network组成)。

2、encoder部分分为:self-attention和feed-forward组成,数据经过self-attention之后得到一个加权的特征向量,被送入一个具有两层网络结构的feed-forward.

decoder部分多了一个encoder-decoder attention,两个attention分别用于计算输入和输出的权值。decoder中self-attention模块关注翻译与之前翻译的关系;encoder-decoder-attention关注翻译和当前编码的特征向量之间的关系。

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?