随着LLM(LLM的擅长与不擅长:深入剖析大语言模型的能力边界)规模的不断扩大和训练数据的急剧增加,大型语言模型(LLMs)如GPT系列、LLaMA等已成为自然语言处理领域的佼佼者。然而,这些模型巨大的参数数量和计算需求使得它们在资源受限的环境(如移动设备、嵌入式系统等)中部署变得极具挑战性。为了克服这一难题,LLM量化技术应运而生。今天我们一起了解一下模型量化。

一、模型量化的基本概念

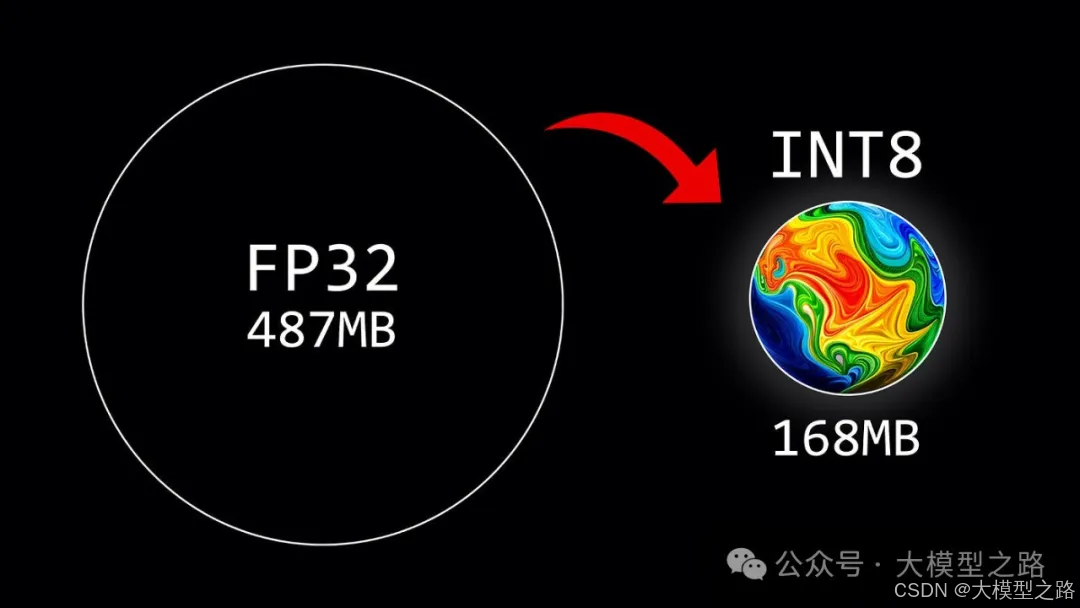

模型量化是指通过减少深度学习模型的参数大小和内存占用,使其在保持性能基本不变的前提下,更加适合在资源受限的环境中部署。量化技术通过将模型中的高精度参数(如32位浮点数)转换为低精度参数(如8位、4位甚至更低位数的整数),从而显著降低模型的存储和计算需求。这种转换不仅有助于减小模型体积,还能加快推理速度,降低能耗,是深度学习模型优化的重要手段之一。

二、模型量化的技术类型

模型量化技术种类繁多,每种技术都有其独特的优势和适用场景。以下是几种常见的量化技术:

-

<

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1040

1040

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?