当下大型语言模型(LLMs)备受瞩目。然而,尽管LLMs在许多自然语言任务上表现出色(LLM的擅长与不擅长:深入剖析大语言模型的能力边界),它们在处理需要复杂多步推理的任务时仍面临挑战。为了解决这一问题,伊兹密尔理工学院的研究人员提出了AutoReason框架。AutoReason通过自动生成推理步骤,有效提升了LLMs在复杂推理任务中的表现,并增强了其可解释性。本文将详细介绍AutoReason的架构、原理及其实验效果。希望对大家有所帮助

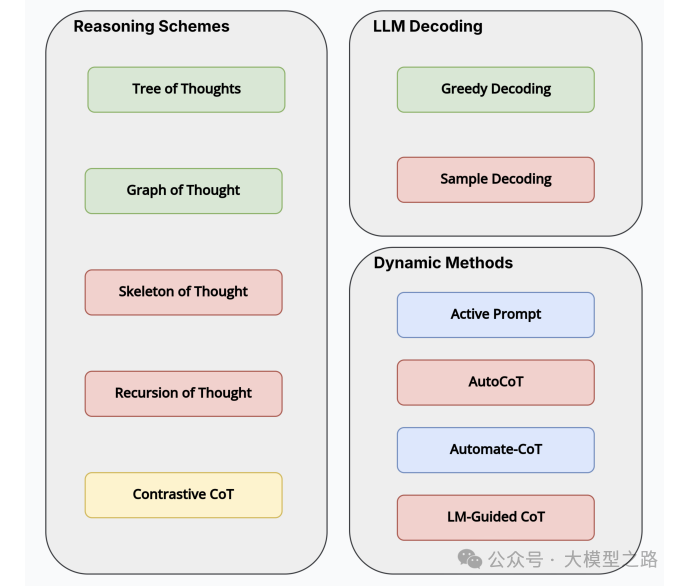

一、AutoReason架构

AutoReason框架采用了一种创新的双层模型方法,该方法结合了强模型和弱模型的协同作用。具体而言,一个更强大的模型(如GPT-4)用于生成基本的推理步骤,而一个相对较弱的模型(如GPT-3.5 Turbo)则将这些步骤提炼成可操作的答案。这种设计旨在弥补隐式查询复杂性和显式逐步解决方案之间的差距,同时提高推理的准确性和可解释性。

AutoReason的工作流程可以细分为以下几个阶段:

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

885

885

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?