刚刚看一篇代码,注释说了最后有一个softmax,但是代码中却没有用到F.softmax

查阅资料,原来是算交叉熵损失函数的时候自带了softmax

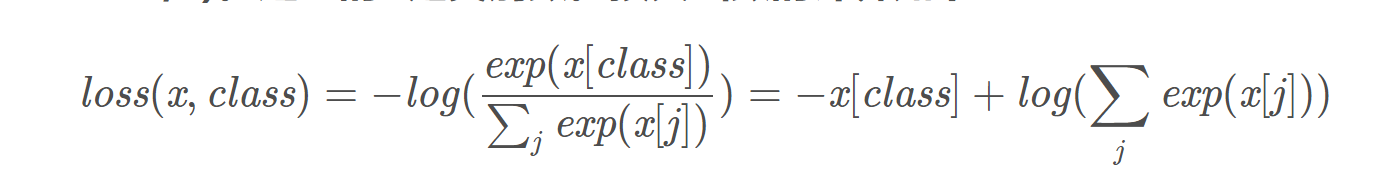

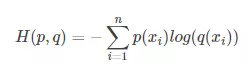

x[class]是gt类别的预测概率,x[j]是各个类别的预测概率,由于交叉熵损失只计算gt类别的损失,如下图

x_i是gt类别,p(x_i)只有gt类别时=1,所以实际上只计算gt类别的预测置信度加个log,算个softmax就是第一张图片那样

torch.nn.CrossEntropyLoss自带了softmax!

最新推荐文章于 2024-05-13 20:32:49 发布

231

231

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?