下载预训练结果https://huggingface.co/THUDM/chatglm-6b-int4/tree/main

这里用的是int4量化的预训练结果,下载完成之后放入E:\\glmdata。

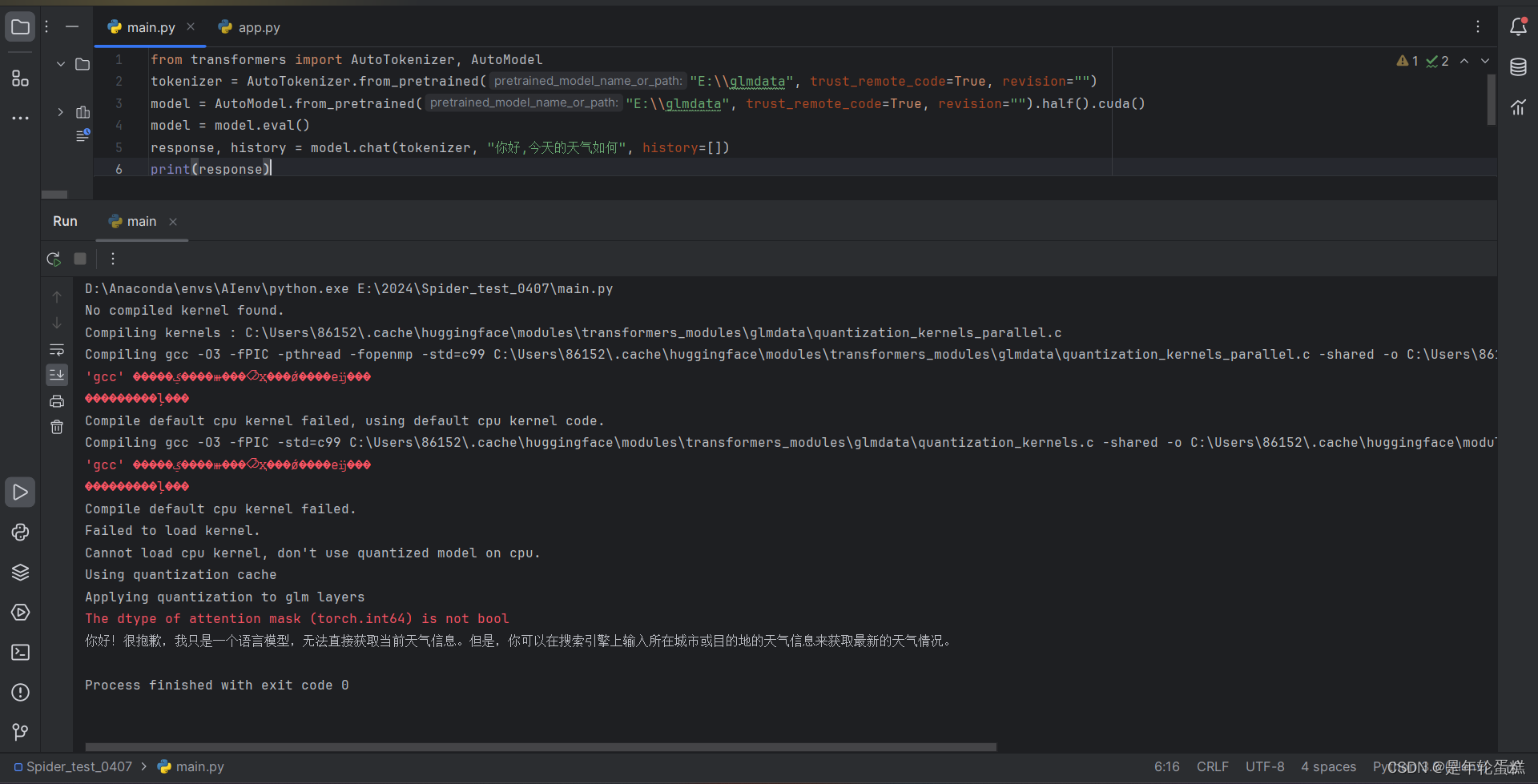

导入AutoTokenizer, AutoModel, 将预训练结果通过AutoTokenizer和AutoModel导入,设置trust_remote_code属性为True,部署最终完成。

from transformers import AutoTokenizer, AutoModel

tokenizer = AutoTokenizer.from_pretrained("E:\\glmdata", trust_remote_code=True, revision="")

model = AutoModel.from_pretrained("E:\\glmdata", trust_remote_code=True, revision="").half().cuda()

model = model.eval()

response, history = model.chat(tokenizer, "你好,今天的天气如何", history=[])

print(response)

测试

成功给出了输出,但是仍有报错,并且较为缓慢。

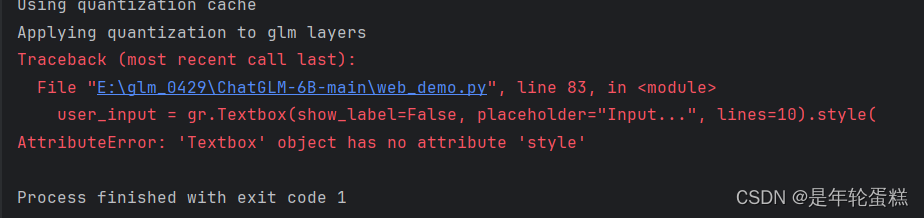

注:Chatglm部署问题——‘Textbox‘ object has no attribute ‘style‘

查找资料后发现虚拟环境中的gradio版本太高,Textbox对象没有style方法

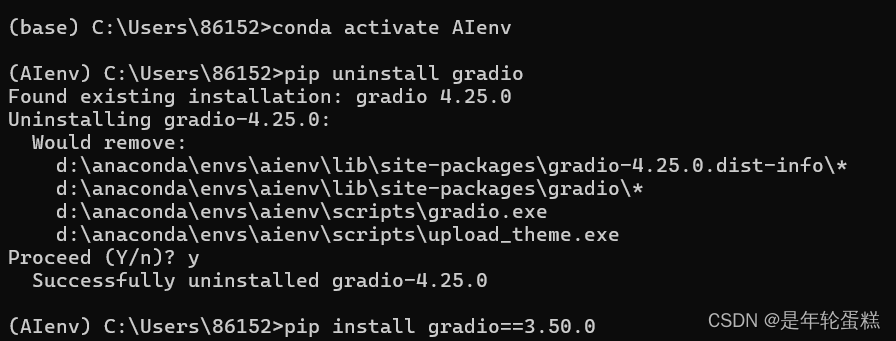

删除虚拟环境中的gradio,重新指定3.50.0版本下载

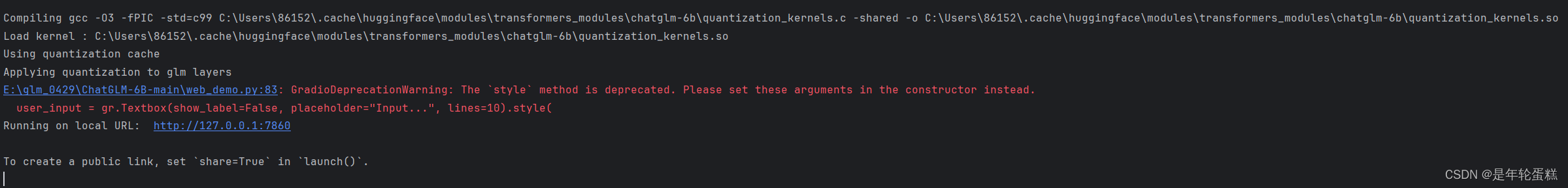

再次运行程序,问题解决

217

217

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?