1 GoogleNet Inception v2

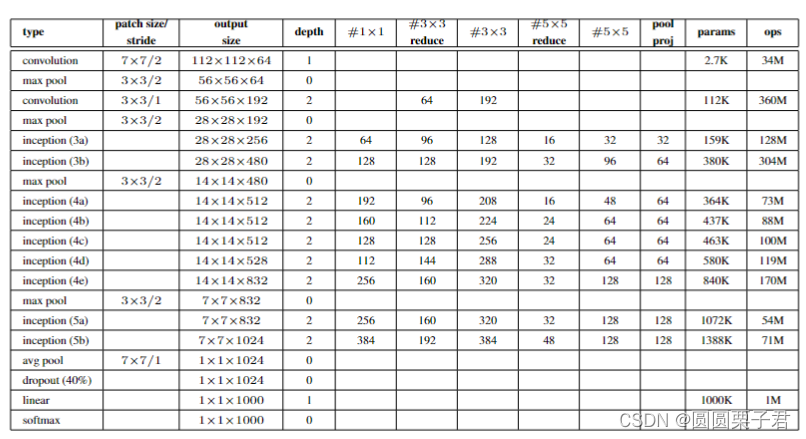

v1具体结构:

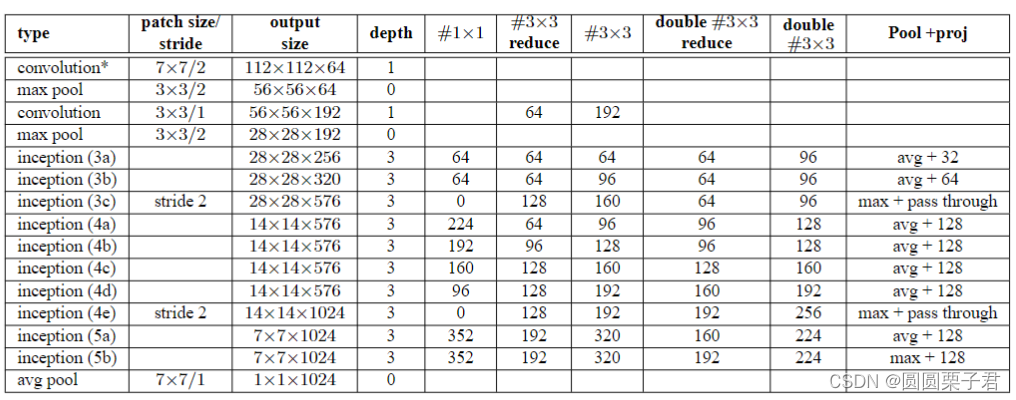

v2具体结构:

1 引入Batch Normalization(BN):

Inception v2在每个卷积层之后引入了BN。这有助于解决深层网络中的梯度消失问题,同时加快训练过程并提高模型的收敛速度。BN通过减少内部协变量偏移,使每一层的输入更加稳定。

2 使用更小的卷积核:

Inception v2采用了更多的3x3卷积核代替大尺寸卷积核。这种设计可以减少参数数量,从而减少过拟合的风险,并降低计算复杂度。

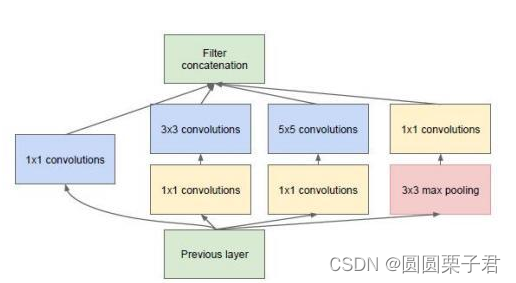

Inception v2将大尺寸的卷积核(如5x5)分解成两个较小的卷积核(如3x3)。这不仅减少了参数的数量和计算量,还保持了网络的表达能力。如下图在v1中,只改变了,第三个位置的5x5变成了两个3x3,当然也修改了inception结构输出的通道数

本文介绍了GoogleNet的Inceptionv2和v3版本,重点在于它们在结构上的改进,如引入BatchNormalization、使用更小的3x3卷积核、以及maxpool替换为Inception模块。Inceptionv3在Inceptionv2基础上进一步优化,特别提到了标签平滑技术用于增强模型的泛化能力。

本文介绍了GoogleNet的Inceptionv2和v3版本,重点在于它们在结构上的改进,如引入BatchNormalization、使用更小的3x3卷积核、以及maxpool替换为Inception模块。Inceptionv3在Inceptionv2基础上进一步优化,特别提到了标签平滑技术用于增强模型的泛化能力。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1053

1053

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?