最近学习了一些自动驾驶的相关的投影知识,结合自身,做了小小的改进,得到了想要的效果,故记录下来!

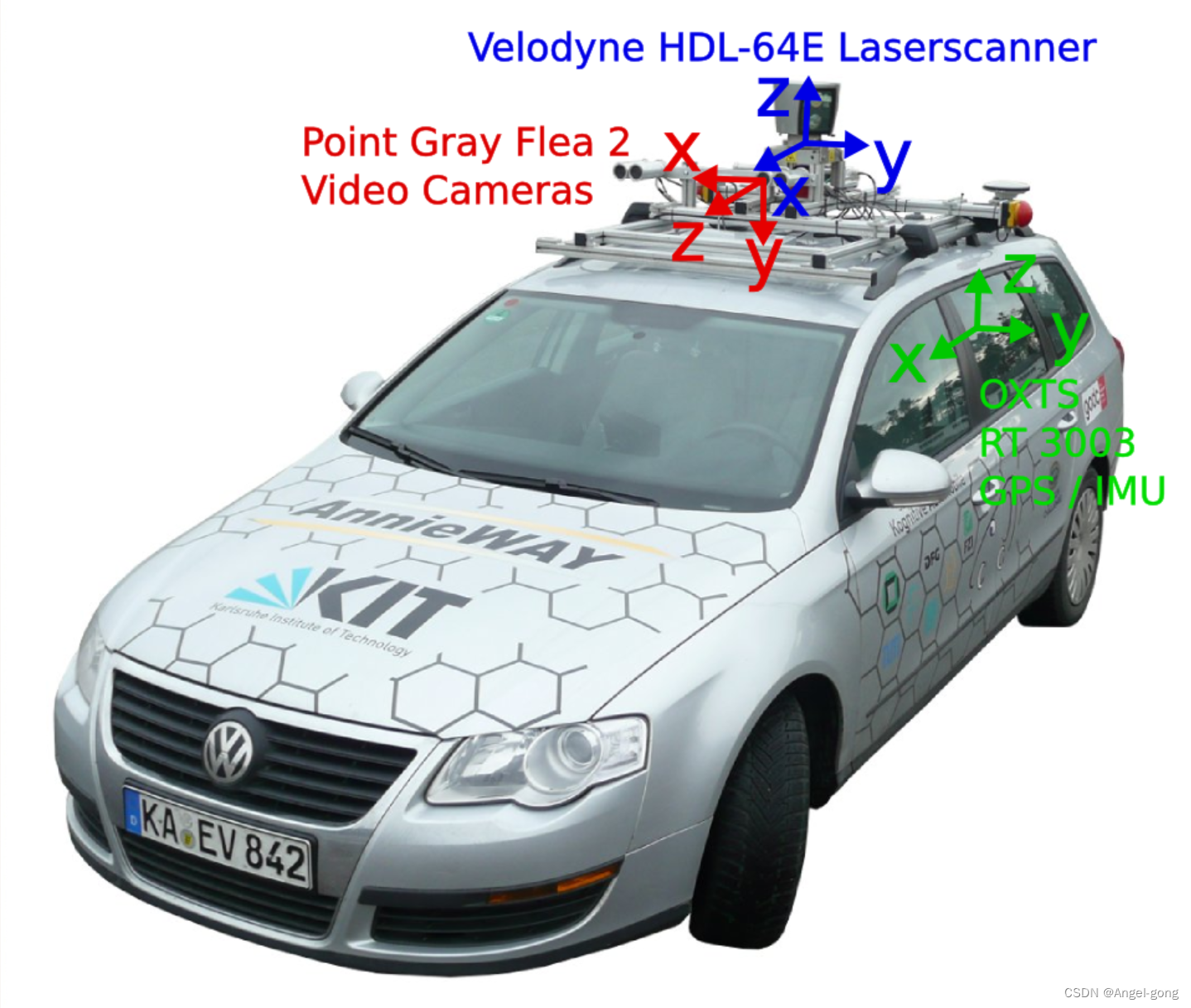

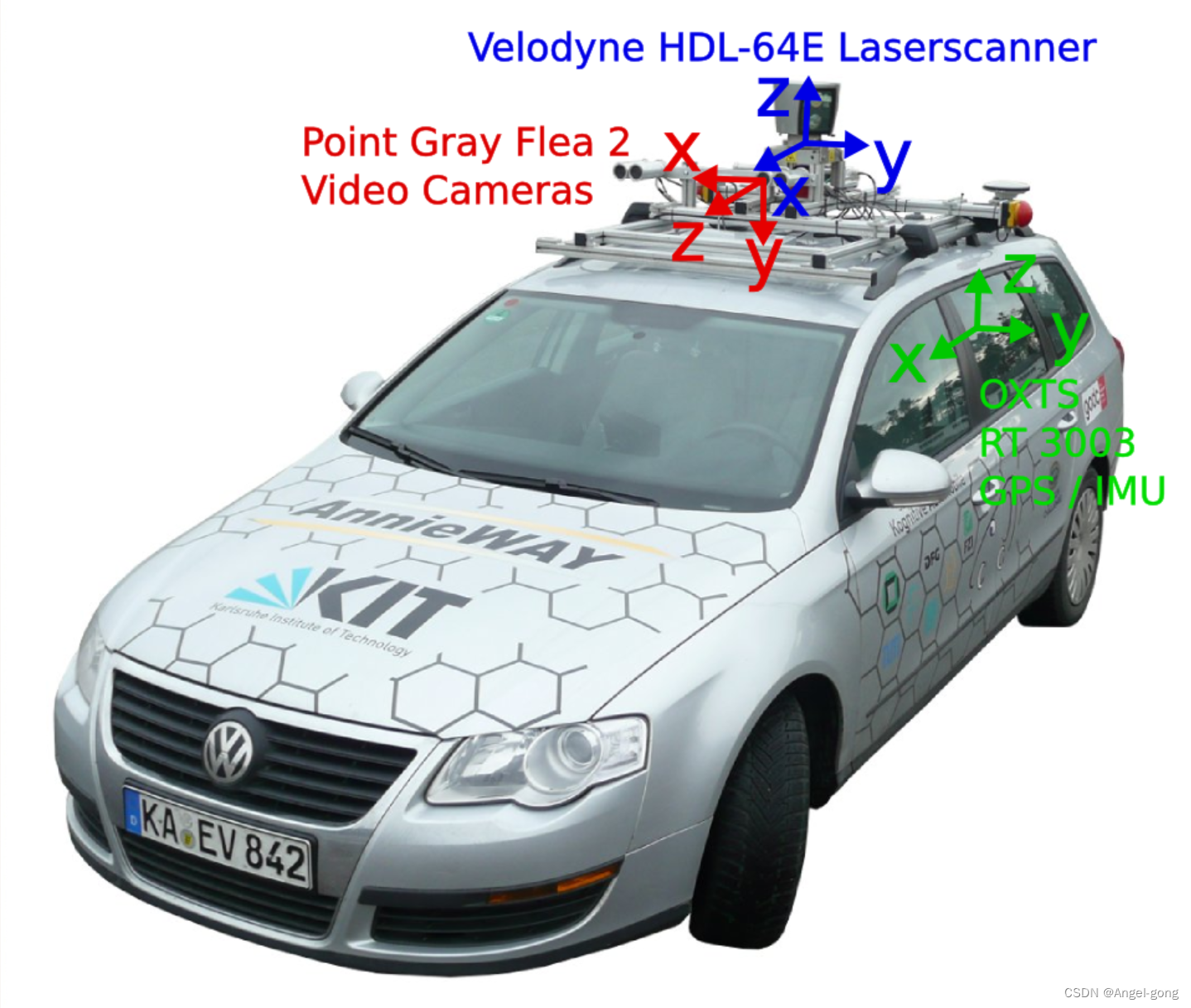

KITTI数据集介绍

1个64线激光雷达:车身正中间

2个GRB相机:得到RGB图像数据

2个灰度图像:得到灰度图像

激光雷达和相机的坐标系:

激光雷达:

x:前 y:左 z:上

相机:

x:右 y:下 z:前

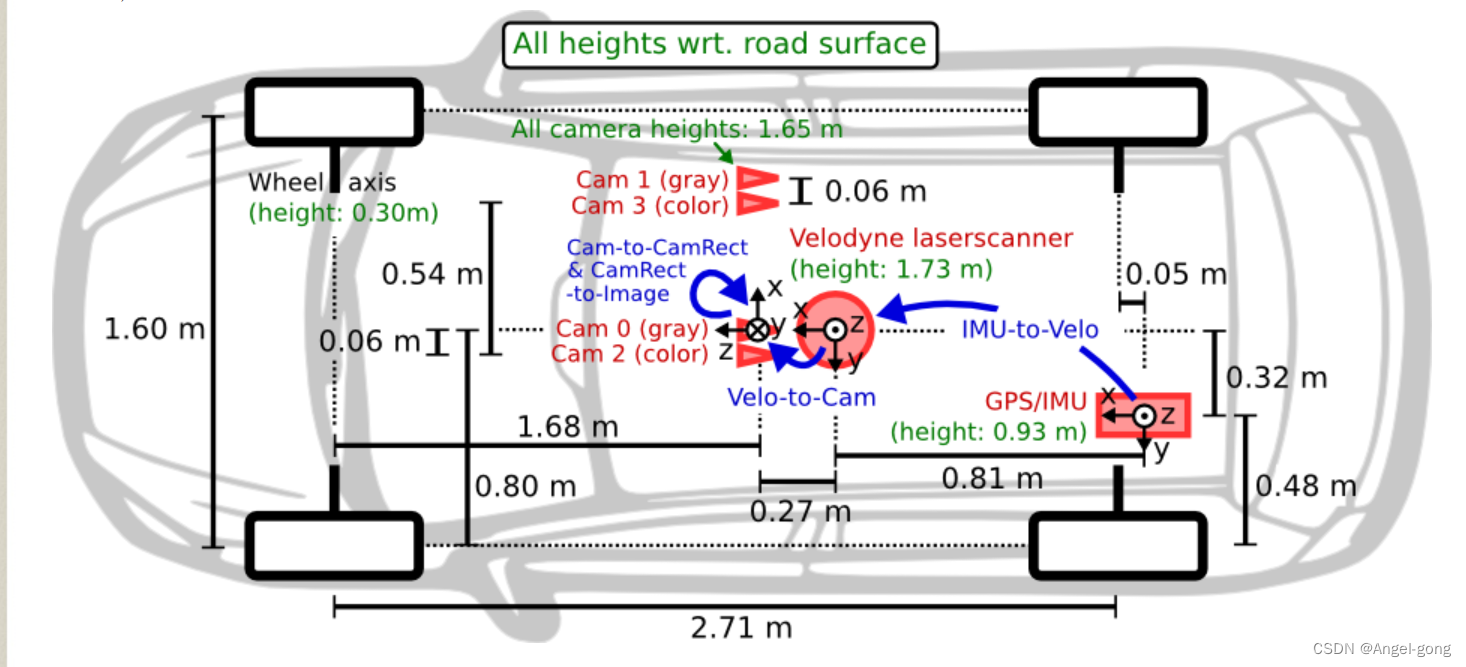

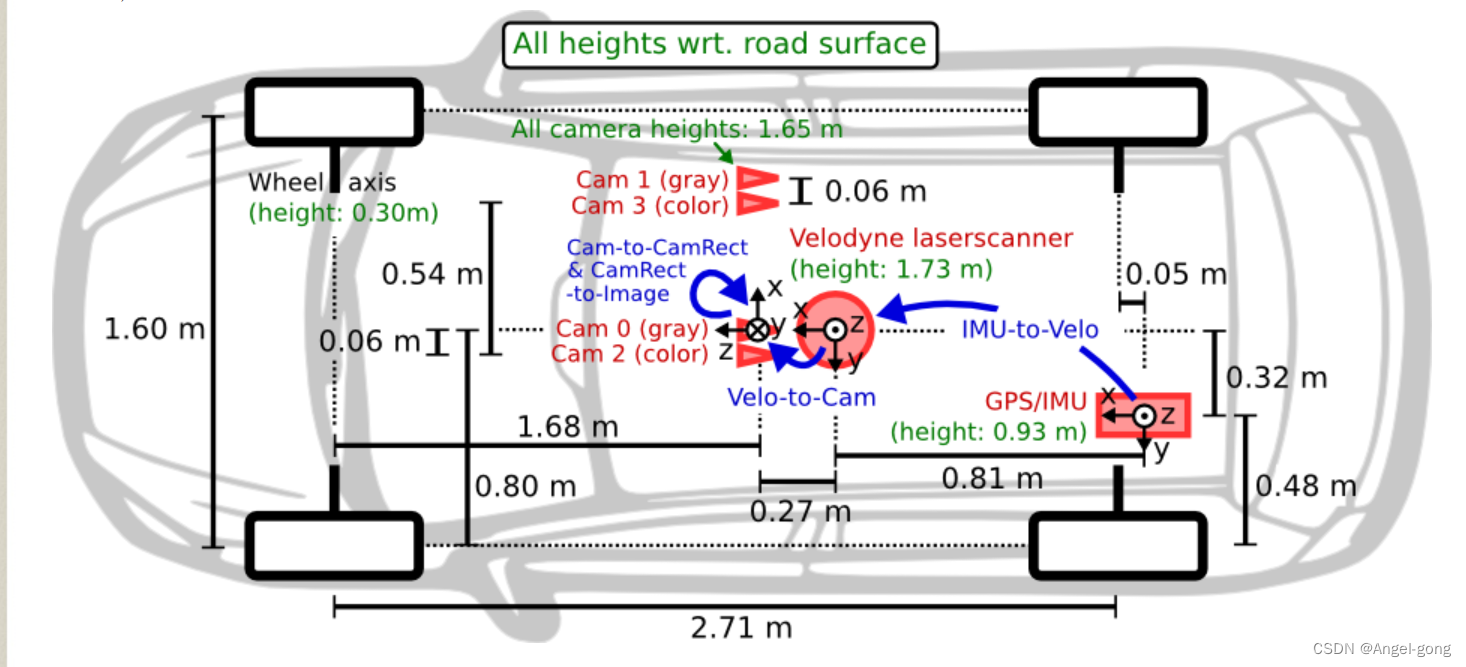

具体的安装位置(俯视图)如图:

更多详细介绍:

最近学习了一些自动驾驶的相关的投影知识,结合自身,做了小小的改进,得到了想要的效果,故记录下来!

1个64线激光雷达:车身正中间

2个GRB相机:得到RGB图像数据

2个灰度图像:得到灰度图像

激光雷达:

x:前 y:左 z:上

相机:

x:右 y:下 z:前

具体的安装位置(俯视图)如图:

更多详细介绍:

2784

2784

4110

4110

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?