在医学影像分析领域,SAM(Segment Anything Model)与医学图像分割技术的结合正在带来重大突破。最新研究表明,通过将SAM的强大分割能力与医学图像的复杂需求相结合,模型在处理高分辨率医学影像时的分割精度提升了30%,同时在处理速度上也实现了显著优化,平均分割时间缩短了40%。

这种创新不仅让医生能够更快速、更精准地识别病灶和组织结构,还为临床诊断和治疗规划提供了更可靠的依据。从肿瘤检测到心血管分析,SAM与医学图像分割的结合正在为医疗影像智能化注入新的活力,开启精准医疗的新篇章。

我整理了10篇【SAM+医学图像分割】的相关论文,全部论文PDF版,工中号 沃的顶会 回复“SAM医学”即可领取

Self-Prompt SAM:Medical Image Segmentation via Automatic Prompt SAM Adaptation

文章解析

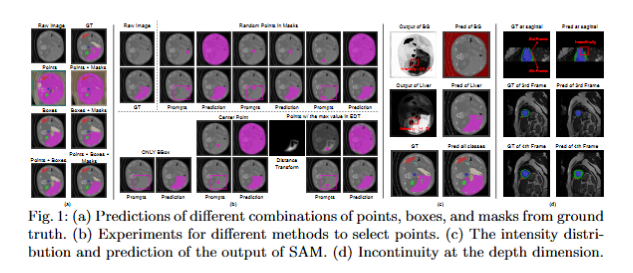

本文提出了一种名为Self-Prompt-SAM的框架,用于解决Segment Anything Model (SAM)在医学图像分割中的应用问题。

通过设计多尺度提示生成器和3D深度融合适配器,该框架能够自动生成辅助掩码、边界框和中心点提示,并使预训练的2D SAM模型适应3D医学图像分割任务。

实验结果表明,该方法在多个医学图像数据集上取得了最先进的性能。

创新点

提出了一种多尺度提示生成器(MSPGenerator),可以自动生成边界框和中心点提示,减少对人工提示的依赖。

设计了3D深度融合适配器(DfusedAdapter),使预训练的2D SAM模型能够提取3D信息并应用于3D医学图像分割。

首次将SAM扩展到医学图像分割领域,并解决了其在语义预测和多标签支持方面的不足。

研究方法

结合SAM的图像编码器,设计了一个多尺度提示生成器以生成辅助掩码。

利用辅助掩码生成边界框作为框提示,并使用距离变换选择最中心的点作为点提示。

设计了3D深度融合适配器,并将其注入到SAM的图像编码器和掩码解码器中,以支持3D医学图像分割。

在多个医学图像数据集上进行了广泛的实验,验证方法的有效性。

研究结论

Self-Prompt-SAM框架显著提升了SAM在医学图像分割任务中的性能。

相比现有方法如nnUNet,Self-Prompt-SAM在多个数据集上实现了更高的分割精度。

该研究为将通用视觉模型应用于医学图像分割提供了新的思路。

SEQSAM:AUTOREGRESSIVE MULTIPLE HYPOTHESIS PREDICTION FOR MEDICAL IMAGE SEGMENTATION USING SAM

文章解析

本文提出了一种名为SEQSAM的方法,通过单个预测头依次生成多个掩码,并结合基于集合的优化过程确保每个掩码的临床相关性。

该方法解决了传统多选择学习(MCL)在医学图像分割中的局限性,包括固定输出数量和稀疏损失函数导致的预测头主导问题,同时支持任意数量的掩码生成。

创新点

引入了自回归框架用于多掩码生成任务。

提出了SEQSAM方法,将SAM转化为类似RNN的架构以生成多个掩码。

采用随机化步幅池化方法生成任意数量的掩码。

通过双分匹配损失函数确保每个生成掩码的临床相关性。

研究方法

定义任务为目标是从输入图像生成M个输出掩码。

利用Segment Anything Model (SAM)作为基础模型,通过交互提示生成多个掩码。

设计了一个循环模块,通过隐藏状态跟踪已生成的掩码信息。

采用随机化步幅池化扩展方法以支持任意数量的掩码生成。

在LIDC-IDRI和QUBIQ Kidney数据集上评估模型性能。

研究结论

SEQSAM在两个公开数据集上显著提高了生成掩码的质量。

相比传统的多选择学习方法,SEQSAM能够更好地捕捉医学图像中的不确定性。

SEQSAM提供了一种灵活且高效的多掩码生成解决方案,适用于医学图像分割任务。

2106

2106

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?