在图像处理领域,Transformer架构的创新应用正不断刷新着我们对视觉任务的认知。从2025年最新的研究成果来看,Transformer不仅在图像分类、去噪、超分辨率等传统任务中取得了显著进展,更通过与CNN、量子计算等技术的融合,展现出前所未有的潜力。

Agent Attention通过引入代理向量,将传统注意力与线性注意力无缝集成,显著提升了计算效率和图像生成质量;而SparseViT则利用稀疏自注意力机制,优先强化与篡改相关的低频特征,同时保留高频语义信息,极大地提升了模型在跨场景数据集上的性能。

这些创新不仅优化了模型的效率和效果,更为图像处理的未来发展开辟了新的方向。我整理了9篇关于【Transformer+图像处理】的相关论文,全部论文PDF版,工中号 沃的顶会 回复“9T图像”即可领取。

ITrans:generative image inpainting with transformers

文章解析

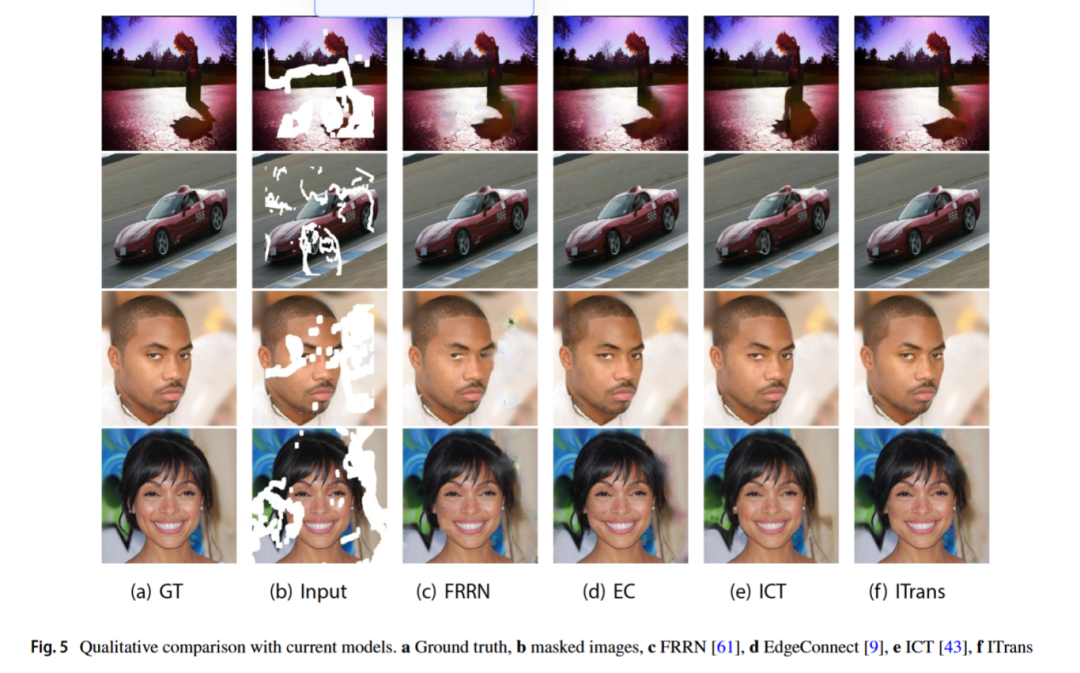

文章提出ITrans网络用于图像修复,融合CNN与Transformer优势,设计全局和局部变压器模块提升性能。

经实验对比和消融研究,验证其优势,同时指出不足并展望未来研究方向。

创新点

架构融合创新:首次将CNN与Transformer以端到端方式结合,提出ITrans网络用于图像修复。

模块设计新颖:设计全局和局部变压器模块,分别从全局和局部层面提升图像修复效果。

性能表现优异:在多个基准数据集上超越现有方法,达到了新的最先进性能。

研究方法

文献研究:梳理图像修复和视觉Transformer相关研究,分析现有方法优缺点。

模型构建:构建包含全局和局部变压器模块的ITrans网络,明确网络架构及各模块细节。

实验对比:使用多个数据集和指标,对比ITrans网络与其他方法的图像修复性能。

消融实验:对全局和局部变压器模块进行消融实验,验证模块有效性。

研究结论

网络有效性:ITrans网络能有效融合CNN和Transformer优势,在多种场景下有良好的图像修复表现。

模块重要性:全局和局部变压器模块对提升网络性能至关重要,分别在全局语义和局部细节处理上发挥作用。

改进方向:当前模型在大尺寸或复杂掩码下存在模糊和伪影问题,未来可从优化网络结构和增强生成能力等方面改进。

TransInpaint:Transformer-based Image Inpainting with Context Adaptation

文章解析

文章提出用于图像修复的TransInpaint模型,通过上下文自适应Transformer和纹理增强网络提升修复效果,经实验验证其优势,同时指出不足与未来改进方向。

创新点

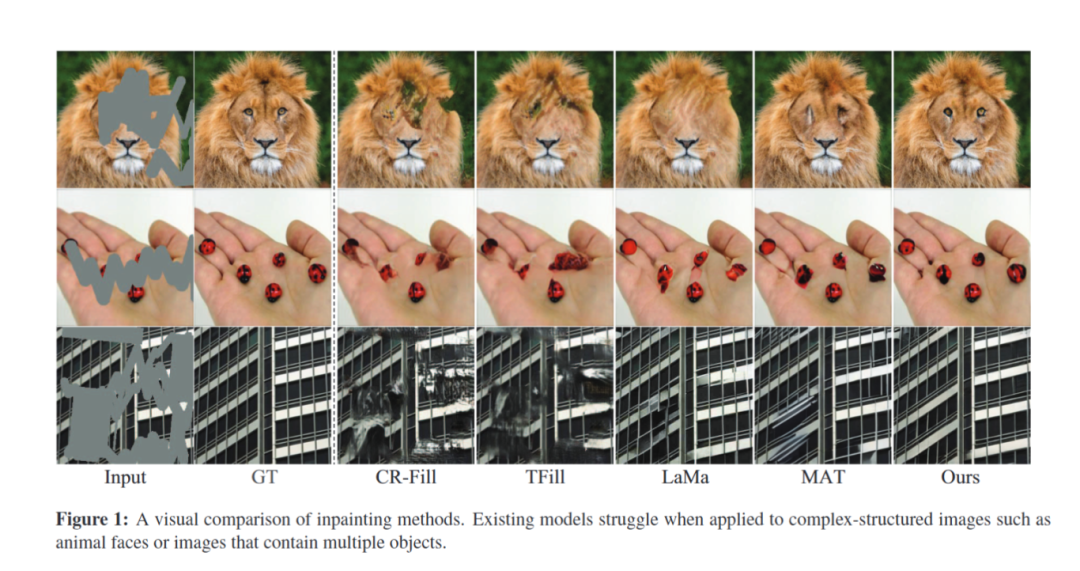

架构创新:提出结合上下文自适应Transformer(CT)和纹理增强网络(TENet)的图像修复架构,有效处理复杂结构图像。

采样优化:采用Gibbs采样获取外观先验,考虑缺失区域令牌间的相关性,提升生成结果的真实性。

特征融合:TENet的Feature Synthesis模块融合编码器跳跃连接特征与生成器粗糙特征,更好地模拟长距离依赖和全局上下文。

研究方法

模型设计:构建包含CT和TENet的TransInpaint模型,明确各模块结构和功能。

损失函数构建:设计由多种损失项组成的损失函数,用于训练模型并优化修复效果。

实验对比:在多个数据集上,用多种指标对比TransInpaint与其他模型的修复性能。

消融实验:对模型各模块进行消融实验,验证模块有效性。

研究结论

性能优势:TransInpaint在多个数据集上,多项指标优于其他模型,能生成更逼真、高质量的修复图像。

模块作用:CT和TENet模块对模型性能提升至关重要,有助于生成纹理细节和保留结构信息。

未来方向:模型在处理复杂形状重建上存在局限,未来可利用扩散技术提升修复的真实感和质量。

2124

2124

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?