一、从高斯分布到信息矩阵

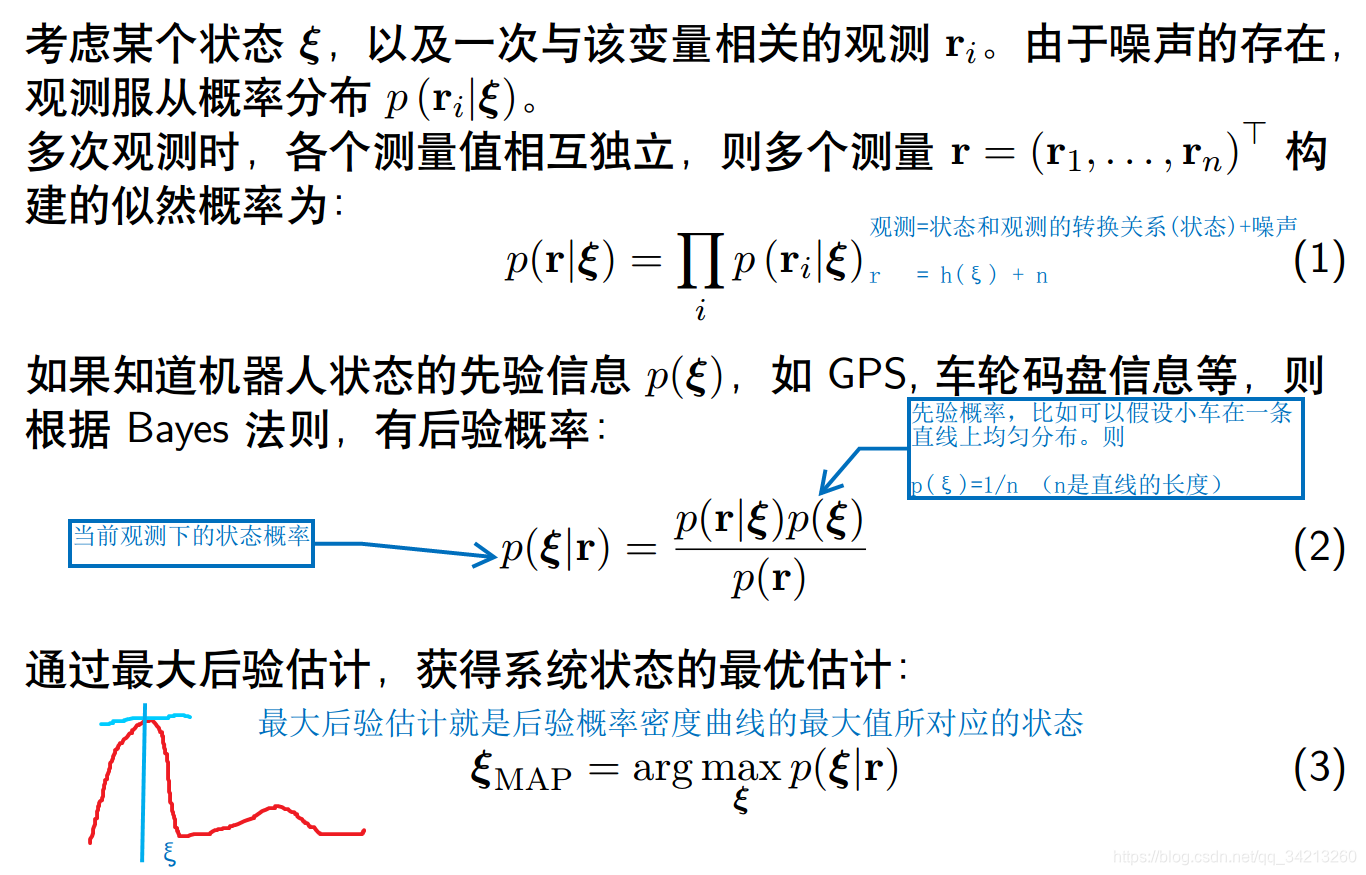

1.1 SLAM 问题概率建模

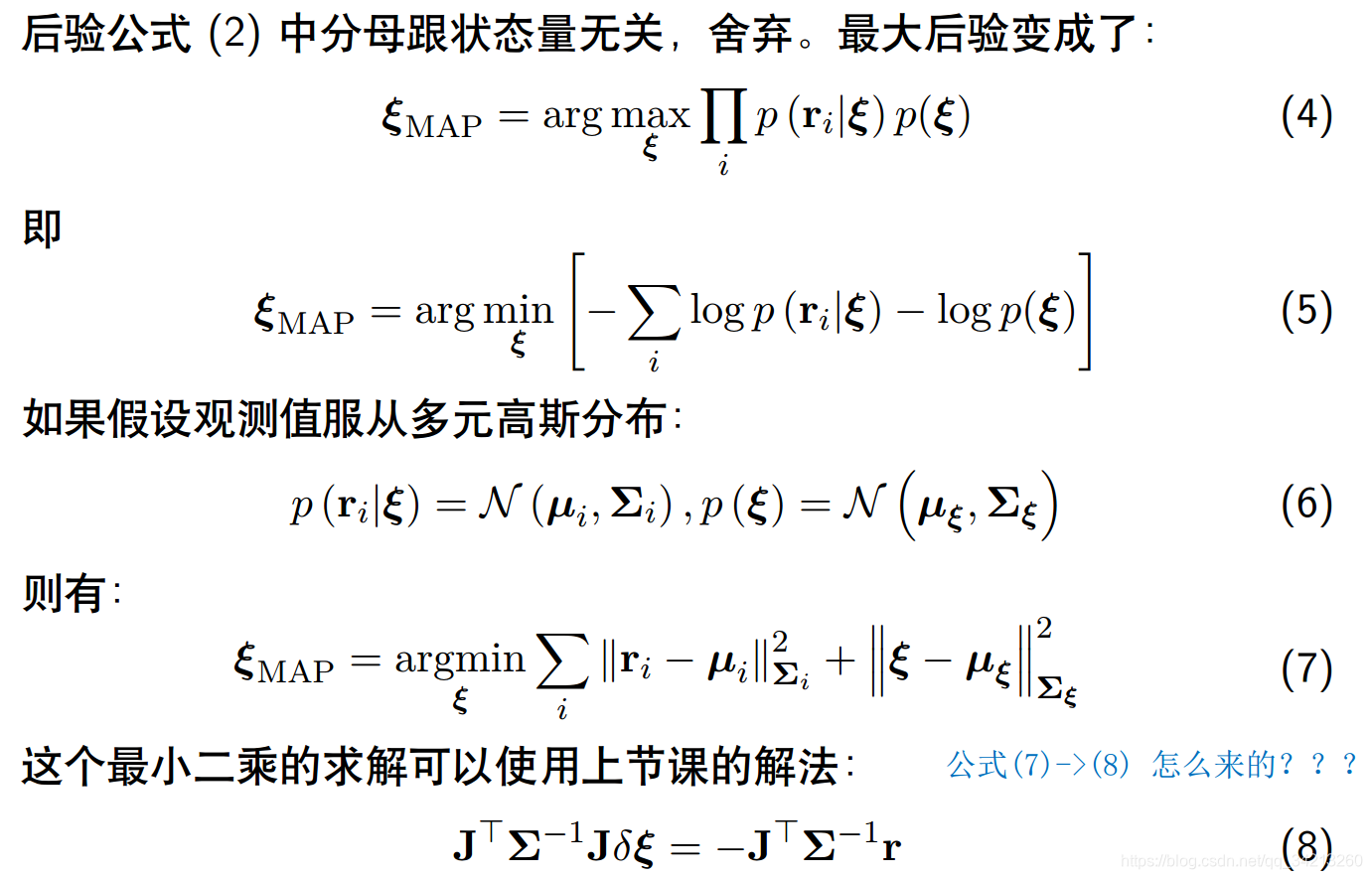

1.2 SLAM 问题求解

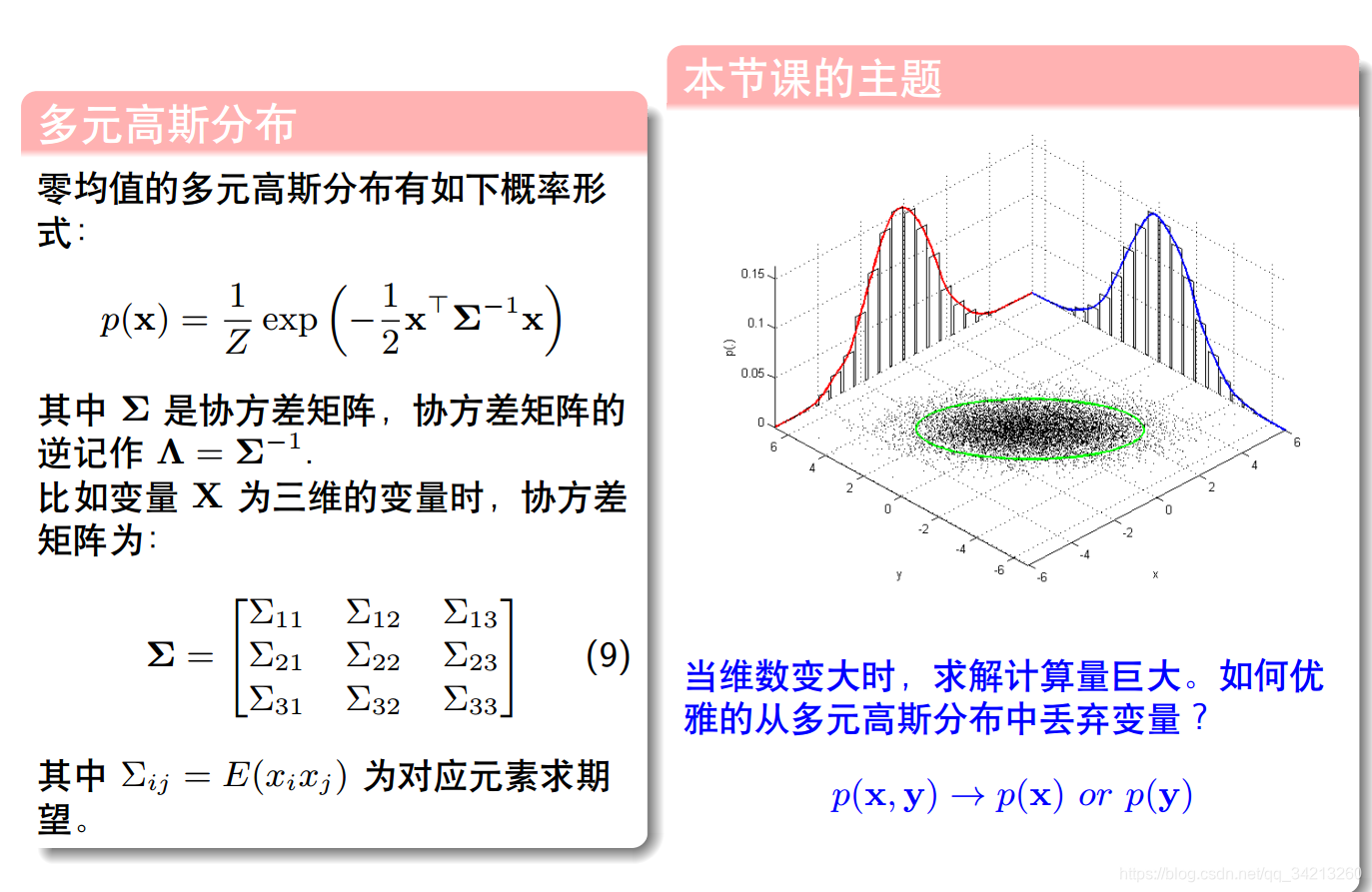

1.3 高斯分布和协方差矩阵

因为一般可以假设

x

i

和

x

j

x_{i}和 x_{j}

xi和xj是相互独立的:

因为一般可以假设

x

i

和

x

j

x_{i}和 x_{j}

xi和xj是相互独立的:

Σ

i

j

=

E

(

x

i

x

j

)

=

E

(

x

i

)

E

(

x

j

)

=

(

x

−

u

)

T

(

x

−

u

)

\Sigma_{i j}=E\left(x_{i} x_{j}\right)=E(x_i)E(x_j)=(x-u)^T(x-u)

Σij=E(xixj)=E(xi)E(xj)=(x−u)T(x−u)

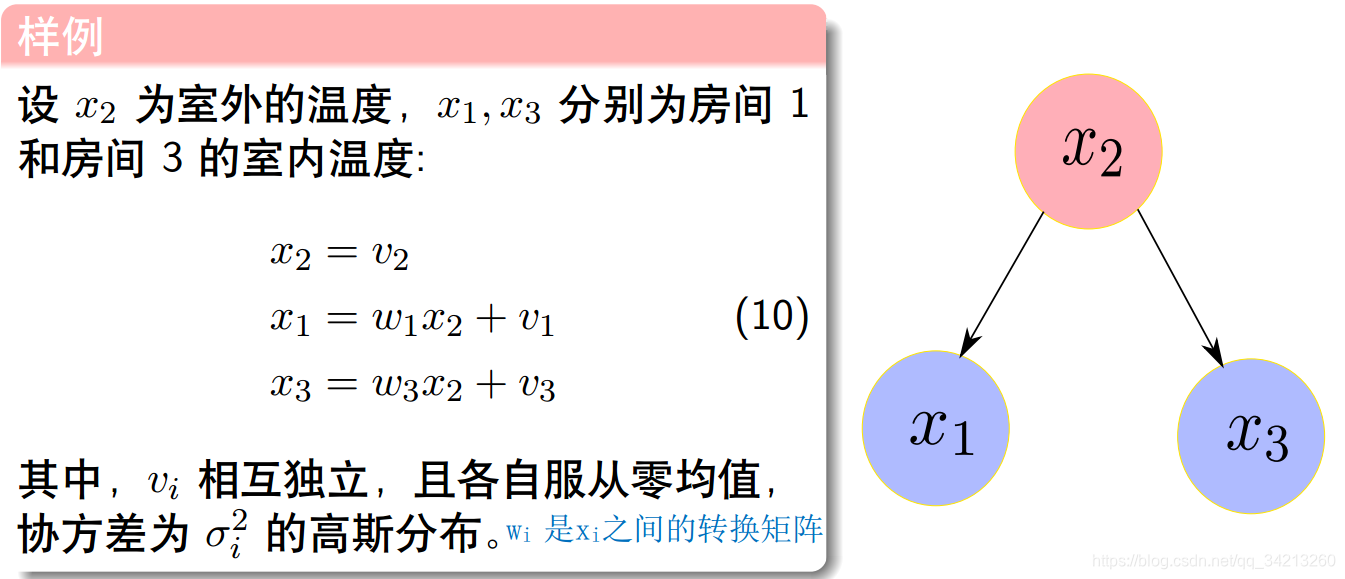

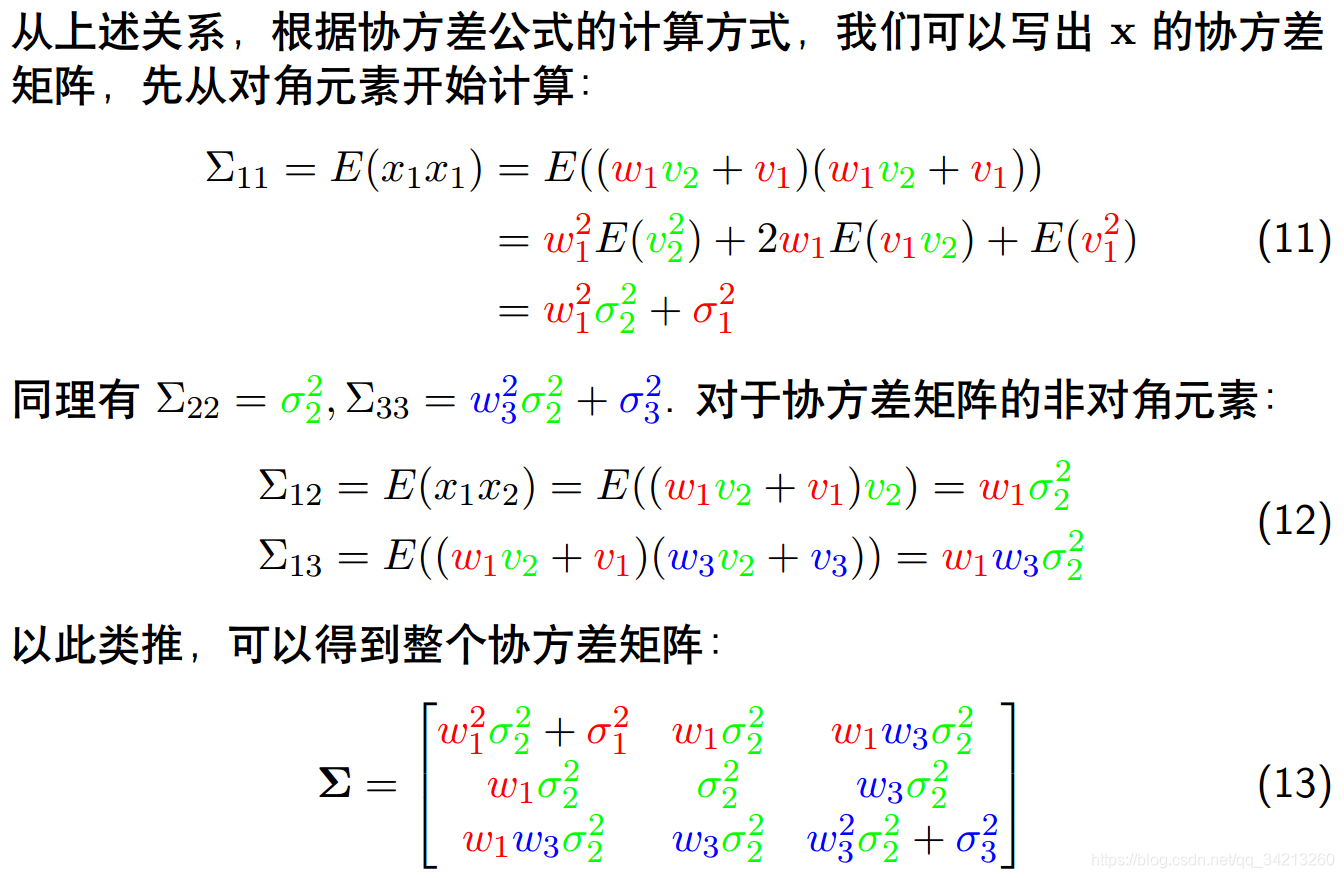

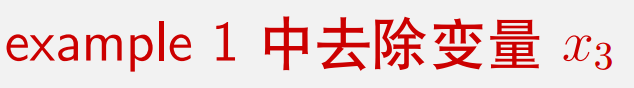

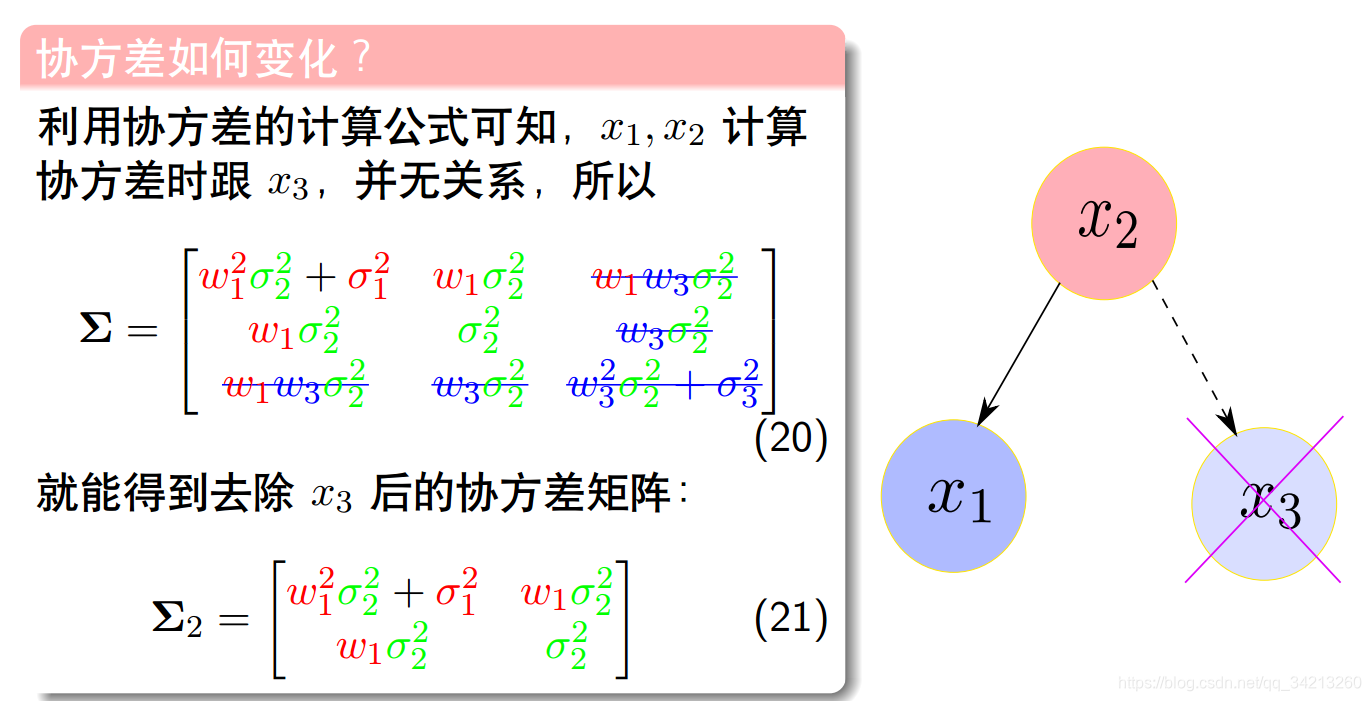

1.4 样例

1.4.1 样例1

因为实际过程中是协方差矩阵里面各个值是一个数,已经没有办法单独去掉某一部分。

因为实际过程中是协方差矩阵里面各个值是一个数,已经没有办法单独去掉某一部分。

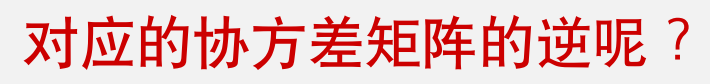

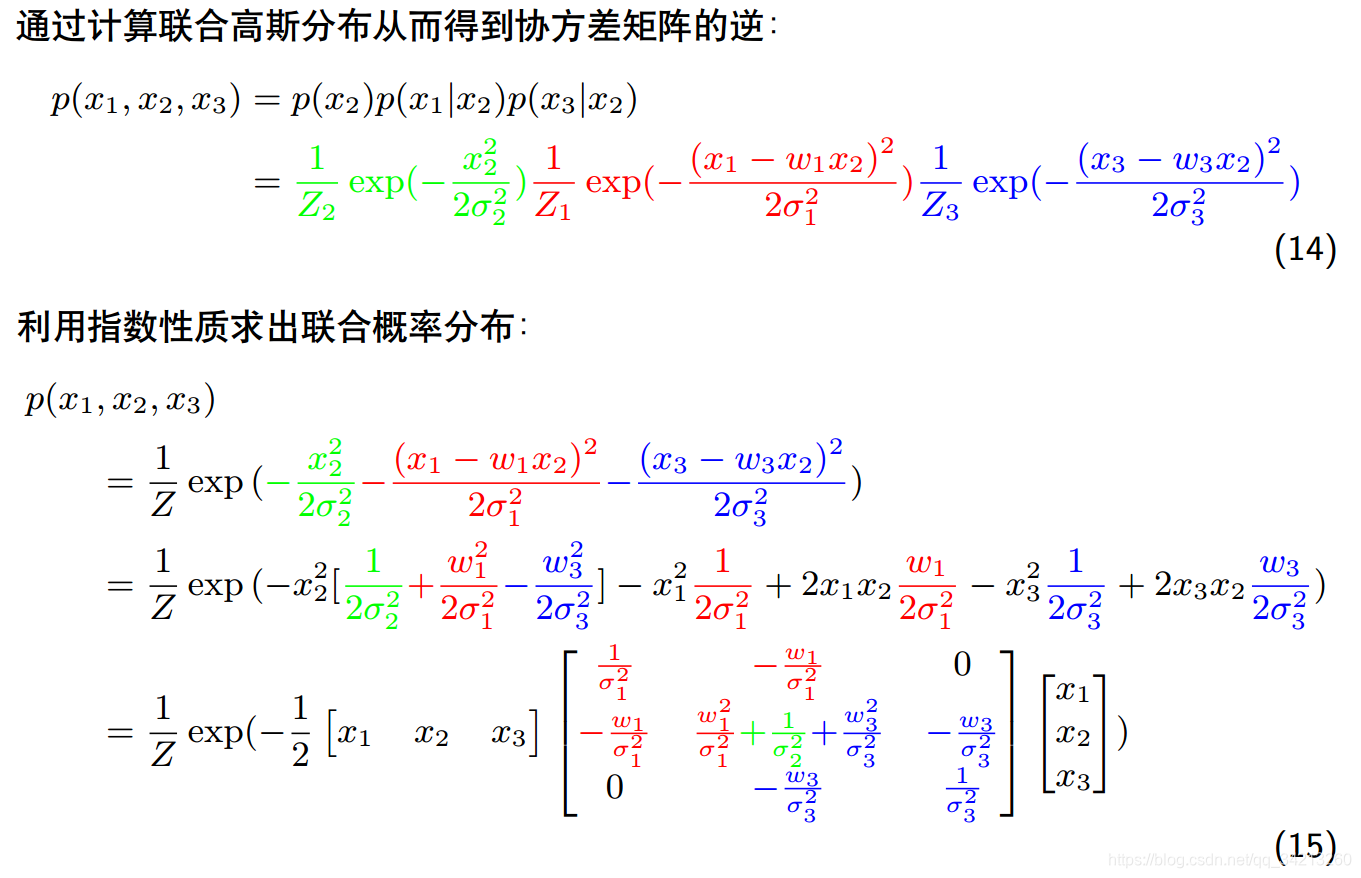

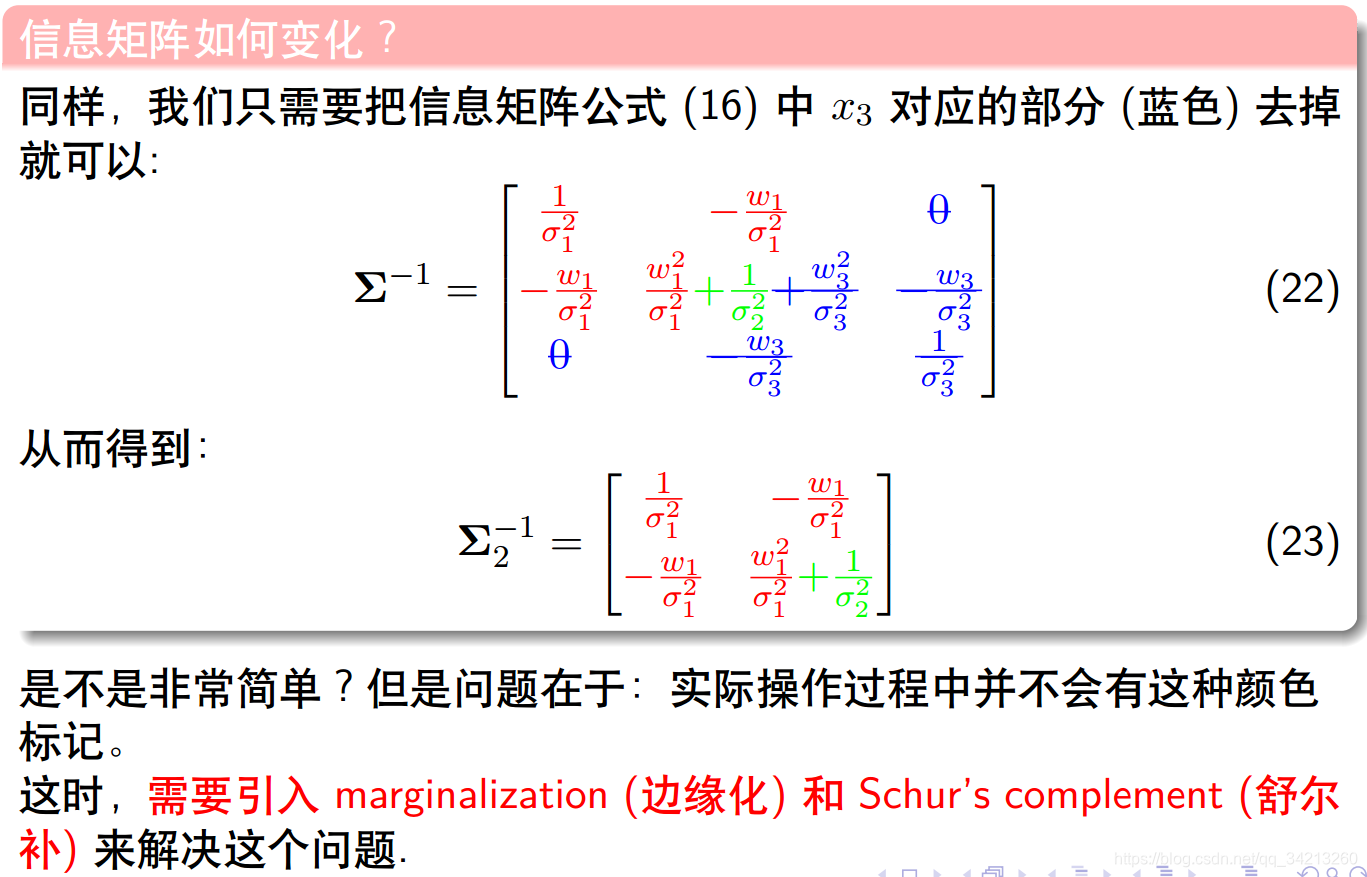

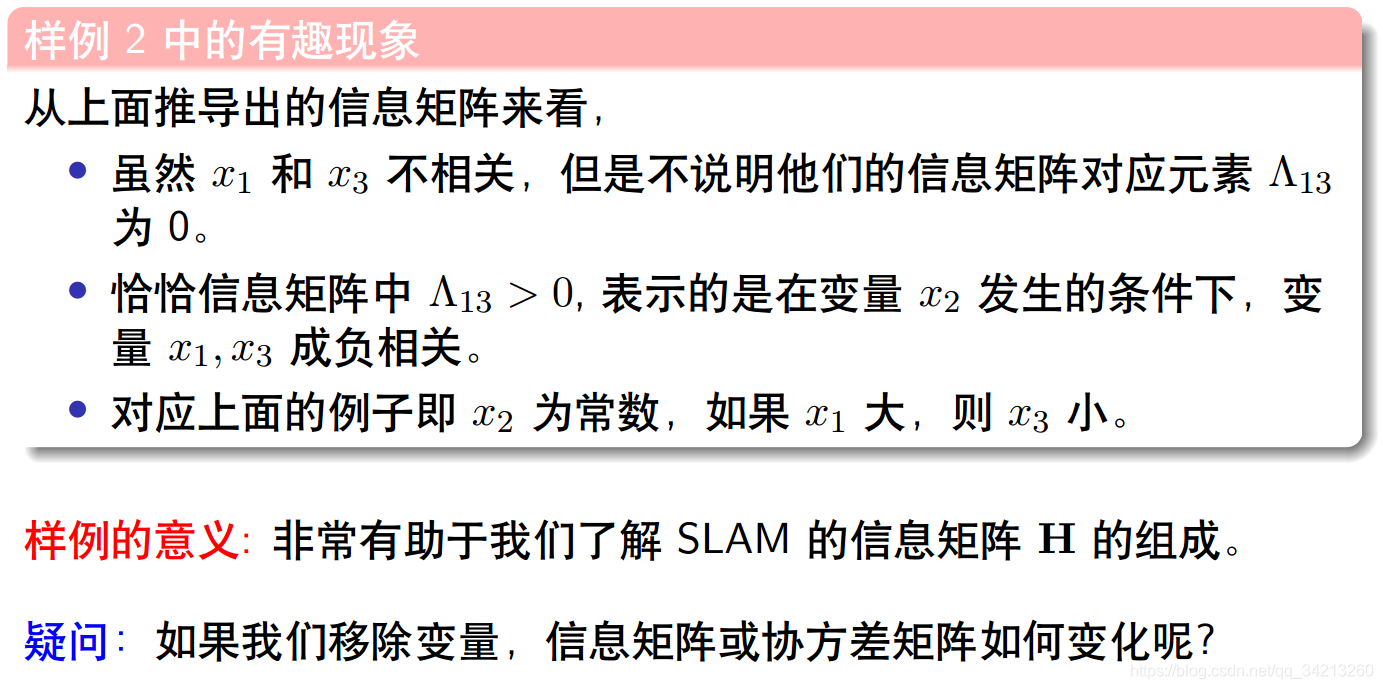

1.4.2 样例2

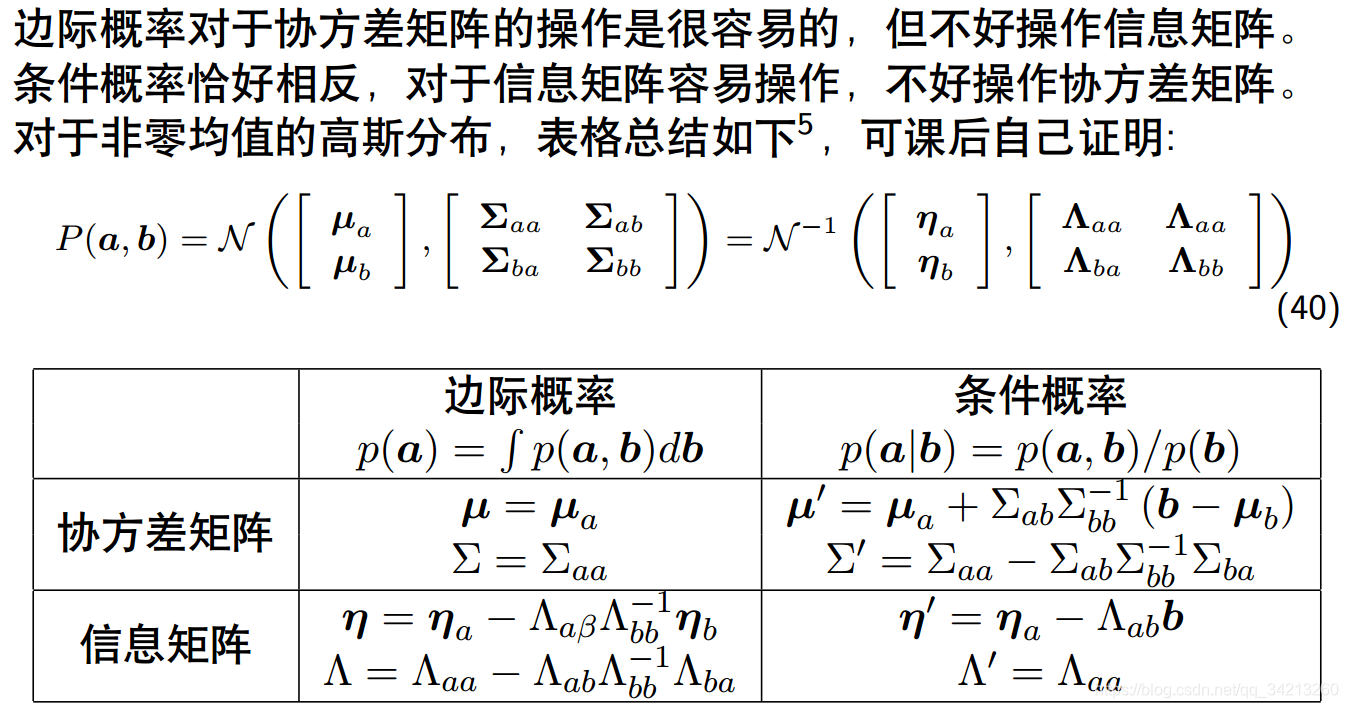

二、舒尔补应用:边际概率, 条件概率

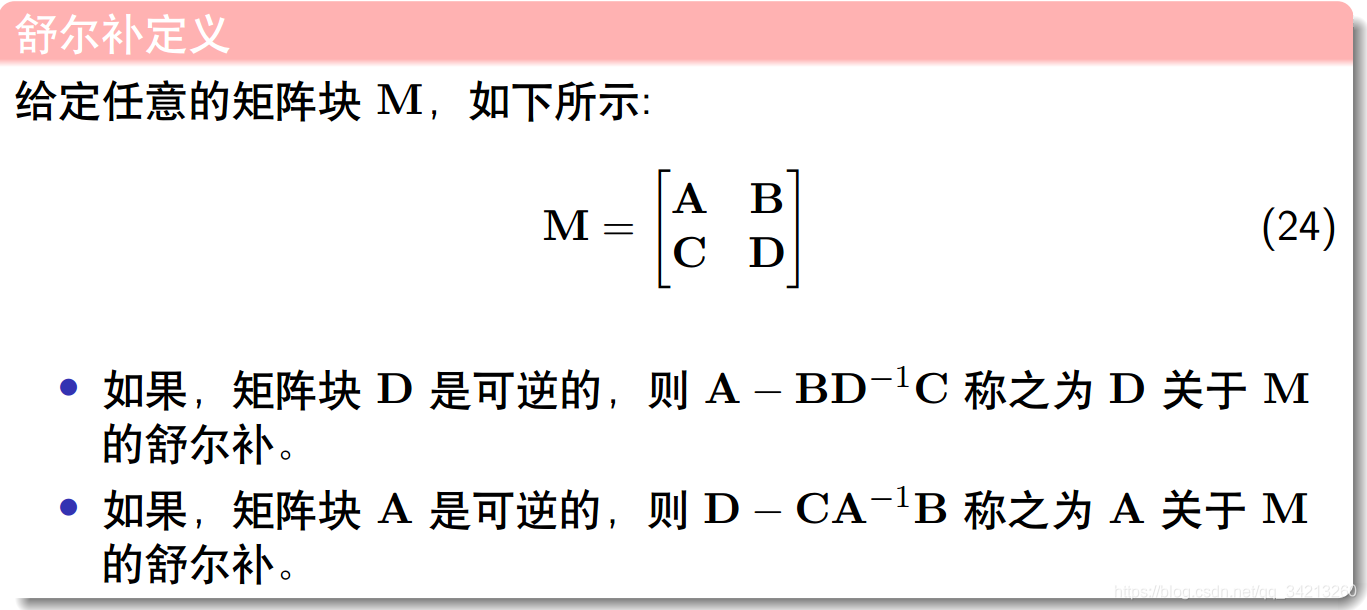

2.1 舒尔补的概念

更多定义参见:Wiki. Schur Complement.

更多定义参见:Wiki. Schur Complement.

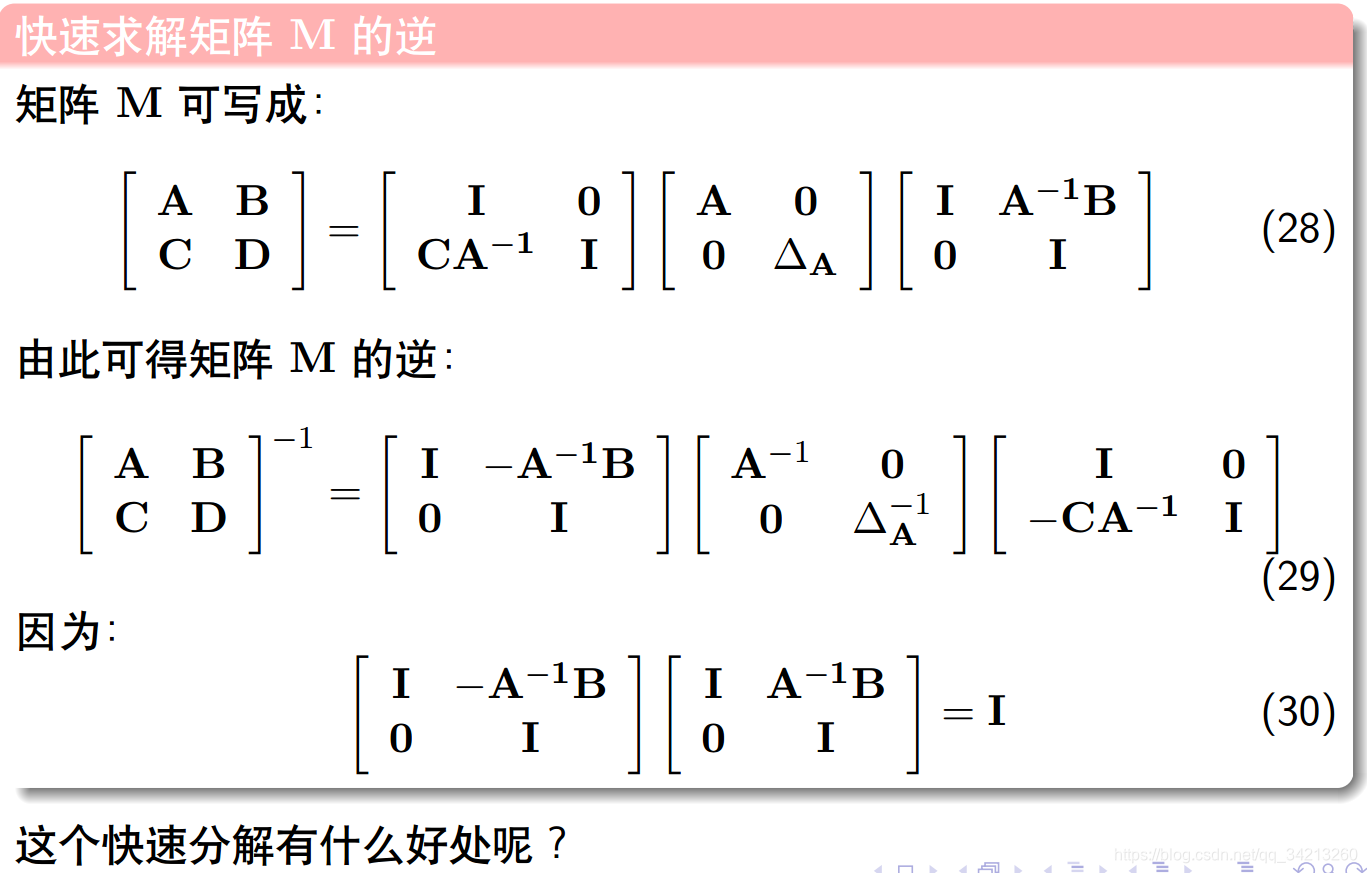

2.2 舒尔补的来由

2.3 使用舒尔补分解的好处

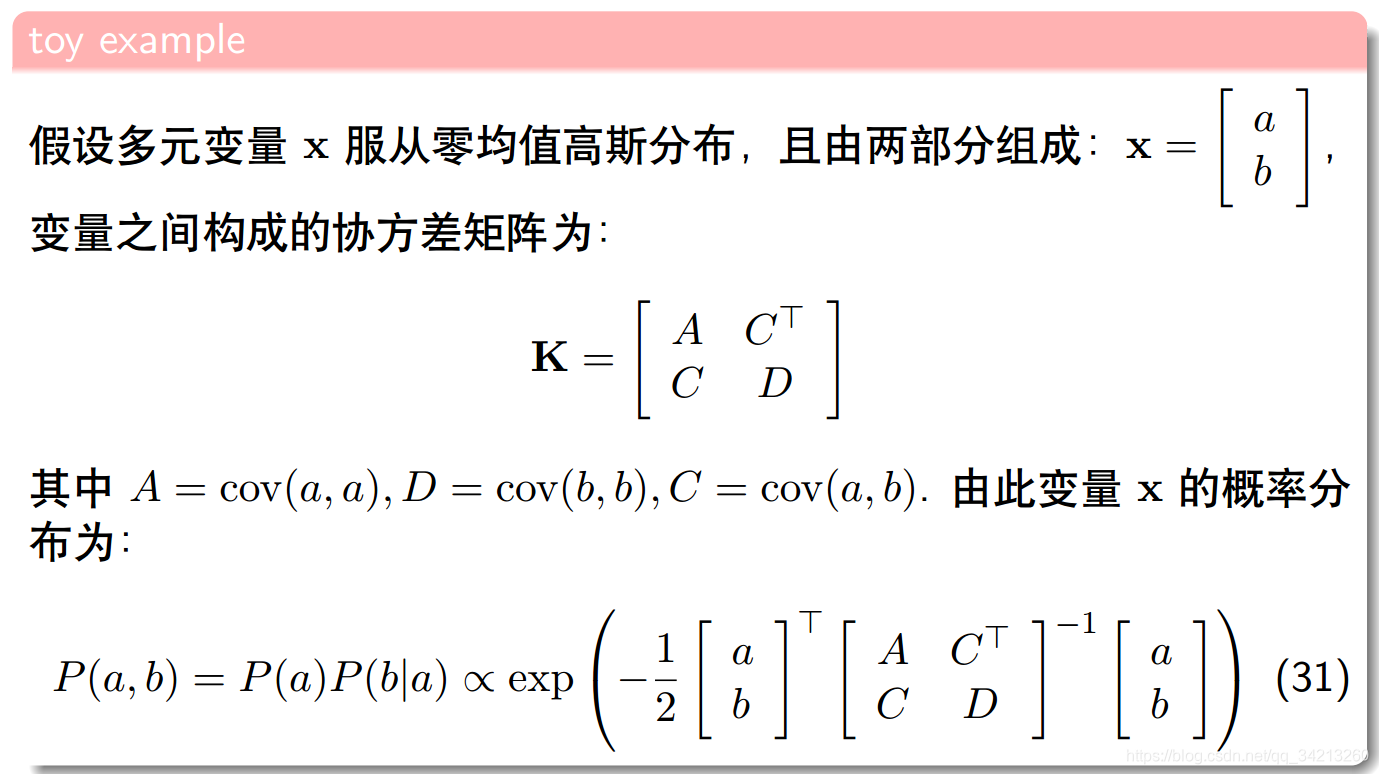

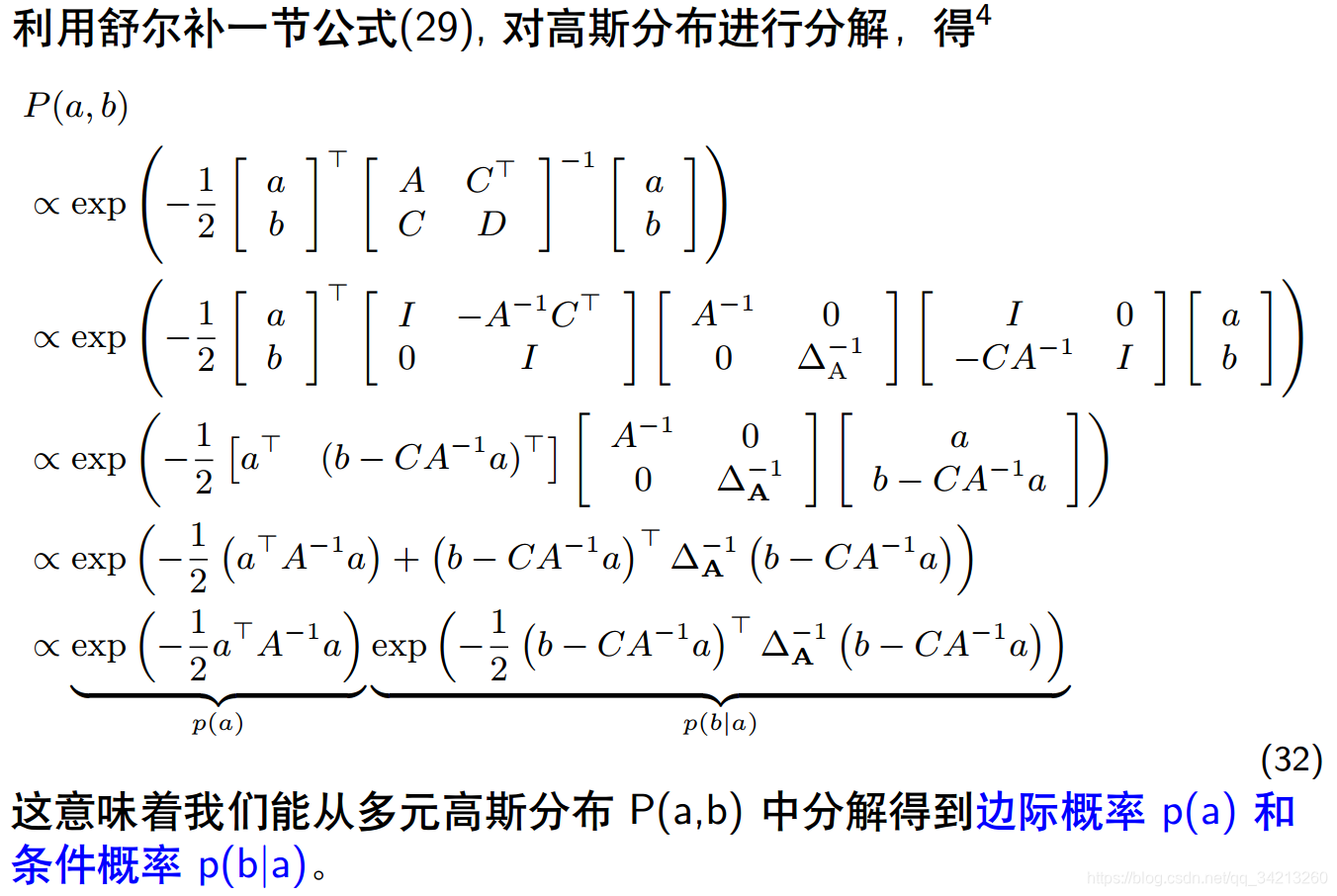

2.4 舒尔补应用于多元高斯分布

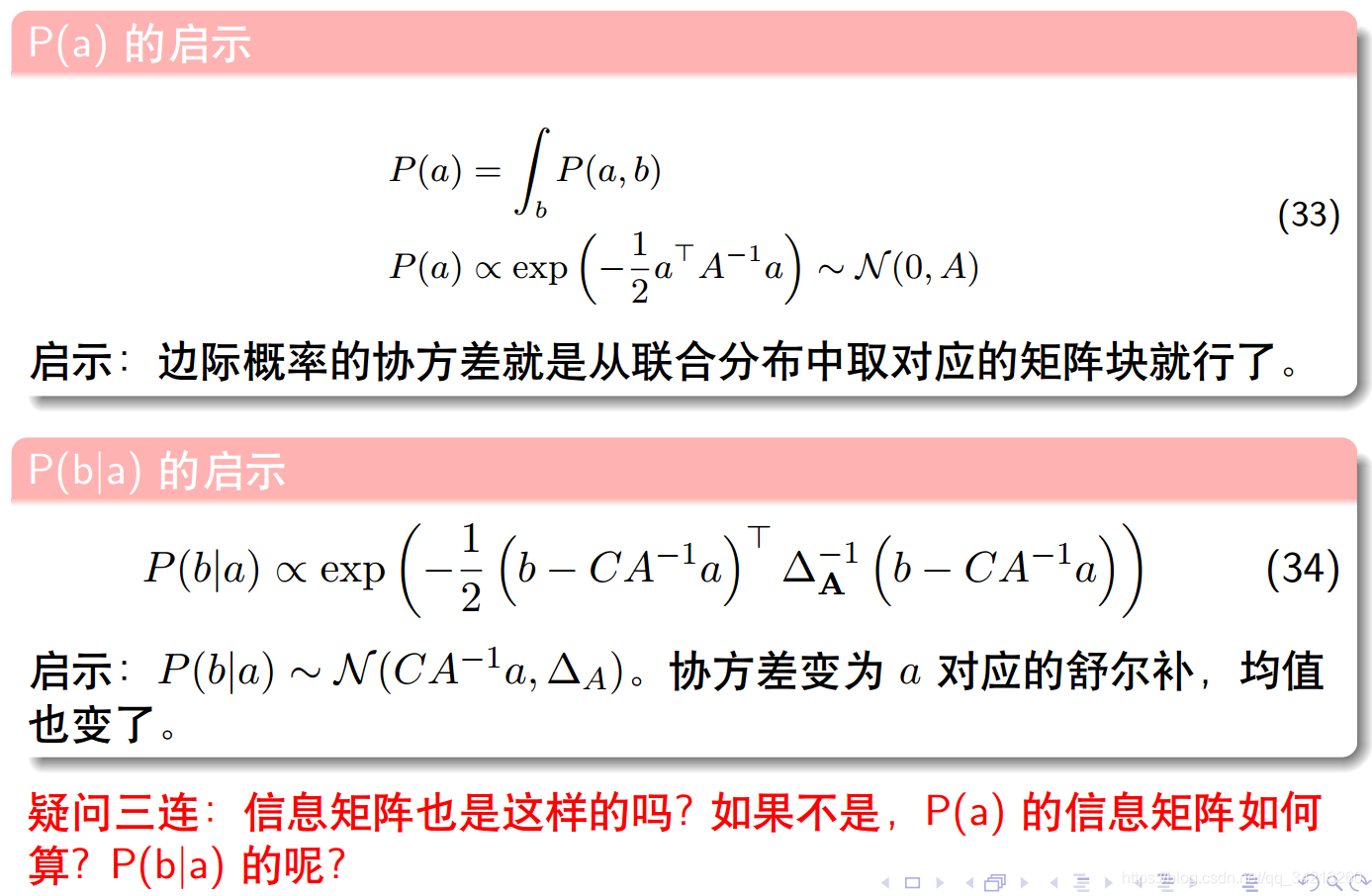

2.5 关于 P(a), P(b|a) 的协方差矩阵

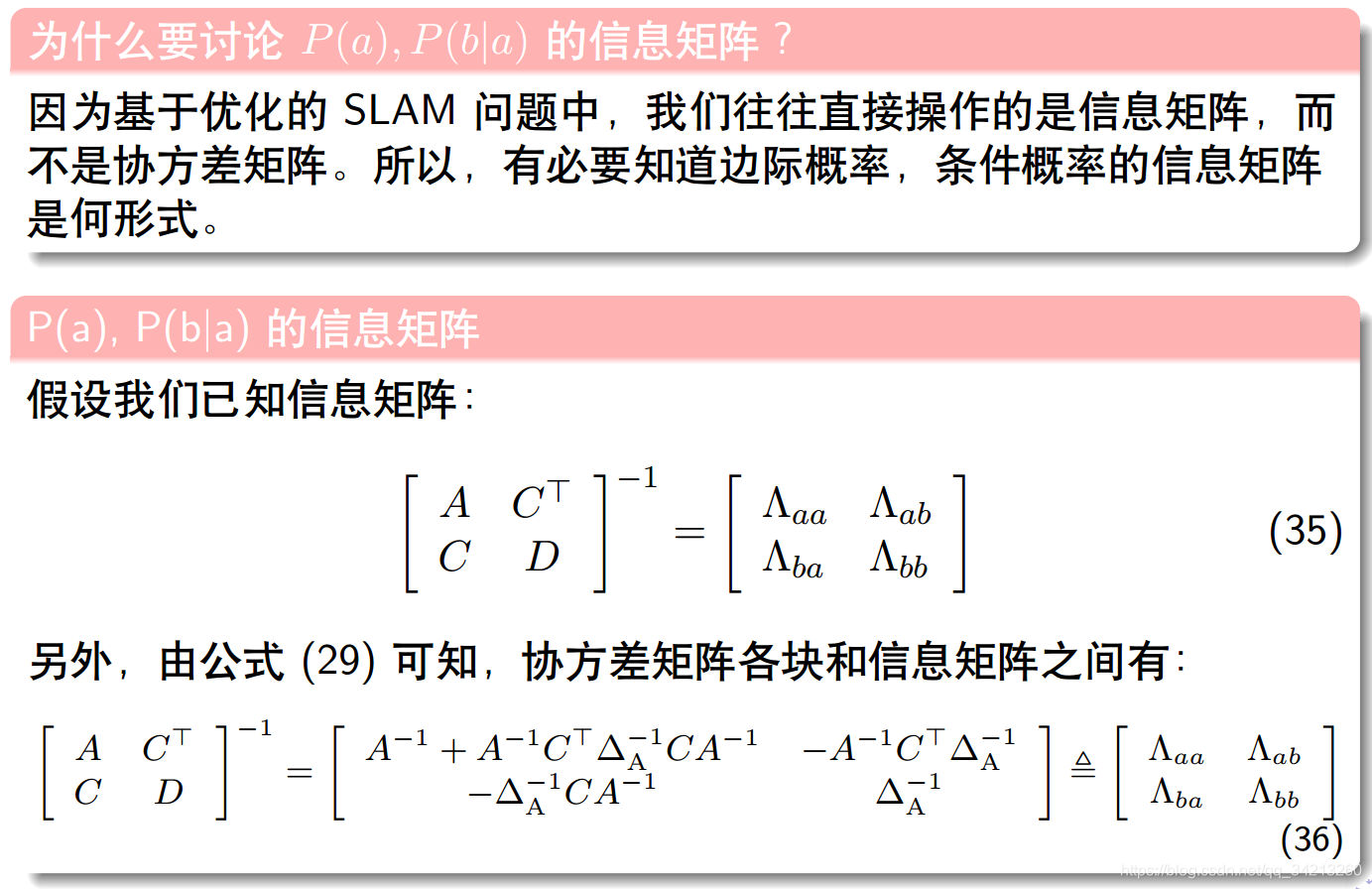

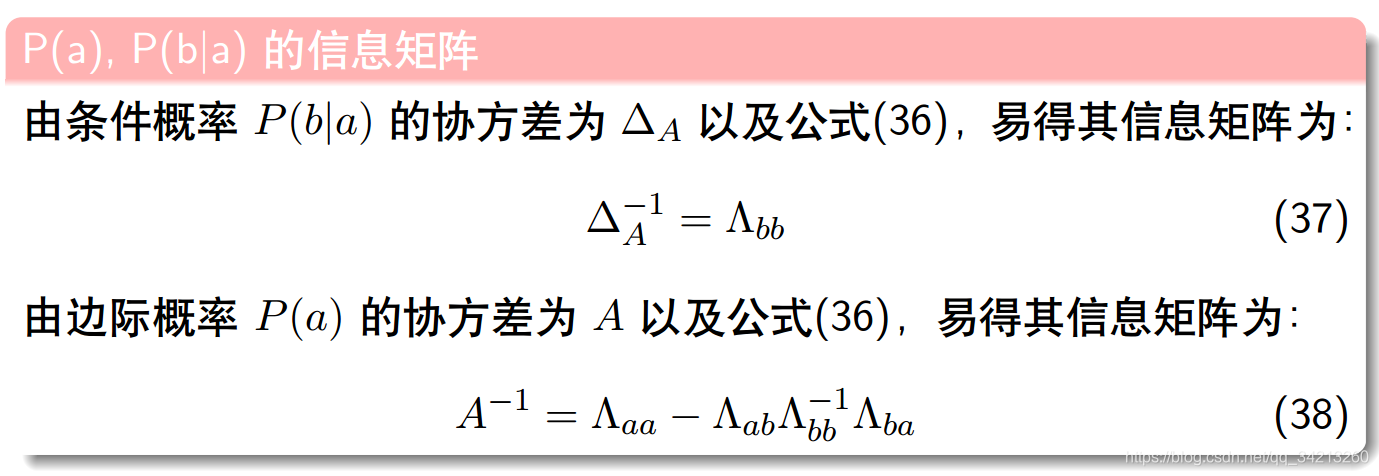

2.6 关于 P(a), P(b|a) 的信息矩阵

2.7 回顾样例

2.8 总结

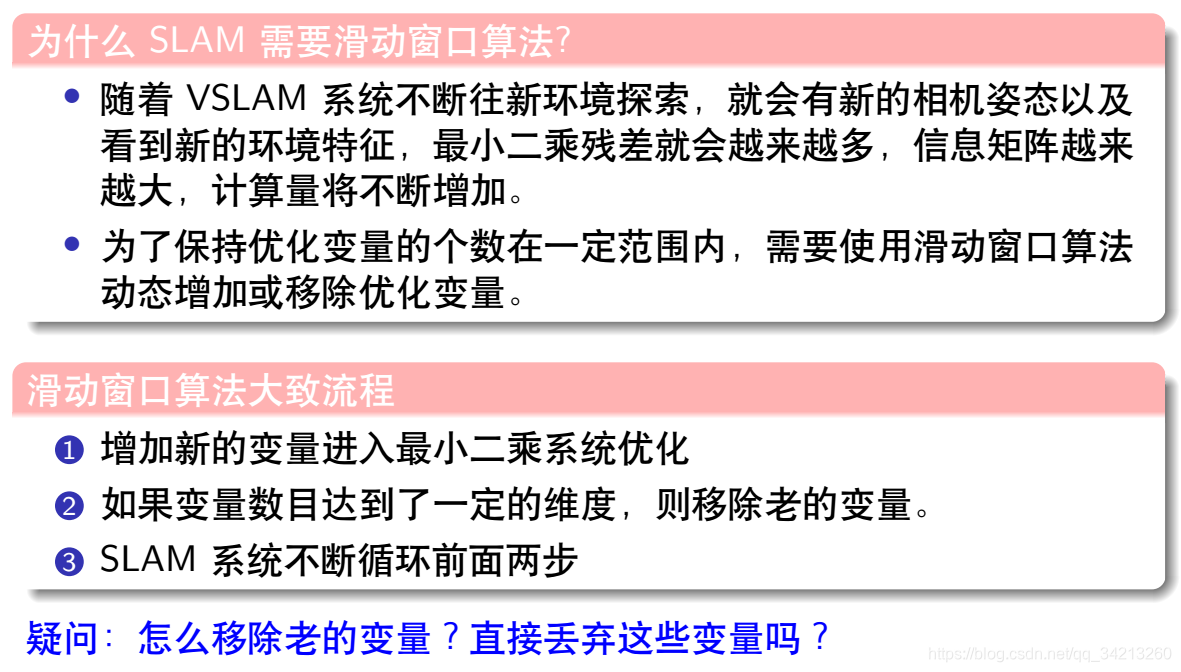

三、滑动窗口算法

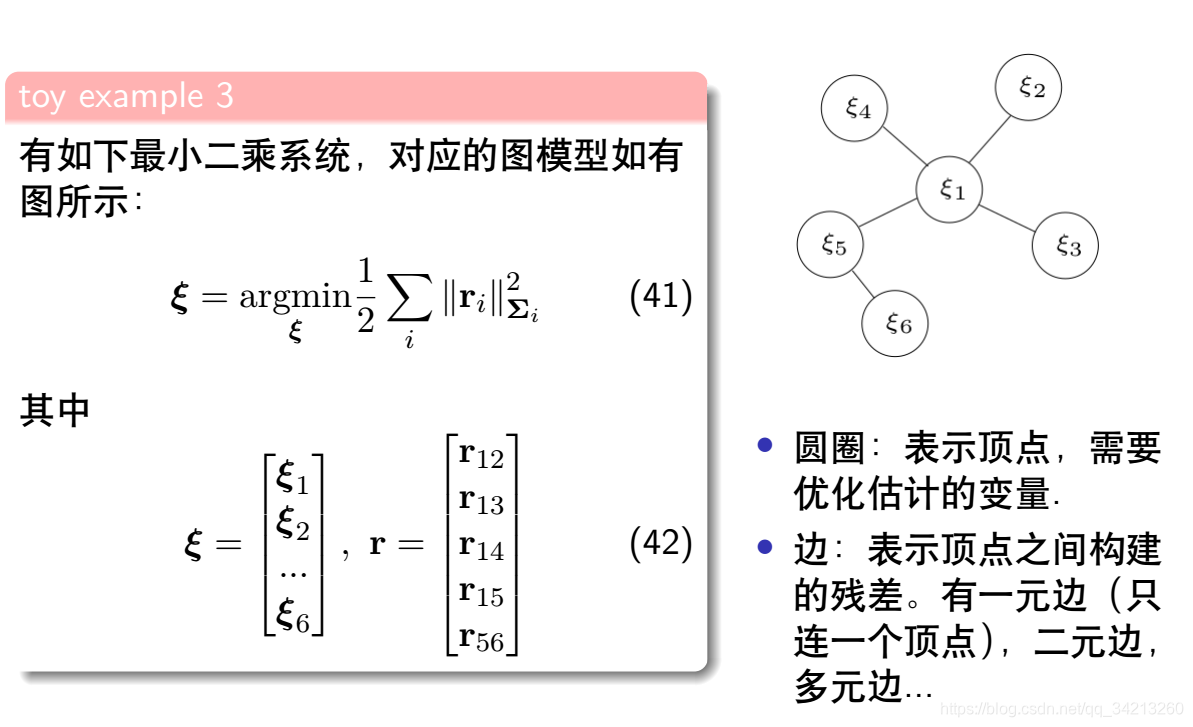

3.1 最小二乘用图表示

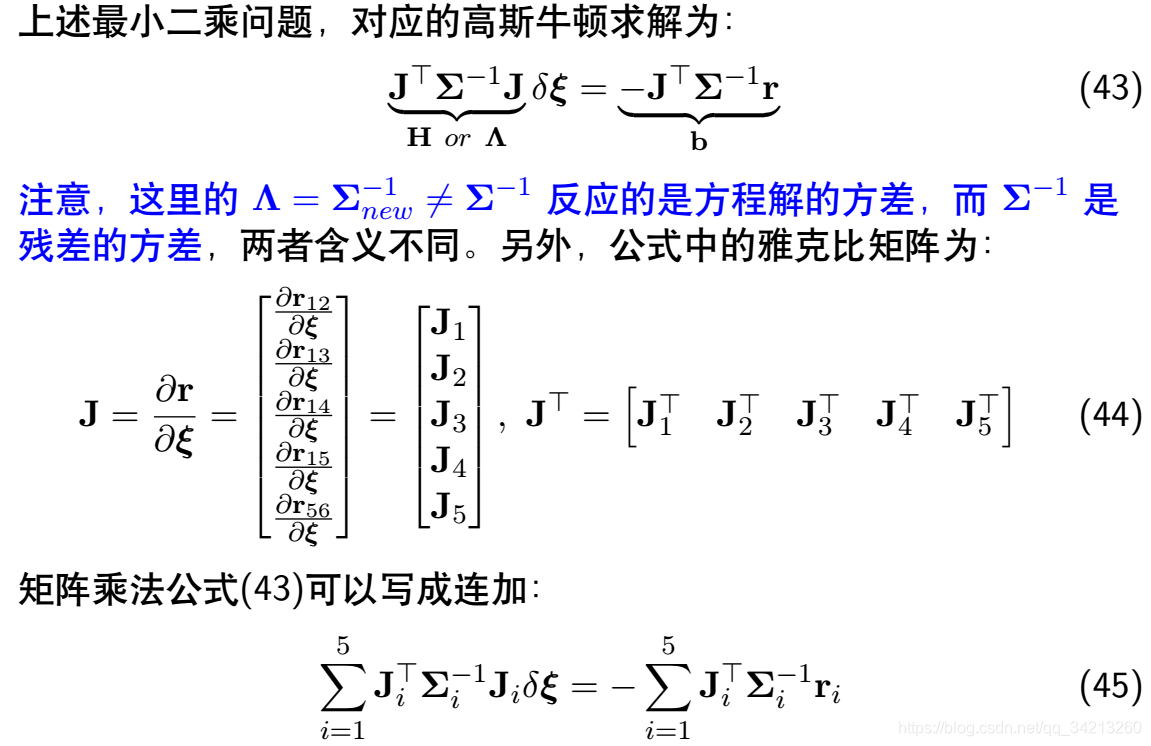

3.2 最小二乘问题信息矩阵的构成

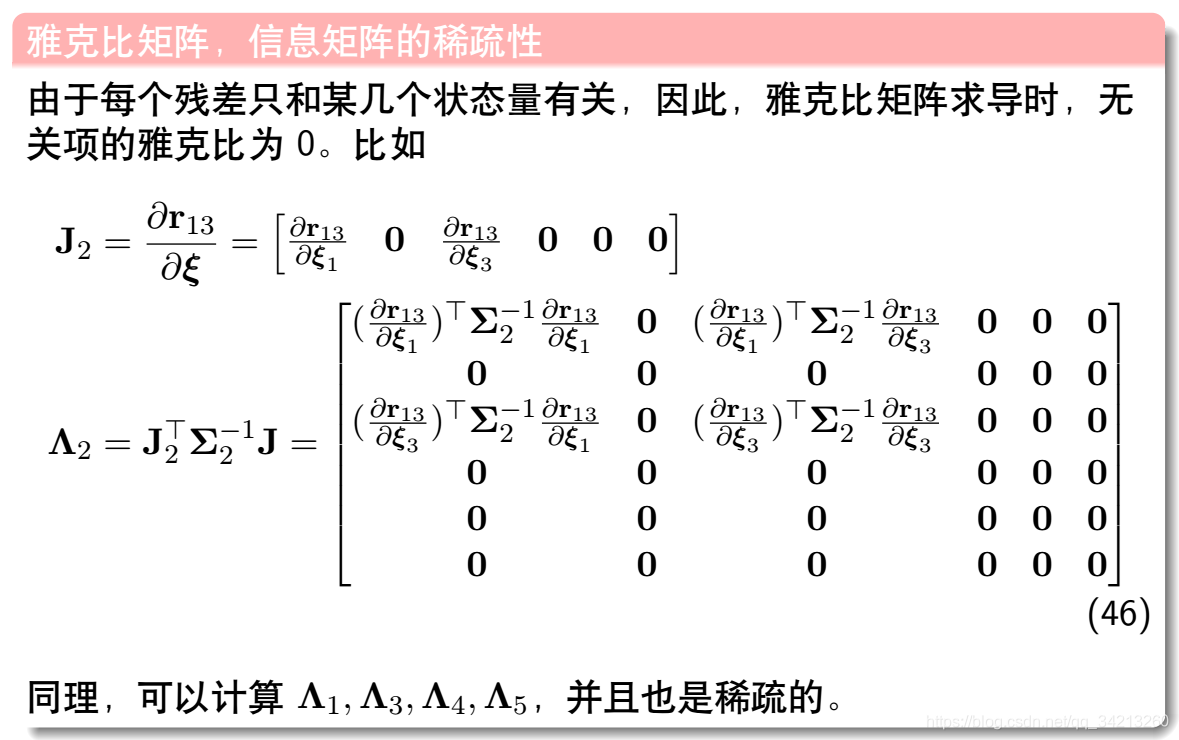

3.3 信息矩阵的稀疏性

3.4 信息矩阵组装过程的可视化

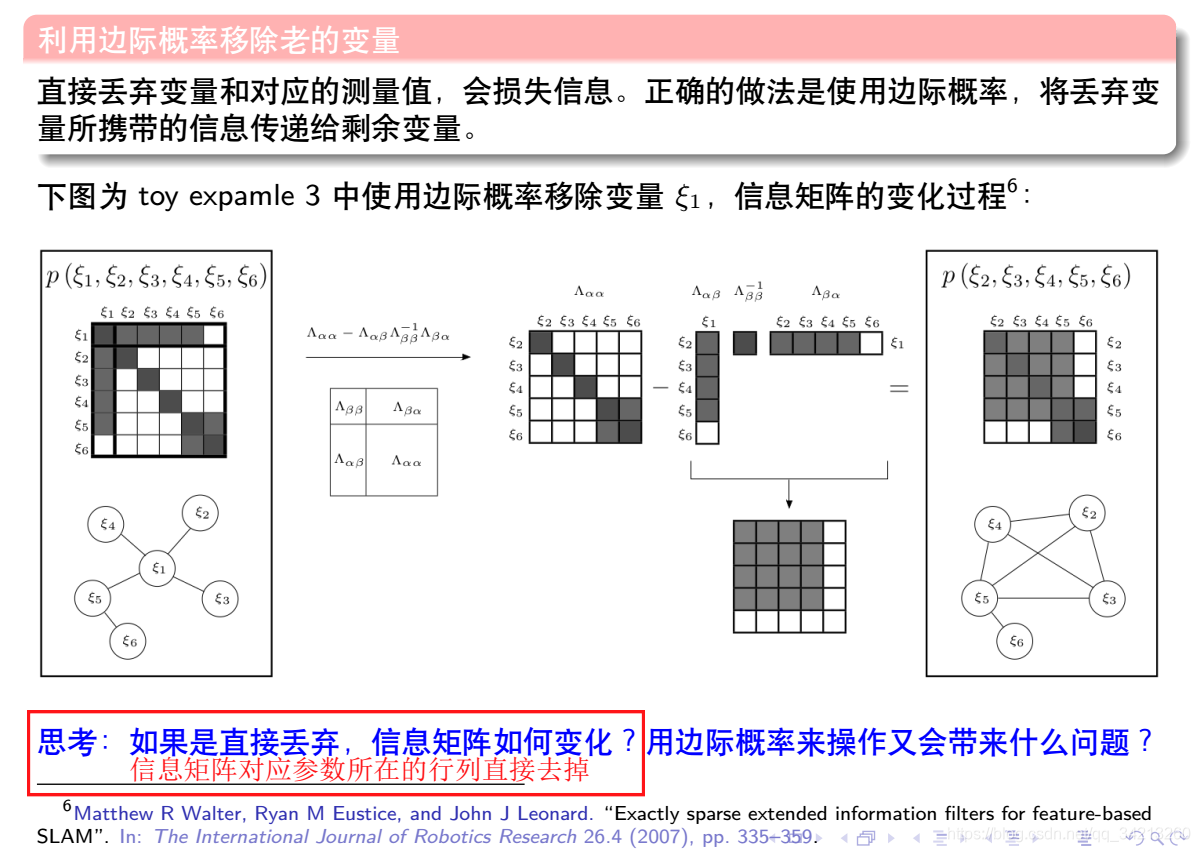

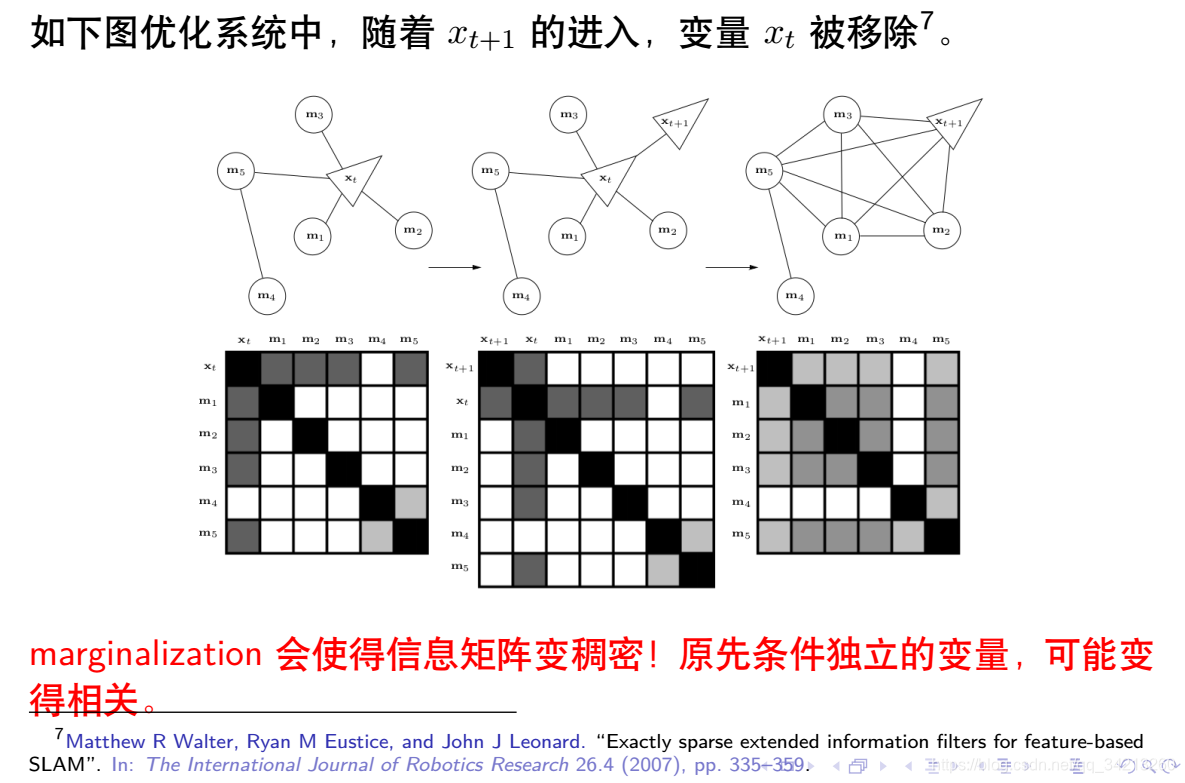

3.5 基于边际概率的滑动窗口算法

公式表示:

公式表示:

假设要被边缘化的状态是

δ

x

a

\delta x_a

δxa

因为在实际滑窗中

δ

x

a

\delta x_a

δxa的状态已经被移出去了,所以不会再产生约束,所以只展开矩阵第二行。

可以看到新的方程只和

δ

x

b

\delta x_b

δxb相关,但是

δ

x

a

\delta x_a

δxa的信息又被保留了下来。接下来只需把最后的公式重写分解成以下形式就又形成了常见后端中的边缘化约束

J

⊤

J

⏟

H

or

Λ

δ

ξ

=

−

J

⊤

r

⏟

b

\underbrace{\mathbf{J}^{\top} \mathbf{J}}_{\mathbf{H} \text { or } \boldsymbol{\Lambda}} \delta \boldsymbol{\xi}=\underbrace{-\mathbf{J}^{\top} \mathbf{r}}_{\mathbf{b}}

H or Λ

J⊤Jδξ=b

−J⊤r

对H矩阵作特征值分解

H

=

V

Σ

V

T

H = V\Sigma V^T

H=VΣVT.

V

是

特

征

向

量

,

Σ

是

特

征

值

构

成

的

对

角

矩

阵

V是特征向量,\Sigma是特征值构成的对角矩阵

V是特征向量,Σ是特征值构成的对角矩阵 同时又

H

=

J

T

J

H = J^TJ

H=JTJ,所以

J

=

Σ

V

T

J = \sqrt{\Sigma}V^T

J=ΣVT

同理

r

=

−

(

J

T

)

−

1

∗

b

r = -(J^T)^{-1}*b

r=−(JT)−1∗b

3.6 样例

详细步骤如下:

详细步骤如下:

左边为因子图,右边为其对应的H矩阵

如果边缘化掉pose1会发生什么?

如果边缘化掉pose1会发生什么?

四、滑动窗口中的 FEJ 算法

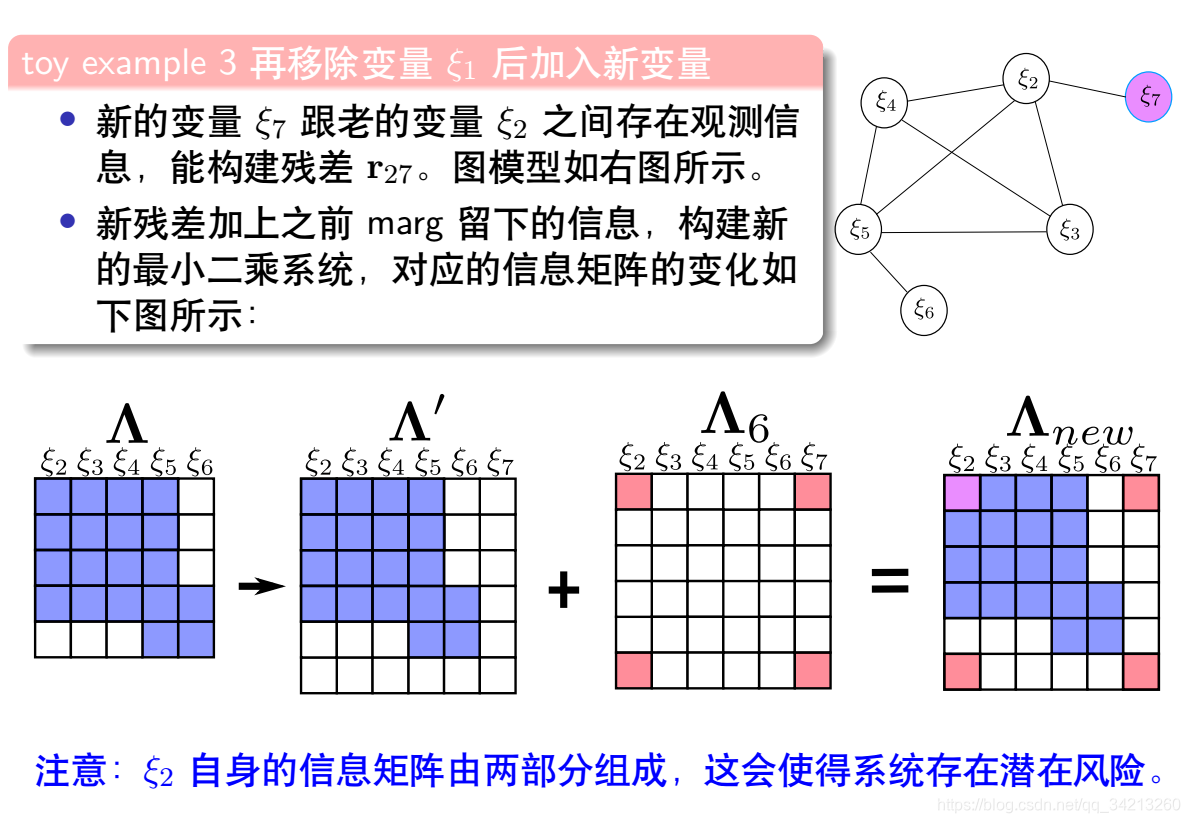

4.1 新测量信息和旧测量信息构建新的系统

4.2 信息矩阵的零空间变化

4.3 可观性的一种定义

2027

2027

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?