【AIGC】WIN10极速部署OpenManus(带WEBUI)

为了方便大家无需魔法即可获取教程中需要的zip文件,

已整理资源全家桶,请在百度网盘下载。

(其中含OpenManus+OpenManusWEBUI+Conda+Ollama(2025/3/21更新))

https://download.csdn.net/download/qq_35079107/90519660

一、OpenManus快速部署

1.安装Conda(请注意仅供学习研究使用,企业商用需联系官方)

https://www.anaconda.com/download

(官方链接免费获取)

国内镜像地址下载地址:https://mirrors.tuna.tsinghua.edu.cn/anaconda/archive/?C=M&O=D

根据自己电脑的操作系统选择下载并直接安装。

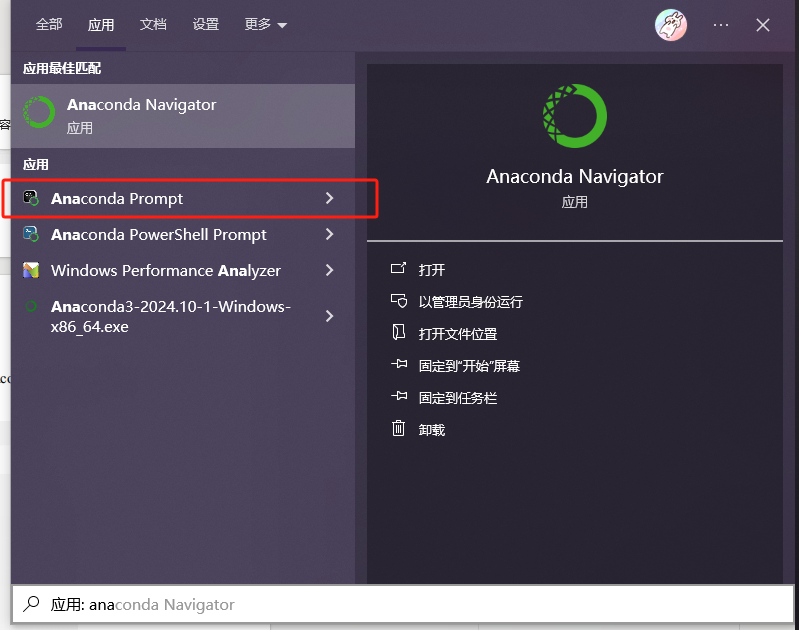

安装后在系统的“开始”—> “所有应用”中找到 Anaconda3,找到Anaconda Prompt

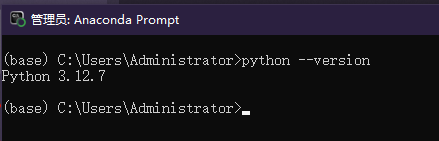

在 Anaconda Prompt 中输入命令python --version,出现任意Python 版本号即表示安装成功

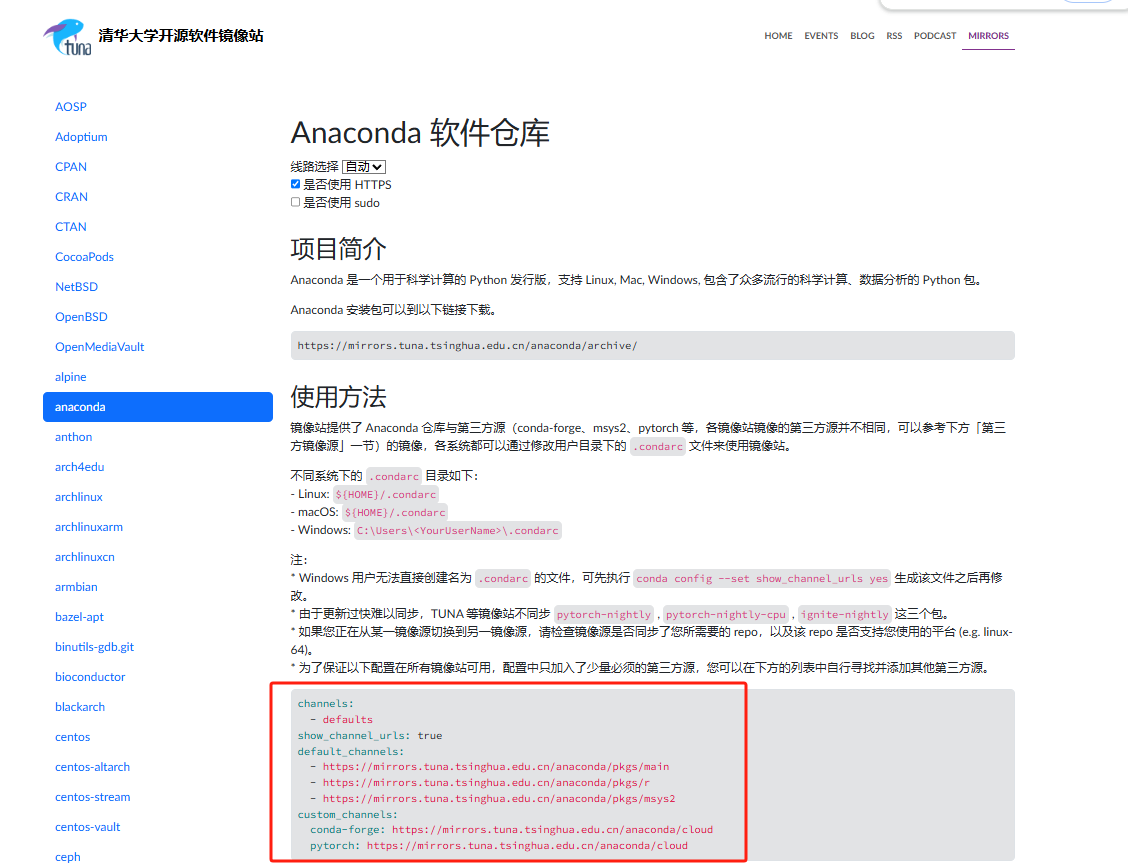

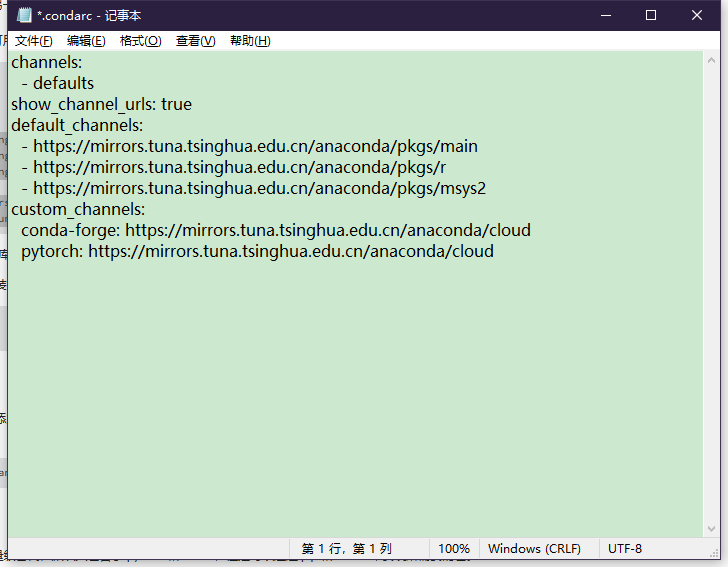

*2.配置镜像(如果有魔法不需要这一步)

在打开的命令行中输入以下命令,并回车执行

conda config --set show_channel_urls yes

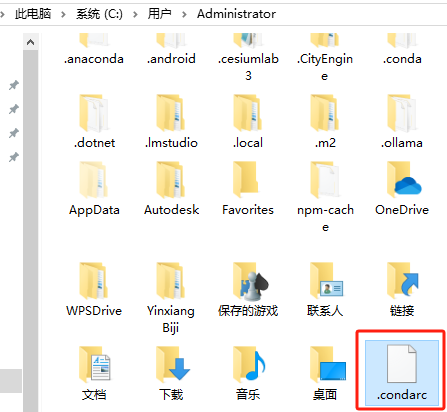

完成后打开在 Windows 系统中,找到 C:\用户\<你的用户名>\.condarc 文件

右键用记事本打开,粘贴以下命令

channels:

- defaults

show_channel_urls: true

default_channels:

- https://mirrors.tuna.tsinghua.edu.cn/anaconda/pkgs/main

- https://mirrors.tuna.tsinghua.edu.cn/anaconda/pkgs/r

- https://mirrors.tuna.tsinghua.edu.cn/anaconda/pkgs/msys2

custom_channels:

conda-forge: https://mirrors.tuna.tsinghua.edu.cn/anaconda/cloud

pytorch: https://mirrors.tuna.tsinghua.edu.cn/anaconda/cloud

来源:https://mirrors.tuna.tsinghua.edu.cn/help/anaconda/

在 Anaconda Prompt 命令行中,清理缓存:

conda clean -i

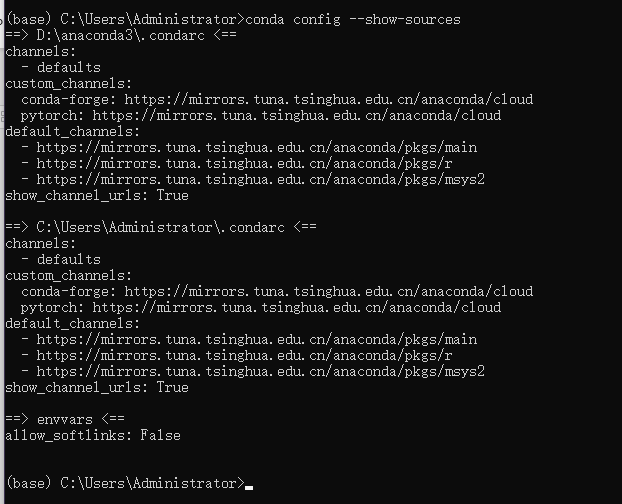

验证结果

conda config --show-sources

(只要出现国内镜像即可,本示例中有两个配置地址。)

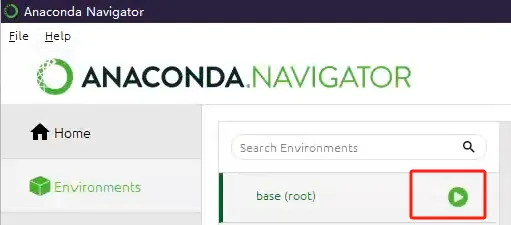

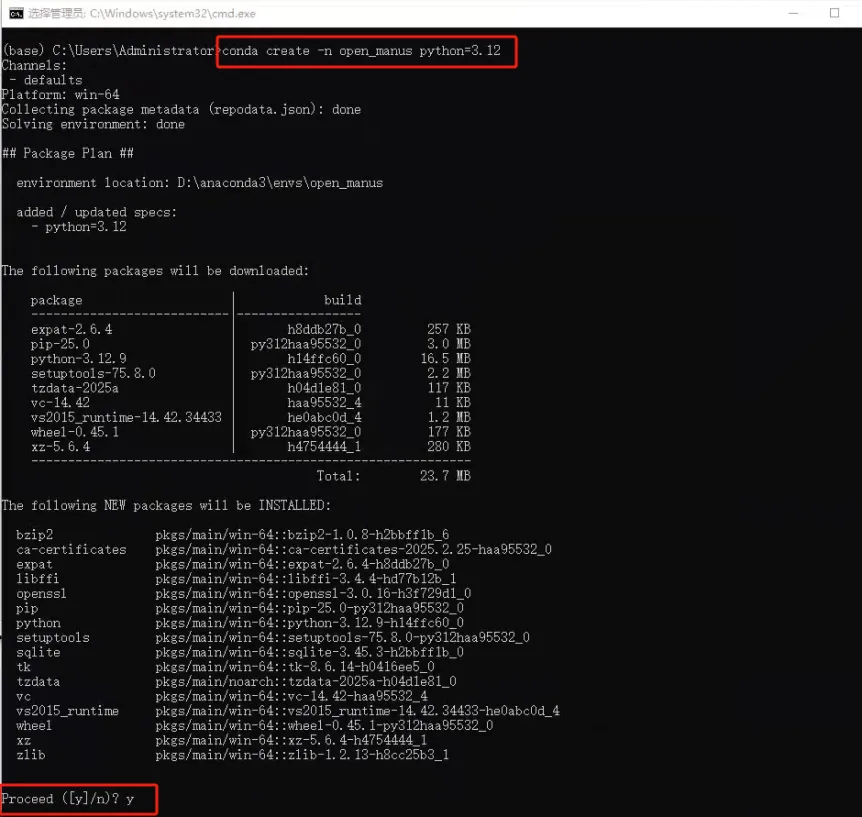

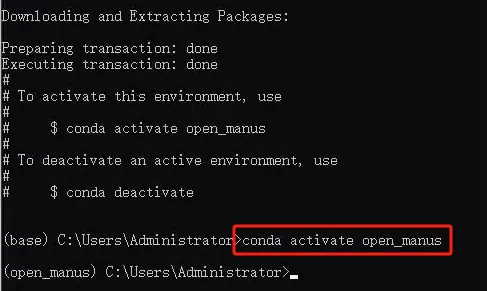

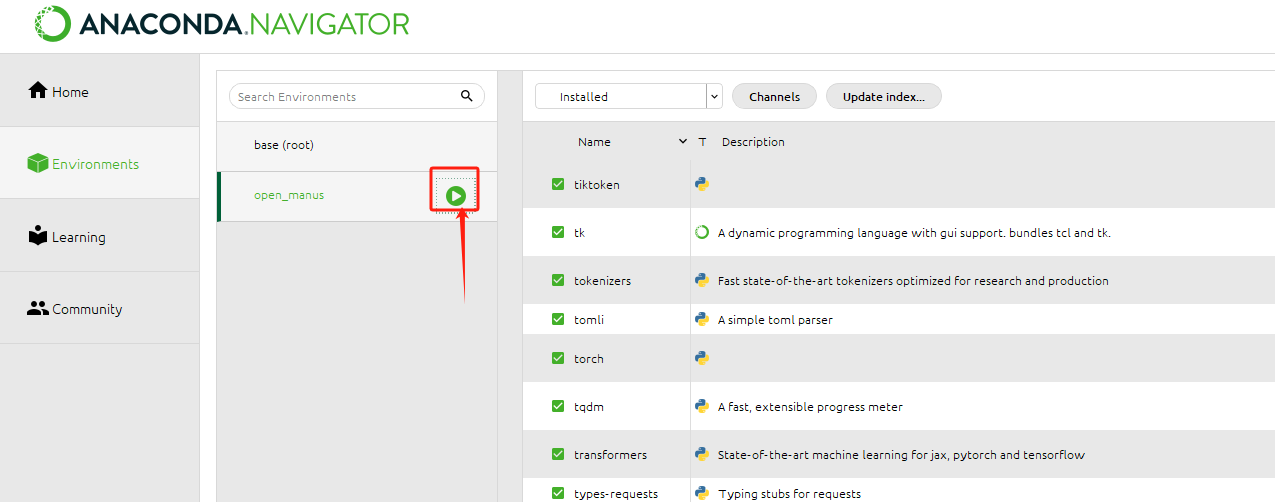

3.创建新环境

一键安装完成后打开Conda软件,点击base(root)右侧的按钮以打开控制台命令输入。

输入命令conda create -n open_manus python=3.12

输入命令conda activate open_manus

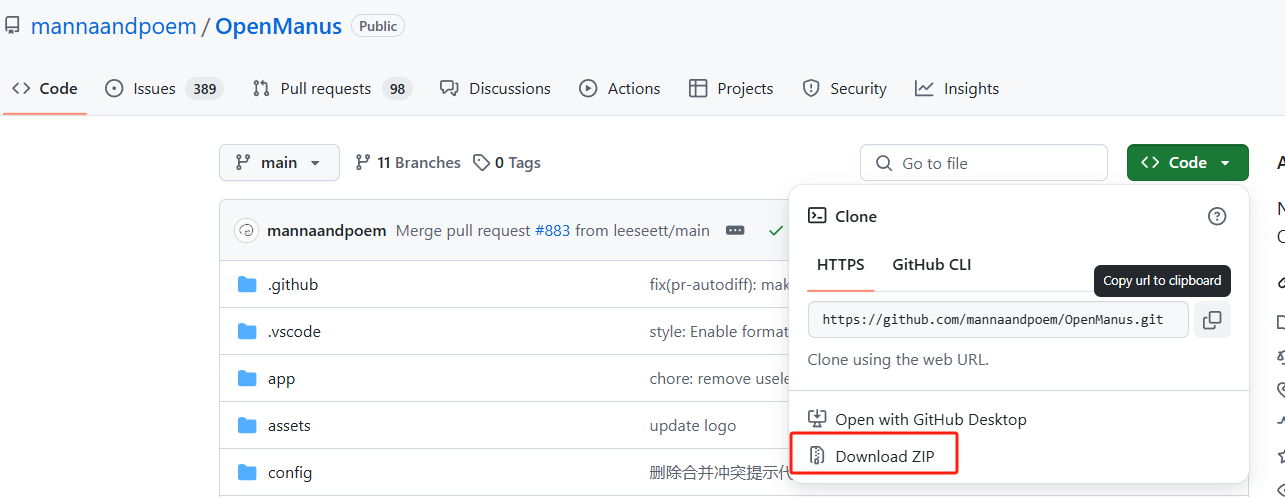

4.下载OpenManus包

访问https://github.com/mannaandpoem/OpenManus

下载好zip包

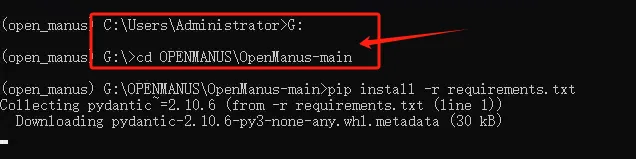

通过命令行进入到解压路径

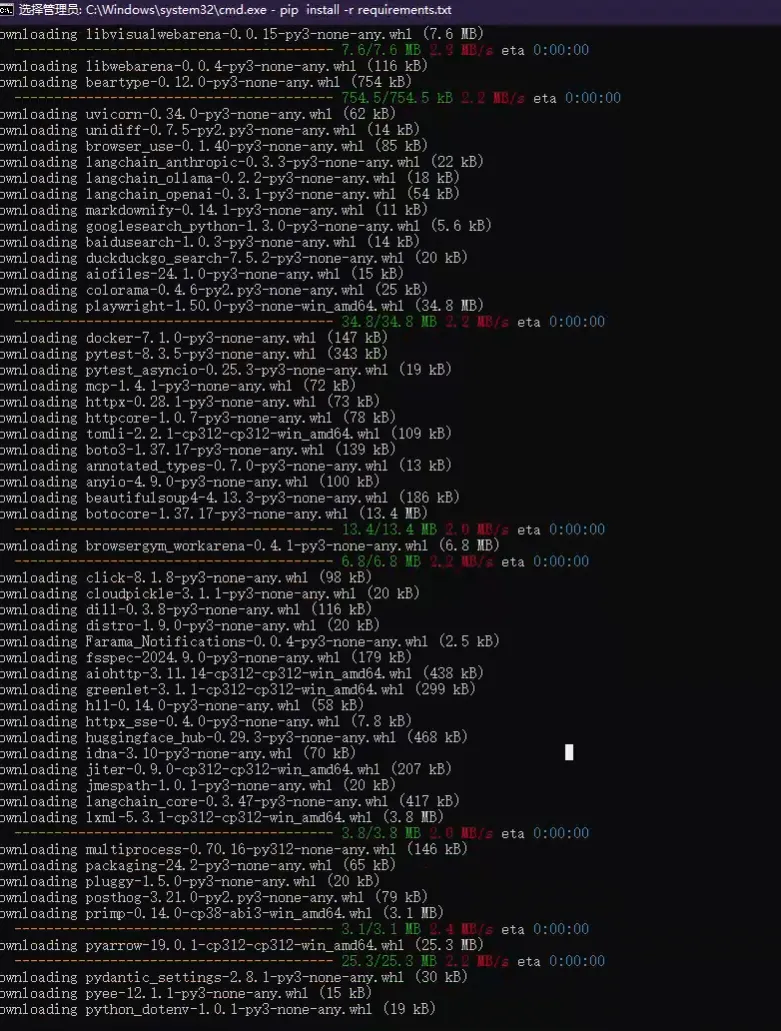

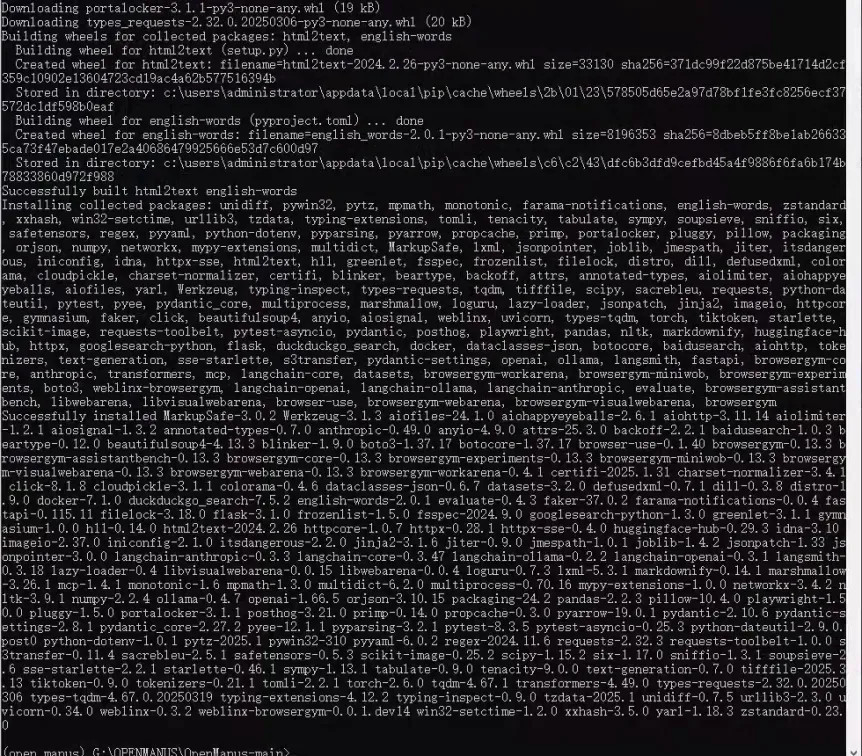

输入pip install -r requirements.txt

下载过程如果中断,enter键继续。

可选操作:playwright install 安装一个浏览器自动化工具

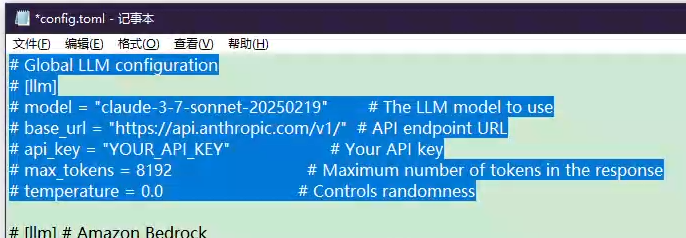

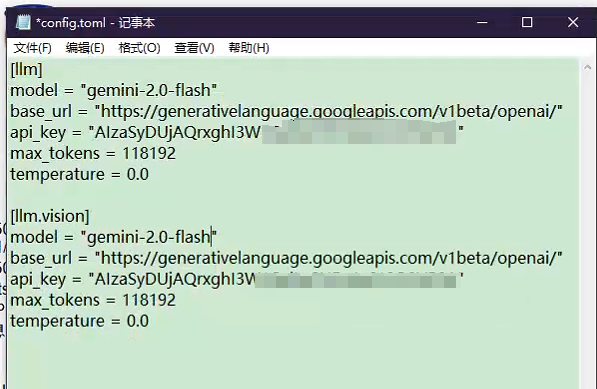

二、配置使用的 LLM API

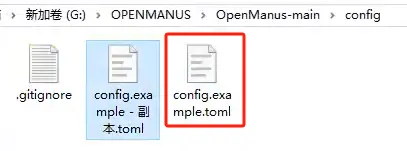

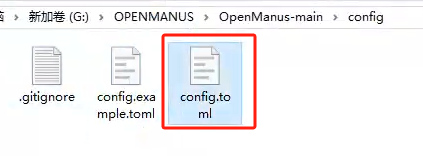

直接到这个路径下,从示例复制一个副本,重命名为

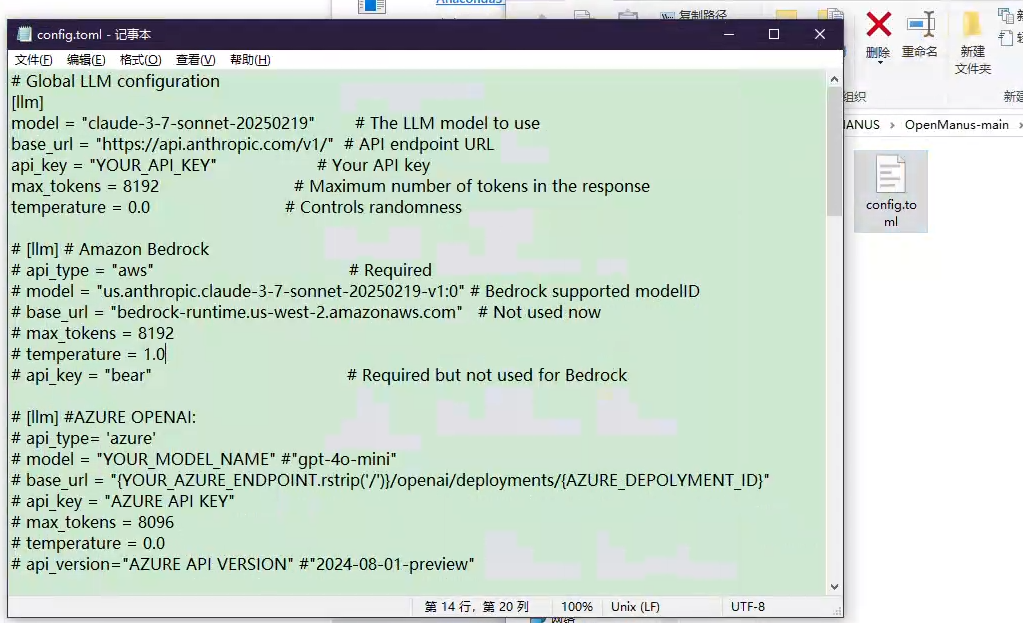

右键用记事本打开文件

注释掉示例全局调用的大模型

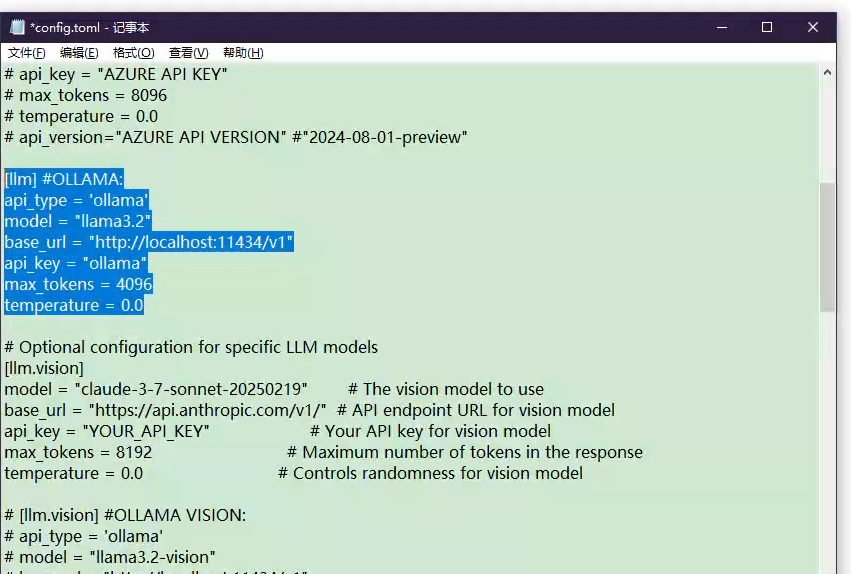

找到下面的OLLAMA解开注释。

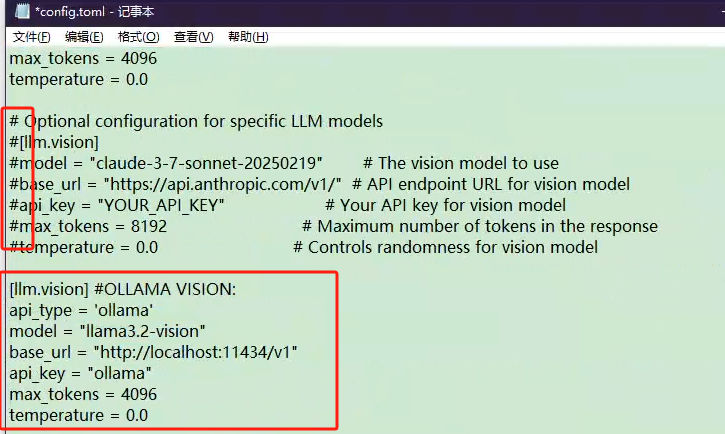

接着同理,注释掉示例指定调用的大模型,并换成本地OLLAMA

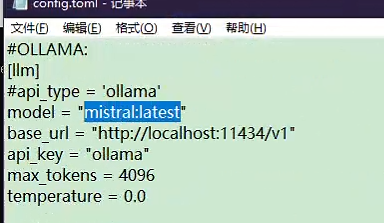

替换成本地的mistral模型名称和地址。

或者替换成其他在线模型:

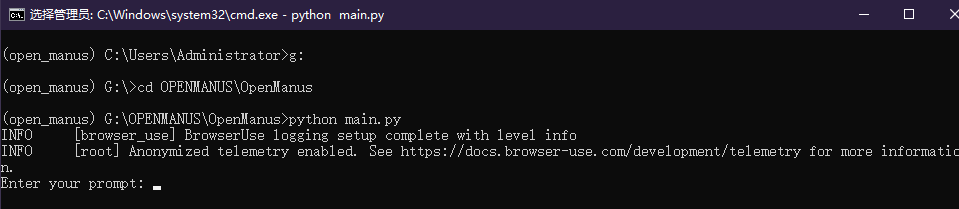

三、使用OpenManus

1.在conda环境中跑

cd到OpenManus源码路径下。

2.使用命令:

直接使用:

python main.py

调用MCP模式:

python run_mcp.py

多智能体模式:

python run_flow.py

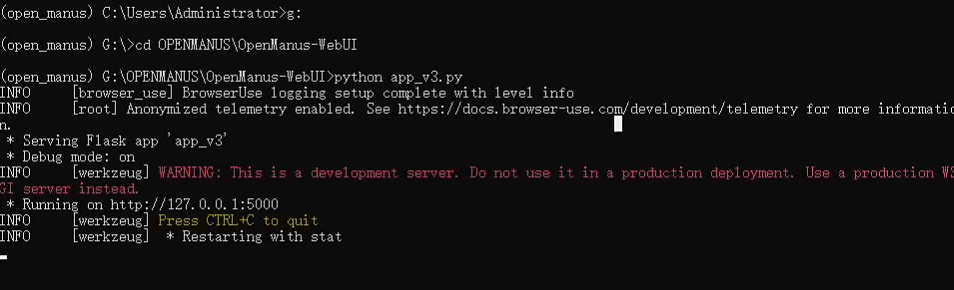

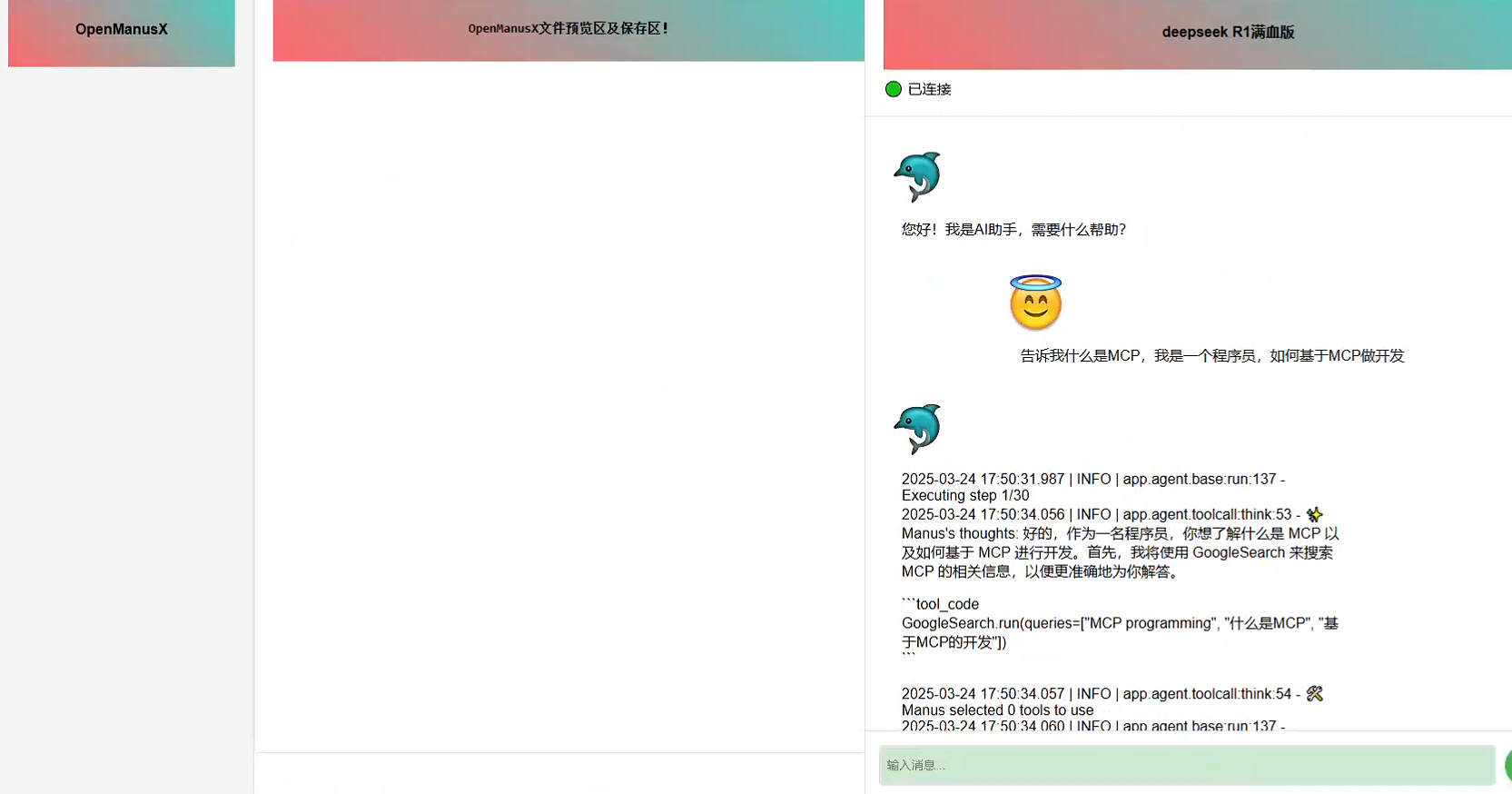

四、第三方WEB-UI工具访问

下载OpenManusWEBUI(直接下载zip解压)。

https://github.com/Shybert-AI/OpenManus-WebUI.git

从在conda环境cd到OpenManusWEBUI源码路径下

使用命令行

python app.py (替换成对应版本)

启动成功到这个地址访问:http://127.0.0.1:5000/

五 、疑难杂症

1.可能出现环境问题,顺便检查一下环境变量python版本是否正确,建议是刚好在3.12 ,并确保在conda环境而非系统环境下运行。

2.大部分问题都是因为大模型类型不兼容或者config配置有问题或者在线大模型被限制使用/本地模型跑不动/URL错误,请先尝试其他人正确配置的参数。

3.token限制超额,需要在config里调大。

4.基于google搜索引擎,需要梯子。

5.关注官方飞书讨论群。

8543

8543

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?