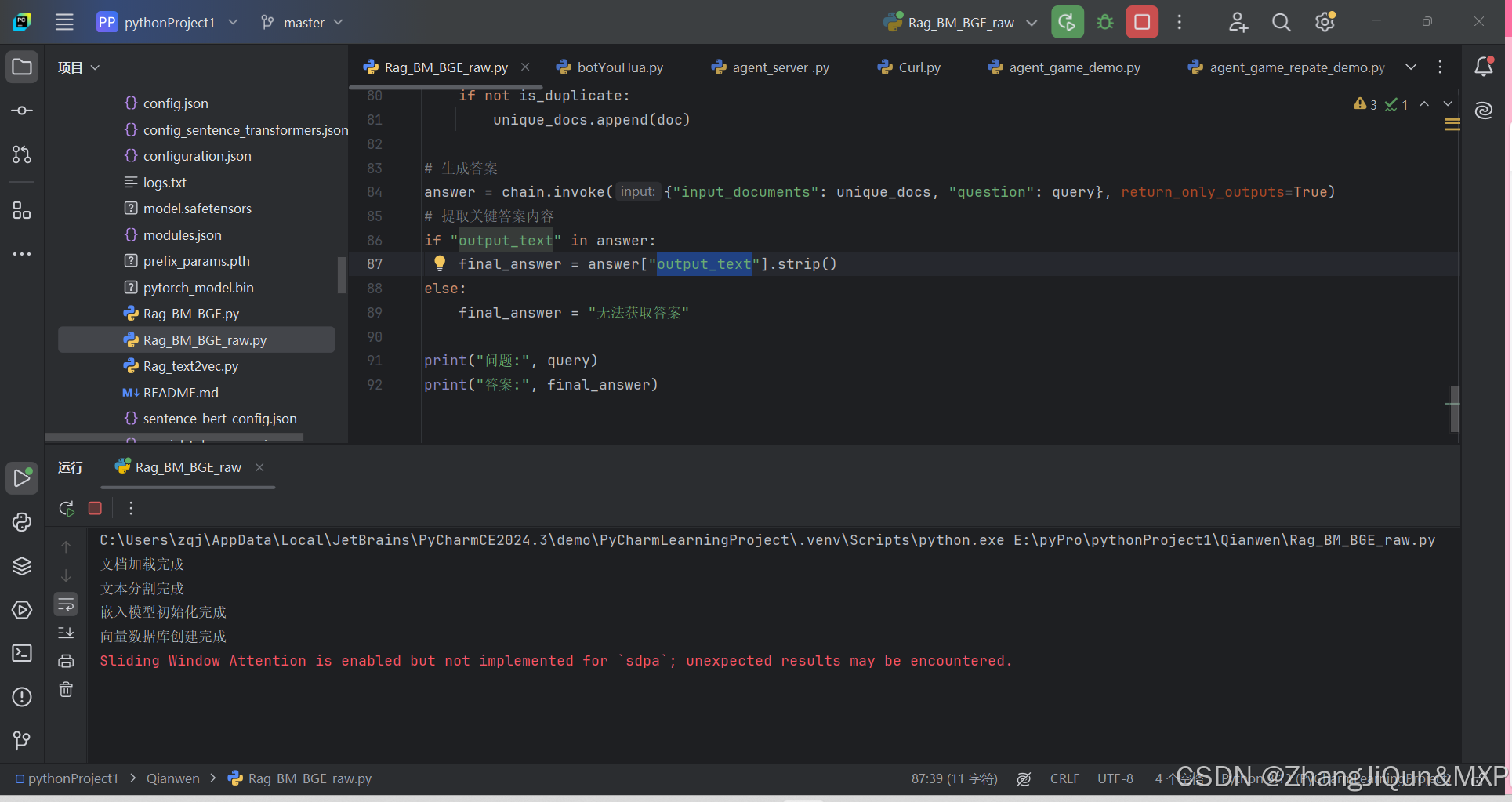

Sliding Window Attention is enabled but not implemented for sdpa; unexpected results may be encountered.

这个提示信息表明你启用了滑动窗口注意力(Sliding Window Attention),但使用的 sdpa(Scaled Dot-Product Attention)实现并不支持它,这可能会导致结果异常。下面是几种可能的解决办法:

1. 停用滑动窗口注意力

若你使用的库或者模型不支持 sdpa 的滑动窗口注意力,可尝试停用它。停用方法取决于你使用的框架与代码。以某个深度学习框架为例,可能会有类似如下的参数设置:

# 假设这里有一个配置对象 config

c

订阅专栏 解锁全文

订阅专栏 解锁全文

1586

1586

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?