ICLR 2024 reviewer 打分 888

1 论文思路

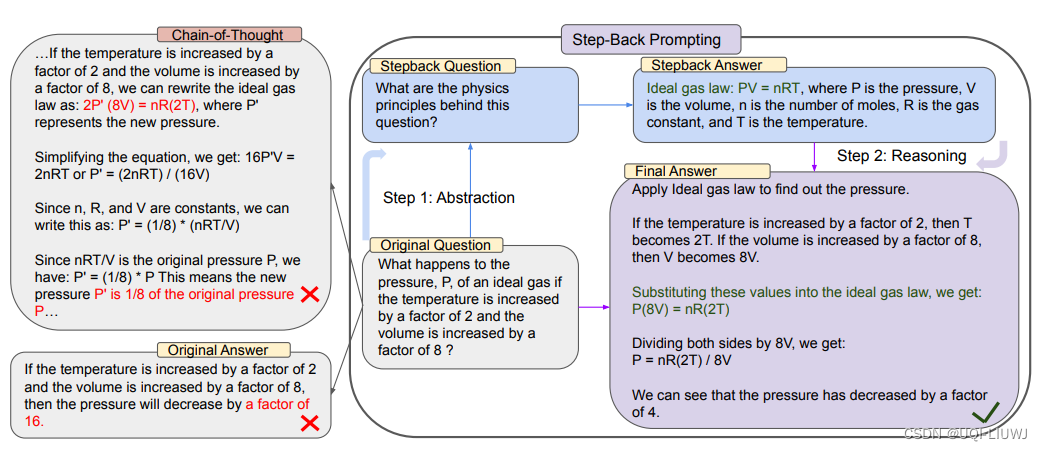

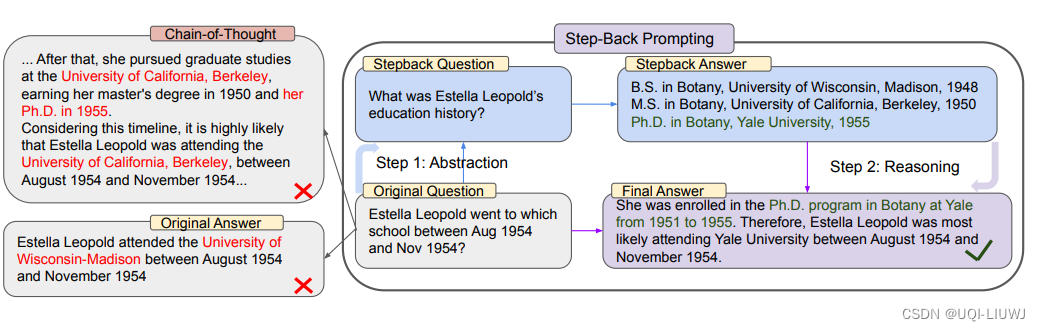

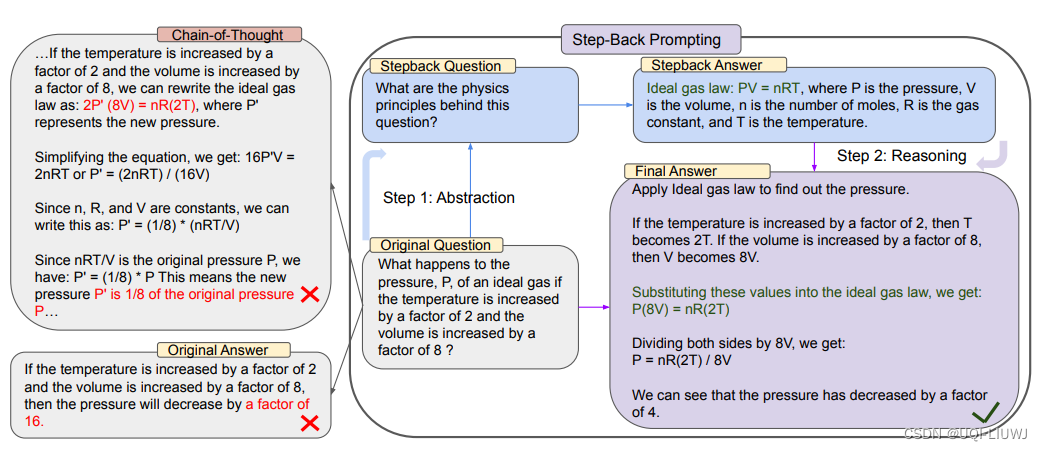

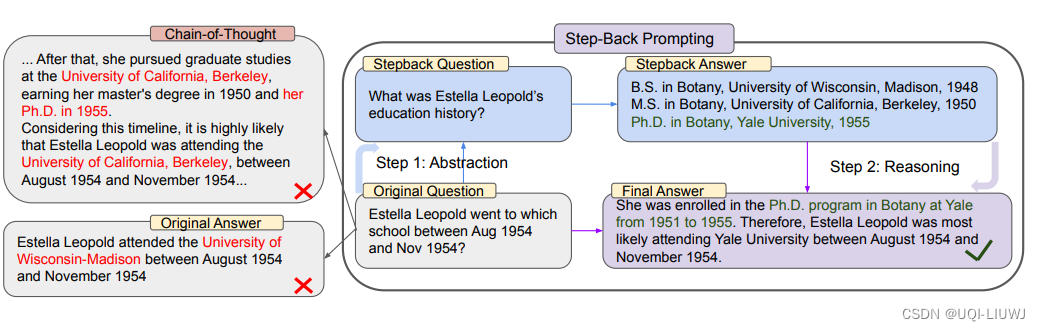

- 思路很简单,在进行prompt的时候,先后退一步,从更宏观的角度来看问题,让LLM对问题有一个整体的理解;然后再回到detail上,让模型回答更具体的问题

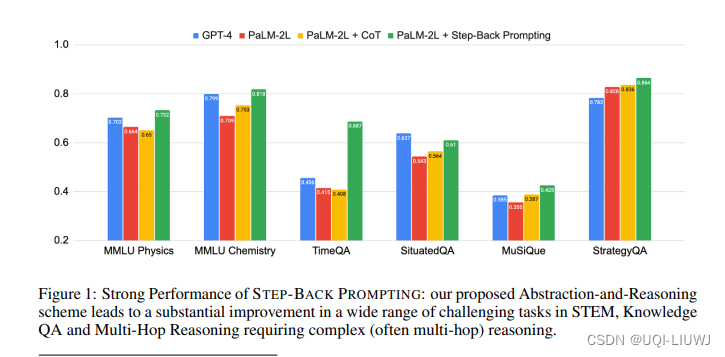

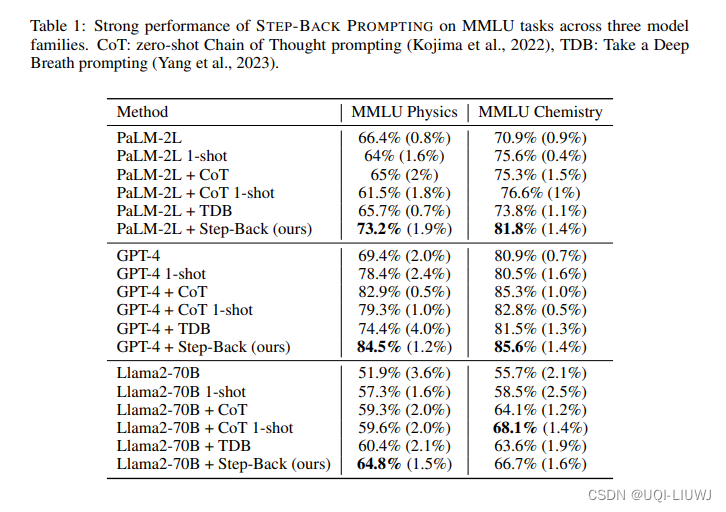

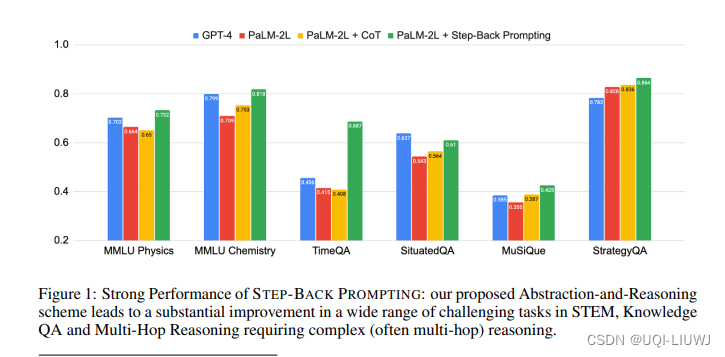

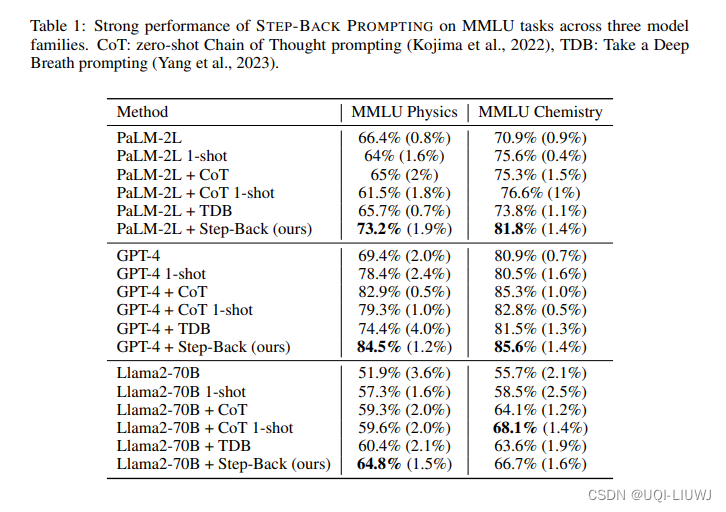

2 实验——STEM

MMLU 高中物理和化学基准测试

2.1 实验效果

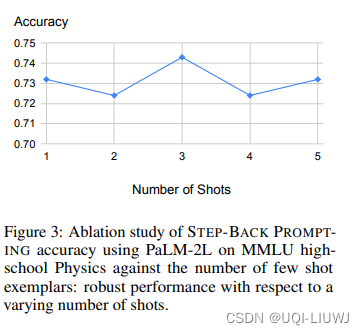

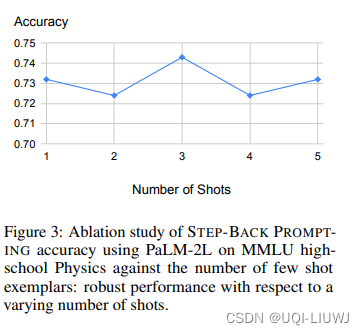

2.2 few-shot 例子数量的影响

2.3 错误案例分析

- 原则错误:错误发

ICLR 2024 reviewer 打分 888

MMLU 高中物理和化学基准测试

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?