iclr 2024 reviewer评分 568

- 现有的解释GNNs的尝试通常集中在局部级或全局级可解释性上

- 局部级解释器通常训练一个辅助模型来针对特定输入实例,识别最能解释预训练GNN行为的关键图结构

- 全局级解释器通过对解释实例进行原型学习或随机游走,提取多个图样本上的全局概念或反事实规则

- 全局解释更为健壮;局部解释更为直观和细致

- 论文介绍了一种计算效率高的局部级GNN解释技术,称为图输出归因(GOAt)

- 将GNN输出归因于输入特征,利用GNN前向传播中的重复求和-乘积结构

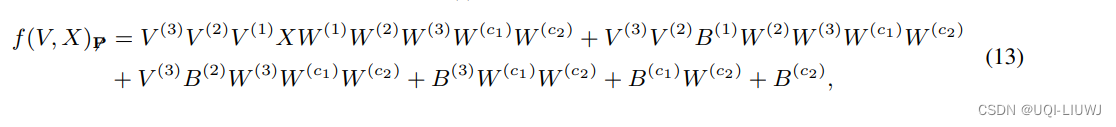

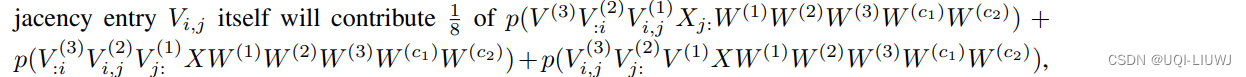

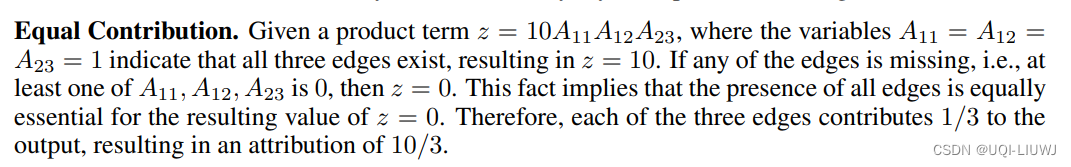

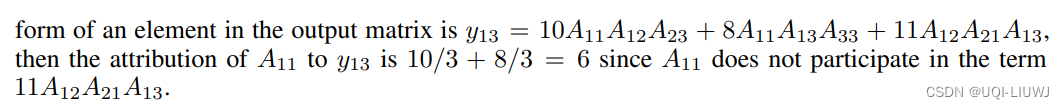

- 通过将GNN展开为涉及节点特征、边缘特征和激活模式的标量乘积之和,论文提出了一种高效的分析方法来计算每个节点或边缘特征对每个标量乘积的贡献,并聚合扩展形式中所有标量乘积的贡献,以推导出每个节点和边缘的重要性。

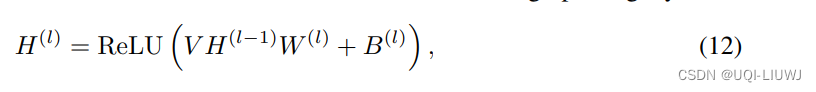

举例(GCN)【3层graph conv+2层MLP的分类层】

举例:

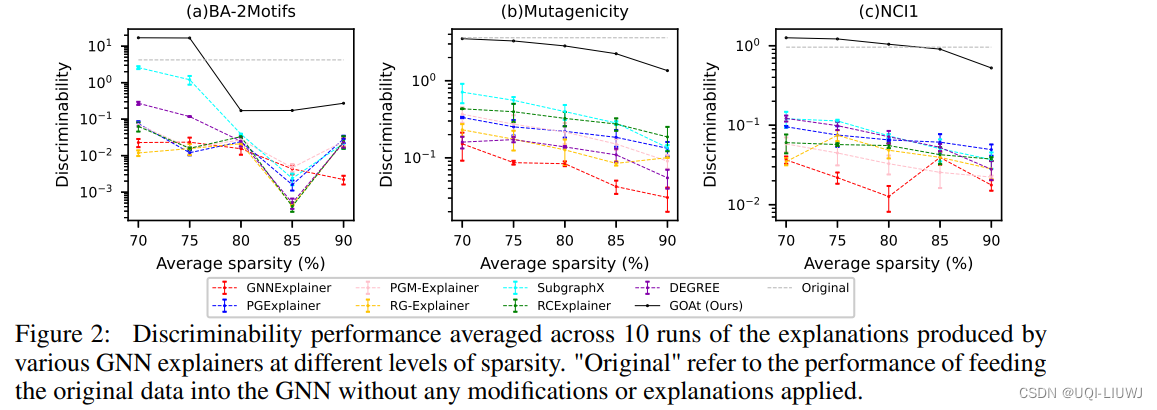

- 除了常用于评估GNN解释忠实度的忠实度指标外,论文还引入了两个新指标来评估解释的区分能力和稳定性,这两个方面在先前文献中较少被研究

- 区分能力是指解释区分不同类别的能力,通过不同类别的平均解释嵌入之间的差异来评估

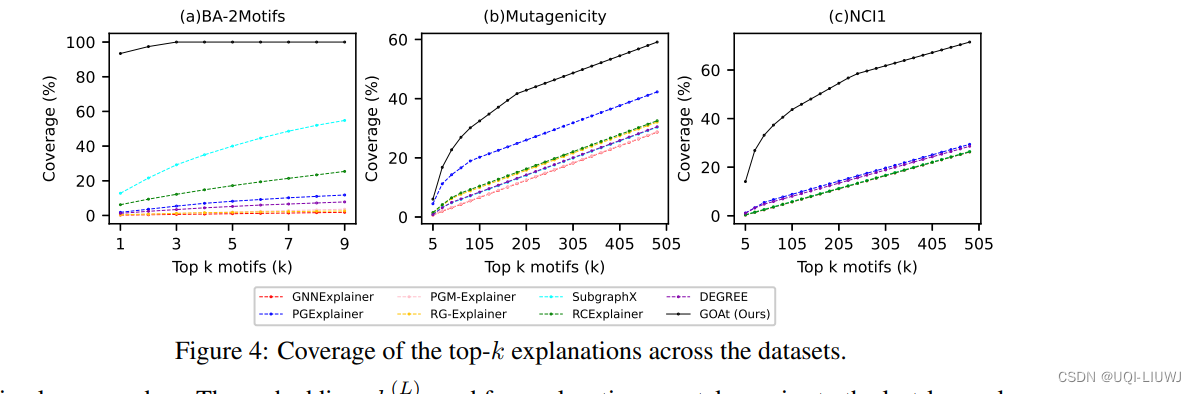

- 稳定性是指生成一致解释的能力,通过被前k个解释覆盖的数据样本百分比来衡量

3332

3332

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?