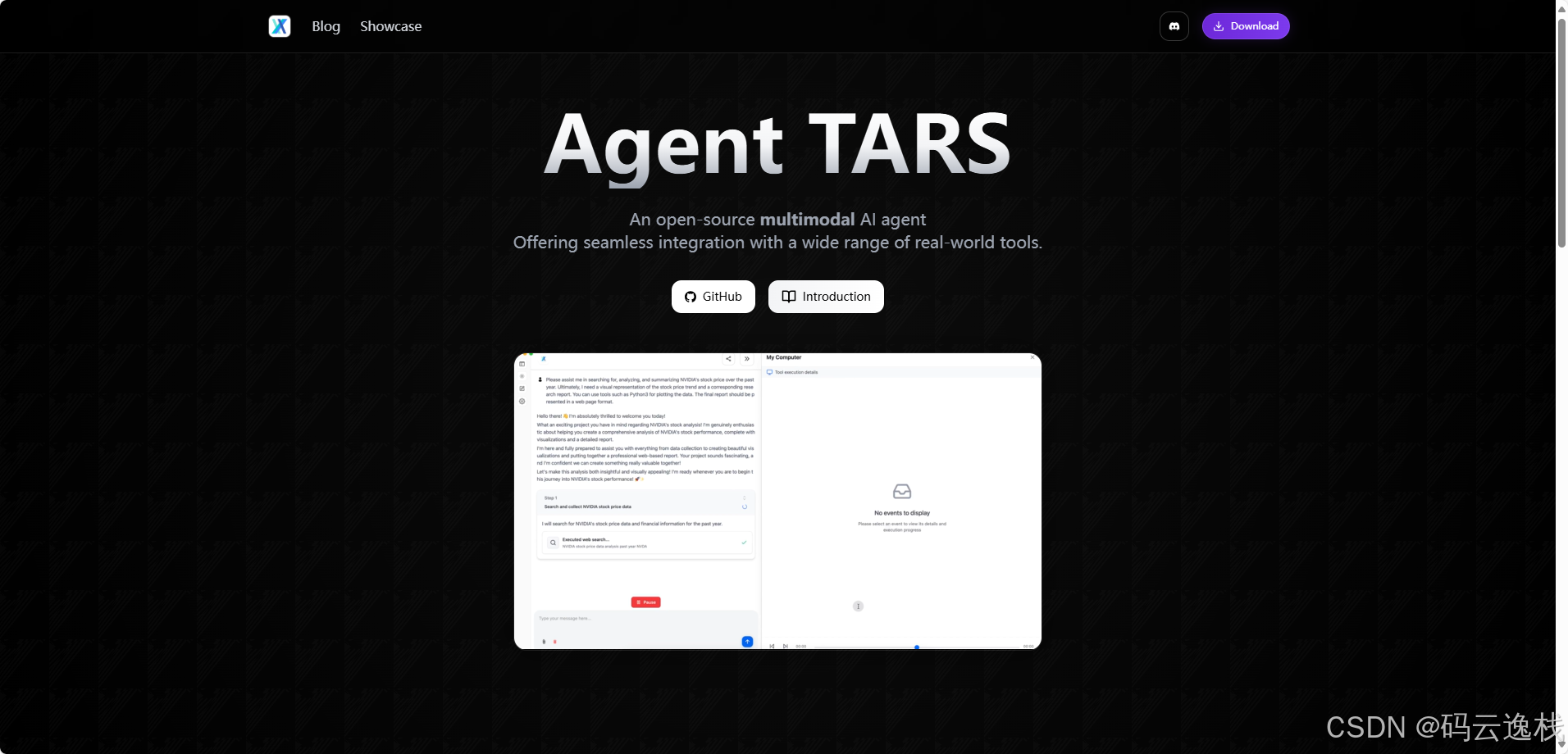

🚀Agent-TARS:革新人机交互的超强AI助手,你get了吗?

在AI技术一路狂飙的当下,字节跳动强势推出了一款堪称革命性的桌面应用——Agent-TARS。身为一名资深技术爱好者,我刚接触到它时,就被其强大功能深深震撼。它基于视觉语言模型,作为图形用户界面代理,成功将复杂繁琐的计算机操作变得轻松又智能,简直就是广大码农及普通用户的福音。接下来,就随我深入了解一下这款神器吧。

💥最新动态:技术预览版惊喜亮相

2025年3月18日,字节跳动正式发布了Agent TARS技术预览版。这一创新的多模态AI代理功能强大得超乎想象,它能像人类一样,通过视觉精准理解网页内容,还能与命令行、文件系统无缝协作,行云流水般执行各种浏览器操作。比如说,以前我们找资料,得在浏览器里各种搜索、筛选,现在有了Agent TARS,只需简单指令,它就能快速定位到我们想要的信息,大大提升了工作效率。

🤖技术原理:多模态AI构建强大内核

Agent-TARS能如此智能,得益于其背后先进的多模态AI技术。这里我给大家详细剖析一下:

- 视觉语言模型:它就像一个超级智能翻译官,能精准解读屏幕上的各类信息,无论是复杂的图表、密密麻麻的文字,还是各种图标,同时还能深度洞察我们的意图。举个例子,当我们在屏幕上看到一个技术文档,想提取关键信息,它能快速理解文档内容,并按照我们的需求进行处理。

- 深度学习算法:堪称精确的“定位大师”,在错综复杂的界面中,能瞬间定位到我们需要操作的元素,比如按钮、菜单等,为精准操作打下坚实基础。比如在一个满是功能按钮的软件界面中,它能快速找到我们想要点击的那个特定按钮。

- 自然语言处理:如同贴心的“智能小秘书”,能轻松理解并执行我们给出的复杂指令。不管是简单的“打开文件”,还是复杂的“将这个月的销售数据按照地区分类,生成可视化图表并发送给团队成员”,它都能完美执行。

对于开发者而言,实践是提升能力的最佳途径。所以我建了一个兼职接单群,群里会分享各类前端、后端及其他领域的编程兼职信息。无论你是想把所学用于实战,还是想增加收入,都欢迎加入。在这里,大家交流技术、分享经验,一起在编程道路上共同进步,感兴趣的小伙伴可私信我进群。

📥下载安装:轻松几步开启智能之旅

相信大家已经迫不及待想体验Agent-TARS了,下面讲讲下载安装的步骤。我们可以前往官网Agent TARS - Open-source Multimodal AI Agent进行下载。安装过程非常简单:

- 从官网下载最新版本的安装包,就像从软件宝库中挑选一件心仪的宝贝。

- 运行安装程序,按照清晰明了的提示一步步操作,就能轻松完成基础安装。

- 首次运行时,完成系统权限配置,这一步很关键,就像给Agent-TARS一把打开系统功能大门的钥匙,让它能充分施展才华。

⚙️配置说明:打造专属个性化体验

安装好后,初次使用Agent-TARS,合理配置能让它更好地为我们服务:

- 系统权限设置:通过精细设置,确保程序能够顺利访问系统的必要功能,这样它在执行任务时才不会遇到阻碍。

- 个性化设置:我们可以根据自己的使用习惯,自由调整界面布局和快捷键。比如我习惯用特定的快捷键快速打开某个功能,在这里就能轻松设置,让操作更加得心应手。

- API密钥配置:如果想要解锁高级功能,比如进行更复杂的数据分析、调用特定的API接口等,按要求配置相关API密钥即可,开启更广阔的智能应用天地。

🌟核心特性:重新定义人机交互新体验

Agent-TARS的一系列核心特性,简直就是人机交互领域的“王炸”:

- 自然语言控制:借助强大的视觉语言模型,实现了真正意义上的直观人机对话。我们只需用日常语言下达指令,比如“打开音乐播放器,播放周杰伦的热门歌曲”,它就能迅速理解并执行,沟通就像和朋友聊天一样顺畅。

- 智能视觉识别:支持便捷的截图操作,并且能对截图及各种视觉内容进行深度理解。比如我们截了一张技术图纸,它能识别出图纸中的关键信息,帮助我们进行分析,大大提高了信息处理效率。

- 精确控制:以超高精度模拟鼠标和键盘操作,无论是精准点击一个小图标,还是复杂的组合键操作,它都能精准复现,确保任务执行毫无差错。

- 跨平台兼容:不管我们使用的是Windows系统,还是MacOS系统,Agent-TARS都能完美适配,打破了系统之间的壁垒,为不同用户提供一致的优质体验。

- 实时反馈:在任务执行过程中,它会即时反馈操作状态,我们能随时了解任务进展。比如在下载一个大文件时,能实时看到下载进度,心里更有底。

- 安全可靠:秉持用户隐私至上的原则,所有处理都在本地完成,不用担心数据泄露风险,使用起来超级安心。

📖使用指南:轻松驾驭智能助手

使用Agent-TARS其实非常简单,跟着下面的步骤来:

- 启动程序,等待初始化完成,就像启动一辆高性能跑车前的预热。

- 用自然语言详细描述想要执行的任务,比如“在浏览器中搜索最新的人工智能技术文章”。

- 仔细确认AI对任务内容的理解是否准确,如果理解有误,及时调整表述,确保它明白我们的意图。

- 实时监控任务执行过程,根据实际情况随时调整任务细节。比如在下载文件时,如果发现下载源速度慢,我们可以让它更换下载源。

🎯使用示例:感受智能魅力

为了让大家更直观地感受Agent-TARS的强大,这里有两个实用演示案例:

- 天气查询:我们只需发出指令“用网页浏览器查询旧金山当前天气”,它就能迅速启动浏览器,精准定位并呈现旧金山的实时天气信息,包括温度、湿度、天气状况等,比我们自己手动查询快多了。

- 社交媒体操作:当我们要求“在社交媒体上发布内容为‘今天学习了新的技术,收获满满’的动态”时,它会自动登录社交媒体平台,完成内容编辑与发布,整个过程一气呵成,非常便捷。

🚀快速上手:迅速融入智能生态

对于想快速上手Agent-TARS的小伙伴们,这里有几个好办法:

- 访问官方文档,查阅快速开始指南,按照详细步骤,能快速熟悉Agent-TARS的基本操作和核心功能,就像找到了一本快速入门秘籍。

- 参考部署文档,无论是在个人电脑上安装,还是在复杂的工作环境中部署,都能按照步骤顺利完成。

- 如果是开发者,SDK文档就是我们的宝藏,它能帮助我们深入了解开发相关信息,基于Agent-TARS开发出更多创新应用,挖掘它的无限潜力。

特别值得一提的是,今年二月,该项目推出了UI TARS SDK,这对开发者来说,简直就是一套超级强大的工具包,大大降低了开发GUI自动化代理的难度,激发了大家的创新热情。同时,云部署文档也得到了更新,新增了魔搭平台的部署支持,为用户提供了更丰富、更灵活的部署选择。

对于致力于深入研究该项目的研究者和开发者,Agent-TARS提供了全方位的支持。我们可以在arXiv上找到相关研究论文,从理论层面深入了解它的技术原理和创新点;还能通过Hugging Face和魔搭社区便捷获取模型资源,为研究和实践提供有力支撑。

总的来说,Agent-TARS凭借其强大的功能、创新的技术和贴心的设计,引领人机交互进入了一个全新的智能时代。无论是技术从业者,还是普通电脑用户,都值得花时间去深入探索和尝试,相信它一定会给你带来意想不到的惊喜。大家有什么使用感受或者想法,欢迎在评论区留言交流哦。

846

846

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?