《------往期经典推荐------》

二、机器学习实战专栏【链接】,已更新31期,欢迎关注,持续更新中~~

三、深度学习【Pytorch】专栏【链接】

四、【Stable Diffusion绘画系列】专栏【链接】

五、YOLOv8改进专栏【链接】,持续更新中~~

六、YOLO性能对比专栏【链接】,持续更新中~

《------正文------》

目录

效果展示

摘要

- 核心问题:现有基于学习的去雾算法在合成数据上表现优异,但受计算资源限制和真实场景多样性影响,真实图像去雾仍面临挑战。

- 解决方案:提出压缩-适应(CoA)计算流程,通过分治策略:

- 压缩阶段:在合成域构建紧凑去雾参数空间以满足效率需求;

- 适应阶段:通过双层适应机制聚合合成域知识,提升对未知真实场景的适应性。

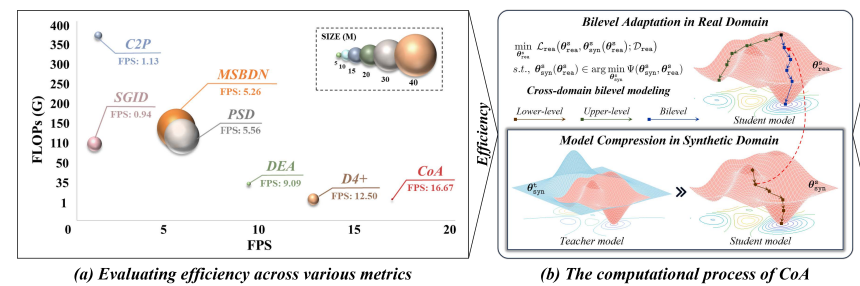

- 优势:无需额外约束的简洁设计,具有跨域稳定性(平均指标提升14.2%)和模型无关灵活性(参数量减少≥73%)。

1. 引言

- 研究背景:

- 去雾技术从早期关注合成数据指标转向真实场景泛化;

- 现有方法面临效率与适应性的矛盾:高效方法缺乏场景适应性,自适应方法计算复杂度高。

- 相关工作:

- 高效去雾方法:基于图像增强、物理模型或分层处理,但稳定性不足;

- 自适应去雾方法:基于局部特征、大气散射模型或域适应,计算成本较高。

- 本文贡献:

- 首次提出分阶段CoA策略,兼顾效率与适应性;

- 设计跨域双层模型,利用合成域知识约束真实域参数学习;

- 通过简洁设计实现稳定性和灵活性。

2.创新点

- 分治策略创新

- 首次将模型压缩(效率优化)与域适应(性能优化)解耦

- 突破传统方法"效率-适应性"不可兼得的困境

- 双层适应机制

- 上层:CLIP引导的真实域约束

- 下层:合成域知识锚定优化方向

- 通过EMA实现渐进式知识迁移

- 工程友好设计

- 无需额外约束条件

- 支持即插即用(兼容现有去雾模型)

- 参数量最低仅1.69M(对比D4的10.7M)

3. 实验结果

3.1 实现细节

- 训练设置:Adam优化器,初始LR=1e-4,余弦退火至1e-6;

- 评估基准:3合成数据集+3真实数据集;

- 对比方法:涵盖SGID/C2P/D4等10+种SOTA方法。

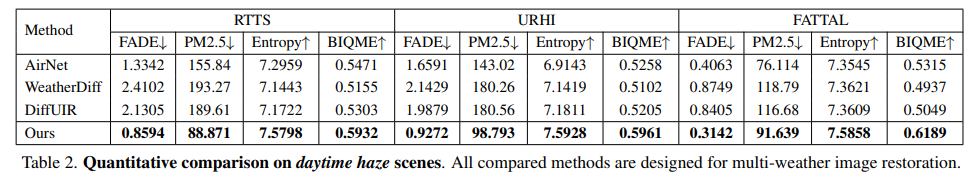

3.2 常规场景评估

定量结果:

- 在RTTS/URHI/FATTAL上,CoA在多数指标领先;

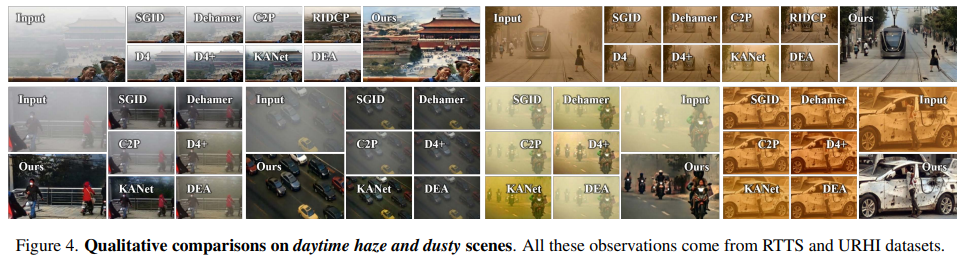

定性对比:

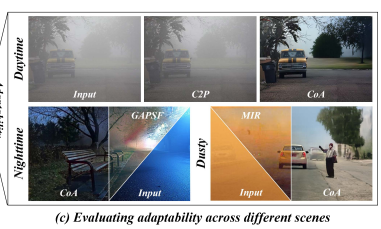

- 相比其他方法,CoA在沙尘/彩色雾霾场景中保持更自然的色彩和纹理。

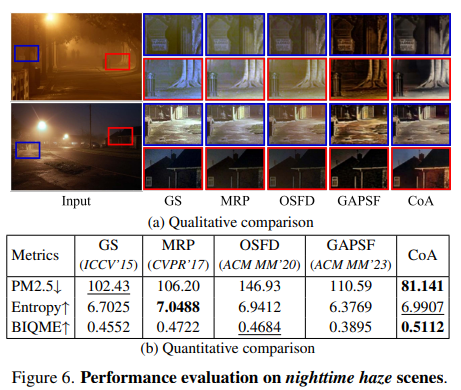

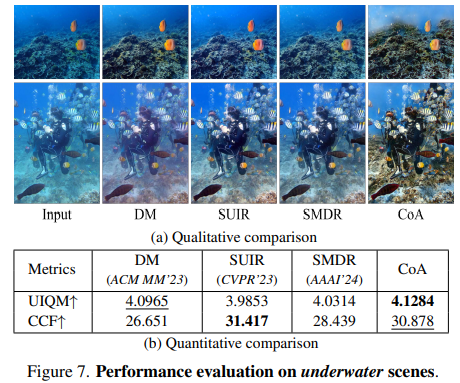

4.适应性验证

-

夜间去雾:有效处理过曝光和人工光源散射;

-

水下增强:显著提升清晰度,优于DM/SUIR等方法。

5. 分析实验

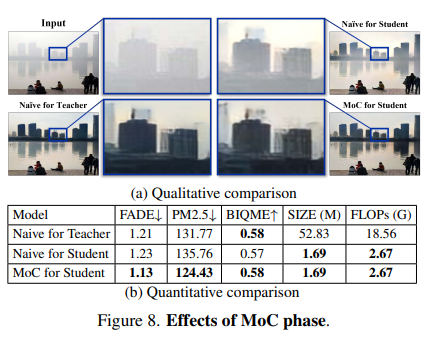

5.1 MoC阶段影响

- 关键发现:无特征迁移的"朴素学生模型"性能显著下降(图8)。

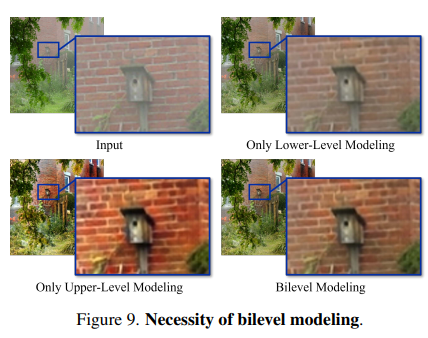

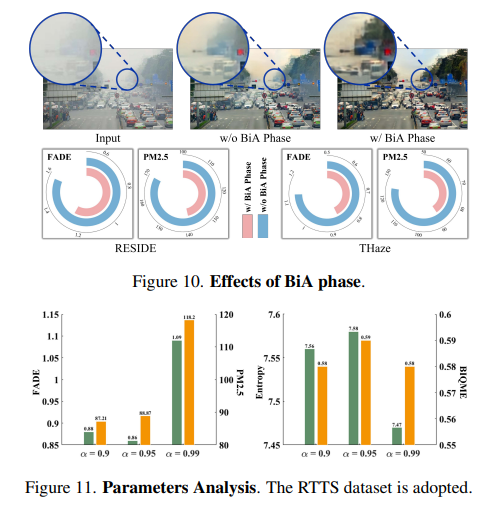

5.2 双层建模必要性

对比实验:

- 仅下层优化:去雾不彻底;

- 仅上层优化:出现色彩失真。

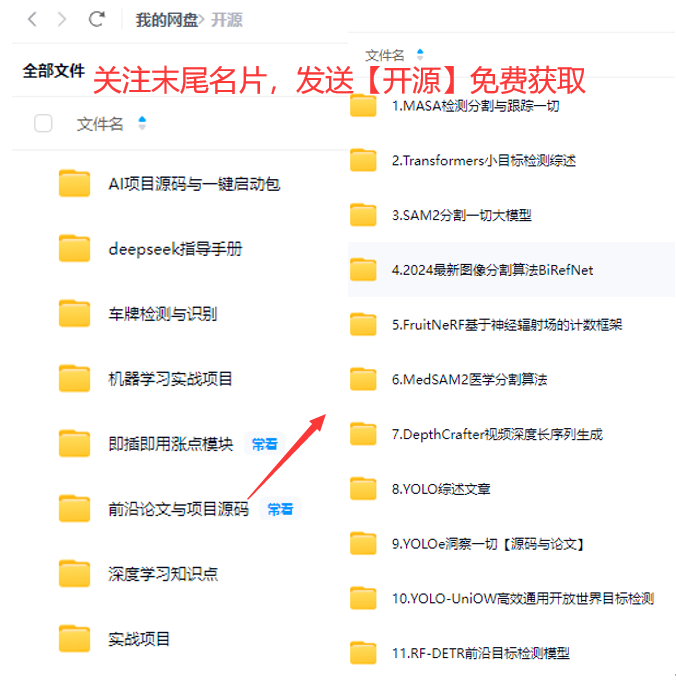

5.4 参数分析

- 最优α值:0.95时收敛最快且性能稳定。

6. 结论与展望

- 创新点:首次通过分治策略平衡去雾效率与适应性;

- 局限性:对遥感雾霾图像处理不足;

参考

论文地址:https://arxiv.org/abs/2504.05590

代码地址:https://github.com/fyxnl/COA

好了,这篇文章就介绍到这里,喜欢的小伙伴感谢给点个赞和关注,更多精彩内容持续更新~~

关于本篇文章大家有任何建议或意见,欢迎在评论区留言交流!

1029

1029

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?