《------往期经典推荐------》

二、机器学习实战专栏【链接】,已更新31期,欢迎关注,持续更新中~~

三、深度学习【Pytorch】专栏【链接】

四、【Stable Diffusion绘画系列】专栏【链接】

五、YOLOv8改进专栏【链接】,持续更新中~~

六、YOLO性能对比专栏【链接】,持续更新中~

《------正文------》

本文主要介绍如何在本地计算机上可视化部署阿里最新发布的Qwen3大模型,小伙伴们一起体验起来吧~

1.安装ollama

首先,进入ollama官网:https://ollama.com/,点击Download,下载自己系统对应的ollama,并安装。

2.下载Qwen3

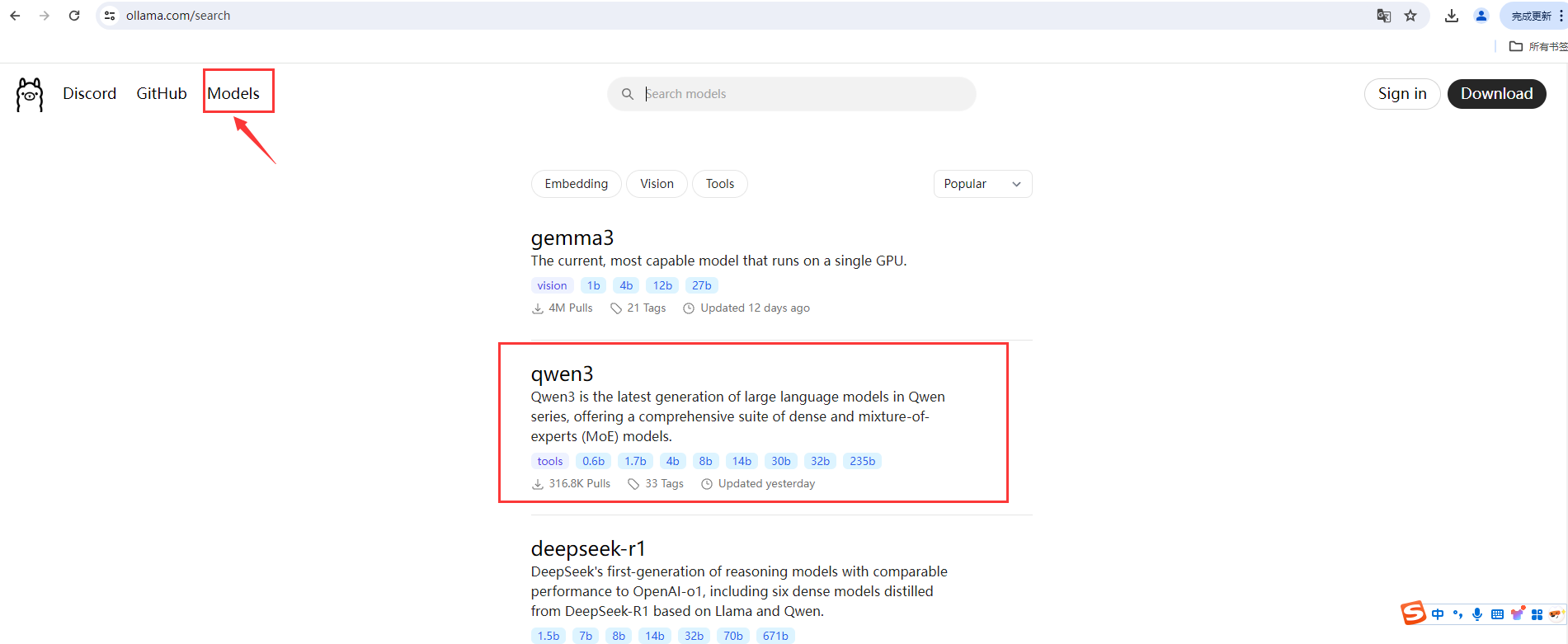

在ollama官网,点击上方的Models,会出现很多模型列表。我们直接点击第二个qwen3。

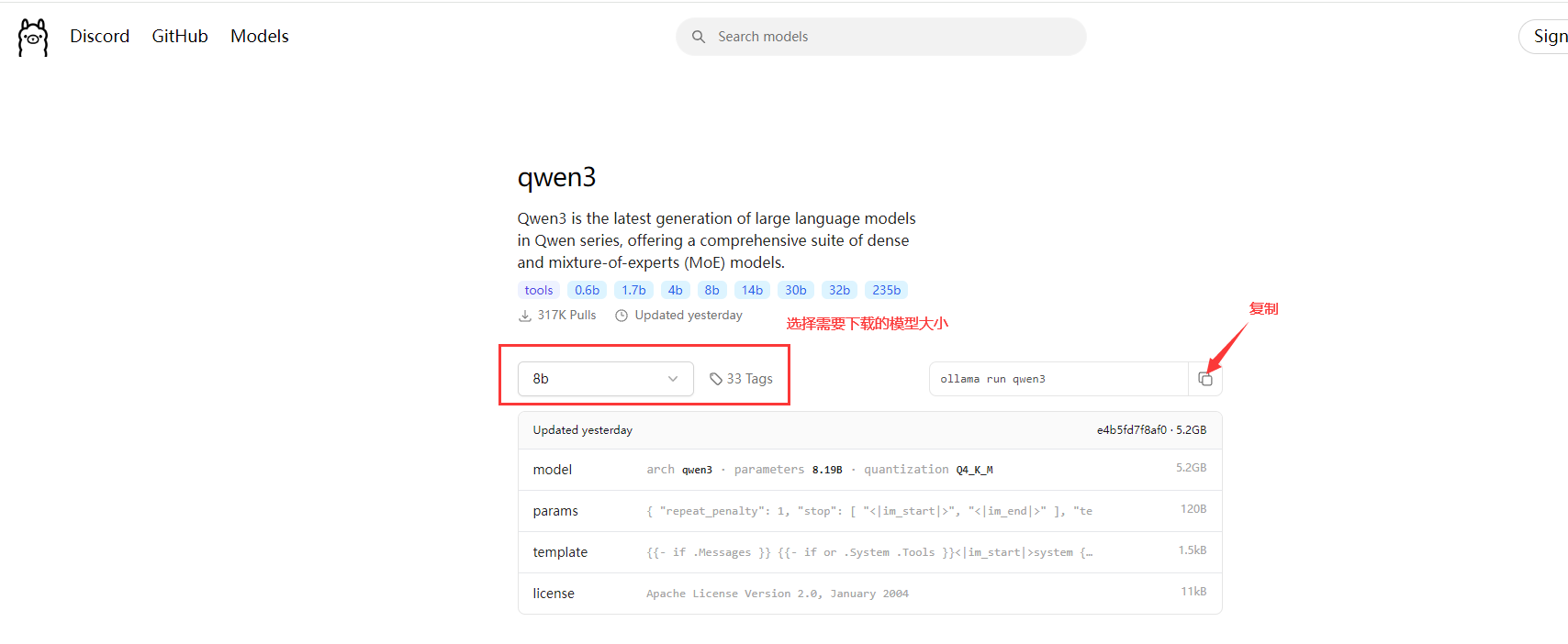

在左侧的下拉框可以选择qwen3的不同模型大小,我们这里直接选择8b的进行下载。点击箭头处的复制命令按钮,复制一下运行模型的命令ollama run qwen3。

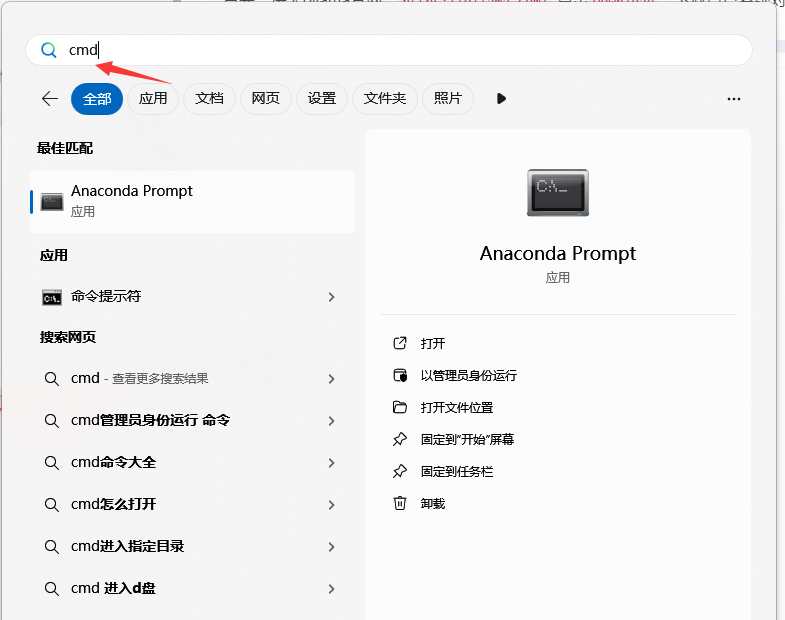

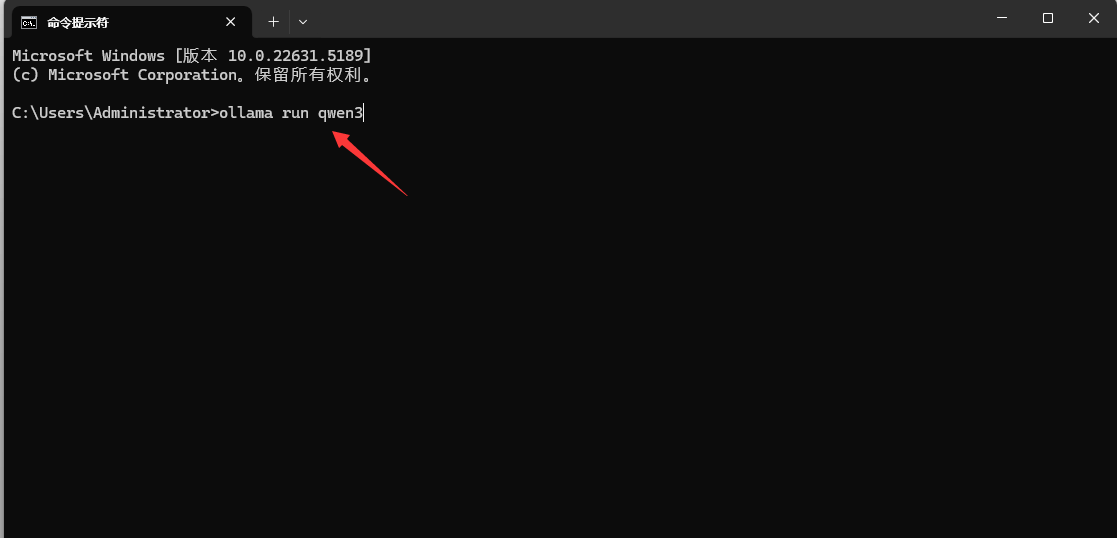

然后在电脑开始菜单栏。输入cmd回车,打开电脑终端;

在打开的电脑终端,粘贴刚才复制的命令,之后回车:

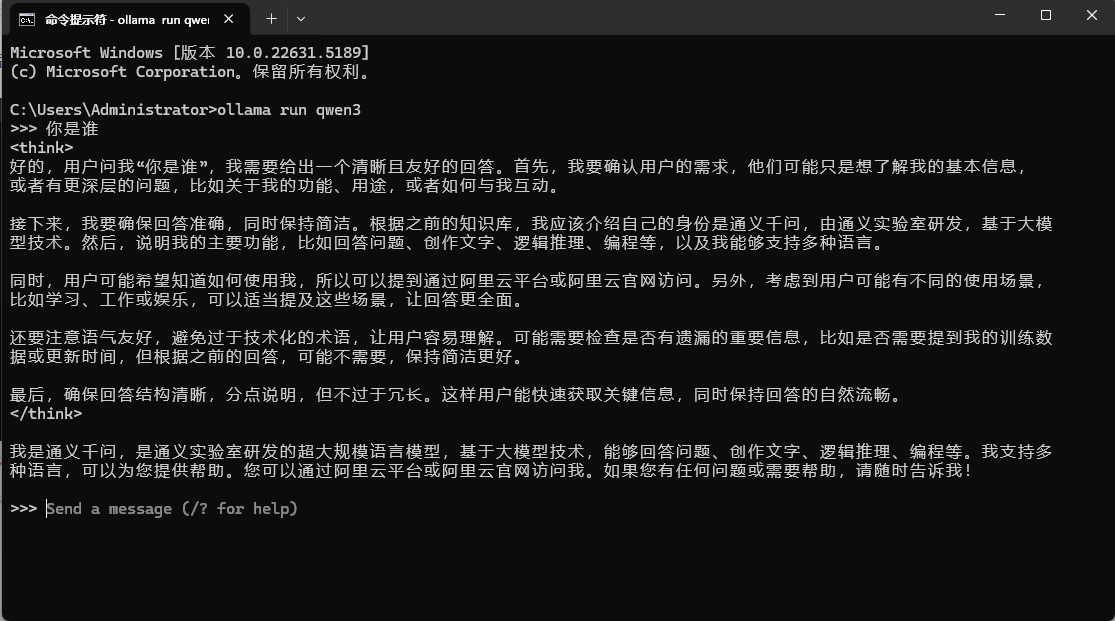

然后会自动下载模型,模型下载后,会自动运行。之后在终端可以开始对话,如下:

技巧:在输入的问题后面,加上/think 或者/nothink 可以切换是否开启模型的思考模式。/nothink 表示不思考。

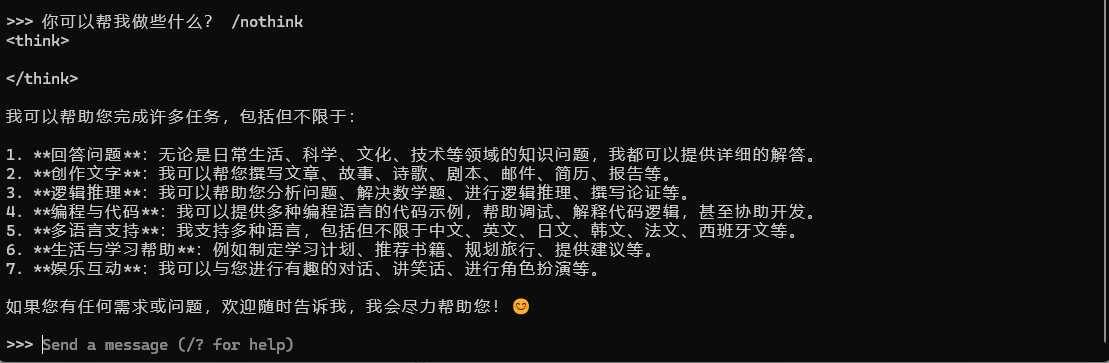

不开启思考模式,测试如下:

3.界面运行Qwen3

上述方法可以在终端进行对话,但是看起来不太友好。下面chatwise来进行qwen3的可视化运行。

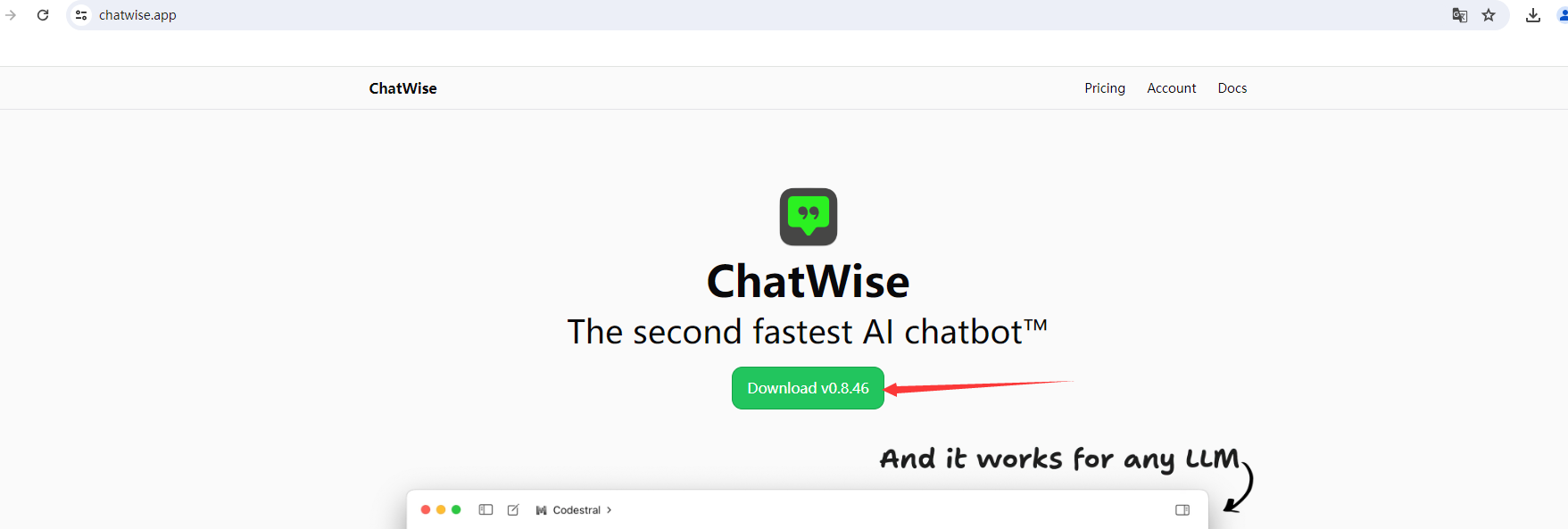

打开chatwise官网:https://chatwise.app/。下载并安装chatwise。

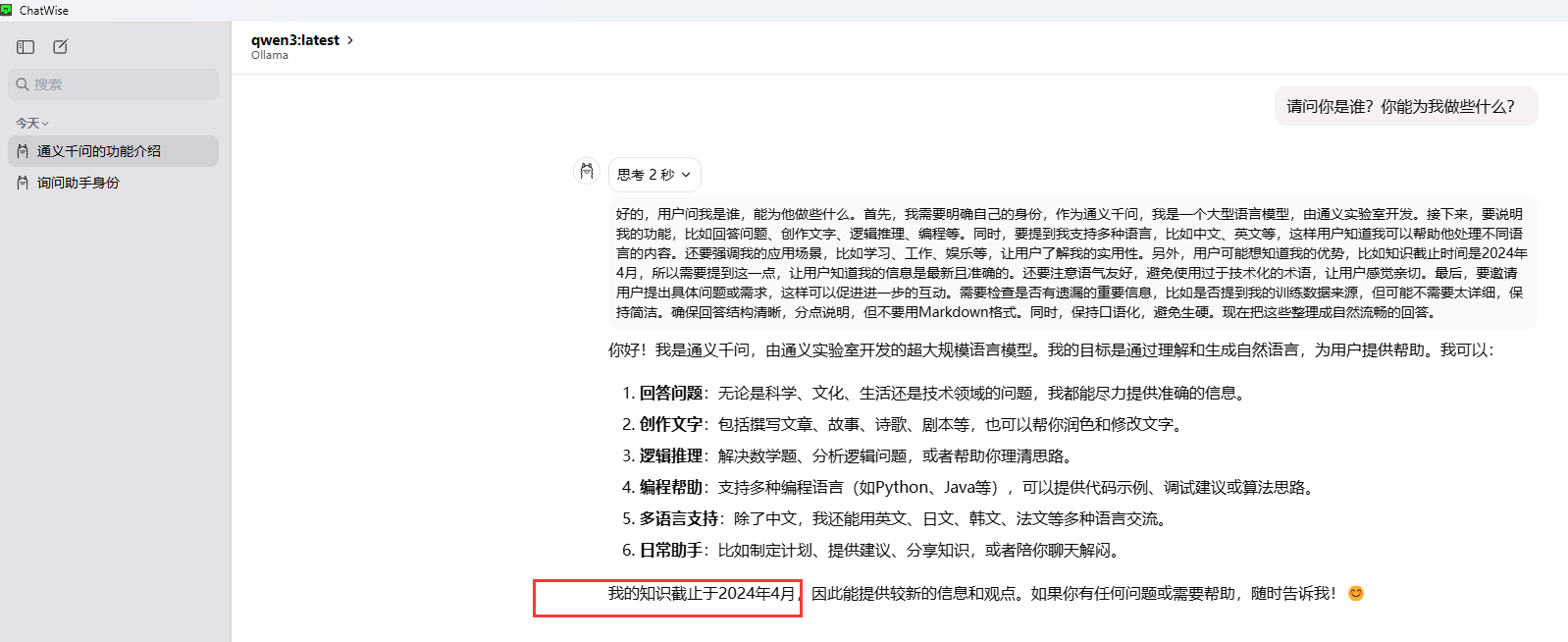

然后,我们就可以在chatwise里选择ollama下载好的模型,愉快的对话啦,如下:

千问3的知识库截止2024年4月,看来这模型也是耗费了不少时间才训练出来的,要不然也不会知识库也不会只更新到了2024年4月。

好了,基于上述步骤,我们的qwen3大模型就在本地部署好了。小伙伴们,愉快的玩起来吧~

好了,这篇文章就介绍到这里,喜欢的小伙伴感谢给点个赞和关注,更多精彩内容持续更新~~

关于本篇文章大家有任何建议或意见,欢迎在评论区留言交流!

14万+

14万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?