Boosting Adversarial Attacks with Momentum(CVPR2018)

摘要:

现有的方法比如FGSM和I-FGSM都容易陷入过拟合和局部最优的问题,并且移植性较差,对黑盒攻击的效率很低。本文提出一种广泛的基于动量的迭代算法来增强对抗性攻击,该方法可以在迭代过程中稳定更新方向并避免局部极大值,解决了对抗样本生成算法对于黑盒模型的低成功率问题。

文中提到:

- 对抗样本的移植性是由于不同的模型在数据点周围学习到相似的决策边界这一特性导致的,使得同一对抗样本可以攻击不同模型。

- 以往的FGSM、I-FGSM得到的对抗样本移植性较差,对黑盒模型的攻击成功率都比较低。

- FGSM得到的对抗样本虽然迁移性不错,但对白盒模型的攻击成功率过低,使得基本无法攻击黑盒模型。

- 首次证明通过对抗训练获得的具有强大防御能力的模型也容易受到黑盒攻击。

算法主要流程:

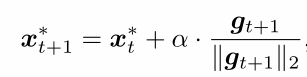

以上是在无穷范数得约束下进行的,那么在L2范数下呢?

这里g t+1就是上面公式6得到的,换成L2范数就变成了I-FGM算法。

拓展:

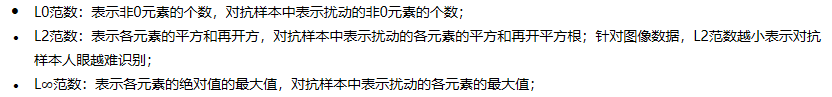

为什么L2、和无穷范数的公式是这样的呢?首先看一下这些范数的定义:

定义比较字面意思,无法深刻的理解,那么再看这一张图:

大致理解范数的定义之后,我们再来将文中的公式来推导一遍,为了更好理解采用FGSM(无穷范数)、FGM(L2范数)的公式来推导:

欢迎批评指正!

2158

2158

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?